深度学习单机多卡GPU 用mpirun跑分布式训练,2卡不报错正常运行,但是4卡GPU或8卡GPU报错无法解决

***************************************************解答*****************************************************从你的截图里只知道你在第三张卡(rank2)上的程序被killed了,signal 9 是linux scheduler杀死进程而非进程自己退出(用2GPU可以跑,但是4GPU或8GPU会

·

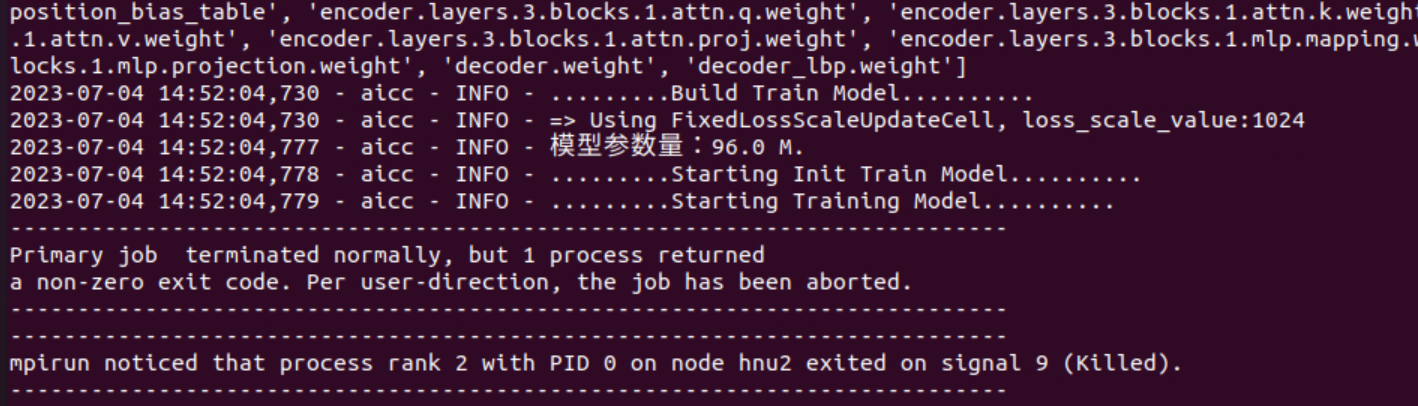

用2GPU可以跑,但是4GPU或8GPU会报下面的错误

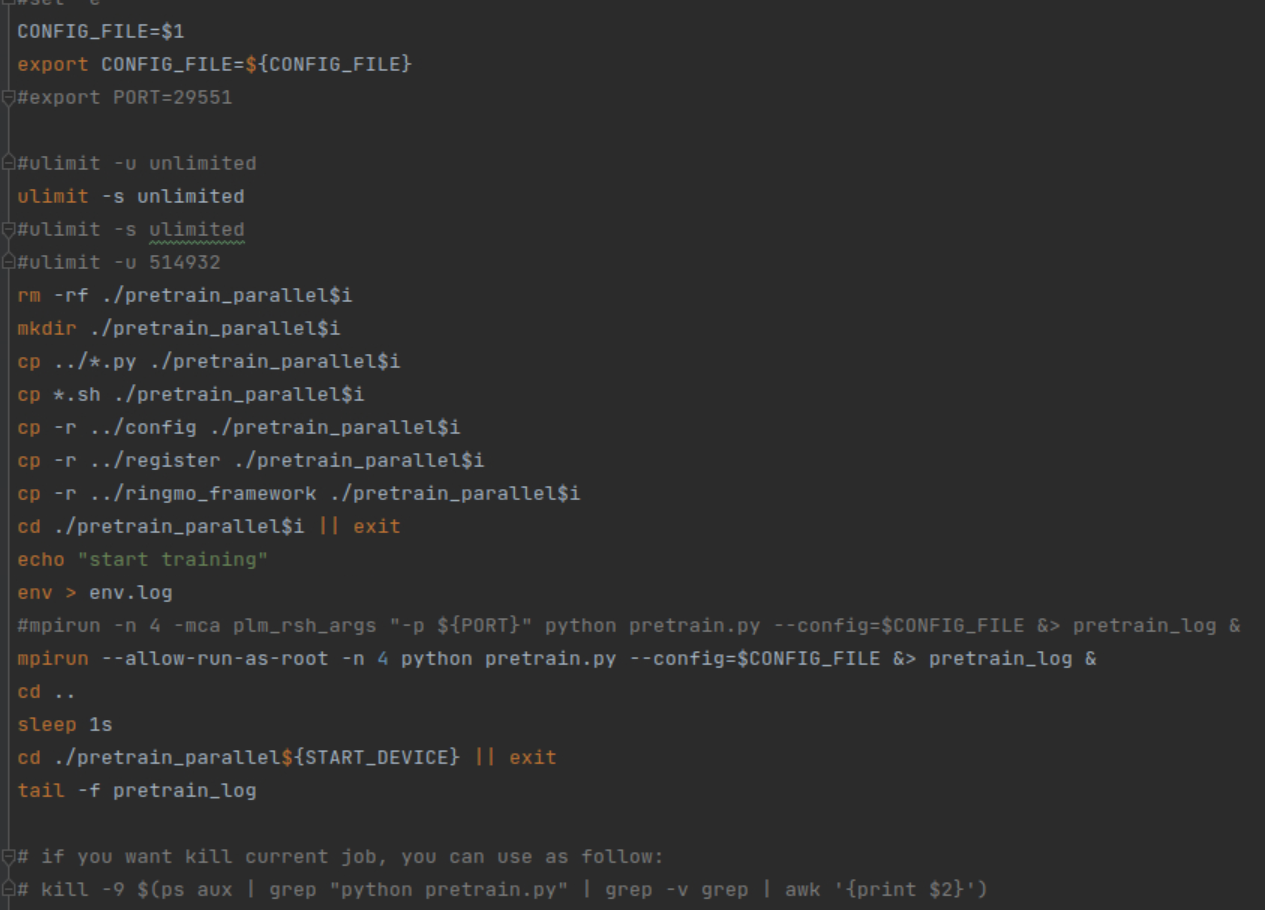

上图分别是报错提示和运行训练的指令

****************************************************解答*****************************************************

从你的截图里只知道你在第三张卡(rank2)上的程序被killed了,signal 9 是linux scheduler杀死进程而非进程自己退出(stackoverflow 参考)。你的程序内的错误信息被隐藏了

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)