3行代码解决大模型训练难题:Gated Attention让Transformer性能飙升!

文章介绍阿里Qwen团队提出的Gated Attention方法,通过在Transformer的SDPA输出后添加简单的Head-Specific Sigmoid门控,实现显著性能提升。这一微小改动(仅需3行代码)可降低PPL、消除训练Loss Spike、解决注意力陷阱问题,并提升长上下文处理能力。该方法通过引入非线性和稀疏性打破原有限制,增加参数极少(15B模型<2M),是值得实践的大模型优化

简介

文章介绍阿里Qwen团队提出的Gated Attention方法,通过在Transformer的SDPA输出后添加简单的Head-Specific Sigmoid门控,实现显著性能提升。这一微小改动(仅需3行代码)可降低PPL、消除训练Loss Spike、解决注意力陷阱问题,并提升长上下文处理能力。该方法通过引入非线性和稀疏性打破原有限制,增加参数极少(15B模型<2M),是值得实践的大模型优化技巧。

在 Transformer 架构统治 LLM 的当下,我们是否还能对标准的多头注意力(MHSA)进行简单的“手术”以获得显著收益?

来自阿里 Qwen 团队等机构的最新研究 《Gated Attention for Large Language Models》 给出了肯定的答案。通过在 SDPA(Scaled Dot-Product Attention)输出后增加一个简单的 Head-Specific Sigmoid 门控,不仅显著降低了 PPL,更重要的是消除了 Loss Spike(训练飞升),并意外地解决了“Attention Sink(注意力陷阱)”问题。

一、极简的改动,显著的收益 🚀

Transformer 的注意力机制自 2017 年提出以来,其核心结构相对稳定。虽然我们见惯了在 FFN 中使用门控(如 SwiGLU),但这篇论文提出了一个直击灵魂的问题:

如果在标准的 Softmax Attention 内部引入门控,会发生什么?

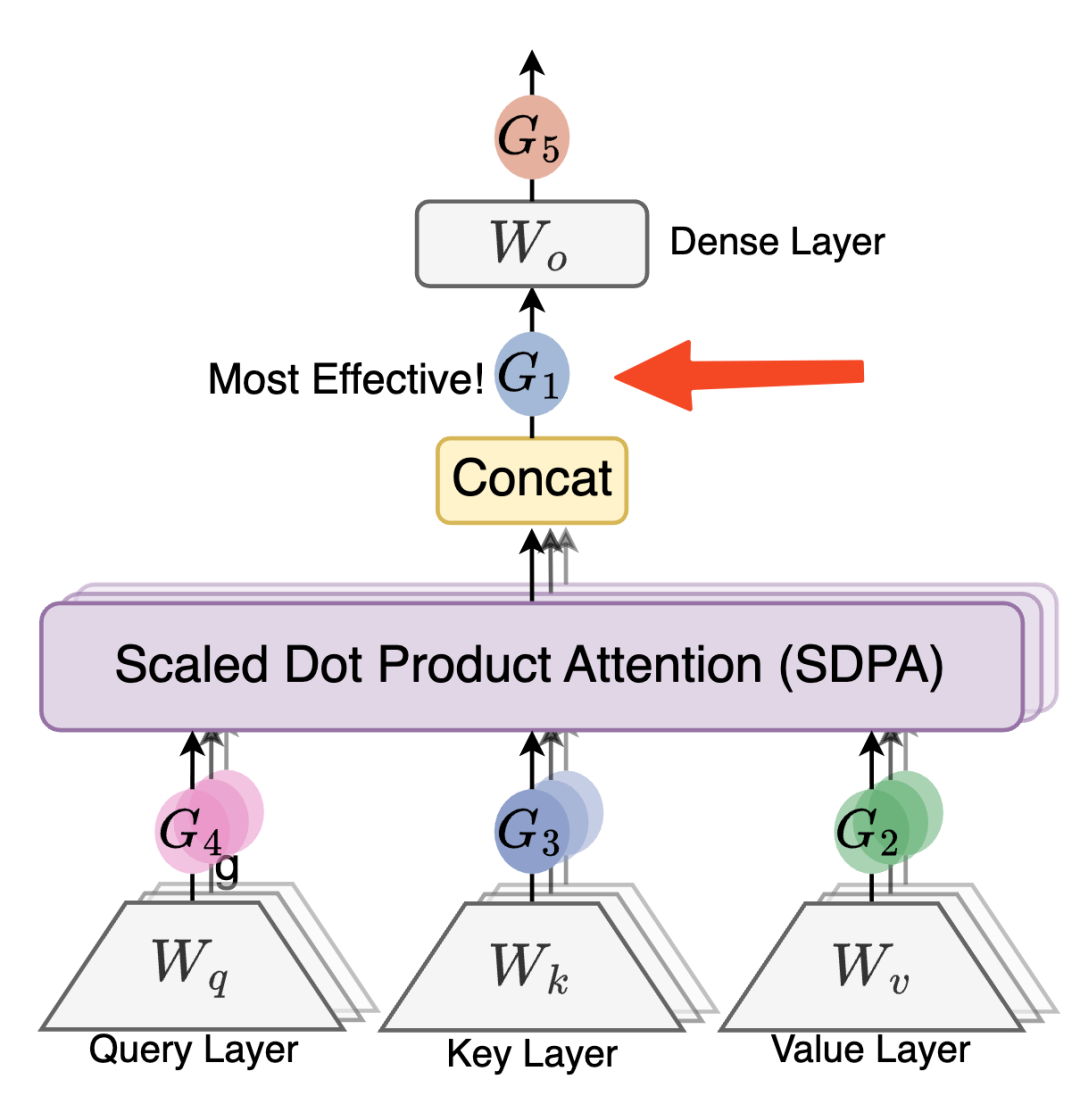

作者在 15B MoE 模型和 1.7B Dense 模型上,基于 3.5T tokens 进行了超过 30 种变体的广泛实验。结论非常明确:最有效的改动是在 SDPA 输出之后、 投影之前,加入一个门控(Gate)。

其公式极其简单,改动代码可能不超过 3 行:

- :SDPA 的输出

- :输入隐状态

- :Sigmoid 激活函数

这看上去只是一个微小的改动,但它带来的收益却是巨大的。

二、 原理拆解:一个小小的 Gate,凭什么四两拨千斤? 💡

为了理解为什么这一改动如此有效,我们需要先回顾一下经典 Transformer 的“标准动作”,看看它遗留了什么隐形短板。

1. 经典 Transformer 的两个“隐形痛点”

在标准的 Multi-Head Attention 中,数据流通常是:Input Q/K/V 投影 SDPA (线性输出)

这里隐藏着两个长期被忽视的问题:

- 痛点 A:双重线性层的“低秩”瓶颈SDPA 的输出本质上是 Value () 的加权和。从 (生成 Value 的矩阵)到 (输出矩阵),实际上是两个连续线性变换的叠加。

由于 Head Dimension 通常很小(低秩),这限制了模型在这一层的表达能力(Expressiveness)。

- **痛点 B:Softmax 的“强迫症”**SDPA 内部使用了 Softmax 进行归一化,这意味着所有权重的和必须为 1。

这就好比开会,哪怕全是废话,你也必须把 100% 的注意力分配出去。 这就是导致“Attention Sink”(注意力陷阱,即模型被迫盯着首个 Token 看)的罪魁祸首。

2. Qwen 团队的“破局一招”

新提出的 Gated Attention 并没有推翻原有的结构,而是做了一个极简的“加法”:在 SDPA 和 之间夹入一个非线性门控。

为什么加个门就能解决上述两个痛点?

-

**针对痛点 A(引入非线性):**门控操作 是非线性的。把它插在 和 之间,就像在两片面包(线性层)中间加了一层火腿,直接打破了原本的线性限制,显著提升了低秩映射的表达能力。实验证明,这是 PPL 下降的主要数学原因。

-

**针对痛点 B(引入动态稀疏性):**这是最精彩的部分。Sigmoid 函数的输出范围是 [0, 1]。

论文通过分析门控分数发现:这个 Gate 产生的系数非常稀疏(大量接近 0)且高度依赖于当前的 Query。这意味着模型终于有了“拒收垃圾信息”的权利。

- 经典 Softmax 说:“大家必须分完这 100% 的注意力,谁也不能空手。”

- 加上 Gate 后说:“Softmax 分完后,我还要再审核一遍。没用的信息,我直接把门关上(乘以接近 0 的系数)。”

三、 意外之喜:终结“Attention Sink” 🎯

Attention Sink(注意力陷阱) 是 LLM 中常见的现象:模型倾向于将大量注意力分数分配给首个 Token(或其他特定 Token),即使它们没有实际语义,仅作为“汇聚点”以满足 Softmax 的归一化需求。

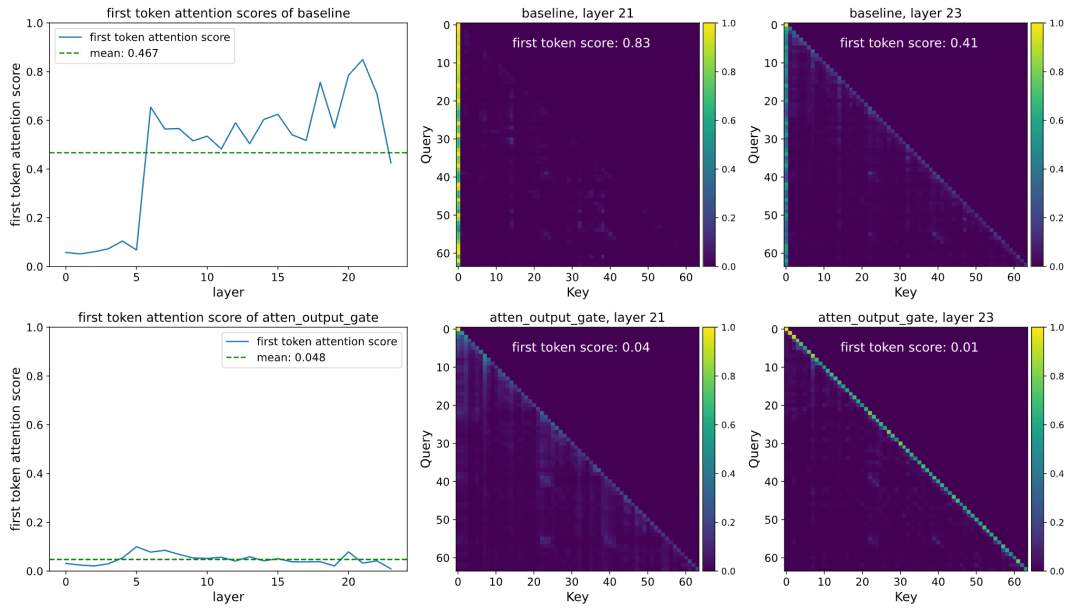

(论文 Figure 2: Baseline 巨大的首个 Token 注意力占比 vs Gated 模型极低的首个 Token 注意力)

实验惊人地发现,Gated Attention 几乎完全消除了这一现象:

- Baseline 模型:首个 Token 平均占据 46.7% 的注意力分数。

- Gated Attention 模型:首个 Token 占比降至 4.8%。

因为有了门控带来的“拒收权”,模型不再需要通过“注水”到首个 Token 来处理冗余信息。这一特性带来的直接好处是:模型在外推长上下文(Long-Context Extrapolation)时表现更佳。 在结合 YaRN 进行长度扩展时,Gated 模型在 64k 和 128k 长度上的表现显著优于 Baseline。

四、 工程价值:稳如泰山的训练 📉

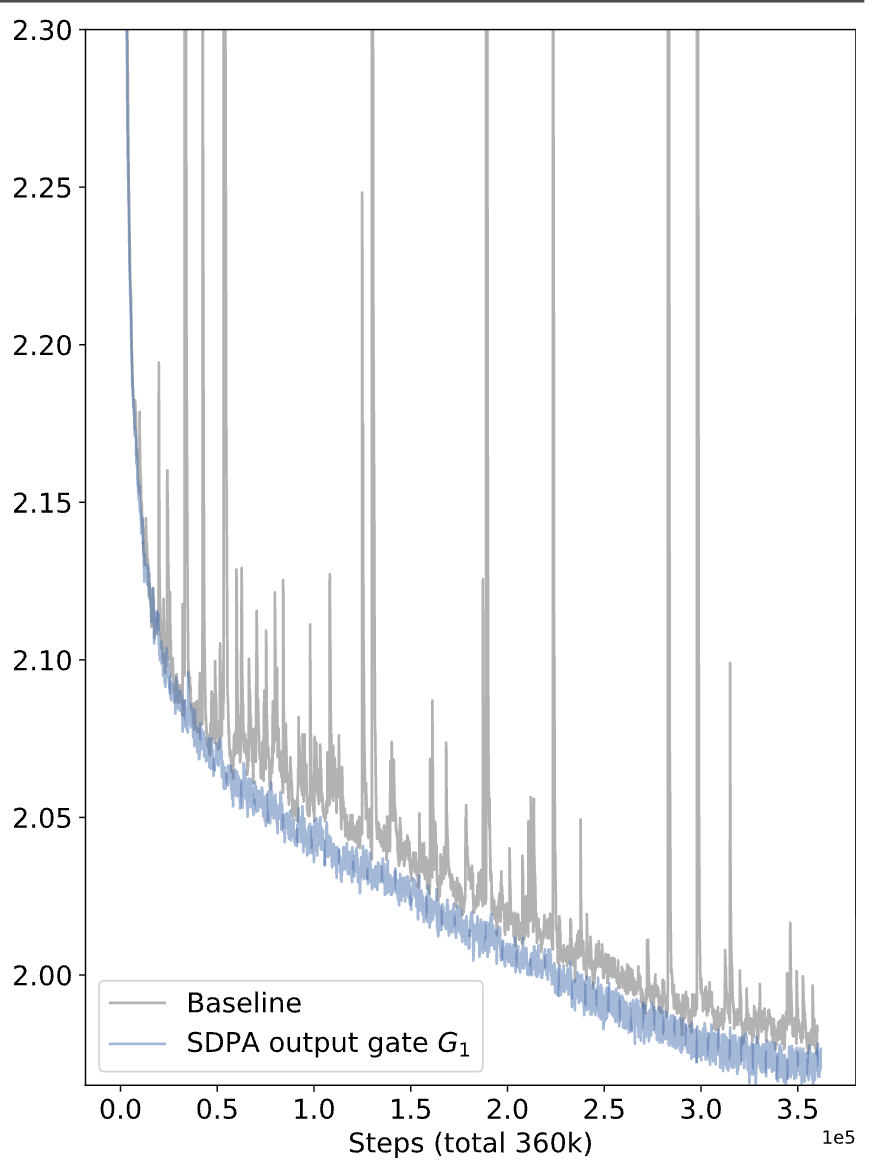

对于一线炼丹师而言,Loss Spike(训练损失飞升/震荡)是最头疼的问题之一。论文展示了极具说服力的对比结果:

- 极高的稳定性:Gated Attention 几乎完全消除了训练过程中的 Loss Spikes。

- 更大的学习率:由于稳定性提升,模型可以承受更大的学习率(例如 Baseline 在 LR=8e-3 时崩溃,而 Gated 模型依然收敛),从而加速训练并获得更低的 Loss。

- Scaling 潜力:在 3.5T token 的大规模训练中,这种稳定性优势依然存在,表明其极佳的 Scaling 属性。

五、总结与启示 📝

Qwen 团队的这项工作给我们的启示是:Transformer 的组件优化仍有空间,且未必需要复杂的架构调整。

- 实现简单:仅需几行代码修改,增加的参数量极少(对于 15B 模型增加 <2M 参数)。

- 收益明确:PPL(困惑度越低越好) 下降、MMLU (综合能力评测,越高越好)提升、训练不炸 Loss。

- 机理通透:通过增加非线性和稀疏性,优雅地解决了 Attention Sink 这一长期存在的“补丁式”现象。

对于正在训练基础模型或追求极致性能的团队来说,Head-Specific SDPA Output Gating 绝对是一个值得即刻尝试的 Trick。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)