python调用LM Studio(AI)本地API

本文介绍了在Windows系统下本地部署DeepSeekR1模型API的方法。首先需要安装Python3和LMStudio,启动本地API服务后可通过http://localhost:1234访问。文章提供了两种调用方式:1)通用HTTP接口调用,使用requests库发送POST请求;2)OpenAI兼容方式调用,通过openai库实现。建议根据具体使用场景调整temperature参数值(0.

前提条件

Windows安装python3.

Windows使用LM Studio部署DeepSeek R1模

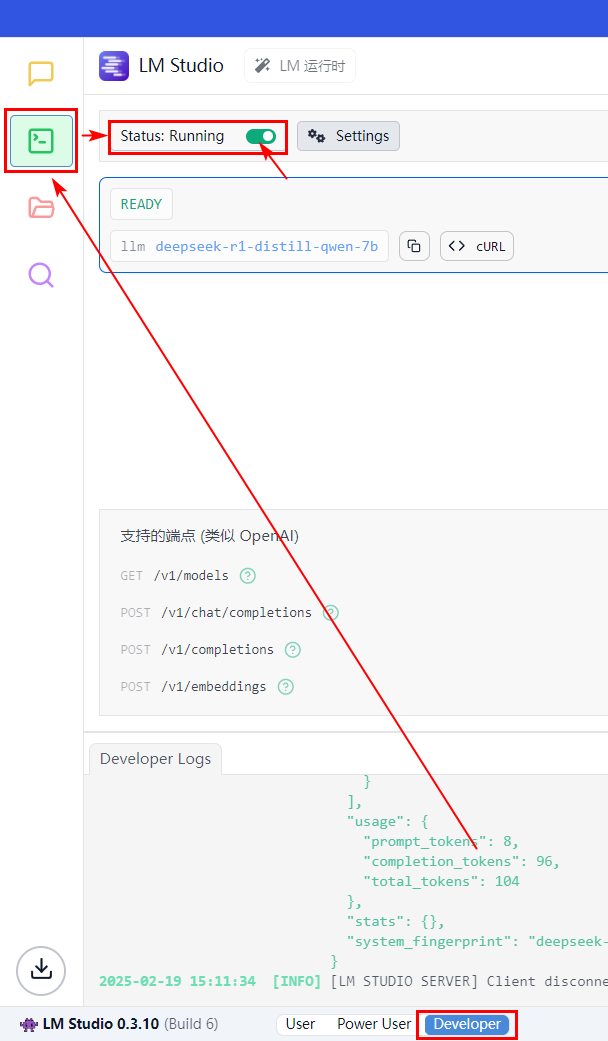

启动本地API

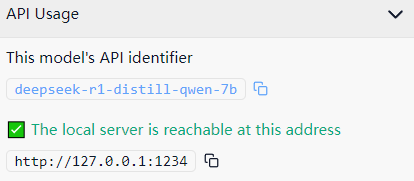

API地址

接口地址:http://localhost:1234

支持的端点 (类似 OpenAl)

GET /v1/models

POST /v1/chat/completions

POST /v1/completions

POST /v1/embeddings

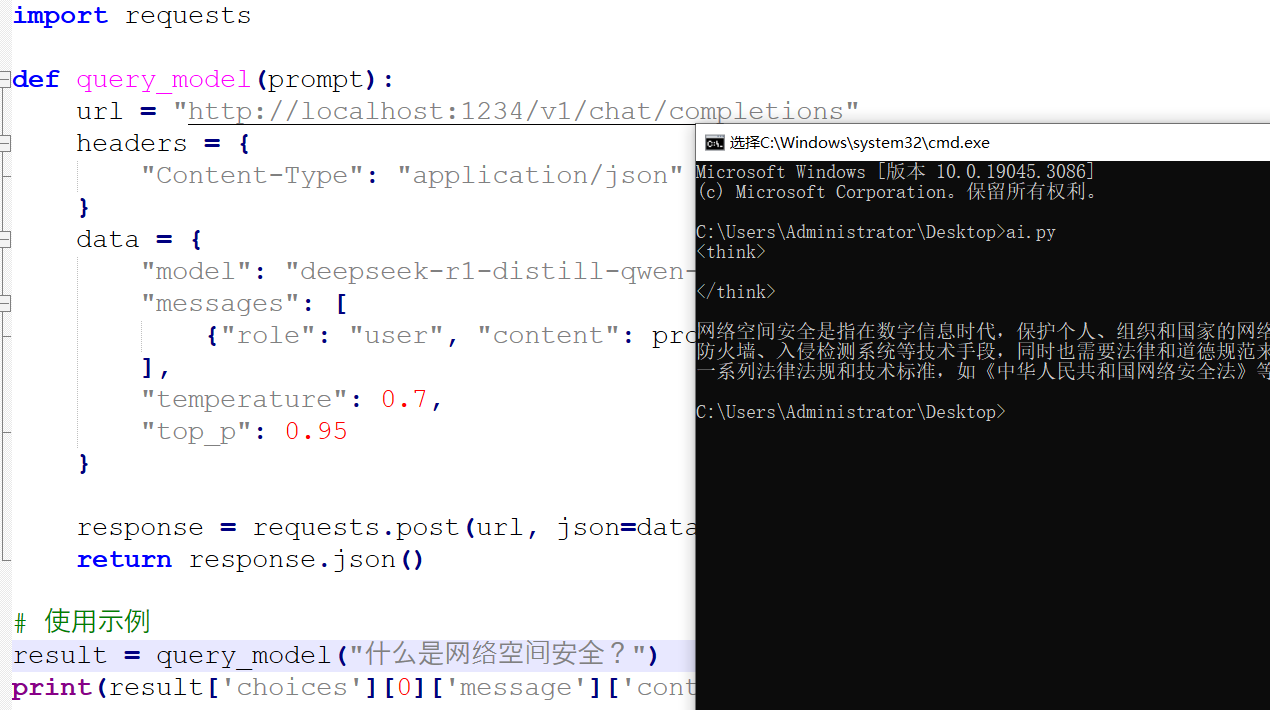

Python调用方式1

注意:"model": "deepseek-r1-distill-qwen-7b", 这个是使用的模型,根据实际情况修改"temperature": 0.7, # 控制生成结果的随机性,值越高越随机"top_p": 0.95 # 概率参数,控制生成结果的多样性

我们建议您根据如下表格,按使用场景设置temperature。

| 场景 | temperature |

|---|---|

| 代码生成/数学解题 | 0.0 |

| 数据抽取/分析 | 1.0 |

| 通用对话 | 1.3 |

| 翻译 | 1.3 |

| 创意类写作/诗歌创作 | 1.5 |

创建run1.py文件

pip install requests通用HTTP接口调用

import requests

def query_model(prompt):

url = "http://localhost:1234/v1/chat/completions"

headers = {

"Content-Type": "application/json"

}

data = {

"model": "deepseek-r1-distill-qwen-7b",

"messages": [

{"role": "user", "content": prompt}

],

"temperature": 0.7,

"top_p": 0.95

}

response = requests.post(url, json=data, headers=headers)

return response.json()

# 使用示例

result = query_model("什么是网络空间安全?")

print(result['choices'][0]['message']['content'])

运行效果:

如果提示拒绝连接,就把localhost改为127.0.0.1

Python调用方式2

支持 OpenAI 兼容方式调用pip install openai

创建run2.py文件

from openai import OpenAI

client = OpenAI(

api_key="lm-studio",

base_url="http://localhost:1234/v1/"

)

response = client.chat.completions.create(

messages=[

{'role': 'user', 'content': "为什么QQ不能用微信登录"},

],

model='deepseek-r1-distill-qwen-7b', # 调用的模型

stream=True # True 是流式返回,False是非流式返回

)

# stream=False的时候,打开这个,启用非流式返回

# print(response.choices[0].message.content)

# stream=True的时候,启用流示返回

for chunk in response:

print(chunk.choices[0].delta.content, end="", flush=True)总结

基于本地部署的大模型API,可以读取本地日志文件、代码文件内容等,进行日志流量分析、代码审计。

运行效率跟机器配置有关,一般个人电脑的效率不会很高。

推荐调用付费的API。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)