文献分享 | RoboBrain 2.0:迈向通用具身智能体的新突破

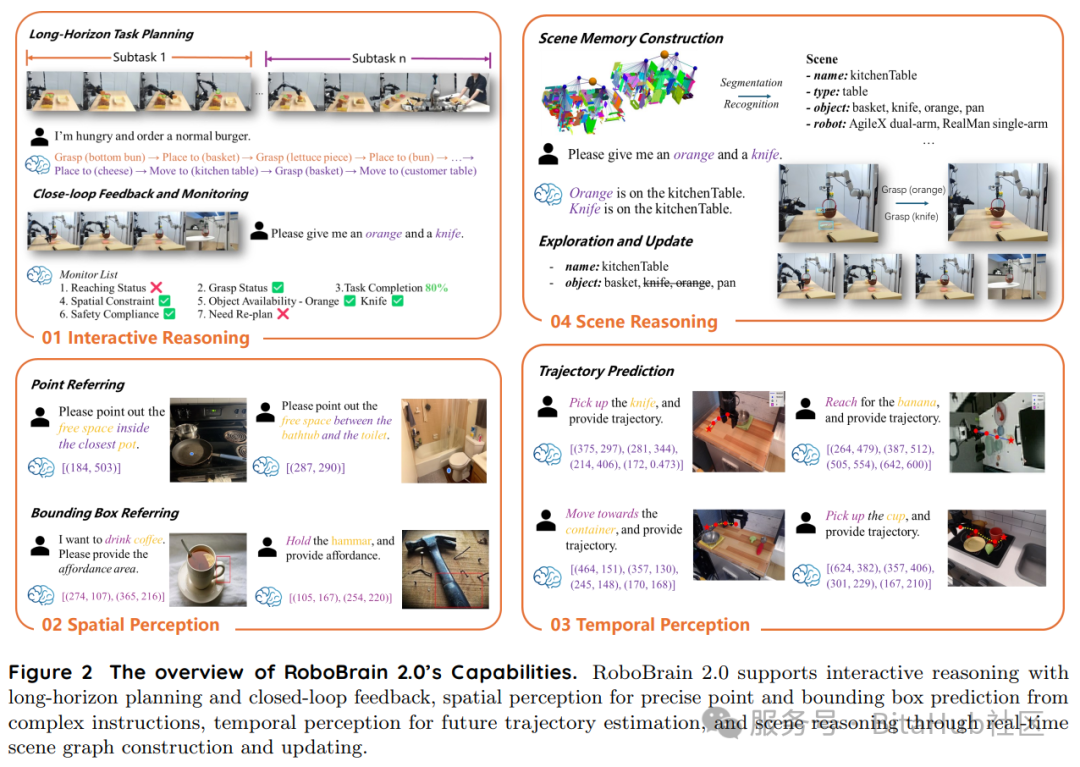

北京智源研究院团队推出RoboBrain2.0多模态大模型,致力于解决数字智能向物理智能转化的三大瓶颈:空间理解、时间建模和推理链条问题。该模型采用模块化架构,支持多模态输入,通过三阶段训练策略逐步提升具身能力。在空间推理和时间建模任务中表现优异,超越GPT-4o等主流模型。未来将重点发展视觉-语言-动作框架和机器人平台集成,推动具身AI生态建设。

随着多模态大模型的发展,人类距离通用人工智能(AGI)的目标正稳步迈进。尤其在数字世界中,大语言模型(LLMs)与视觉语言模型(VLMs)已展现出令人惊叹的理解与推理能力。但当我们将目光投向现实物理世界,问题就变得更具挑战性:如何让AI模型“看见”周围环境、理解复杂任务并做出合理动作?为此,北京智源研究院团队提出了面向具身智能体的多模态大模型 —— RoboBrain 2.0。

从数字智能到物理智能的跃迁

RoboBrain 2.0 正是为了解决“数字智能”向“物理智能”转化过程中遇到的三大瓶颈而生:空间理解薄弱、时间建模能力不足与推理链条不完整。现有多数模型尚无法准确建模物体间的空间关系,也缺乏处理多阶段、跨代理的任务能力。更重要的是,它们难以将复杂的人类意图转化为结构化的动作计划。

为突破这一系列限制,RoboBrain 2.0 提出了一种统一感知、推理与规划的架构。其不仅能接收图像、视频、多视角输入,还支持结构化的场景图与自然语言指令,并具备长链条的因果推理能力。模型发布了两个版本:轻量级的 7B 和全功能的 32B 模型,分别对应不同的部署需求。

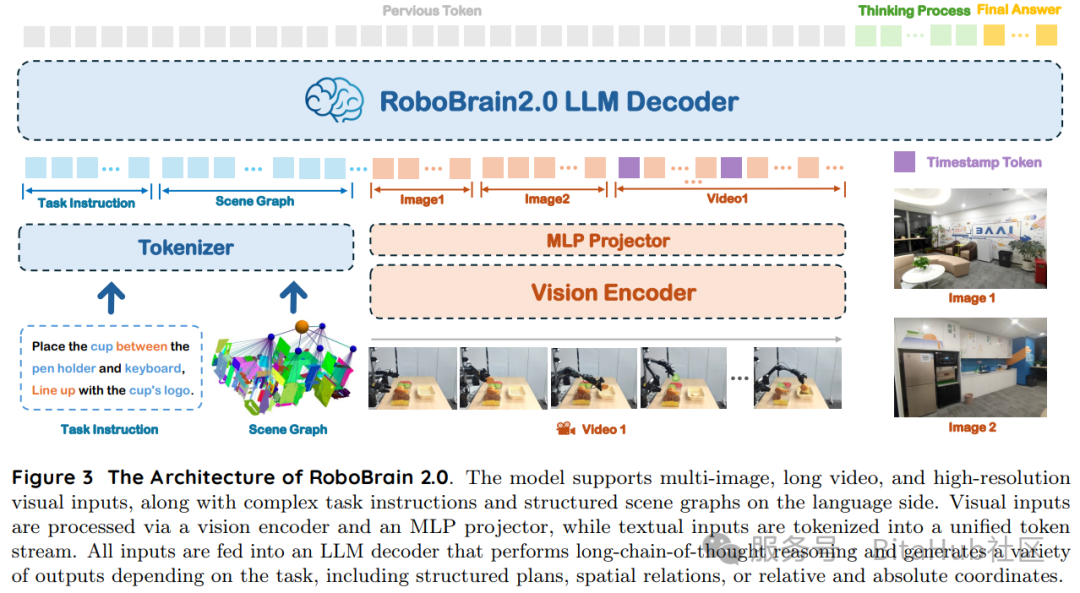

模型架构:模块化设计赋能多模态理解

RoboBrain 2.0 采用模块化的编码器 - 解码器架构,通过四个核心组件协同工作:文本 / 结构化输入的分词器、视觉编码器、将视觉特征映射到语言模型 token 空间的 MLP 投影器,以及基于 Qwen2.5-VL 初始化的语言模型主干。这种设计使其在保持强大通用 VQA 能力的同时,能专注于具身推理任务,如空间感知、时间建模和长链因果推理。

如上图所示,模型支持输入任务指令、图像、视频与场景图等多模态内容,通过视觉编码器提取视觉特征,再由MLP投影映射到语言模型的 token 空间中,与文本输入的 token 流融合,实现统一的多模态推理。

视觉编码器采用自适应位置编码和窗口注意力机制,支持动态分辨率的图像和视频输入,能高效处理具身任务中常见的高分辨率和多视角视觉观测。而解码器的核心设计是把高层的推理过程和与物理空间相关的具体输出结合起来,可灵活生成自由文本、空间坐标和推理轨迹等多种形式的输出,满足从空间定位到长程多智能体规划的各类任务需求。

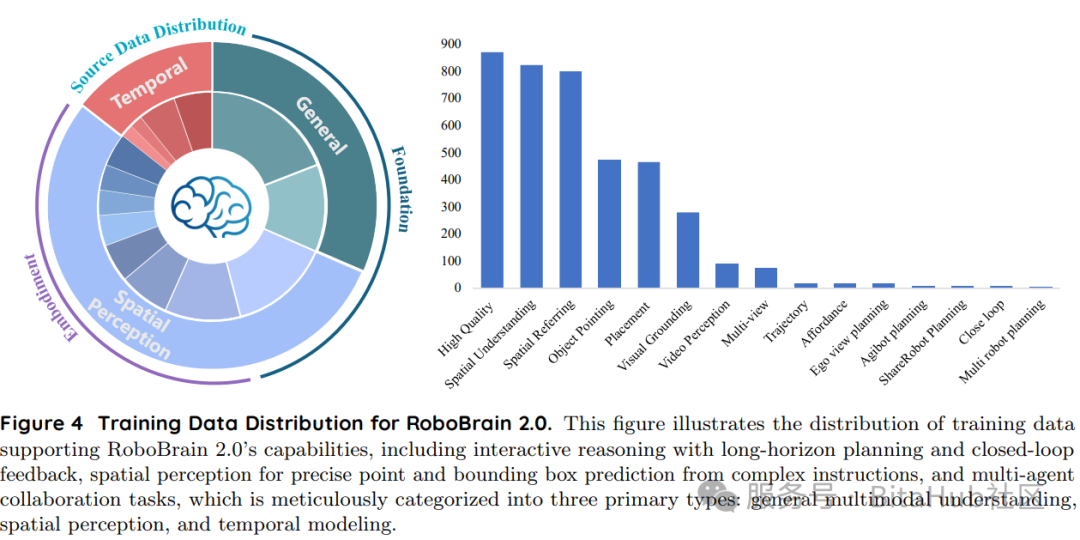

训练数据:多源异构数据赋能时空建模

为了训练具备强空间与时间理解能力的模型,RoboBrain 2.0 构建了一个覆盖多模态理解、空间感知与时间建模三大类的训练数据集,来源覆盖了真实数据、合成数据与模拟器数据,全面支撑模型在具身场景下的空间理解、时间建模和长链因果推理能力。

其中,通用多模态理解数据包含 873K 高质量样本,主要来自 LLaVA-665K 和 LRV-400K,涉及标准 VQA、区域级查询、基于 OCR 的 VQA 和视觉对话等任务,为模型奠定了扎实的多模态基础。

空间数据方面,通过对象定位(pointing)、可供性预测(affordance)、三维空间关系推理(spatial understanding)等多个任务,强化模型的空间感知能力。以 Pixmo-Points 与 RoboPoint 为例,数据中包括大量多点标注和描述性语言问答对,使模型学会从自然语言中解析精确的空间位置。

时间数据则聚焦于自我视角规划、机器人操作规划、多机器人规划和闭环交互等任务,模型引入了如 EgoPlan2、ShareRobot、Agitbot 与 Multi-Robot Planning 等数据集,专注于跨时间、多代理、复杂任务序列的计划生成,甚至还使用 AI2Thor 模拟器构建了闭环交互(Close-loop Interaction)场景,引入 Observation-Thought-Action (OTA) 形式的推理链训练样本,支持模型在复杂交互任务中的推理链学习。

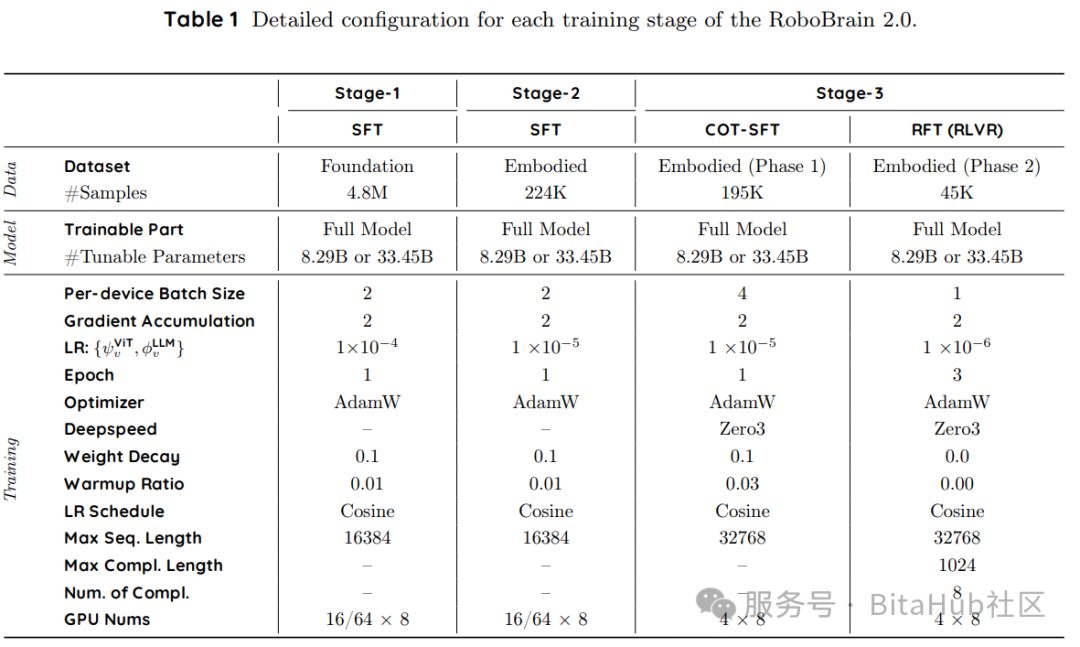

训练策略:三步走向“具身智能体”

为使模型逐步掌握具身能力,RoboBrain 2.0 的训练过程采用了三阶段进阶式策略,在不同阶段使用了不同的数据规模、最大序列长度和优化策略,实现了模型从感知、到理解、再到推理和规划的逐步进化。

第一阶段:基础时空学习,通过在大规模多模态数据集(涵盖密集 captioning、物体定位、图像 - 文本交织文档和基本视频 QA 等)上微调,构建模型的空间感知和时间理解基础能力,使其能理解自我中心视频流和空间锚定指令。

第二阶段:具身增强,引入高分辨率、多视角和自我中心视频数据集,以及带指令增强的导航和交互数据,训练模型处理视角感知、物体中心场景图构建等任务,强化长程时间依赖建模和多智能体协作能力。

第三阶段:链式推理强化,采用 Reason-RFT 的两阶段框架 —— 基于思维链的有监督微调(CoT-SFT)和强化微调(RFT),利用来自合成和真实具身场景的多轮推理示例,提升模型的高层推理能力。其中,CoT-SFT 阶段对 10% 的训练数据标注思维链理据,RFT 阶段则通过 GRPO 算法,基于复合奖励函数优化模型性能。

性能评估:空时任务全面领先

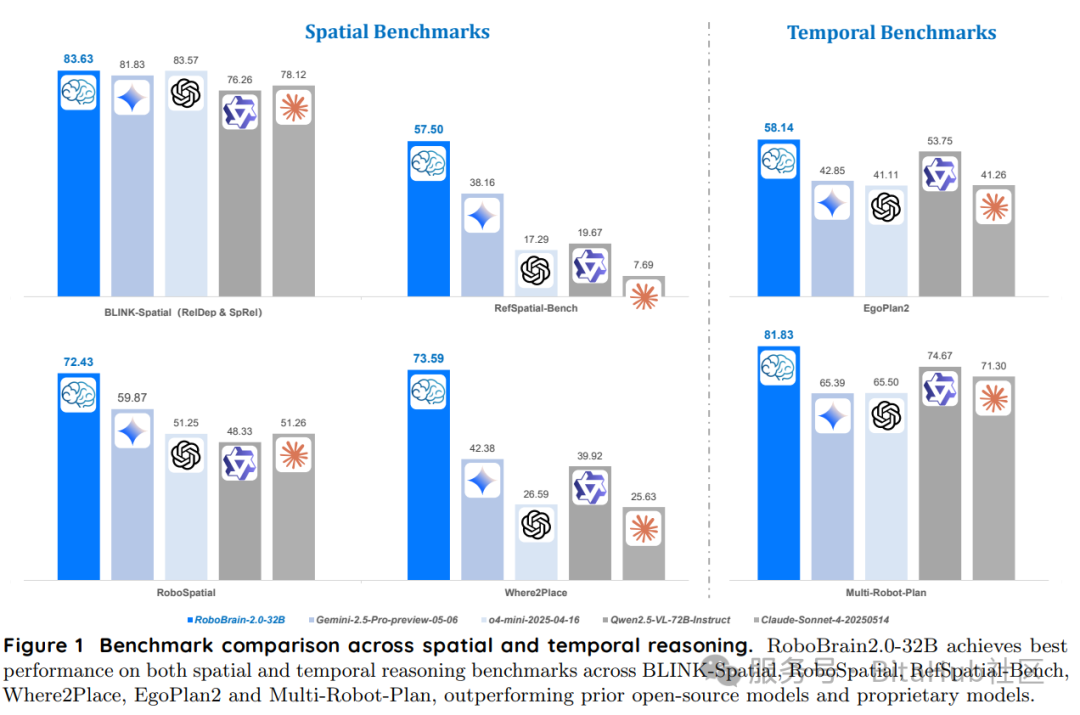

在模型能力评估方面,RoboBrain 2.0 在多项空间推理与时间建模基准测试中取得领先。如下图所示,RoboBrain-2.0-32B 在所有空间与时间任务上表现最佳,超越 GPT-4o、Claude-Sonnet、Gemini 2.5 及其他开源模型。

在 BLINK-Spatial、RefSpatial-Bench 与 RoboSpatial 等空间任务中,RoboBrain 展现出卓越的空间感知与点位预测能力;

在 EgoPlan2、Multi-Robot-Plan 与 RoboBench 等时间任务中,模型能准确完成多轮、多角色、多任务的长期规划;

特别是在 ShareRobot 的轨迹预测任务中,RoboBrain 2.0 以最低 Dynamic Fréchet Distance(0.2368)表现出卓越的路径规划能力,远超 Qwen2.5-VL 与 Gemini 等模型。

总结与展望

RoboBrain 2.0 凭借其模块化架构、精心构建的训练数据、递进式训练策略,在众多具身空间和时间推理基准测试中取得了 SOTA 成果,为具身 AI 研究提供了强有力的支撑。

未来,团队计划从两个方向拓展 RoboBrain 2.0:一是将先进的具身 VLMs 集成到视觉 - 语言 - 动作(VLA)框架中,提升动作生成的通用性和鲁棒性;二是加强与先进机器人平台和操作系统的集成,实现无服务器部署、免适配技能注册和低延迟实时控制,并构建协作式具身 AI 生态系统。

如需查看完整模型细节、训练数据与评估指标,可访问官方项目页:https://superrobobrain.github.io

参考文献链接:https://arxiv.org/abs/2507.02029

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)