全连接神经网络(FNN)深度解析

在深度学习的浩瀚宇宙中,全连接神经网络(Feedforward Neural Network, FNN)如同引力般存在,它是所有复杂神经网络架构的基石。从Google Brain团队2012年的猫脸识别实验,到OpenAI的GPT系列模型,看似高深的AI系统底层都流淌着FNN的血液。本文将带您深入探索这一基础架构的奥秘,并手把手实现PyTorch实战。

·

在深度学习的浩瀚宇宙中,全连接神经网络(Feedforward Neural Network, FNN)如同引力般存在,它是所有复杂神经网络架构的基石。从Google Brain团队2012年的猫脸识别实验,到OpenAI的GPT系列模型,看似高深的AI系统底层都流淌着FNN的血液。

本文将带您深入探索这一基础架构的奥秘,并手把手实现PyTorch实战。

一、FNN的进化史:从单细胞到智慧生命

1. 感知器时代

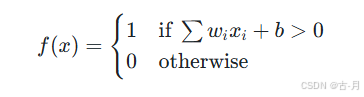

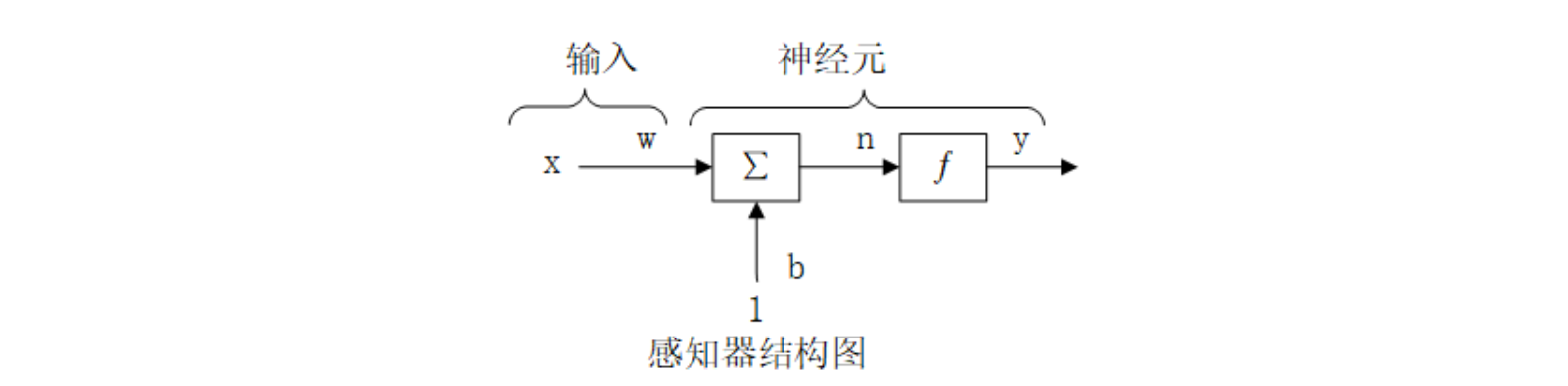

FNN的起源可以追溯到20世纪50年代和60年代的神经网络理论,最早的神经网络模型之一是感知器(Perceptron)。感知器是一种线性分类器,能够对输入数据进行简单的分类。

Frank Rosenblatt 1958年提出的感知器模型,其数学表达式为:

重要突破:

- 首次实现自动权重调整(Delta规则)

- 成功应用于光学字符识别(OCR)

致命缺陷:

- 无法解决XOR问题(Minsky & Papert, 1969)

- 线性分类器的本质限制

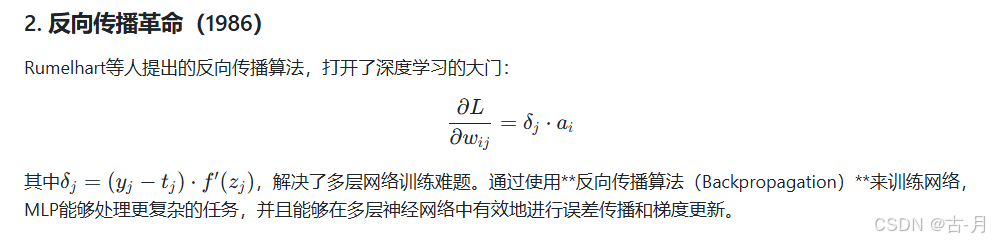

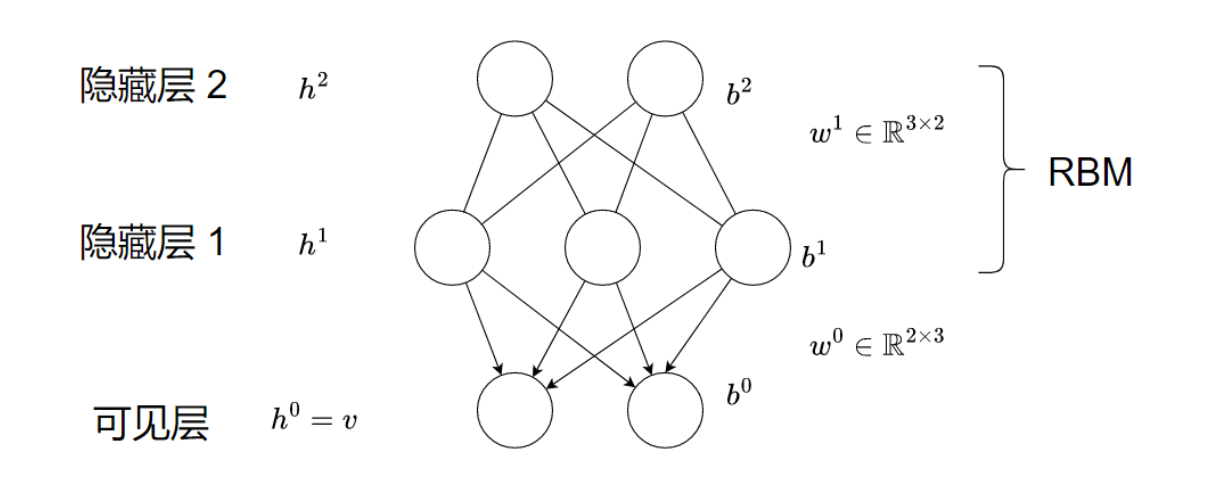

3. 深度觉醒(2006)

Hinton提出的深度信念网络(DBN),通过逐层预训练突破深层网络训练瓶颈。

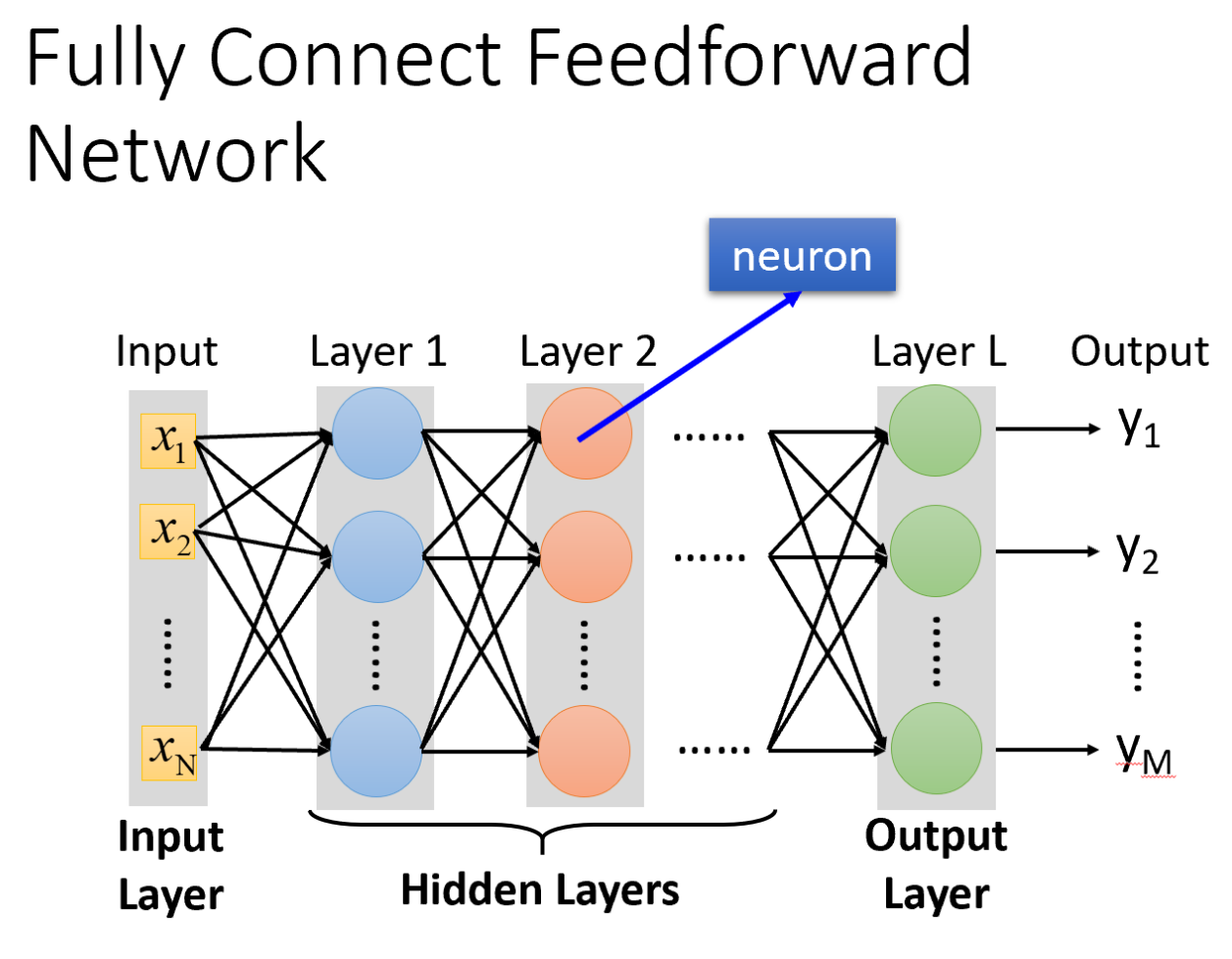

二、FNN核心架构剖析

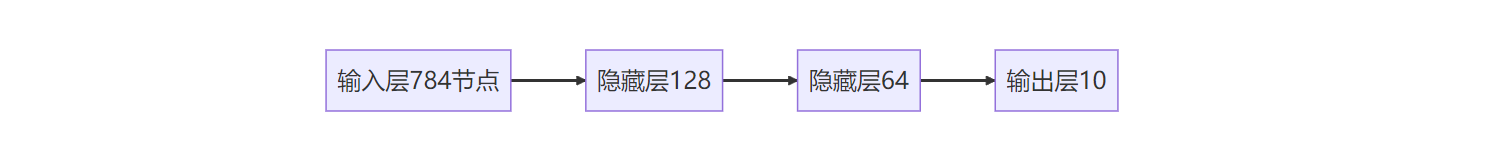

1. 标准结构拓扑

graph LR

Input[输入层784节点] --> Hidden1[隐藏层128]

Hidden1 --> Hidden2[隐藏层64]

Hidden2 --> Output[输出层10]

2. 数学建模

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)