DeepSeek新突破:mHC连接方案解决大模型训练稳定性问题,270亿参数模型性能提升超15%!

DeepSeek提出"mHC"网络连接方案,解决了字节豆包"超连接"在大规模训练中信号过度放大的问题。通过引入"双随机矩阵"约束,将信号放大倍数从3000倍降至1.6倍,显著提升训练稳定性。实验显示,在270亿参数模型上,mHC在8个任务上全面超越原版,性能提升明显,且模型规模越大优势越明显。该方案有望应用于DeepSeek后续模型。

新年第一天,被 DeepSeek 新论文刷屏了!

DeepSeek 的老传统:每逢节假日,总得做点啥。

这次元旦,是一篇论文。

2025 年 12 月 31 日,DeepSeek 在 arXiv 上发表了一篇技术论文。

标题是「mHC: Manifold-Constrained Hyper-Connections」,翻译过来叫「流形约束超连接」。

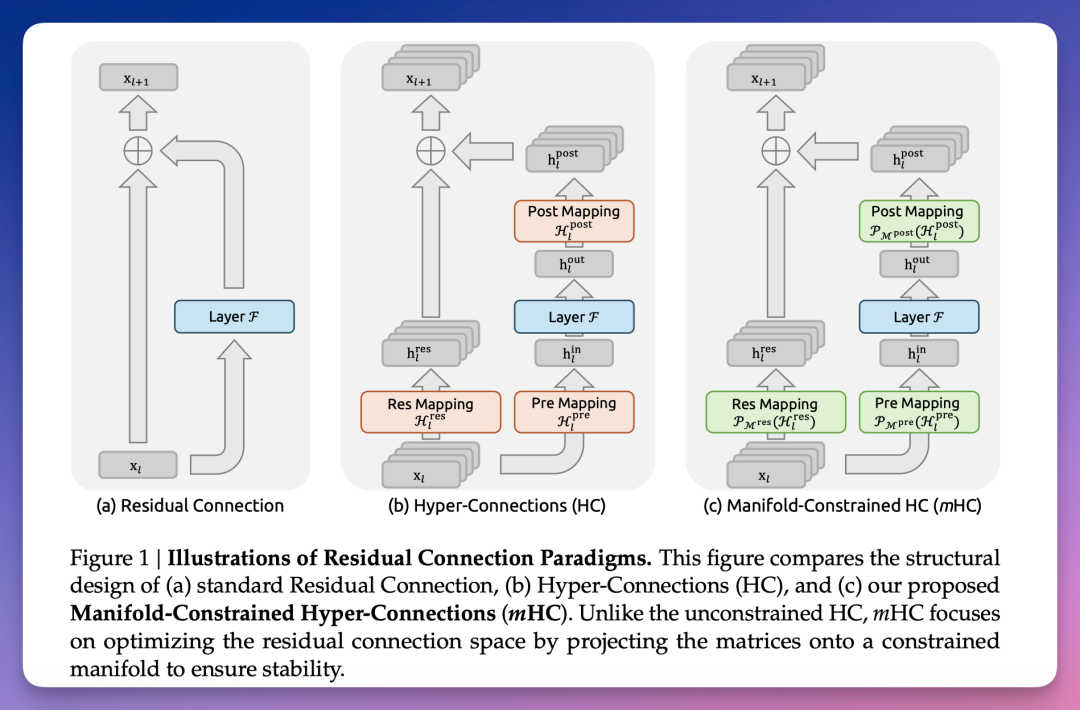

论文的核心贡献是提出了一种新的网络连接方式「mHC」,解决了此前「超连接」(Hyper-Connections)在大规模训练时不稳定的问题。

划重点,DeepSeek 创始人梁文锋也在作者名单里。

DeepSeek 元旦发布的 mHC 论文。

「超连接」本身不是 DeepSeek 的发明,是字节豆包的。

2024 年 9 月,字节豆包大模型团队首次提出了「超连接」,作为「残差连接」的替代方案,论文后来被 ICLR 2025 接收。

字节豆包团队的超连接论文,已被 ICLR 2025 收录。

那么,残差连接是什么?

训练深度神经网络有个老问题:网络层数一多,信息从前往后传的时候会逐渐失真,到最后几层几乎学不到东西。

这个问题困扰了科研界很久。

直到 2015 年,计算机视觉大神何恺明提出了「ResNet」,用一个巧妙的方法解决了它。

何恺明 2016 年提出的 ResNet,残差连接的起源。

每一层不光接收上一层处理过的结果,还同时保留一份原始输入,两个加在一起再往下传递。

这相当于给信息开了一条「直通车」。

不管中间那些层把信息处理成什么样,原始信号都能通过这条直通车传到后面,不会丢失。

这就是残差连接。

何恺明凭借这篇论文拿下了 CVPR 2016 最佳论文奖,后来这个方法几乎成了深度学习的标配,现在的大模型基本都在用。

但残差连接有个「两难困境」。

一种做法(Pre-Norm)能防止信息衰减,但层数多了之后,各层学到的东西会越来越像,梯度贡献变小。

另一种做法(Post-Norm)能避免这个问题,但信息衰减又回来了。

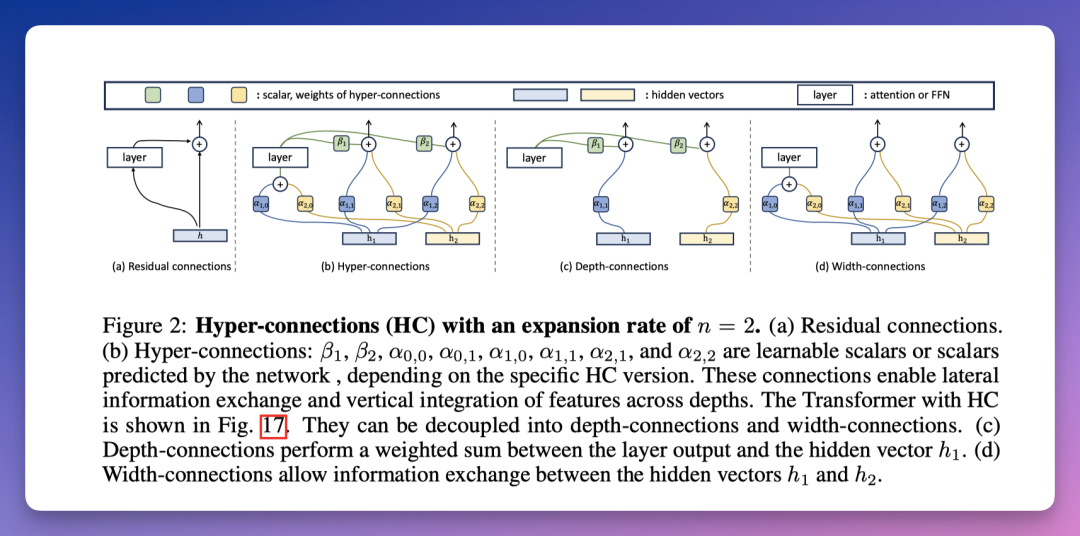

豆包团队的思路是:既然一条直通车不够,那就开四条。

让网络自己学习这四条通道之间怎么配合、怎么混合。

这就是超连接。

从残差连接到超连接,核心是把一条通道扩成多条。

实验效果很好,模型收敛速度最快加速了 80%。

但四条直通车的超连接也有个问题,模型规模一大,训练就容易出事。

DeepSeek 训练 270 亿参数的模型时发现,用超连接的模型跑到一万多步时,训练损失(Train Loss)突然飙升,整个训练直接废了。

Train Loss 是什么?你可以理解为「模型犯错率」,越低越好。

问题出在哪?

大神何恺明提出的残差连接就像一面镜子,信号进去是 1,出来还是 1,不放大也不缩小。

但豆包团队的超连接为了让四条通道能互相配合,引入了一个可学习的「混合矩阵」。

这个矩阵一层一层乘下去,效果会累积。

DeepSeek 测了一下,在 270 亿参数的模型里,信号经过所有层之后被放大了将近 3000 倍。

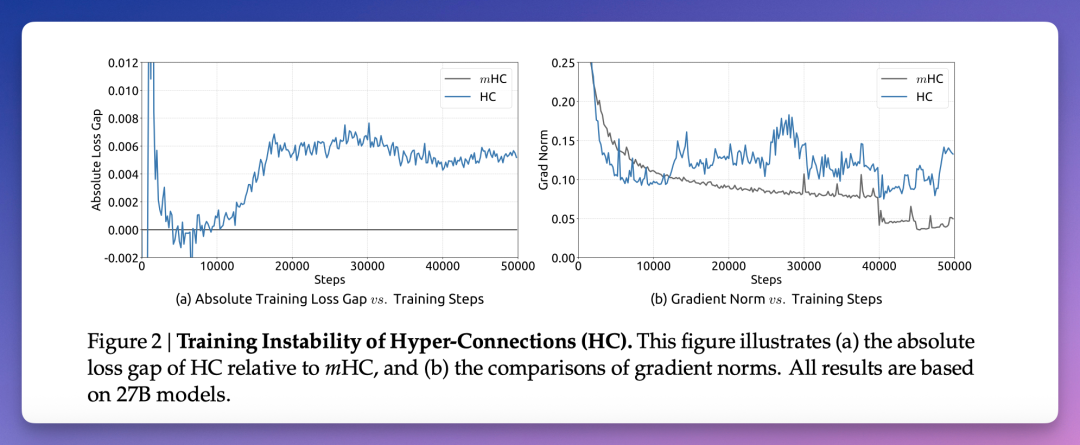

蓝线是原版超连接,灰线是 mHC,训练稳定性差距明显。

你想象一下把音响音量开到 3000 倍会怎样。

训练损失爆炸,训练报废。

DeepSeek 的解法是给这个混合矩阵装一个「限速器」。

具体来说,他们要求这个矩阵必须满足一个条件:每一行加起来等于 1,每一列加起来也等于 1。

数学上叫「双随机矩阵」。

三代连接方式的演进:残差连接 → 超连接 → mHC。

这个约束有什么用?

它能保证信号经过这个矩阵之后,最多保持原样,绝不会被放大。

而且不管叠多少层,这个性质都能保持。

效果立竿见影。

加了这个约束之后,信号的放大倍数从 3000 降到了 1.6,降了三个数量级。

训练曲线变得平滑,稳定跑完。

当然,四条通道比一条通道要费更多资源。

DeepSeek 在工程上做了不少优化,把多个计算步骤合并、减少内存读写、让计算和通信并行。

这也是 DeepSeek 一直以来的强项。

最终这套方案只比原来多花 6.7% 的训练时间。

性能提升也很明显。

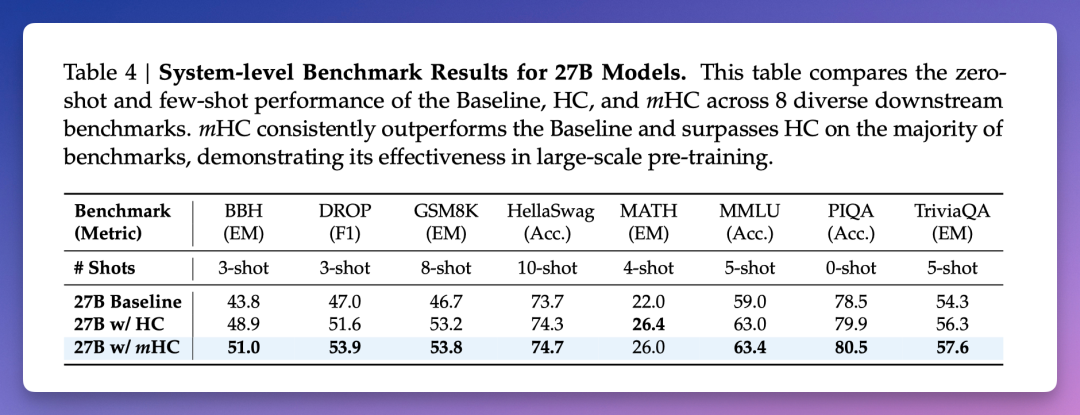

在测试中,mHC 在 8 个任务上全面超过了原版,大部分指标也超过了豆包的超连接。

比如 BBH 推理测试从 43.8 提升到 51.0,DROP 阅读理解从 47.0 提升到 53.9。

270 亿参数模型的测试结果,mHC 在多数指标上领先。

DeepSeek 还测了不同规模的模型,结论是:「模型越大,mHC 的优势越明显。」

这篇论文很 DeepSeek。

在技术上做深度优化,解决真正阻碍落地的问题。

超连接是豆包团队 2024 年提出的,效果好,但大规模训练时不稳定。DeepSeek 加了一层数学约束,让它能稳定完成 270 亿参数的训练。

这种扎实的工程能力,可能比提出一个新概念更实际。

梁文锋出现在作者名单里,这不是第一次。

2025 年 7 月,DeepSeek 和北大合作的 NSA(原生稀疏注意力)论文拿了 ACL 2025 最佳论文奖,梁文锋也在通讯作者里。

对于 AI 公司的 CEO 来说,这种技术参与度不多见。

mHC 如果被验证有效,大概率会用在 DeepSeek 后续模型里。

论文基于 DeepSeek-V3 的 MoE(混合专家)架构做实验,发布时间点又是 2025 年最后一天,很难不让人联想这是在为 2026 年的新模型做铺垫。

DeepSeek 发论文的同时,国内其他 AI 公司也没有闲着。

智谱 12 月 30 日开启港股招股,1 月 8 日以股票代码「2513」挂牌上市,有望成为「全球大模型第一股」。

MiniMax 也通过了港交所聆讯,同样计划 1 月上市。

月之暗面的 Kimi 据说会在 1 月或 3 月上线新的多模态模型,可能是 K2.1 或 K2.5。

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

学习路线

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)