【探索实战】从云原生新手到分布式专家:Kurator一键搭建与核心功能实操全攻略

在云原生技术迅猛发展的今天,企业IT基础设施正经历从单一云平台向分布式多云环境的深刻变革。根据业界实践,全球各组织正积极拥抱多云多集群策略。然而,这种分布式的架构也带来了显著的管理复杂性:配置繁琐、版本不一致、策略管理分散、监控不便等问题层出不穷。Kurator作为业界首个分布式云原生开源套件,由华为云推出,旨在帮助企业构建统一的管理平面,实现跨云、跨边的分布式云原生平台。其设计理念遵循"基础设施

【探索实战】从云原生新手到分布式专家:Kurator一键搭建与核心功能实操全攻略

面对多云多集群环境的运维难题,你是否还在为频繁切换kubeconfig、手动同步应用配置而头疼?某电商企业运维团队在使用Kurator后,将多集群部署时间从2小时压缩至5分钟,这一转变可能正是你寻求的解决方案。

当你需要同时管理来自AWS、Azure和本地数据中心的多个Kubernetes集群时,传统的管理方式会变得捉襟见肘。

你需要为每个集群单独配置应用、监控和策略,这不仅效率低下,还极易导致配置漂移。Kurator作为一个开源的分布式云原生管理平台,正是为了解决这些问题而生。

01 轻松起步:Kurator环境快速搭建指南

搭建一个分布式云原生环境听起来很复杂,但Kurator的设计理念就是“开箱即用”。让我们从最基本的环境准备开始。你需要至少两个Kubernetes集群:一个作为主集群(管理集群),其他作为成员集群。

硬件要求不高,管理集群建议4核8GB内存,工作集群至少2核4GB配置即可。确保集群间网络互通,并开放必要的端口,如6443(K8s API)和8080(Kurator控制台)。

现在开始安装Kurator CLI。你可以选择下载预编译的二进制文件:

VERSION=“v0.6.0”

wget https://github.com/kurator-dev/kurator/releases/download/${VERSION}/kurator-linux-amd64.tar.gz

tar -xzf kurator-linux-amd64.tar.gz

sudo mv kurator /usr/local/bin/

或者直接从源码构建:

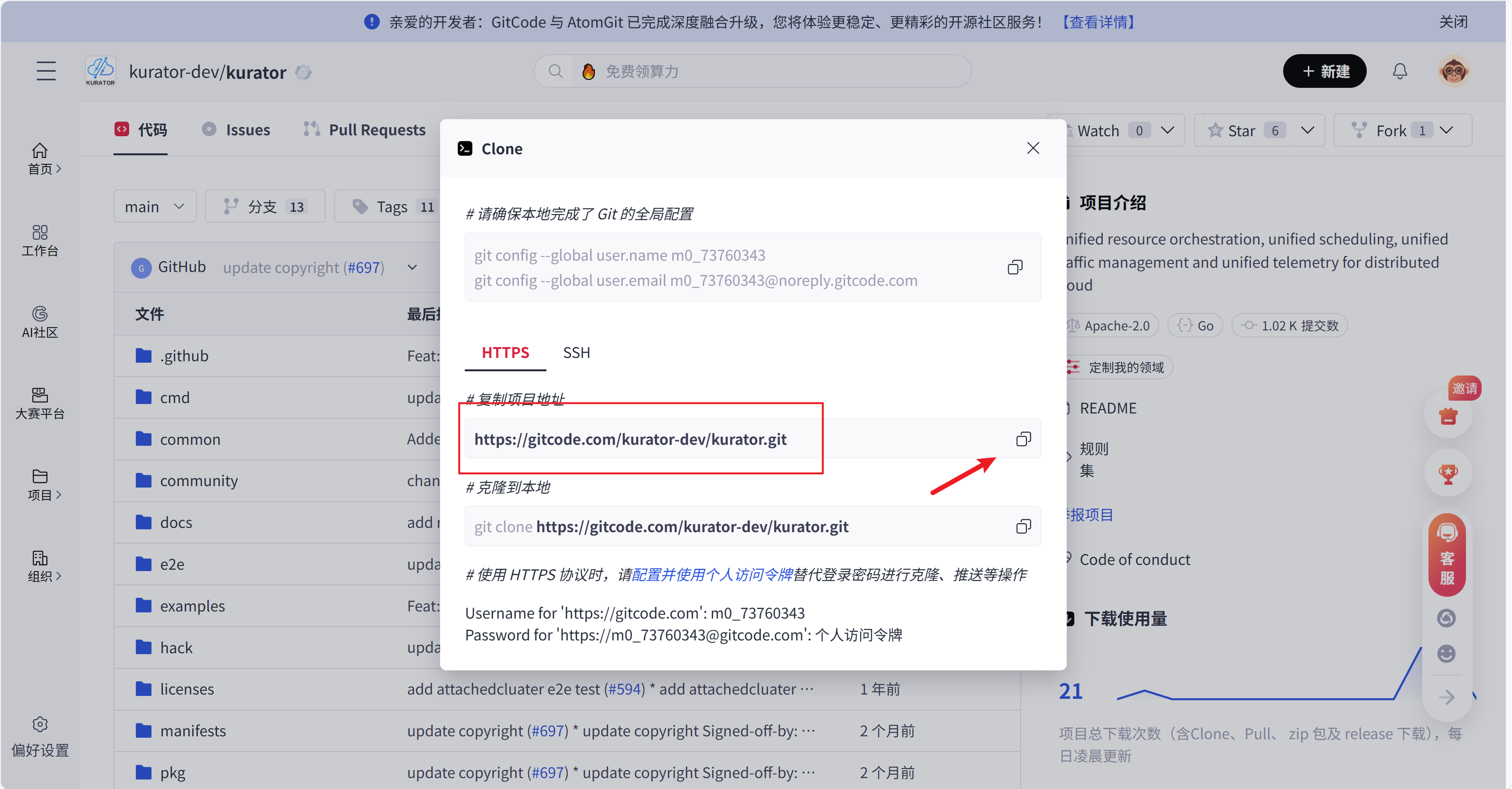

在项目地址中,可以看到可以clone到本地

https://gitcode.com/kurator-dev/kurator.git

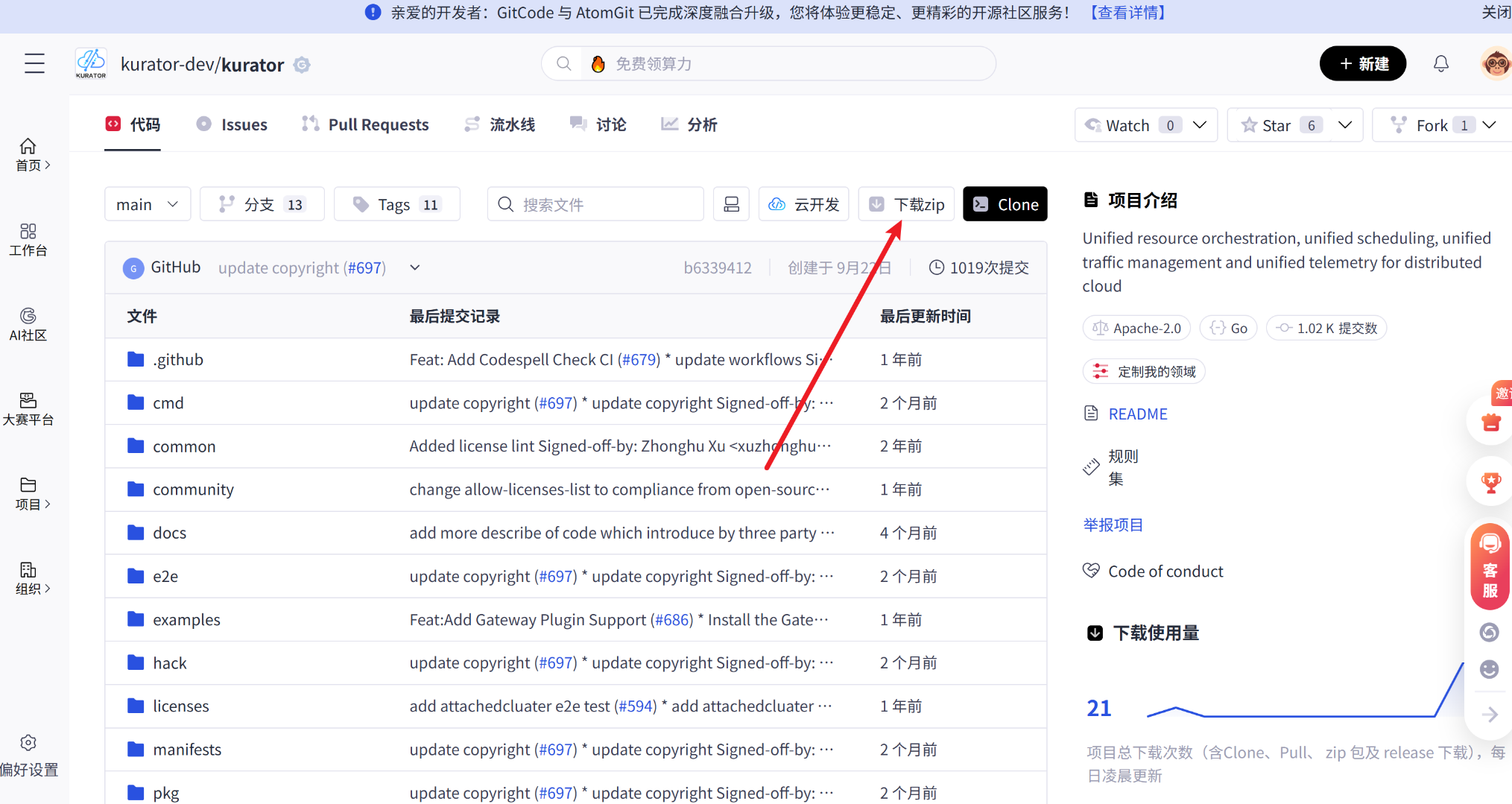

或者我们也可以下载到本地

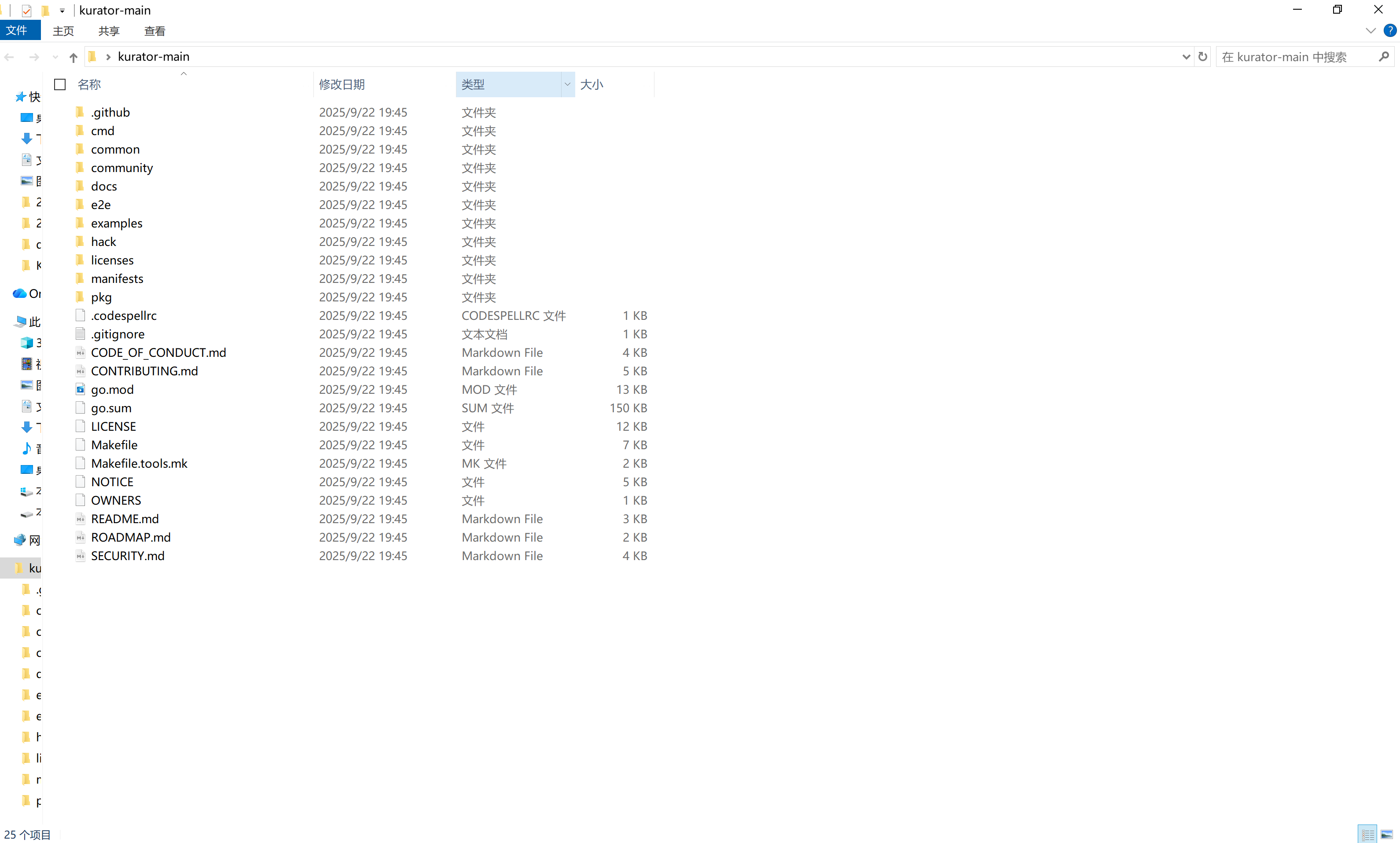

可以看到我们资源文件已经下载下来了

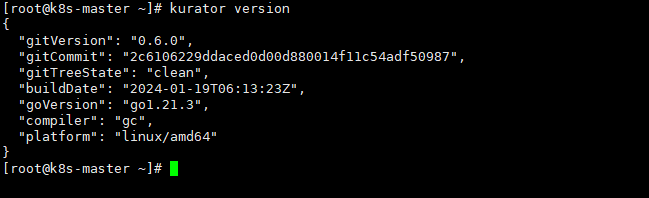

可以看到版本是0.6.0

安装CLI后,在主集群中初始化Kurator控制平面:

kubectl create namespace kurator-system

kurator install center-manager --kubeconfig ~/.kube/config

这个过程通常只需要几分钟。如果你的环境在国内,可能会遇到镜像拉取慢的问题,可以通过配置国内镜像源来解决。

02 常见陷阱:安装过程中的问题与解决方案

即使是最简单的安装过程,也可能遇到一些小问题。最常见的莫过于集群纳管超时。这通常是由于网络连通性问题导致的,请确保管理集群可以访问被管集群的API服务器。

如果遇到Kurator Pod启动失败,检查日志常会发现“连接K8s API失败”的错误。这往往是kubeconfig文件中的API地址或凭证不正确导致的。重新检查config.yaml配置文件,确保每个参数都正确无误。

另一个常见问题是国内用户访问GitHub慢导致的下载失败。除了使用wget命令,你还可以考虑配置代理,或者使用Gitee等国内镜像源。

对于已经存在的Kubernetes集群,Kurator支持通过“附加集群”(Attached Cluster)的方式进行管理。这意味着你不需要为了使用Kurator而重新创建集群,大大降低了迁移成本。

03 核心利器:统一应用分发实战体验

Kurator最强大的功能之一就是统一应用分发。想象一下,你只需要一个YAML文件,就能将应用部署到分布在各地、各个云厂商的数十个集群中。

下面是具体操作方法:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: nginx-global

namespace: default

spec:

source:

helm:

repo: https://charts.bitnami.com/bitnami

chart: nginx

version: 15.1.0

targetCluster:

fleet: production-fleet

clusterSelector:

matchLabels:

env: production

执行 kubectl apply -f cross-cluster-application.yaml 后,Kurator会自动完成所有集群中的Nginx部署。更棒的是,你还可以为不同集群配置差异化参数,比如为资源充足的集群设置更多副本数。

这种基于GitOps的方式,确保了代码和配置在各个环境中完全一致。当源代码或配置发生变更时,Kurator会自动检测这些变更,并将其同步到所有相关的环境中。

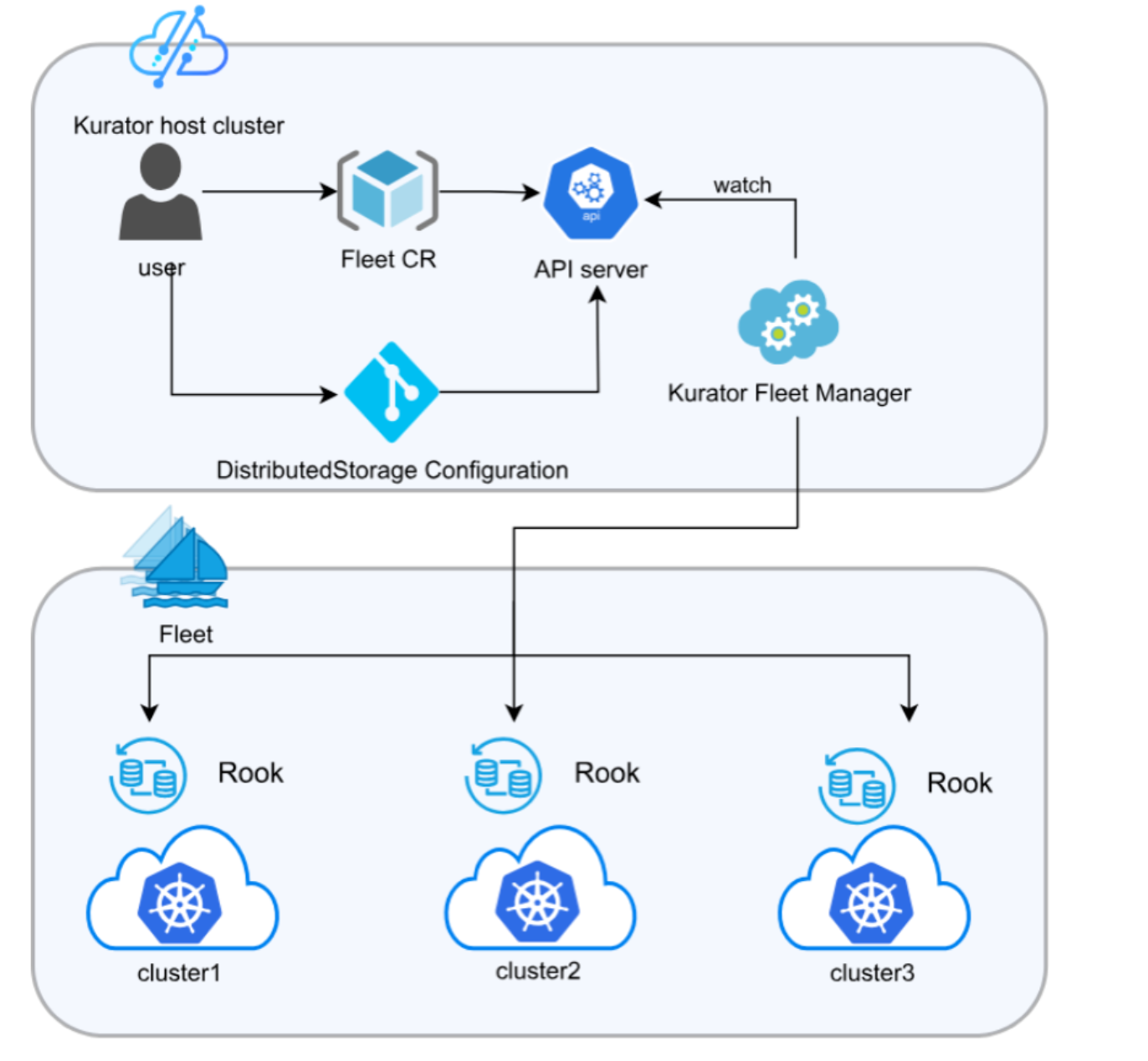

这张图展示了Kurator的统一分布式存储架构,用户通过定义一个配置就能够在多个集群里自动部署和管理Rook存储:

04 进阶能力:渐进式发布策略解析

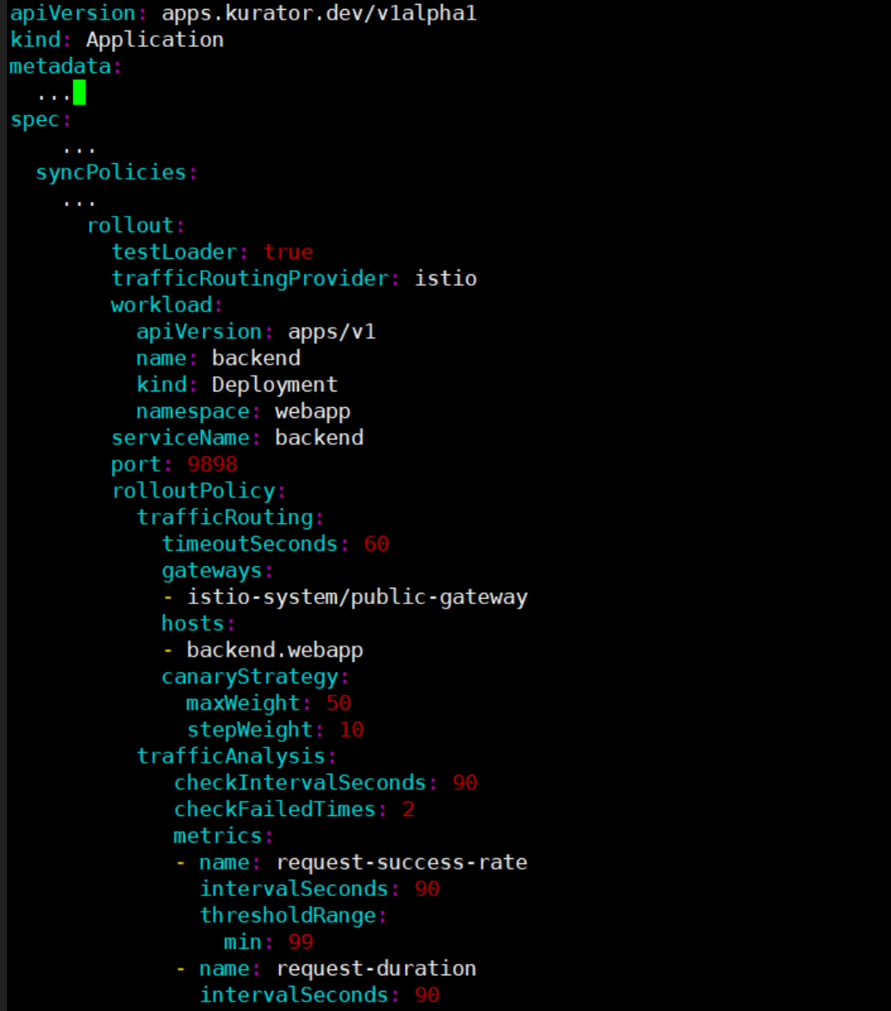

在应用分发的基础上,Kurator v0.6.0增加了渐进式发布功能,包括金丝雀发布、A/B测试和蓝绿发布三种策略。

金丝雀发布允许你先向少量用户发布新版本进行测试,根据测试结果决定是否全面推出。你可以配置每次测试成功后流量递增的比例,比如从10%开始,最多不超过50%。

你可以参考下面这个操作示例,看看怎么通过Kurator配置金丝雀发布:

A/B测试则更加精细化,可以根据用户特征(如使用特定浏览器或地理位置)将流量导向不同版本。这在测试新功能对不同用户群体的影响时特别有用。

蓝绿发布通过维护两套独立的环境(蓝环境和绿环境),实现零停机升级。测试通过后,只需切换流量到新环境即可完成发布。

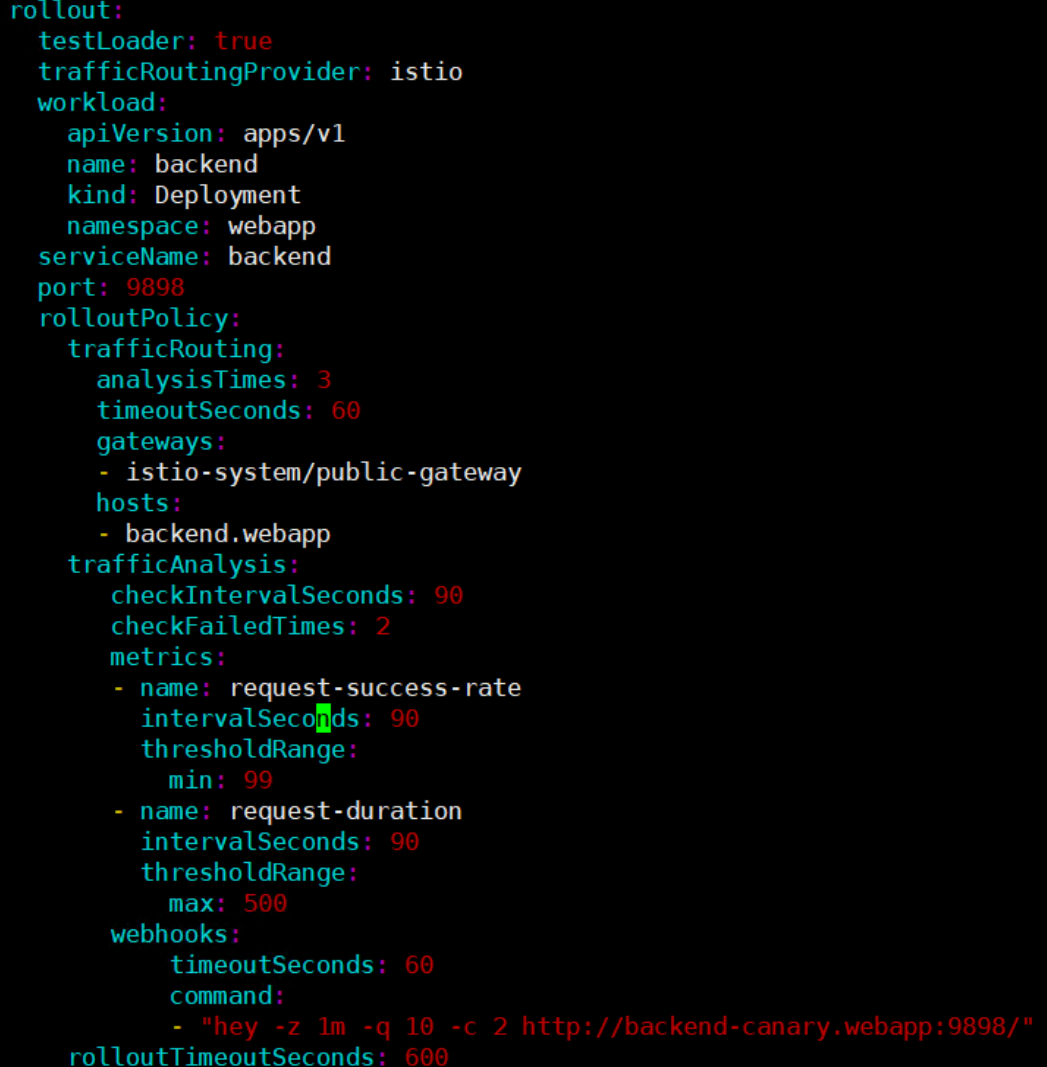

想搞懂怎么在Kurator里配置蓝绿发布?可以看看下面这个示例,它展示了如何通过设置流量切换策略、健康检查指标和回滚机制:

这些高级发布策略在传统多集群环境中实现起来相当复杂,但Kurator通过声明式API使其变得简单易用。

05 架构密码:Kurator如何整合顶尖开源项目

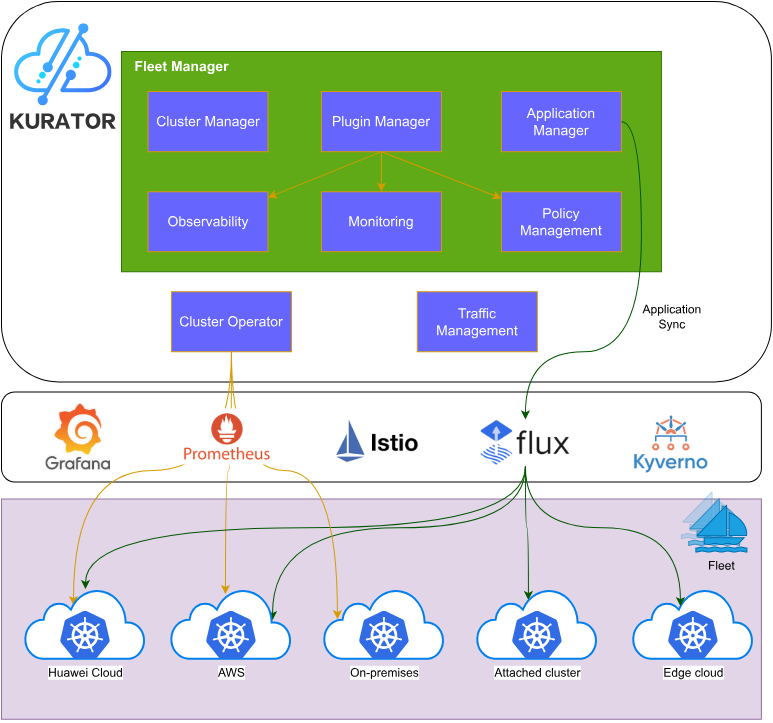

这张Kurator架构图挺清晰的,上面是核心的Fleet Manager,负责统一管理集群、插件、应用和策略:

Kurator不是从零开始造轮子,而是巧妙地整合了CNCF生态中的优秀项目。它以Karmada作为多集群编排基础,内置集成了Istio、Prometheus、Thanos、Volcano、KubeEdge、Argo等主流云原生技术。

这种集成不是简单的堆砌,而是深度整合。例如,Kurator通过Fleet(集群舰队)概念统一管理多个集群,无论这些集群在公有云、私有云还是边缘环境。

对于监控,Kurator结合Prometheus和Thanos实现多集群指标收集,通过Grafana提供统一的可视化界面。对于策略管理,则整合Kyverno实现跨集群策略统一下发。

最有意思的是流量治理部分。Kurator基于Istio构建,但做了更高层次的抽象。你不需要直接编写复杂的Istio VirtualService和DestinationRule,而是通过Kurator提供的简化API实现跨集群流量管理。

06 未来视野:分布式云原生的创新方向

基于我在云原生社区的参与经验,我认为分布式云原生技术有几个重要发展方向。

首先是智能化运维。当前Kurator已经提供了统一的监控和策略管理,未来可以加入AI驱动的异常检测、根因分析和自愈能力。比如基于历史数据预测集群资源需求,自动进行弹性扩缩容。

其次是边缘计算深度融合。随着5G和物联网发展,边缘计算场景越来越多。Kurator已经支持KubeEdge,但可以进一步加强云边协同、边缘自治和离线操作能力。

再者是安全左移和零信任架构。在分布式环境中,安全边界变得模糊。Kurator可以集成更多安全能力,如软件供应链安全、运行时保护和机密计算。

最后是开发者体验优化。虽然Kurator降低了运维复杂度,但还可以进一步简化开发者体验。比如提供更丰富的模板、更直观的可视化界面和更完善的调试工具。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)