vllm多卡部署开源模型(二)

继续上一篇【先说一下使用时的一些问题,我截取了一些并发响应。

·

继续上一篇【vllm多卡部署开源模型(一)_千问2.5部署要什么显卡-CSDN博客】

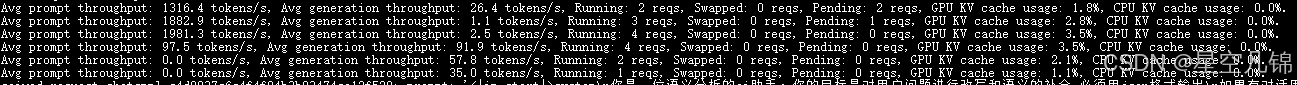

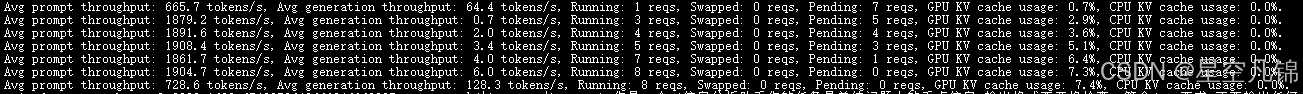

先说一下使用时的一些问题,我截取了一些并发响应。

问题1

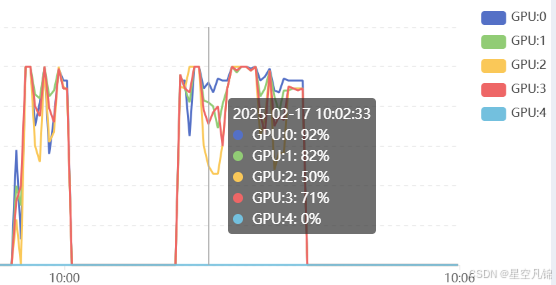

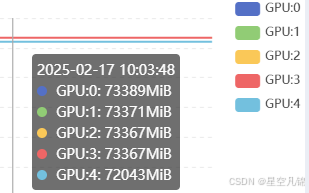

我的配置从3台增加到5台A800-80G,运行千问72B-AWQ模型。通过并发测试比之前快了一些,但是不太多,推理占用显存还是很大,我修改了上下文长度=128K,KV也修改了。下一步还是要从这些参数进行修改进行尝试。

另外:单卡运行qwen-14B-Instruct是不能运行的,上下文超长了。需要修改最大token,80G显存最大是15000多,修改小于这个值就可以了。

问题2

模型会出现无限循环问题,因为复现概率不高,只能猜测是在模型输出长文本时会造成这种情况,单词5000字以下几乎没有问题,大概是8000字以上了。做了一些修改比如:

- 提高top_p

- 增加惩罚系数

出现频率:2个月每天连续使用,出现5次左右

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)