速通大模型:LLM模型微调和部署anythingllm

速通大模型

·

拉取anythingllm

本地和docker都有用过,但最后还是选择docker管理(docker使用多了之后真会会上瘾的,不知道各位是否也是一样的)

anythingllm官网anythingllm.com/

anythingllm桌面端下载地址anythingllm.com/download 首先我们打开cmd

拉取镜像

docker pull mintplexlabs/anythingllm

运行ollama docker镜像

因为我是使用的windows11,所以打开shell

$env:STORAGE_LOCATION="你的anythingllm数据存放地址"; `

If(!(Test-Path $env:STORAGE_LOCATION)) {New-Item $env:STORAGE_LOCATION -ItemType Directory}; `

If(!(Test-Path "$env:STORAGE_LOCATION\.env")) {New-Item "$env:STORAGE_LOCATION\.env" -ItemType File}; `

docker run -d -p 3001:3001 `

--cap-add SYS_ADMIN `

-v "$env:STORAGE_LOCATION`:/app/server/storage" `

-v "$env:STORAGE_LOCATION\.env:/app/server/.env" `

-e STORAGE_DIR="/app/server/storage" `

mintplexlabs/anythingllm;

#我这里是D盘下新建的

其中在此处可以修改端口

docker run -d -p 3001:3001

运行完成后访问本地localhost+端口号(或者在docker可视化页面点击端口号),即可打开anythingllm页面

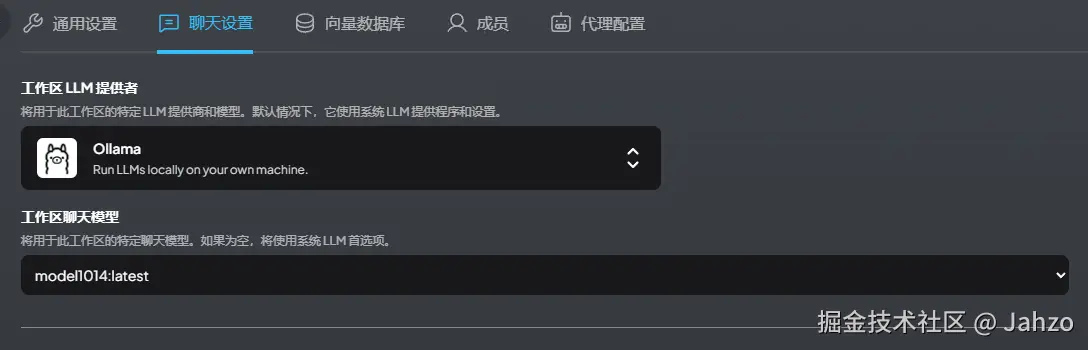

根据页面新建信息以及配置即可,注意选择模型提供商为ollama,anythingllm会自动识别您本地运行的ollama服务,因此需要到ollama镜像中

开启对话

然后新建工作区开启对话

如果您有多个ollama或者其他服务,后续也可在anythingllm工作区进行替换

CSDN独家福利

最后,感谢每一个认真阅读我文章的人,礼尚往来总是要有的,下面资料虽然不是什么很值钱的东西,如果你用得到的话可以直接拿走:

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)