mlp神经网络_【论文分享沙龙 | 2020第172期】利用点云局部特征的图注意力点神经网络...

论文分享沙龙2020第17期分享人:中国矿业大学博士 朱冠宇研究方向:计算机视觉 | 三维点云分类、分割论文标题:GAPNet: Graph Attention based Point Neural Network for Exploiting Local Feature of Point Cloud (利用点云局部特征的图注意力点神经网络 )论文来源:arXiv论文下载:https:/...

分享人:中国矿业大学博士 朱冠宇

研究方向:计算机视觉 | 三维点云分类、分割

论文标题:GAPNet: Graph Attention based Point Neural Network for Exploiting Local Feature of Point Cloud (利用点云局部特征的图注意力点神经网络 )

论文来源:arXiv

论文下载:https://arxiv.org/pdf/1905.08705.pdf

摘要:

在PointNet中有助于更好的上下文学习的本地特性没有被考虑。同时,注意机制通过对邻近节点的关注,可以有效地捕获基于图的数据上的节点表示。在本文中,作者提出了一种新的用于点云的神经网络,称为GAPNet,通过在多层感知器(MLP)层中嵌入图注意机制来学习局部几何表示。首先,作者引入一个GAPLayer,通过在邻域上突出不同的注意权重来学习每个点的注意特征。其次,为了挖掘足够的特征,采用了multi-head机制,允许GAPLayer聚合来自independent heads的不同特征。第三,作者提出了在相邻网络上使用注意力池化层来捕获本地信号,以增强网络的鲁棒性。最后,GAPNet将多层MLP应用在注意力特征和局部特征上,充分提取局部几何结构。

1. 方法贡献:-

本文提出了一个multi-head GAPLayer,通过显示不同的邻居对每个点的重要性来捕获上下文的注意力特征,Independent heads并行地处理来自表示空间的不同特征,并进一步聚合在一起,以获得足够的特征提取能力。

-

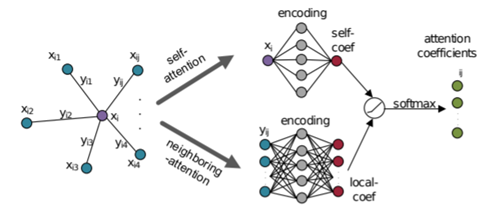

本文提出了自注意和邻域注意机制,允许GAPLayer通过考虑自几何信息和与相应邻域的局部相关性来计算注意系数。

-

提出了一个用在领域的注意力池化层来识别最重要的特征,通过获得局部信号表示,以增强网络的鲁棒性。

-

本文的GAPNet将GAPLayer和注意力池化层集成到多层感知器(MLP)层或现有网络(例如PointNet)中,以便更好地从无序点云中提取本地上下文特征。

1.1 GAPLayer

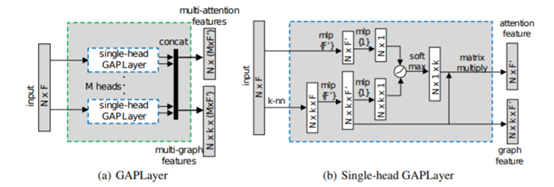

M个heads的GAPLayer,如图(a)所示。以N个F维特征的点为输入,将所有并行的heads的注意力特征和图特征分别拼接,生成多注意特征和多图特征作为输出。图 (b)所示,single-head的GAPLayer并行的学习self-attention和neighboring-attention特征,然后通过一个非线性激活函数leaky-RELU融合在一起获得注意力系数,然后由softmax函数进一步归一化,然后通过线性组合运算最终生成注意力特征。

M个heads的GAPLayer,如图(a)所示。以N个F维特征的点为输入,将所有并行的heads的注意力特征和图特征分别拼接,生成多注意特征和多图特征作为输出。图 (b)所示,single-head的GAPLayer并行的学习self-attention和neighboring-attention特征,然后通过一个非线性激活函数leaky-RELU融合在一起获得注意力系数,然后由softmax函数进一步归一化,然后通过线性组合运算最终生成注意力特征。

1.2 GAPNet

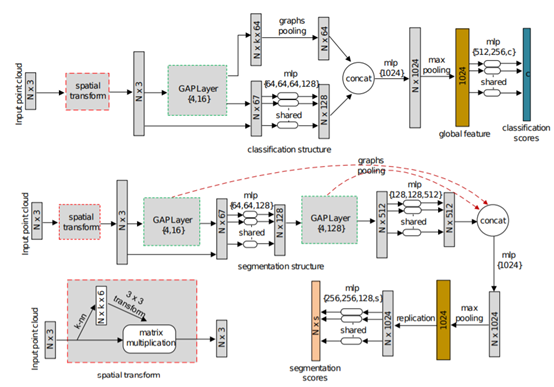

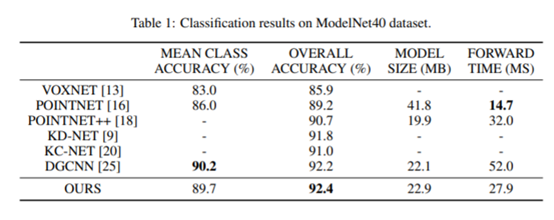

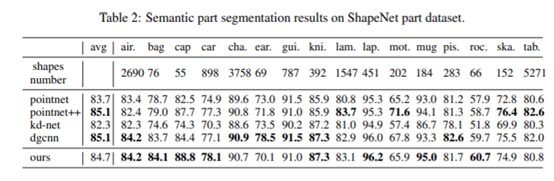

该体系结构包含两个部分:分类(顶部分支)和语义部分分割(底部分支)。分类模型将N个点作为输入,并应用一个GAPLayer获得multi-attention特性和multi-graph特性,然后分别送入共享MLP层和注意力池化层,然后是一个共享的全连接层,形成一个全局特征,用于获取c类的分类分数。

排版编辑:朱冠宇综合策划:何 欣

排版编辑:朱冠宇综合策划:何 欣

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)