给神经网络增加记忆能力

背景介绍为了处理时序数据并利用其历史信息,我们需要让网络具有短期记忆能力.而前馈网络是一种静态网络不具备这种记忆能力.一般来讲,引入外部记忆单元一种简单的利用历史信息的方法是建立一个额外的延时单元,用来存储网络的历史信息(可以包括输入输出隐状态等).比较有代表性的模型是延时神经网络TDNN.延时神经网络在时间维度上共享权值,以降低参数数量.因此对于序列输入来讲,延时神经网络就相当于卷积神经网络.延

·

背景介绍

为了处理时序数据并利用其历史信息,我们需要让网络具有短期记忆能力.而前馈网络是一种静态网络,不具备这种记忆能力.

一般来讲,我们可以通过以下四种方法来给网络增加短期记忆能力,即:延时神经网络、有外部输入的非线性自回归模型、循环神经网络、引入外部记忆单元。

延时神经网络

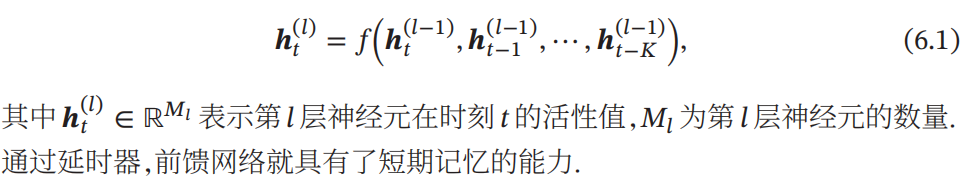

一种简单的利用历史信息的方法是建立一个额外的延时单元,用来存储网络的历史信息(可以包括输入、输出、隐状态等).比较有代表性的模型是延时神经网络(Time Delay Neural Network,TDNN).

延时神经网络在时间维度上共享权值,以降低参数数量.因此对于序列输入来讲,延时神经网络就相当于卷积神经网络. 延时神经网络是在前馈网络中的非输出层都添加一个延时器,记录神经元 的最近几次活性值.在第 t 个时刻,第 𝑙 层神经元的活性值依赖于第 𝑙 − 1 层神经元的最近𝐾 个时刻的活性值,即

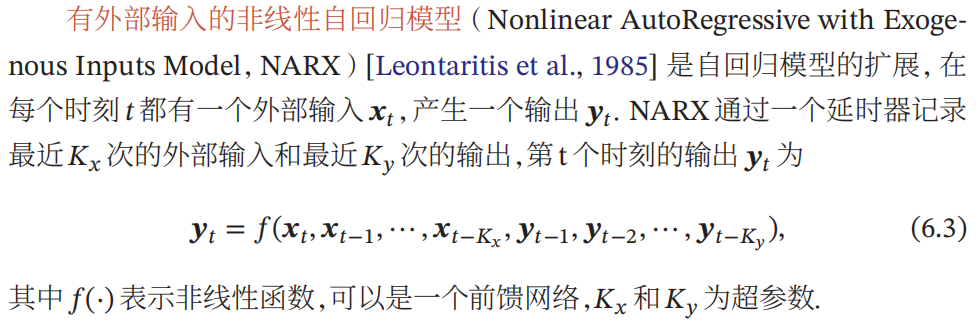

有外部输入的非线性自回归模型

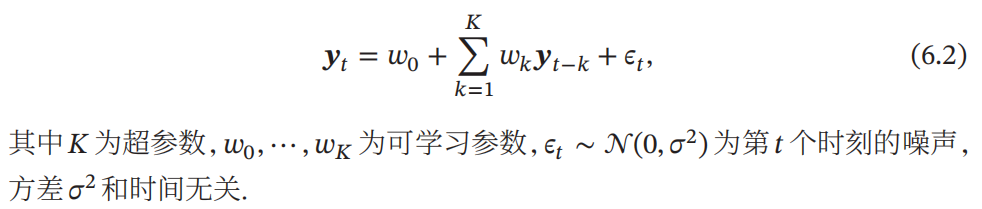

自回归模型(AutoRegressive Model,AR)是统计学上常用的一类时间序列模型,用一个变量𝒚𝑡 的历史信息来预测自己.

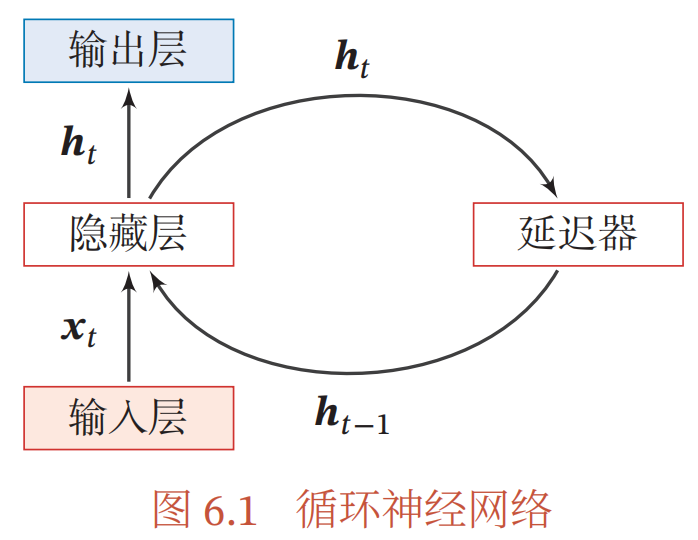

循环神经网络

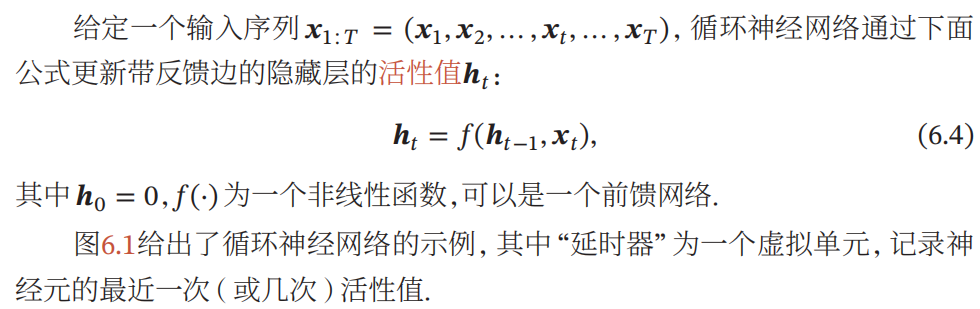

循环神经网络(Recurrent Neural Network,RNN)通过使用带自反馈的神经元,能够处理任意长度的时序数据。RNN也经常被翻译为递归神经网络.这里为了区别与另外一种递归神经网络 (Recursive Neural Network,RecNN),我们称为循环神经网络.

从数学上讲,公式(6.4)可以看成一个动力系统.因此,隐藏层的活性值𝒉𝑡 在很多文献上也称为状态(State)或隐状态(Hidden State).

动力系统(Dynamical System)是一个数学上 的概念,指系统状态按照一定的规律随时间变化的系统.具体地讲, 动力系统是使用一个函数来描述一个给定空间(如某个物理系统的状态空间)中所有点随时间的变化情况.生活中很多现象(比如钟摆晃动、台球轨迹等)都可以动力系统来描述.

由于循环神经网络具有短期记忆能力,相当于存储装置,因此其计算能力十分强大.理论上,循环神经网络可以近似任意的非线性动力系统.前馈神经网络可以模拟任何连续函数,而循环神经网络可以模拟任何程序.

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)