图神经网络(GNN)怎么会过时呢!GNN+Transformer可拿下顶会!模型性能飞起

图神经网络(GNN)在处理非欧结构数据方面表现出色,广泛应用于社交网络、推荐系统等领域。然而,传统GNN主要依赖局部邻域信息聚合,难以捕捉全局信息,限制了其在复杂任务中的表现。近年来,研究者提出了多种创新思路,如将GNN与Transformer结合,引入自注意力机制以扩大感受野,或通过拓扑结构增强、层次化聚合等方式提升模型表达能力。这些方法为GNN性能的进一步提升提供了新的可能。本文整理了10篇关

图神经网络(GNN)在处理非欧结构数据方面展现出强大的建模能力,广泛应用于社交网络、推荐系统、分子结构分析等领域。然而,传统GNN主要依赖局部邻域的信息聚合机制,难以有效捕捉图结构中的全局信息,限制了其在复杂任务中的表现。因此,如何改进GNN模型以增强其全局建模能力,成为当前研究的热点方向之一。

近年来,研究者提出了多种创新思路,例如将GNN与Transformer结合,引入自注意力机制以扩大感受野;或通过拓扑结构增强、层次化聚合等方式提升模型表达能力。这些方法为GNN性能的进一步提升提供了新的可能,也为相关领域论文的选题和创新提供了丰富灵感。

我整理了10篇关于GNN模型改进的前沿论文,涵盖多种创新思路与技术方案,旨在帮助读者深入理解当前GNN的研究趋势,并为开展相关课题研究提供参考与启发。

点击【AI十八式】的主页,获取更多优质资源!

一、TransGNN: Harnessing the Collaborative Power of Transformers and Graph Neural Networks for Recommender Systems

方法

-

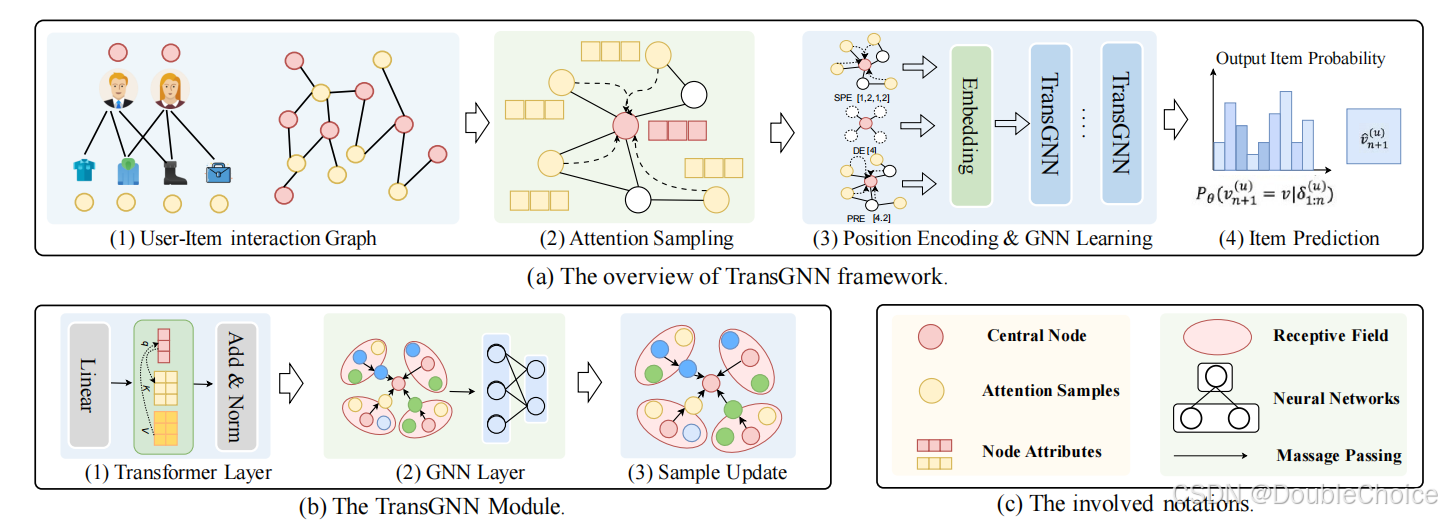

模型架构:

TransGNN提出了一种交替结合Transformer和GNN层的协作框架。Transformer层通过自注意力机制扩展GNN的感受野,全局聚合信息;GNN层通过消息传递捕获图结构信息,增强Transformer对局部拓扑的理解。 -

注意力采样模块:

为每个中心节点采样最相关的节点,结合语义相似性和图结构信息,减少计算复杂度从O(N^2)降至O(Nk)并过滤噪声连接。 -

位置编码模块:

设计了三种位置编码方法:-

最短路径跳数编码:捕获节点间拓扑距离。

-

节点度编码:反映节点交互频率或流行度。

-

PageRank编码:衡量节点在图中的结构重要性。

通过多层感知机将编码与节点属性融合,增强Transformer对图结构的感知。

-

-

高效样本更新策略:

-

随机游走更新:基于相似性探索局部邻域,动态扩展注意力样本。

-

消息传递更新:利用GNN邻域消息传递直接聚合邻居的注意力样本,避免额外计算开销。

-

-

模型优化:

使用成对排序损失函数优化推荐结果,提升正样本与负样本的区分度。

创新点

-

协作式架构设计:

首次将Transformer与GNN交替结合,Transformer扩展GNN的全局视野,GNN增强Transformer对图结构的捕获,形成互补增强机制。 -

多粒度位置编码:

提出三种位置编码(SPE、DE、PRE),将图结构的多样性信息(距离、频率、重要性)融入节点表示,解决了Transformer在图上缺乏位置感知的问题。 -

高效采样与更新策略:

-

注意力采样:通过语义与结构联合筛选节点,降低计算复杂度并抑制噪声。

-

动态样本更新:两种轻量级更新策略(随机游走、消息传递)支持大规模图的高效训练,避免静态样本的过时问题。

-

-

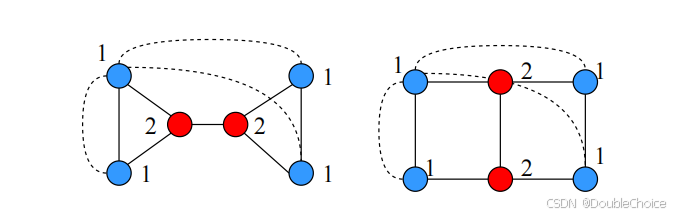

理论验证与可扩展性:

通过理论分析证明TransGNN的表达能力优于传统GNN,且复杂度仅线性增加,适合大规模应用。 -

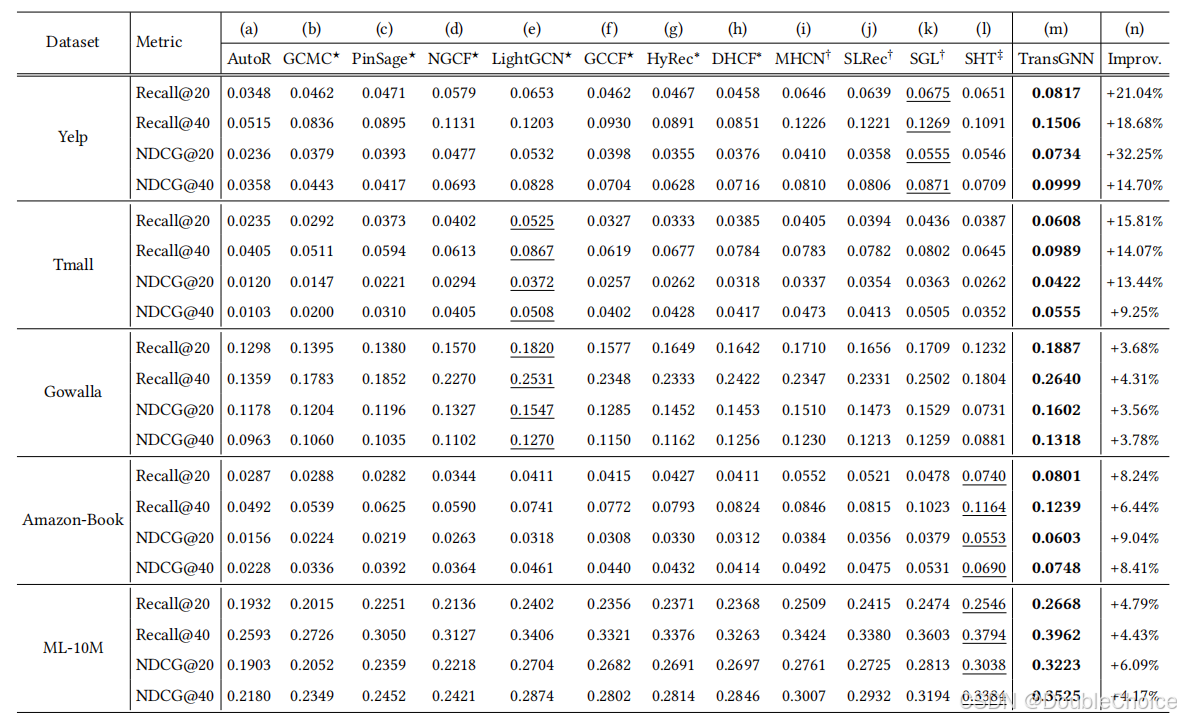

实验优势:

在五个公开数据集上验证了模型的有效性,尤其在Top-K推荐场景中显著优于基线模型,并展示了良好的可扩展性与计算效率。

论文链接:https://arxiv.org/abs/2308.14355

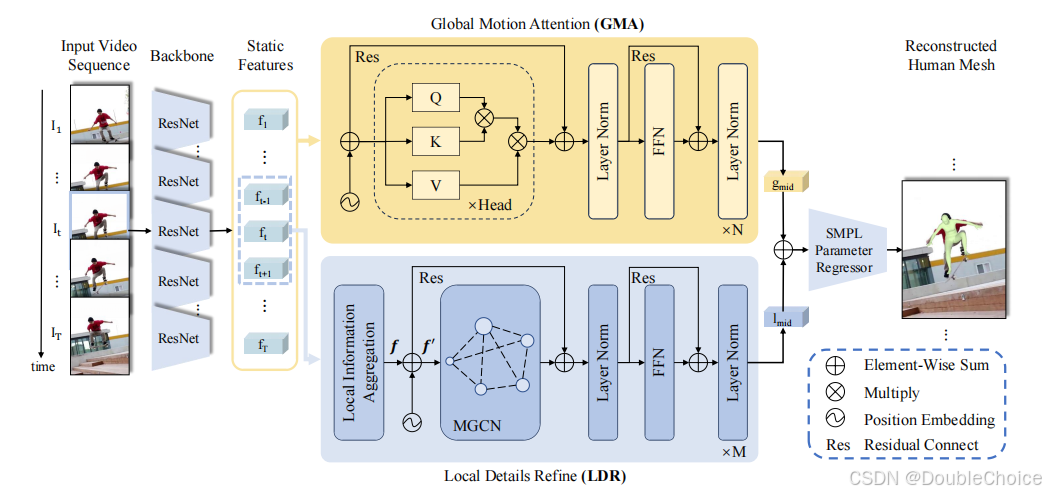

二、Dual-Branch Graph Transformer Network for 3D Human Mesh Reconstruction from Video

方法

-

双分支架构:

-

全局运动注意力分支:基于Transformer编码器,从所有相邻帧中提取长期时序依赖,利用多头注意力机制捕捉全局运动特征。

-

局部细节优化分支:结合调制图卷积网络与Transformer框架,通过局部信息聚合模块和关键特征提取模块,从相邻3帧中捕捉局部细节。

-

特征融合:将GMA和LDR分支的输出特征相加后输入SMPL参数回归器,生成最终的人体网格。

-

-

关键技术模块:

-

调制图卷积:通过权重调制和邻接矩阵调制,动态调整不同节点的权重关系,增强局部特征的表达能力。

-

轻量化设计:GMA仅使用2层Transformer编码器,LDR仅使用1层Modulated GCN,减少参数量和计算量。

-

创新点

-

双分支并行架构:

首次提出同时建模全局运动与局部细节的双分支网络,解决了视频重建中全局-局部信息互补的难题,打破传统方法在准确性与平滑性之间的权衡。 -

图卷积与Transformer的深度融合:

-

在LDR分支中,将Modulated GCN嵌入Transformer框架,替换传统注意力机制,结合图结构对局部人体关节的建模能力与Transformer的全局感知优势。

-

提出局部信息聚合模块,增强相邻帧间冗余信息的利用,提升细节恢复能力。

-

-

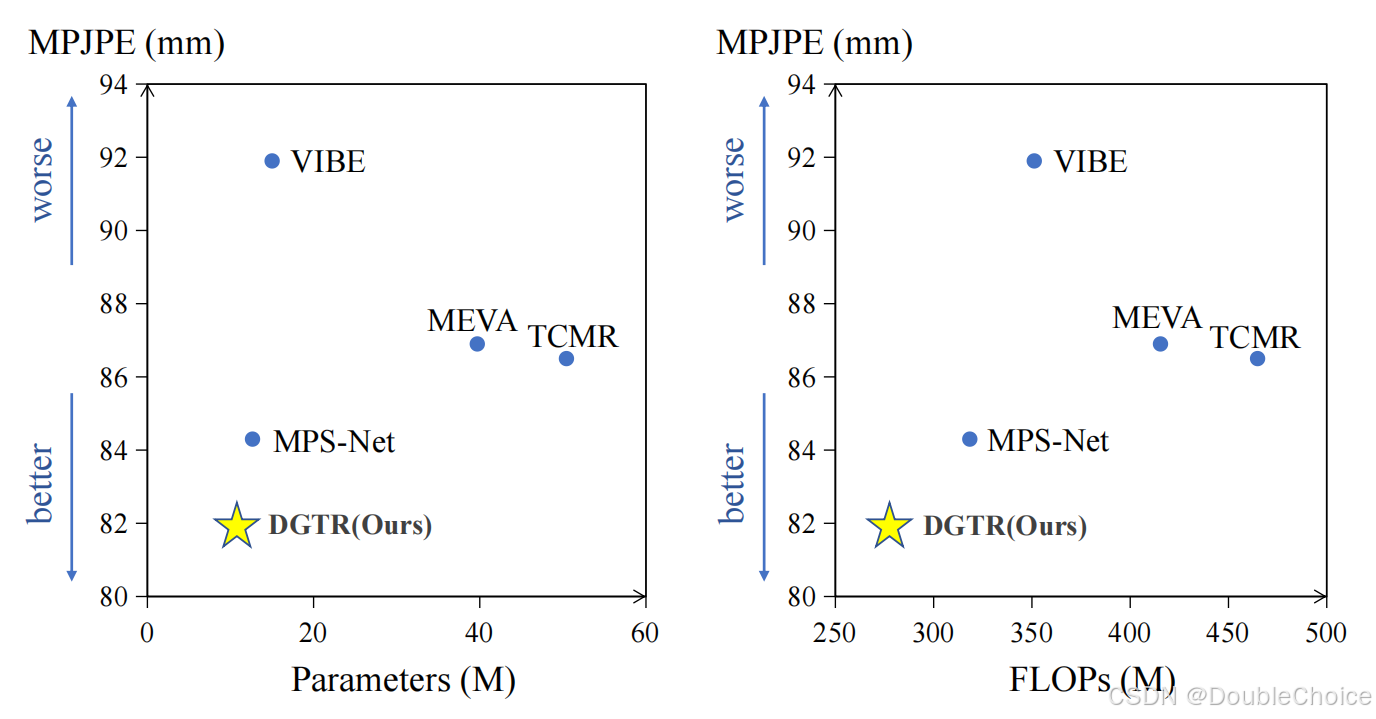

高效性与轻量化:

通过精简网络层数,在保持性能的同时显著降低参数量和计算量,更适合实际部署。 -

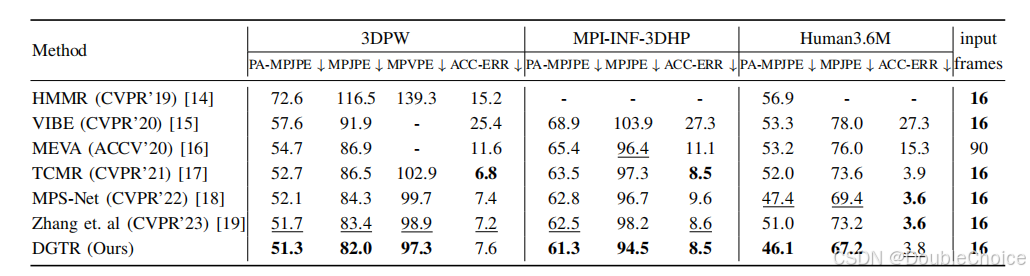

实验结果:

在3DPW、MPI-INF-3DHP、Human3.6M数据集上,MPJPE指标分别提升2.3mm、2.2mm、2.2mm,运动平滑性达到SOTA水平。

论文链接:https://ieeexplore.ieee.org/document/10801569

点击【AI十八式】的主页,获取更多优质资源!

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)