入门深度学习必须掌握的五大算法模型!

在深度学习技术日新月异的今天,掌握具有里程碑意义的五大核心算法架构,是突破技术瓶颈与拓展应用场景的关键。

在深度学习技术日新月异的今天,掌握具有里程碑意义的五大核心算法架构,是突破技术瓶颈与拓展应用场景的关键。

学习视频教程:

深度学习八大算法真不难!一口气学完CNN、RNN、GAN、GNN、DQN、Transformer、LSTM八大神经网络!机器学习|卷积神经网络|pytorch

【附源码】毕设有救了!整整50套深度学习项目,算法原理+论文解读,比啃书强太多了!学完就能玩透人工智能!pytorch/机器学习/计算机视觉

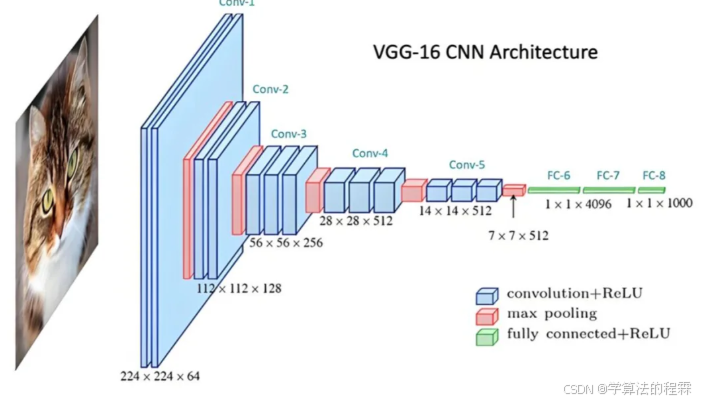

一、卷积特征提取网络(CNN)

核心机制:通过多层级联的卷积核在输入矩阵上执行滑动窗口运算,形成特征响应图谱。核心模块包含:

-

特征映射层:采用局部感受野提取纹理、边缘等空间模式

-

降维采样层:通过最大/平均池化保留显著特征

-

全局推理层:将空间特征编码为抽象语义向量

技术优势:

√ 具备平移不变性特征学习能力,适应图像/视频等规则网格数据

√ 参数复用机制显著降低计算复杂度(相比全连接网络可减少90%以上参数量)

√ 层次化特征抽象体系可自然适配多尺度视觉模式

技术挑战:

× 空间变换敏感性限制其在非欧几里得数据上的应用

× 感受野受限可能影响全局上下文建模

× 多层反向传播存在梯度衰减风险

典型应用:

▶ 医学影像分析(如MRI肿瘤检测)

▶ 自动驾驶场景解析

▶ 卫星图像地物分类

▶ 书法字库生成等跨模态任务

二、时序记忆网络(RNN)

核心机制:通过循环神经元构建时间维度上的记忆链,实现:

-

历史信息压缩存储(隐藏状态向量)

-

时序依赖关系建模(门控机制如LSTM/GRU)

-

变量长度序列处理(动态时间步展开)

技术优势:

√ 具备可变长度序列建模能力

√ 门控机制缓解梯度消失问题

√ 参数共享特性适合长序列处理

技术挑战:

× 并行计算效率受限(时序依赖需顺序计算)

× 长程依赖捕捉能力随序列长度指数下降

× 训练过程存在不稳定震荡风险

典型应用:

▶ 实时语音转写系统

▶ 金融交易序列预测

▶ 聊天机器人对话管理

▶ 音乐生成等时序创作任务

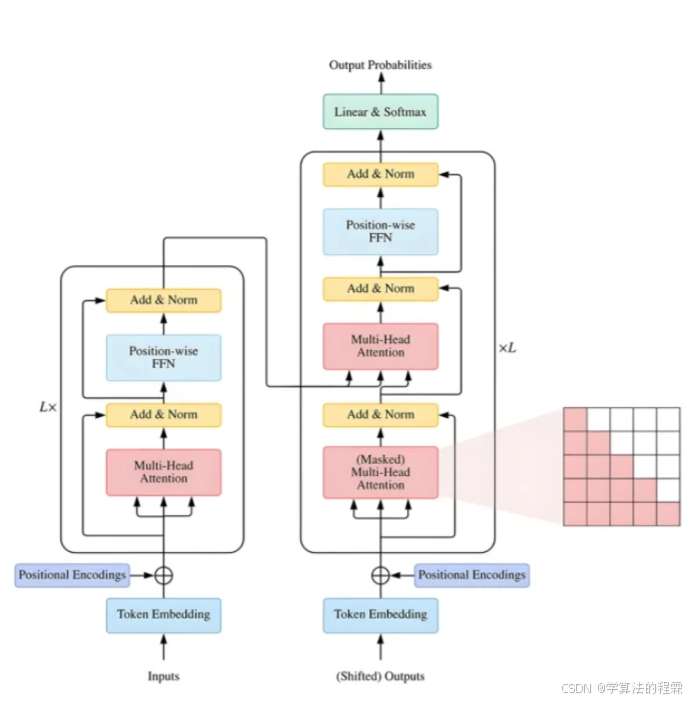

三、注意力增强网络(Transformer)

核心突破:革命性地引入自注意力机制,实现:

-

全局依赖关系建模(突破局部感受野限制)

-

并行化序列处理(替代循环结构)

-

多头注意力机制(捕捉多元语义关联)

技术优势:

√ 实现O(1)时间复杂度的长程依赖建模

√ 支持超大规模并行计算

√ 预训练-微调范式推动NLP范式变革

技术挑战:

× 二次复杂度自注意力计算(序列长度n→O(n²))

× 位置编码设计影响长文本建模

× 需要海量数据进行预训练

前沿应用:

▶ 长文本摘要生成(突破传统RNN的512词限制)

▶ 多模态预训练模型(如CLIP)

▶ 代码自动生成系统

▶ 数学定理证明等符号推理任务

四、双向编码表示模型(BERT)

技术革新:提出双向语言理解新范式,通过:

-

遮蔽语言模型(MLM)实现上下文感知

-

句间关系预测(NSP)捕捉篇章结构

-

深层Transformer编码器堆叠

核心优势:

√ 双向上下文建模突破ELMo的单向限制

√ 微调策略适配20+特定NLP任务

√ 注意力权重提供可解释性分析

现存挑战:

× 参数量级达亿级(如BERT-large含3.4亿参数)

× 预训练数据质量影响领域适配效果

× 生成任务表现弱于自回归模型

产业应用:

▶ 智能客服意图识别

▶ 法律文书自动摘要

▶ 医学文献知识图谱构建

▶ 情感分析驱动的用户画像建模

五、生成式对抗框架(GAN)

核心博弈:构建生成器-判别器的极小极大对抗体系:

-

生成器:通过潜在空间采样合成逼真样本

-

判别器:执行二元分类鉴别真伪

-

对抗训练:交替优化生成/判别能力

技术亮点:

√ 零监督学习范式(仅需真实样本)

√ 生成样本多样性超越传统方法

√ 支持跨模态数据转换(如文本→图像)

主要挑战:

× 训练过程存在模式坍塌风险

× 评估指标缺乏统一标准

× 生成样本存在伪影现象

创新应用:

▶ 虚拟试衣间(人体姿态迁移)

▶ 老电影高清修复

▶ 分子图生成(药物研发)

▶ 语音克隆与风格迁移

这五大算法体系不仅重塑了AI技术版图,更催生出如扩散模型、图神经网络等新兴架构。理解其设计哲学与适用边界,是开发具备产业价值AI系统的关键基石。未来,算法融合与创新将成为突破现有范式的主要方向,例如将Transformer架构引入强化学习,或将GAN与物理引擎结合等跨界探索。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)