QwenLong-L1-32B论文速览:趋向长上下文大 推理模型与强化学习

本文提出QWENLONG-L1框架,通过强化学习提升大型推理模型在长文本(120K tokens)场景下的推理能力。该框架采用渐进式上下文扩展方法,包含预热监督微调、分阶段RL训练和难度感知回溯采样三个核心技术,解决了长文本RL训练效率低和优化不稳定的问题。实验在7个长文本问答基准上,QWENLONG-L1-14B/32B模型表现优异,与Claude-3.7-Sonnet相当。消融研究验证了各技术

QWENLONG-L1 论文解读

一、引言

本文提出了 QWENLONG-L1,这是一个旨在通过强化学习(RL)提升大型推理模型(LRMs)长文本推理能力的框架。以往的 LRMs 在短文本推理任务中表现出色,但在需要处理长文本(如 120K tokens)的场景中,存在训练效率低下和优化过程不稳定的问题。QWENLONG-L1 通过渐进式上下文扩展的方法,使短文本 LRMs 能够适应长文本推理场景。具体来说,该框架包括三个核心部分:预热监督微调(SFT)阶段、基于课程引导的分阶段 RL 技术,以及难度感知的回溯采样策略,以促进策略探索。

二、长文本推理强化学习

(一)RL 算法

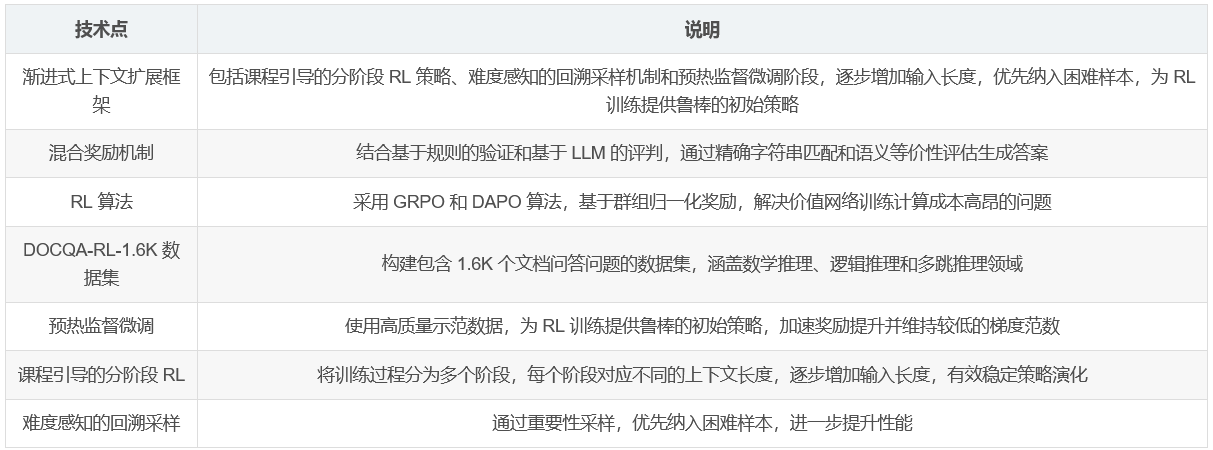

论文介绍了两种 RL 算法:近端策略优化(PPO)和基于群组的相对策略优化(GRPO)、解耦裁剪和动态采样策略优化(DAPO)。由于长文本输入使得价值网络训练计算成本高昂,论文选择了基于群组归一化奖励的 GRPO 和 DAPO 算法。

(二)渐进式上下文扩展

为解决长文本推理 RL 的训练动态不稳定问题,论文提出了渐进式上下文扩展框架,包括课程引导的分阶段 RL 策略、难度感知的回溯采样机制和预热监督微调阶段。课程引导的分阶段 RL 将训练过程分为多个阶段,每个阶段对应不同的上下文长度,逐步增加输入长度。难度感知的回溯采样则通过重要性采样,优先纳入困难样本。预热监督微调阶段使用高质量示范数据,为 RL 训练提供鲁棒的初始策略。

(三)混合奖励机制

论文提出了一种结合基于规则的验证和基于 LLM 的评判的混合奖励机制。基于规则的验证通过正则表达式提取模型生成的最终答案,并与标准答案进行精确字符串匹配。基于 LLM 的评判则通过一个小型 LLM 来评估生成答案与标准答案之间的语义等价性。

三、实验设置

(一)训练数据集

论文构建了 DOCQA-RL-1.6K 数据集,包含 1.6K 个文档问答问题,涵盖数学推理、逻辑推理和多跳推理领域。同时,通过 DeepSeek-R1 蒸馏出 5.3K 高质量问题-文档-答案三元组作为 SFT 数据集。

(二)训练细节

实验基于 R1-Distill-Qwen-14B 和 R1-Distill-Qwen-32B 模型进行。RL 训练采用两阶段课程上下文扩展,输入长度分别为 20K 和 60K。SFT 阶段输入长度设为 20K。训练在 32xA100-80G GPU 上进行。

(三)评估细节

在七个长文本文档问答基准测试上进行评估,包括多跳推理基准和数学推理基准。使用 DeepSeek-V3 作为评判模型,报告最大精确匹配和 LLM-评判准确率作为最终分数。

(四)基线模型

QWENLONG-L1 与多个最先进的 LRMs 进行比较,包括专有模型和开源模型。

四、实验结果

(一)主要结果

QWENLONG-L1 在七个长文本文档问答基准测试中表现出色。QWENLONG-L1-14B 和 QWENLONG-L1-32B 分别在平均得分上超越了多个先进的 LRMs,包括 Gemini-2.0-Flash-Thinking、Qwen3-Plus、Qwen3-235B-A22B 和 OpenAI-o3-mini 等,与 Claude-3.7-Sonnet-Thinking 表现相当。

(二)消融研究

消融研究表明,预热监督微调能加速奖励提升并维持较低的梯度范数。课程引导的分阶段 RL 能有效稳定策略演化。难度感知的回溯采样进一步提升了性能。

(三)附加分析

分析表明,SFT 和 RL 在优化长文本推理能力方面具有互补作用。RL 在提升推理行为(如定位、子目标设定、回溯和验证)方面表现出色,而 SFT 则在较少努力下实现可接受的性能。

五、结论与未来工作

论文提出 QWENLONG-L1 框架,通过渐进式上下文扩展解决了长文本推理 RL 的训练效率和优化稳定性问题。未来工作将集中在扩展现实任务、开发先进架构和重新思考长文本 RL 范式上。

六、案例研究

论文展示了两个案例,说明 QWENLONG-L1 如何通过有效的自我反思、验证和回溯,过滤掉无关细节并得出正确答案,体现了其长文本推理能力的提升。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)