深入解析:神经网络的C++实现

神经网络是模仿生物神经系统结构和功能的数学模型,它由大量的节点(或称神经元)通过各种类型的连接(或称突触)相互连接。这些节点被组织成不同的层次,每一层中的神经元处理输入信息并产生输出,传递到下一层。基础的神经网络包括输入层、隐藏层和输出层。在学习神经网络时,首先要理解三个核心概念:激活函数、权重(weight)和偏置(bias)。激活函数决定一个神经元是否被激活,权重控制输入的重要程度,而偏置则是

简介:本篇文章详细解析了神经网络的C++源码,涵盖了神经网络基础、C++源码结构、关键概念详解以及学习路径建议。通过该教程,读者能深入了解神经网络的工作原理、反向传播算法以及C++代码的实现细节,为解决分类、回归问题和深度学习探索打下坚实基础。

1. 神经网络基础介绍

神经网络是模仿生物神经系统结构和功能的数学模型,它由大量的节点(或称神经元)通过各种类型的连接(或称突触)相互连接。这些节点被组织成不同的层次,每一层中的神经元处理输入信息并产生输出,传递到下一层。基础的神经网络包括输入层、隐藏层和输出层。

在学习神经网络时,首先要理解三个核心概念:激活函数、权重(weight)和偏置(bias)。激活函数决定一个神经元是否被激活,权重控制输入的重要程度,而偏置则是对输入进行调整以更准确地预测输出。神经网络的学习过程实质上是对这些参数的不断调整过程。

理解神经网络的基础知识后,可以进一步深入学习更复杂的结构,如卷积神经网络(CNN)、循环神经网络(RNN)以及近年来大热的Transformer模型。每一类神经网络在解决不同问题时都展示出了优越的性能,如CNN在图像识别领域,RNN在语音识别与自然语言处理领域,而Transformer则在机器翻译和文本理解领域大放异彩。

2.1 神经网络的C++实现概述

2.1.1 C++在神经网络中的应用

C++在神经网络中的应用广泛,其性能上的优势使得它成为深度学习库实现的首选语言之一。C++具有高性能的特性,尤其适合于实现那些计算密集型的神经网络算法。在进行神经网络的底层开发时,如自定义层、优化器等,C++的灵活和高效让它成为不二选择。

此外,C++可以与硬件紧密交互,这使得利用C++开发的神经网络应用能够更好地利用GPU等硬件资源,加速计算过程。如CUDA编程接口可以使得C++代码直接运行在NVIDIA GPU上,这对于深度学习应用来说是极大的优势。

2.1.2 开源框架与工具的选择

在实际开发中,选择合适的开源框架和工具至关重要。对于C++实现的神经网络,主要的开源框架包括TensorFlow C++ API、PyTorch C++前端以及Dlib等。TensorFlow C++ API是Google开发的框架,对于大规模生产环境下的应用非常合适。PyTorch C++前端则是从Python接口转换而来的,它便于在Python和C++之间共享代码。

在工具选择上,除了直接使用这些框架提供的工具外,还有一些辅助工具和库值得推荐。比如OpenCV用于图像处理和视觉任务,Boost库则可以用于数据结构和算法的优化。

2.2 C++源码的基本结构

2.2.1 主程序结构分析

一个典型的C++神经网络程序主结构通常由以下几个部分组成:

- 包含必要的头文件,如对标准库的引用以及对网络库的引用。

- 声明程序中用到的全局变量和函数。

- 主函数入口,负责程序的初始化、网络的创建、训练、测试和清理资源。

#include <iostream>

#include "network.h" // 假设这是用户定义的网络库

int main() {

// 初始化日志记录、随机数生成器等

setup();

// 创建网络结构

Network net;

// 加载数据

net.load_data();

// 训练网络

net.train();

// 测试网络

net.test();

// 清理资源

cleanup();

return 0;

}

2.2.2 模块划分和功能

为了清晰的管理代码,一个好的实践是将网络的不同部分划分到不同的模块中。以下是常见的模块划分方法:

- 数据处理模块:负责数据的加载、预处理和批量生成。

- 网络结构模块:定义网络层的结构、前向传播和初始化参数。

- 训练模块:负责反向传播、参数更新和训练过程的控制。

- 测试模块:运行测试并输出结果。

// network.h

class Network {

public:

void load_data(); // 数据加载

void create_layers(); // 创建网络层

void train(); // 训练

void test(); // 测试

// ...其他成员函数

};

// data_handler.h

class DataHandler {

public:

void load_dataset(); // 加载数据集

void preprocess_data(); // 数据预处理

// ...其他数据处理相关函数

};

// layer.h

class Layer {

public:

void forward(); // 前向传播

void backward(); // 反向传播

// ...其他层相关函数

};

2.3 C++源码的深入细节

2.3.1 关键数据结构的定义

在C++神经网络实现中,关键的数据结构通常包含权重矩阵、偏置向量、输入输出缓存等。这里以一个简单的全连接层为例:

class FullyConnectedLayer {

private:

Eigen::MatrixXd weights; // 权重矩阵

Eigen::VectorXd bias; // 偏置向量

Eigen::VectorXd input; // 输入向量

Eigen::VectorXd output; // 输出向量

public:

FullyConnectedLayer(int input_size, int output_size) {

// 初始化权重矩阵和偏置向量

weights.resize(output_size, input_size);

bias.resize(output_size);

weights.setRandom(); // 随机初始化权重

bias.setRandom(); // 随机初始化偏置

}

void forward(const Eigen::VectorXd &input) {

this->input = input;

output = weights * input + bias;

}

// 其他成员函数,如后向传播等

};

2.3.2 关键算法的实现细节

关键算法的实现在C++中需要考虑到性能和效率。以反向传播算法为例,梯度的计算、权重和偏置的更新是核心内容。下面是一个简化的梯度下降更新步骤的代码示例:

void update_parameters(FullyConnectedLayer &layer, double learning_rate) {

// 假设我们已经有了梯度信息

Eigen::MatrixXd gradient_weights = ...; // 权重的梯度

Eigen::VectorXd gradient_bias = ...; // 偏置的梯度

// 更新权重和偏置

layer.weights -= learning_rate * gradient_weights;

layer.bias -= learning_rate * gradient_bias;

}

在实际的神经网络中,每个层在前向传播后会计算梯度,在反向传播时根据梯度更新权重和偏置。这里需要注意的是,所有的矩阵操作都应该在内存和计算上进行优化以获得最佳性能。

以上,我们对C++源码的结构和细节进行了讨论,从源码的总体结构划分到关键数据结构的定义,再到核心算法实现的细节,都进行了深入的剖析。这对于理解C++实现神经网络的内部机制具有重要的意义,也为进一步学习和研究奠定了基础。

3. 反向传播算法实现

3.1 反向传播算法的原理

3.1.1 错误传递与权重更新机制

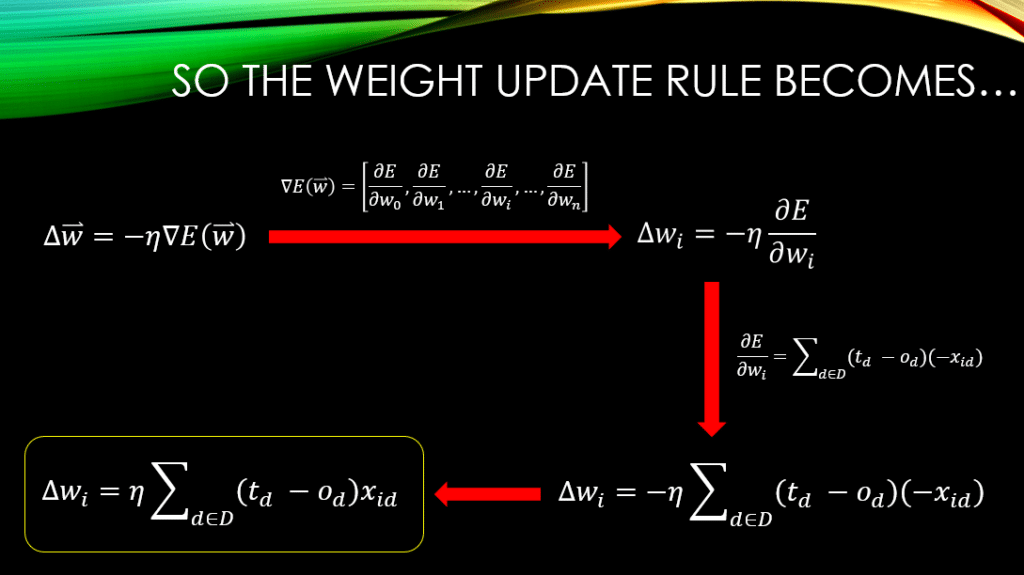

反向传播算法(Backpropagation)是神经网络训练中的一种关键算法,其核心思想是通过误差反向传播来更新网络中的权重和偏置。在神经网络的训练过程中,首先通过前向传播计算出模型的预测输出,然后计算预测输出与实际输出之间的误差。这个误差会被用来指导权重的更新。

误差的计算通常基于损失函数(Loss Function),损失函数衡量了模型预测的准确度,常见的损失函数有均方误差(MSE)和交叉熵(Cross-Entropy)等。一旦确定了损失函数,反向传播算法通过链式法则计算损失函数对每个权重的偏导数。这些偏导数反映了在当前权重下,损失函数值如何变化。然后,通过这些偏导数和学习率来更新权重,学习率是一个超参数,控制着在反方向上调整权重的步长。

在数学表达上,如果有N个样本的训练集,损失函数可以表示为所有样本损失的平均值。反向传播的过程可以被分解为两个主要步骤:误差的反向传播和权重的更新。在反向传播中,误差从输出层传递到输入层,每经过一层,都会根据当前层的权重计算误差的梯度。

3.1.2 激活函数的导数计算

在神经网络中,激活函数是用来增加网络非线性的关键函数。没有激活函数,无论多少层的神经网络,最终都可以被简化成一个单层线性模型,这将极大限制网络的表达能力。因此,选择和实现适当的激活函数对于构建强大的神经网络至关重要。

常见的激活函数有Sigmoid、Tanh和ReLU等。Sigmoid函数的输出范围是(0, 1),适用于二分类问题。Tanh函数的输出范围是(-1, 1),它的输出均值为0,相比于Sigmoid,它能提供更快速的收敛速度。ReLU函数(Rectified Linear Unit)在正区间内输出输入值本身,在负区间内输出0,由于其计算简单且在实践中效果良好,是当前深度学习中使用最为广泛的激活函数之一。

在反向传播过程中,激活函数的导数对于计算误差梯度至关重要。因为梯度的计算通常涉及到激活函数的导数。例如,Sigmoid和Tanh函数的导数可以通过它们各自的函数形式直接求解。ReLU函数的导数在正区间内为1,在负区间内为0,这使得ReLU在梯度下降时更易于优化。

3.2 反向传播算法的C++实现

3.2.1 算法实现框架

反向传播算法的C++实现可以大致分为以下框架:

- 初始化网络结构与参数。

- 输入数据前向传播,计算每一层的输出。

- 计算损失函数值,并进行反向传播计算梯度。

- 使用梯度下降或其变种算法更新网络参数。

- 重复执行前向传播和反向传播,直至收敛。

下面是实现反向传播算法的一个简化示例代码:

void Backpropagation::train(const Matrix& input, const Matrix& output) {

// 前向传播计算输出层的预测值

Matrix& hidden_layer = hiddenLayers[0];

Matrix& output_layer = hiddenLayers[1];

hidden_layer = activation_function(hidden_layer * weights_hidden_input);

output_layer = activation_function(output_layer * weights_hidden_output);

// 计算输出层的误差

Matrix error = (output - output_layer);

// 反向传播计算误差梯度

Matrix gradient_output = error * derivative ActivationFunction(output_layer);

Matrix gradient_hidden = gradient_output * transpose(weights_hidden_output) * derivative ActivationFunction(hidden_layer);

// 更新权重和偏置

weights_hidden_output += learning_rate * gradient_output * transpose(hidden_layer);

weights_hidden_input += learning_rate * gradient_hidden * transpose(input);

}

3.2.2 关键步骤的代码解析

在上面的代码片段中,首先初始化网络的输入层和隐藏层,并使用激活函数进行计算得到输出层的预测值。接着,计算输出层的实际输出值和预测值之间的误差。然后,根据误差使用链式法则计算梯度,并且在计算过程中需要激活函数的导数。最后,使用计算出的梯度更新权重和偏置。

// 计算激活函数导数

Matrix derivative_activation_function(const Matrix& x) {

// 此处以Sigmoid函数为例

return x * (1 - x);

}

// 更新权重函数

void update_weights(Matrix& weights, const Matrix& delta, const Matrix& inputs, double learning_rate) {

weights += learning_rate * delta * transpose(inputs);

}

在这里, derivative_activation_function 函数计算了给定输入的Sigmoid激活函数的导数。 update_weights 函数则实现了权重的更新机制。请注意,实际实现时要考虑所有层的权重更新,以及偏置项的更新。

3.3 反向传播算法的优化技巧

3.3.1 梯度消失与梯度爆炸问题的应对

在深度神经网络的训练中,经常会出现梯度消失和梯度爆炸的问题。梯度消失是指在反向传播过程中,随着误差向输入层反向传播,梯度变得越来越小,导致权重更新非常缓慢甚至不更新。梯度爆炸则相反,梯度值变得非常大,导致权重更新过大,破坏了网络的稳定性和收敛性。

为了解决这些问题,可以采取以下策略:

- 使用ReLU或者Leaky ReLU作为激活函数,因为它们在正区间内的导数是1,不容易造成梯度消失。

- 采用合适的权重初始化方法,比如He初始化或Xavier初始化,它们可以调整权重的初始尺度,帮助缓解梯度消失或梯度爆炸。

- 使用批归一化(Batch Normalization),在每一层的输出上进行规范化,可以缓解梯度消失问题,并且使学习过程更加稳定。

- 在梯度下降中采用动量(Momentum)方法,或者使用更高级的优化算法如Adam、RMSprop,它们可以更加稳定地更新权重。

3.3.2 正则化与超参数调优

正则化是防止神经网络过拟合的重要手段。它通过对损失函数添加一个额外的项来惩罚网络权重的大小,迫使模型学习更加简洁的表示。常见的正则化方法有L1正则化、L2正则化(权重衰减)和Dropout。

L1正则化倾向于使权重稀疏化,而L2正则化则倾向于限制权重的大小。Dropout通过在训练过程中随机丢弃一些神经元的激活,迫使网络学习到更加鲁棒的特征。

超参数调优涉及到模型训练之前设置好的参数,如学习率、隐藏层神经元的数量、批次大小等。超参数的选择会直接影响到模型的训练效率和性能,因此,合理地调整这些参数至关重要。可以通过网格搜索(Grid Search)、随机搜索(Random Search)或贝叶斯优化(Bayesian Optimization)等方法来寻找最佳的超参数组合。

下面是正则化和超参数调优的伪代码示例:

double regularized_loss(const Matrix& weights, const Matrix& predictions, const Matrix& targets, double lambda) {

// 计算未正则化的损失

double loss = loss_function(predictions, targets);

// 添加L2正则化项

double weight_decay = 0.5 * lambda * norm(weights);

return loss + weight_decay;

}

void optimize_hyperparameters() {

// 使用网格搜索、随机搜索或贝叶斯优化等方法

// 调整学习率、隐藏层数量、批次大小等超参数

}

通过实施这些优化策略,可以有效地提高模型的泛化能力,避免过拟合,并且提高训练效率。

4. 权重和偏置管理

权重和偏置是神经网络中重要的可训练参数,它们决定了输入数据如何通过网络流动,并最终影响模型的输出。合理地管理权重和偏置对于提高模型的性能至关重要。本章将深入探讨权重和偏置的概念、作用、更新策略以及在C++源码中的具体实现方式。

4.1 权重和偏置的概念与作用

4.1.1 理解权重和偏置的重要性

在神经网络中,权重(weights)表示神经元之间的连接强度,而偏置(biases)则用于调整神经元激活的阈值。权重和偏置共同构成了网络的参数,通过训练数据进行调整,使网络能够学习到输入和输出之间的映射关系。

- 权重的重要性

权重决定了输入数据经过网络的加权求和后,输入到神经元的信号大小。在一个充分训练的模型中,权重反映了输入特征的重要性和相关性。例如,对于图像识别问题,权重可以突出显示图像中的关键部分,从而帮助网络进行准确分类。

- 偏置的重要性

偏置对于调整神经元的激活阈值非常关键。即使输入信号为零,偏置也可以确保神经元具有一定的输出。在训练过程中,偏置使得神经元可以更好地适应数据集中的非零均值。

4.1.2 初始化方法的影响

权重和偏置的初始化方法对于神经网络的学习和性能有着显著的影响。不恰当的初始化可能导致训练过程中出现梯度消失或爆炸的问题,从而影响模型的收敛速度和最终性能。

-

常见的权重初始化方法

-

零初始化 :将所有权重设置为零,但这种做法会导致网络中所有神经元学到相同的特征,因为它们的梯度在反向传播时是相同的。

- 随机初始化 :使用小的随机数来初始化权重,比如从均值为0,方差为1的正态分布中采样。这种做法可以打破对称性,使得神经元能够学习到不同的特征。

- Xavier初始化 :根据网络的层数和激活函数的导数分布来调整初始化的方差,有助于保持信号在前向和反向传播时的稳定性。

- He初始化 :是Xavier初始化的变种,特别适用于ReLU激活函数,能够更好地控制方差随着层数加深而增大。

4.2 权重和偏置的更新策略

4.2.1 常见的权重更新方法

权重的更新是通过优化算法来实现的,优化算法根据损失函数的梯度来调整权重,以期望最小化输出误差。

- 梯度下降法(GD)

梯度下降法是最基本的优化算法,通过计算损失函数关于权重的梯度,并按照负梯度方向更新权重,可以实现损失的下降。该方法每次更新权重的幅度是固定的,这可能导致收敛速度慢或陷入局部最小值。

- 随机梯度下降法(SGD)

随机梯度下降法是对基本梯度下降法的改进,它在更新权重时使用了一个小批量的随机样本,而不是全部训练数据。这种方法可以提供更稳定和更频繁的权重更新,减少了收敛时间。

- 动量(Momentum)

动量方法引入了惯性概念,通过加入上一次更新的权重变化(动量项),可以加速SGD并减少震荡,有助于突破梯度下降中的某些问题。

4.2.2 动量与自适应学习率算法

- Adagrad

Adagrad是一种自适应学习率算法,通过为每个参数调整学习率,使得频繁更新的参数学习率下降更快,不经常更新的参数学习率下降较慢。这种策略特别适用于处理稀疏数据。

- RMSprop

RMSprop是对Adagrad的一种改进,它通过调整学习率来防止参数更新过程中出现学习率过小的问题,从而避免训练过程中可能出现的停滞。

- Adam

Adam结合了Momentum和RMSprop的优势,它根据梯度的一阶矩估计(即动量项)和二阶矩估计(即梯度平方的无偏估计)来动态调整每个参数的学习率。Adam已经成为最受欢迎的优化算法之一。

4.3 C++源码中的权重和偏置操作

4.3.1 数据结构的设计

在C++中,权重和偏置通常通过矩阵或张量数据结构来实现。以下是一个简单的示例,展示如何使用C++中标准库向量来表示权重矩阵。

#include <vector>

using WeightMatrix = std::vector<std::vector<float>>;

// 创建一个2x3的权重矩阵

WeightMatrix create_weight_matrix() {

WeightMatrix matrix(2, std::vector<float>(3, 0.0f)); // 初始化所有元素为0.0

// 初始化权重矩阵的代码

return matrix;

}

4.3.2 更新算法的代码实现

更新权重和偏置通常涉及到计算梯度并根据更新规则来调整它们。以下是一个使用SGD更新规则的示例代码。

void update_weights(WeightMatrix& weights, const WeightMatrix& gradients, float learning_rate) {

size_t num_layers = weights.size();

size_t num_weights = weights[0].size();

// 假设gradients已通过反向传播计算

for (size_t i = 0; i < num_layers; ++i) {

for (size_t j = 0; j < num_weights; ++j) {

// 更新每个权重

weights[i][j] -= learning_rate * gradients[i][j];

}

}

}

在实际的应用中,权重更新需要结合动量或自适应学习率算法,这需要更多的逻辑来实现。例如,Adam算法需要维护梯度的一阶矩估计(即梯度的均值)和二阶矩估计(即梯度平方的均值),并根据这些估计来调整每个参数的学习率。

通过本章节的介绍,我们了解了权重和偏置的理论基础,以及如何在C++代码中实现它们的初始化和更新过程。下一章节将深入探讨激活函数与损失函数的实现与应用。

5. 激活函数与损失函数

在神经网络中,激活函数和损失函数的选择直接影响到模型的学习效率和泛化能力。本章将从激活函数和损失函数的基础知识讲起,深入探讨它们在C++中的实现方式以及如何与反向传播算法相结合。

5.1 激活函数的选择与应用

5.1.1 不同激活函数的特点

激活函数是神经网络中非线性部分的体现,它负责为网络引入非线性因素,从而让网络有能力解决复杂问题。常见的激活函数包括Sigmoid、Tanh、ReLU及其变种等。Sigmoid和Tanh函数由于其数学性质,在某些情况下会导致梯度消失问题,而ReLU系列函数因为计算简单和防止梯度消失的特性而被广泛使用。每个激活函数都有其适用的场景,因此,合理选择激活函数是构建有效神经网络的关键之一。

5.1.2 激活函数在C++中的实现

在C++中实现激活函数,通常需要定义一个函数或者函数对象,对输入数据进行非线性转换。下面是一个简单的ReLU激活函数的实现示例:

double ReLU(double x) {

return std::max(0.0, x);

}

这段代码使用了C++标准库中的 std::max 函数来实现ReLU函数。对于批量数据处理,可以利用SIMD指令集进行优化,如使用 _mm_max_pd 等操作来并行处理多个数据。

5.2 损失函数的理论基础

5.2.1 损失函数的作用与分类

损失函数是衡量模型预测值与真实值之间差异的指标,用于训练过程中指导权重参数的更新。常见的损失函数包括均方误差(MSE)、交叉熵损失(Cross-Entropy)、绝对误差损失等。损失函数的选择依赖于具体的任务类型,比如回归问题常用MSE,分类问题则常用交叉熵损失。

5.2.2 常用损失函数的形式与性质

以交叉熵损失函数为例,其形式为:

L = -\sum_{i} y_i \log(p_i) + (1 - y_i) \log(1 - p_i)

其中,$y_i$是真实标签,$p_i$是模型对样本的预测概率。交叉熵损失函数能够度量两个概率分布之间的距离,特别适合于分类问题。

5.3 损失函数的C++源码实现

5.3.1 损失函数的计算方法

实现损失函数时,我们需要编写一个计算损失值的函数。以MSE损失函数为例,它计算所有样本预测值与真实值差值的平方和:

double CalculateMSELoss(const std::vector<double>& predictions, const std::vector<double>& targets) {

double loss = 0.0;

for (size_t i = 0; i < predictions.size(); ++i) {

double diff = predictions[i] - targets[i];

loss += diff * diff;

}

return loss / predictions.size();

}

5.3.2 与反向传播算法的结合

损失函数的核心作用是计算梯度,以便进行反向传播算法中的权重更新。在实际应用中,通常将损失函数与优化器结合使用,形成训练循环。以下是一个简化的反向传播过程:

void BackwardPass(double* weights, double* biases, const std::vector<double>& inputs, const std::vector<double>& targets) {

// Forward pass to compute predictions

std::vector<double> predictions = ...;

// Compute loss

double loss = CalculateMSELoss(predictions, targets);

// Compute gradients for weights and biases

std::vector<double> grad_weights = ...;

std::vector<double> grad_biases = ...;

// Update weights and biases

for (size_t i = 0; i < weights.size(); ++i) {

weights[i] -= learning_rate * grad_weights[i];

biases[i] -= learning_rate * grad_biases[i];

}

}

本章详细介绍了激活函数与损失函数在神经网络中的作用、特点、以及在C++中的实现方法。下一章节将介绍C++在神经网络中的进阶内容,包括高级特性的学习和相关项目与实战经验积累。

6. 学习路径建议

6.1 神经网络学习的起步

学习神经网络并非一蹴而就,需要系统地构建起扎实的理论基础与实践经验。对于初学者而言,选择合适的学习资源与书籍至关重要,同时明确学习路径能帮助你更高效地掌握这一领域知识。

6.1.1 推荐的学习资源与书籍

入门阶段,可以选择一些经典教材和在线课程,例如《深度学习》一书由Ian Goodfellow、Yoshua Bengio和Aaron Courville合著,是深度学习领域内的经典入门书籍。除此之外,《Neural Networks and Deep Learning》在线书免费提供,由Michael Nielsen编写,内容深入浅出。在线课程方面,Andrew Ng的Coursera课程、fast.ai和Udacity的机器学习课程均值得推荐。

6.1.2 基础知识的构建路径

对于神经网络的基础知识构建,可以遵循以下路径: 1. 线性代数与概率论基础 :理解向量、矩阵运算以及概率分布的基础知识。 2. 编程语言学习 :学习Python和C++等语言,掌握基本的编程技巧。 3. 机器学习基础 :了解监督学习、无监督学习、决策树、支持向量机等传统机器学习算法。 4. 深度学习理论 :重点理解前馈神经网络、卷积神经网络、递归神经网络等深度学习模型。 5. 实践操作 :通过实际编写代码,将理论知识转化为实践能力。

6.2 C++在神经网络中的进阶

掌握基础知识后,进阶学习是加深理解与提升技能的重要过程。在神经网络领域,C++主要被应用于性能要求较高的场景。

6.2.1 高级特性的学习

深入学习C++在神经网络中的应用,需要对以下内容有深入了解: - 高级编程技巧 :模板编程、泛型编程、智能指针等高级C++特性。 - 并行计算与优化 :学习如何利用C++进行多线程和并行计算,并理解其对性能的影响。 - 内存管理 :理解C++中的内存管理和资源管理,避免内存泄漏和优化内存使用。

6.2.2 相关项目与实战经验积累

- 开源项目参与 :加入一些知名的深度学习开源项目,如TensorFlow、PyTorch等,参与讨论与贡献代码。

- 实战项目 :亲自构建一些小型的神经网络项目,例如实现一个简单的图像识别系统或者文本分类器。

- 性能优化 :在项目中尝试不同的优化手段,比如使用更高效的矩阵运算库(如BLAS、MKL)等。

6.3 神经网络的前沿研究与发展方向

掌握了一定的理论与实践基础之后,了解并跟进行业前沿研究与技术发展是非常必要的。

6.3.1 当前研究热点

神经网络领域当前的研究热点包括: - 深度强化学习 :结合深度学习与强化学习的方法,被广泛应用于游戏、机器人控制等领域。 - 生成对抗网络(GAN) :GAN以其强大的生成能力,被用于图像合成、风格迁移等。 - 注意力机制与Transformer架构 :在自然语言处理中大放异彩,逐渐成为各类序列建模任务的主流技术。

6.3.2 未来技术趋势预测

对未来的预测: - 边缘计算 :随着物联网的兴起,AI处理将更多地发生在本地设备上,这要求模型更加轻量和高效。 - 自动化机器学习(AutoML) :减少人工干预,实现算法的自动化选择与调参,是未来发展的趋势。 - 跨模态学习 :融合不同模态(如文本、图像、音频等)的信息,实现更全面的理解与预测。

通过掌握以上学习资源、基础知识构建、进阶技巧学习以及跟进最新研究,神经网络学习者可以在此领域不断进阶,成为AI领域的佼佼者。

7. 实践应用示例

在深入学习了神经网络的理论基础,以及在C++中如何实现神经网络的各个组成部分之后,我们来到了实践应用示例这一章节。在这里,我们将通过一个具体的项目案例,来理解如何从零开始构建一个神经网络模型,实现它,并对其进行性能调优和结果分析。这个过程不仅仅是一个技术实现的展示,更是一种综合运用所学知识解决实际问题的能力体现。

7.1 实际问题的神经网络模型构建

7.1.1 问题定义与模型选择

在开始构建模型之前,首先要明确我们想要解决的问题是什么。假设我们的目标是通过神经网络来预测房价。这个问题的输入是房屋的各种特征(如面积、卧室数量、位置等),输出则是预测的房价。

对于这类回归问题,我们可以选择多种不同的神经网络结构。一个简单的多层感知机(MLP)就可以满足我们的需求。在这种情况下,我们会选择一个包含输入层、一个或多个隐藏层,以及一个输出层的网络结构。

7.1.2 数据预处理与特征工程

在构建模型之前,数据的预处理是至关重要的一步。数据预处理包括对数据进行清洗(去除缺失值、异常值处理)、归一化(将数据缩放到统一的尺度)和编码(将非数值特征转换为数值形式)等步骤。

接下来是特征工程,即根据问题的特点选择合适的特征,并对它们进行变换。例如,可能需要对分类数据进行独热编码,对于连续特征可能需要进行多项式特征的生成以捕捉非线性关系。

7.2 C++项目实战:一个简单的神经网络应用

7.2.1 项目需求分析与规划

在实际的项目开发中,需求分析是第一步,必须清楚了解项目的目标和约束条件。根据我们的房价预测问题,项目需要能够接受用户输入的房屋特征,并输出一个预测的价格。

规划项目时,需要决定开发的各个阶段,包括模型设计、编码实现、测试验证等。在编码实现阶段,我们将使用C++语言编写代码,创建神经网络模型,实现数据预处理、模型训练、预测等功能。

7.2.2 代码实现与调试过程

下面是一个简化版的C++代码实现示例,用于创建一个简单的神经网络并进行房价预测。

#include <iostream>

#include <vector>

// 可能还需要包含其他神经网络库和数据处理库

// 定义一个简单的神经网络结构

struct NeuralNetwork {

std::vector<std::vector<float>> weights;

std::vector<float> biases;

// 网络的初始化函数

void initialize(int input_size, int hidden_size, int output_size) {

// 初始化权重和偏置等

}

// 预测函数

float predict(const std::vector<float>& input) {

// 实现前向传播逻辑

}

// 训练函数

void train(const std::vector<std::vector<float>>& inputs,

const std::vector<float>& targets) {

// 实现反向传播逻辑

}

};

int main() {

// 实例化神经网络

NeuralNetwork nn;

nn.initialize(4, 3, 1); // 假设输入特征有4个,隐藏层有3个神经元,输出1个预测值

// 加载训练数据和目标数据

std::vector<std::vector<float>> inputs;

std::vector<float> targets;

// 加载数据过程...

// 训练模型

nn.train(inputs, targets);

// 使用模型进行预测

std::vector<float> test_input = { /* 某个房屋的特征数据 */ };

float predicted_price = nn.predict(test_input);

std::cout << "Predicted house price: " << predicted_price << std::endl;

return 0;

}

在实际开发过程中,调试是必不可少的。你需要使用调试工具逐步跟踪代码执行情况,检查数据流和程序逻辑,确保模型的正确实现。

7.3 性能调优与结果分析

7.3.1 网络性能的评估方法

网络性能通常通过损失函数的值来评估。在回归问题中常用的损失函数有均方误差(MSE)和均方根误差(RMSE)。通过这些损失函数,我们可以了解模型预测的准确度。

7.3.2 调优策略与实际效果评估

在模型训练完成后,需要进行性能调优。调优策略包括但不限于调整学习率、改变网络结构(如层数或每层的神经元数量)、使用正则化技术等。调优的目标是减少损失函数的值,提高模型的预测准确性。

在调整过程中,可以使用交叉验证等方法来评估模型在未知数据上的表现。最终,我们还需要对调优后的模型进行实际效果评估,查看其在实际数据上的表现是否符合预期。

通过对这一实际应用案例的分析,我们能够更好地理解理论知识与实际应用之间的联系,以及在实践中如何运用C++语言实现和优化神经网络模型。这将为我们的学习和工作带来重要的实践经验。

简介:本篇文章详细解析了神经网络的C++源码,涵盖了神经网络基础、C++源码结构、关键概念详解以及学习路径建议。通过该教程,读者能深入了解神经网络的工作原理、反向传播算法以及C++代码的实现细节,为解决分类、回归问题和深度学习探索打下坚实基础。

更多推荐

已为社区贡献175条内容

已为社区贡献175条内容

所有评论(0)