深入探索数据挖掘:五大实验项目

数据挖掘是从大量的、不完全的、有噪声的、模糊的实际数据中,提取隐含在其中的、人们事先不知道的、但又是潜在有用的信息和知识的过程。数据挖掘的技术主要分为分类、预测、聚类分析、关联规则学习和异常检测等几大类。数据挖掘实验的目标是通过各种算法和技术,从大量数据中提取有价值的信息,辅助决策制定。它涉及从数据准备、数据探索、模式发现到解释和评估的整个过程。本章首先介绍数据挖掘实验的基本概念、实验流程和数据挖

简介:本实验项目集深入探讨了数据挖掘领域中的关键技术和应用,包括数据预处理、分类与预测、聚类分析、关联规则学习和异常检测。每个实验涵盖了实验目的、步骤、工具和方法,以及结果分析和结论,旨在帮助学习者通过实际操作掌握数据挖掘的基本流程并提升解决问题的能力。实验中所用到的工具包括R和Python的pandas、scikit-learn库等,为数据挖掘的学习和研究提供了宝贵的实践经验和理论支持。

1. 数据挖掘实验概述

数据挖掘是从大量的、不完全的、有噪声的、模糊的实际数据中,提取隐含在其中的、人们事先不知道的、但又是潜在有用的信息和知识的过程。数据挖掘的技术主要分为分类、预测、聚类分析、关联规则学习和异常检测等几大类。

数据挖掘实验的目标是通过各种算法和技术,从大量数据中提取有价值的信息,辅助决策制定。它涉及从数据准备、数据探索、模式发现到解释和评估的整个过程。

本章首先介绍数据挖掘实验的基本概念、实验流程和数据挖掘在各行业的应用现状,为读者建立起数据挖掘的全局视角。接下来的章节将深入探讨数据预处理与清洗、分类与预测技术、聚类分析方法、关联规则学习、异常检测应用以及数据挖掘工具实践,帮助读者掌握数据挖掘的整个技术框架和实际应用。

2. 数据预处理与清洗

在数据挖掘领域,原始数据的质量直接影响到最终模型的效果。数据预处理与清洗是确保数据质量的关键步骤,它包括了数据的理解、数据清洗、数据转换和数据规约等环节。在这一章节,我们将深入探讨数据预处理的重要性,掌握各种处理策略和技术细节,确保我们能从原始数据中提取出最宝贵的信息。

2.1 数据预处理的重要性与方法

数据预处理是数据挖掘流程中不可或缺的一环。在数据被用于训练预测模型之前,需要通过一系列预处理步骤来确保数据质量。这些步骤包括识别并处理缺失数据,以及识别和处理异常值等。

2.1.1 缺失数据的处理策略

缺失数据是在数据集中常见的问题。它们可能是由于数据收集不完整或数据输入错误造成的。处理缺失数据的方法有很多,比如删除含有缺失值的记录、用均值、中位数或众数填充缺失值,或是采用更复杂的插补方法如多重插补(Multiple Imputation)。

代码块示例:

import pandas as pd

from sklearn.impute import SimpleImputer

# 假设df是包含缺失数据的DataFrame

imputer = SimpleImputer(strategy='mean') # 使用均值填充

df_filled = pd.DataFrame(imputer.fit_transform(df), columns=df.columns)

逻辑分析和参数说明:

SimpleImputer(strategy='mean'):创建一个用于填充缺失值的SimpleImputer对象,这里选择的策略是使用均值填充。fit_transform(df):拟合数据并进行变换,将缺失值替换为每列的均值。- 最终,

df_filled中原始的缺失数据被相应列的均值所替代。

2.1.2 异常值的识别与处理

异常值通常是由于测量或录入错误、数据收集或生成过程中的错误、或者是数据本身所固有的不规则性导致的。识别和处理异常值是数据清洗中不可或缺的部分。我们可以采用统计方法来识别异常值,例如使用Z分数(Z-Score)或箱线图(Boxplot)。

代码块示例:

import numpy as np

import matplotlib.pyplot as plt

# 创建一个数据集

data = np.array([101, 102, 103, 104, 105, 106, 107, 108, 109, 110, 1000])

# 计算均值和标准差

mean = np.mean(data)

std = np.std(data)

# 识别Z分数大于3的异常值

z_scores = [(x - mean) / std for x in data]

outliers = [x for x, z in zip(data, z_scores) if abs(z) > 3]

print(f'异常值: {outliers}')

# 绘制箱线图

plt.boxplot(data)

plt.show()

逻辑分析和参数说明:

- 使用

np.mean和np.std计算数据集的均值和标准差。 - 利用Z分数公式计算出每个数据点的Z分数,并识别Z分数绝对值大于3的数据点为异常值。

- 利用

plt.boxplot函数绘制箱线图,直观展示数据集的分布情况,包括异常值。

2.2 数据清洗的技术细节

数据清洗的目的是确保数据的准确性和一致性,提高数据质量,从而提高数据挖掘的效率和准确性。这里将详细介绍几个关键的数据清洗技术。

2.2.1 数据标准化与归一化

数据标准化和归一化是将数据按比例缩放,使之落入一个小的特定区间。标准化的常用方法是将数据转换为标准正态分布(均值为0,标准差为1),而归一化通常是指将数据缩放到0到1的区间内。

代码块示例:

from sklearn.preprocessing import StandardScaler, MinMaxScaler

# 假设df是需要进行标准化和归一化的DataFrame

# 标准化处理

scaler_standard = StandardScaler()

df_standardized = scaler_standard.fit_transform(df)

# 归一化处理

scaler_minmax = MinMaxScaler()

df_normalized = scaler_minmax.fit_transform(df)

逻辑分析和参数说明:

StandardScaler和MinMaxScaler是scikit-learn库中用于数据标准化和归一化的类。.fit_transform()方法首先拟合数据,计算出需要的参数(如均值和标准差),然后将数据进行转换。df_standardized和df_normalized分别是标准化和归一化后的数据,可用于后续的数据挖掘任务。

2.2.2 数据的离散化与二值化

数据的离散化是将连续特征的值转化为有限个离散特征的过程。二值化是将数据集中的数值型特征转换为二元特征的过程,常用于分类问题中。

代码块示例:

from sklearn.preprocessing import Binarizer

# 假设df有一个连续型特征列'feature_column'

binarizer = Binarizer(threshold=0.5) # 阈值设置为0.5

# 应用二值化

df_binarized = binarizer.fit_transform(df[['feature_column']])

逻辑分析和参数说明:

Binarizer类用于实现二值化,参数threshold设置二值化的阈值。fit_transform方法拟合数据并将数据转换为二元值,大于或等于阈值的为1,小于阈值的为0。

2.2.3 文本数据的清洗技巧

文本数据清洗是将非结构化的文本数据转换为结构化的形式,以便进行进一步的处理和分析。这通常包括去除停用词、标点符号、数字,以及进行词干提取或词形还原等。

代码块示例:

import nltk

from nltk.corpus import stopwords

from nltk.stem import WordNetLemmatizer

nltk.download('punkt')

nltk.download('stopwords')

nltk.download('wordnet')

# 假设corpus是包含文本数据的列表

stop_words = set(stopwords.words('english'))

lemmatizer = WordNetLemmatizer()

# 文本清洗函数

def clean_text(text):

# 将文本分割为单词列表

words = nltk.word_tokenize(text)

# 移除标点和停用词,词干提取

words_clean = [lemmatizer.lemmatize(w.lower()) for w in words if w.isalpha() and w.lower() not in stop_words]

return ' '.join(words_clean)

# 清洗corpus中的每个文本项

corpus_clean = [clean_text(text) for text in corpus]

逻辑分析和参数说明:

- 使用

nltk库中的stopwords和WordNetLemmatizer来进行文本清洗。 clean_text函数首先对文本进行分词,然后移除标点和停用词,最后将每个单词进行词干提取转换为基本形式。corpus_clean是清洗后的文本数据列表,可以直接用于文本分析或进一步的模型训练。

通过本章节的介绍,我们学习到了数据预处理与清洗的基本概念和操作方法。在下一章中,我们将深入探讨分类与预测技术,以及如何构建和优化预测模型。

3. 分类与预测技术

3.1 分类问题的理论基础

分类问题是数据挖掘中重要的任务之一,其目标是通过给定训练数据集,建立一个分类模型,用于对未知数据进行分类。分类器是执行分类任务的算法或模型。

3.1.1 常见分类算法介绍

分类算法多种多样,这里简要介绍几种主流的分类算法:

- K近邻(K-NN)算法 :通过计算待分类样本与已知类别样本之间的距离进行分类,即选择距离最近的K个样本,根据这些样本的多数类来确定待分类样本的类别。

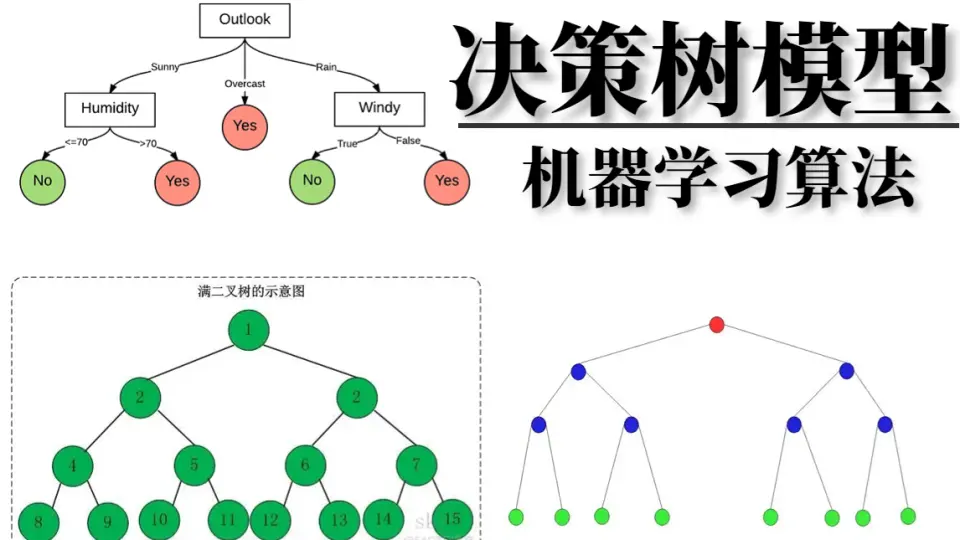

- 决策树分类器 :通过递归地选择最优特征并根据该特征对样本进行分割,构成树结构的分类模型。常用的决策树算法有ID3、C4.5和CART等。

- 支持向量机(SVM) :通过寻找最优的超平面将不同类别的样本分开,旨在最大化不同类别之间的边界。

- 朴素贝叶斯分类器 :基于贝叶斯定理和特征条件独立假设,适用于小规模数据集。

每种算法有其优势和适用场景,选择合适的分类算法通常需要结合具体问题和数据特征。

3.1.2 分类器性能评估指标

分类器的性能评估指标主要包括:

- 准确率(Accuracy) :正确分类的样本数除以总样本数。

- 精确率(Precision) :正确预测为某一类别的样本数除以预测为该类别的样本总数。

- 召回率(Recall) :正确预测为某一类别的样本数除以实际为该类别的样本总数。

- F1分数(F1-Score) :精确率和召回率的调和平均数,是评估模型综合性能的指标。

还有其它指标如ROC曲线和AUC值等,在评估分类器性能时也非常重要,但在此不一一赘述。

3.2 预测模型的构建与优化

预测模型主要用于根据历史数据预测未来趋势或结果,模型的训练和优化是提高预测准确性的关键。

3.2.1 回归分析方法概述

回归分析是研究变量之间依赖关系的统计方法,其目的是通过模型建立一个或多个自变量和因变量之间的关系。常见的回归分析方法有:

- 线性回归 :假设因变量和一个或多个自变量之间存在线性关系,通过最小化误差的平方和来确定最佳的模型参数。

- 逻辑回归 :虽然名为回归,但逻辑回归是一种分类方法,适用于因变量为二分类的情况。它将线性回归的结果通过一个逻辑函数转换为概率值,用以判断类别。

- 多项式回归 :允许回归模型的线性组合中包含自变量的高次项,适用于数据与线性模型拟合不佳的情况。

- 回归树 :是决策树的一种应用,用于解决回归问题。与决策树类似,回归树通过递归地分割特征空间,构建出回归预测模型。

3.2.2 预测模型的训练与验证

预测模型的构建过程通常包括数据准备、特征选择、模型训练、模型验证和模型部署等步骤。在训练模型时,通常需要选择适当的性能指标,并通过交叉验证等方法来避免模型过拟合。

- 特征选择 :根据问题需求和数据特征,选择有助于模型预测的特征,可以提高模型预测的准确性,减少模型的复杂性。

- 模型验证 :使用交叉验证、保留测试集验证等方式,评估模型的泛化能力。

- 模型选择 :基于性能指标选择最优模型,并通过超参数调优进一步提升模型性能。

下面的代码块展示了如何使用Python和scikit-learn库来构建一个简单的线性回归模型,并对模型进行训练和验证。

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

import numpy as np

# 假设 X 和 y 分别是特征数据和目标变量

X = np.array([[1], [2], [3], [4], [5]])

y = np.array([1, 2, 3, 2, 5])

# 将数据集分割为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建线性回归模型实例

model = LinearRegression()

# 训练模型

model.fit(X_train, y_train)

# 预测测试集

y_pred = model.predict(X_test)

# 计算并输出均方误差

mse = mean_squared_error(y_test, y_pred)

print(f'Mean Squared Error: {mse}')

在上述代码中,我们首先导入了必要的库,并创建了数据集。然后我们将数据集分为训练集和测试集,创建了线性回归模型实例,并训练了模型。最后,我们对测试集进行了预测,并计算了均方误差来评估模型的性能。

通过以上的介绍与分析,我们可以看到分类与预测技术在数据挖掘中的重要性以及如何应用于实际问题。在下一节中,我们将深入讨论聚类分析方法及其在数据挖掘中的应用。

4. 聚类分析方法

聚类分析是一种无监督的学习方法,其目的是根据样本间的相似性将数据划分为不同的类别或簇,使得同一簇内的数据对象之间具有较高的相似性,而不同簇之间的数据对象差异较大。聚类分析在许多领域中都有广泛的应用,如市场细分、社交网络分析、图像分割等。

4.1 聚类分析的基本概念

4.1.1 聚类算法的分类

聚类算法可以根据不同的标准进行分类。根据聚类过程是否需要预先指定簇的数量,可以分为划分方法和层次方法。划分方法,如K-means,需要预先指定簇的数量,通过迭代优化得到最佳的聚类结果。层次方法,如AGNES(自底向上)和DIANA(自顶向下),不需要预先指定簇的数量,而是通过构建一个层次的簇树来展现数据的聚类过程。

根据簇的形状,聚类算法可以分为基于原型的方法和基于图的方法。基于原型的方法,如K-means,将簇视为一个中心点的集合,簇内的点到中心的距离最小。基于图的方法,如谱聚类,利用图论的原理来发现数据的内在结构。

4.1.2 距离度量与相似性计算

聚类分析中,距离度量是衡量两个样本相似程度的重要工具。常见的距离度量方法包括欧氏距离、曼哈顿距离、切比雪夫距离、杰卡德相似系数等。每种距离度量方式都有其适用场景,选择合适的方法可以提高聚类结果的质量。

除了距离度量,相似性计算也是聚类分析的一个关键步骤。相似性可以通过余弦相似度、皮尔逊相关系数等方法计算。余弦相似度衡量的是两个样本向量的夹角大小,适用于文本数据的聚类分析。

4.2 高级聚类技术应用

4.2.1 密度聚类与层次聚类

密度聚类算法,如DBSCAN和OPTICS,依据数据点的密度分布进行聚类。与传统的划分方法相比,密度聚类不仅可以发现任意形状的簇,而且对噪声数据有很强的鲁棒性。

层次聚类通过构建一个嵌套的簇树来展现数据的聚类过程,可以是自底向上的凝聚方法,也可以是自顶向下的分裂方法。层次聚类能够得到一系列的聚类结果,方便用户根据不同的需求选择合适的簇划分。

4.2.2 聚类结果的评价方法

聚类结果的有效性评价是一个复杂的问题。评价指标通常分为外部指标、内部指标和相对指标。外部指标如RI(Rand Index)和ARI(Adjusted Rand Index),需要与真实标签进行对比。内部指标如轮廓系数(Silhouette Coefficient)和Davies-Bouldin Index,不需要真实标签,而是根据簇内和簇间的距离来评价聚类效果。

from sklearn.metrics import silhouette_score

# 示例:使用轮廓系数评价聚类效果

# 假设 clustering_result 是聚类结果,X 是数据集

score = silhouette_score(X, clustering_result)

print(f"轮廓系数: {score}")

在上述Python代码中,我们使用了 sklearn.metrics 库中的 silhouette_score 函数来计算数据集 X 的轮廓系数。轮廓系数越接近1,说明聚类效果越好。

聚类分析是一个复杂的过程,需要对算法有深入的理解,并根据实际的数据特征和业务需求选择合适的算法和评价方法。通过实际案例的分析和模型的部署,我们可以进一步掌握聚类技术的应用,从而在数据分析和知识发现中取得更好的效果。

5. 关联规则学习

5.1 关联规则挖掘原理

5.1.1 支持度、置信度与提升度

关联规则挖掘是数据挖掘领域的一项核心任务,旨在发现大量数据中项之间的有趣关系,这些关系被称为关联规则。在频繁项集挖掘的基础上,关联规则挖掘通过评估特定指标来提取有意义的模式。

-

支持度(Support) : 一个项集的支持度是指在所有交易中该项集出现的频率。它是一个重要的指标,用于衡量一个规则在数据集中出现的频繁程度。在算法中,我们可以设置一个最小支持度阈值,仅考虑那些支持度不低于此阈值的项集。

-

置信度(Confidence) : 置信度是一个条件概率,表示在前项出现的情况下,后项出现的条件概率。它用于衡量规则的强度或可靠性。与支持度类似,我们也可以为置信度设定一个最小阈值。

-

提升度(Lift) : 提升度是评估关联规则的有趣程度的一个指标。如果提升度大于1,意味着项集A和项集B是正相关;如果等于1,则两者无关;如果小于1,则两者是负相关。提升度可以排除那些由于项集本身出现频繁而产生的偶然相关性。

这三个指标是相互关联的,支持度较高的项集更容易得到高置信度的规则,而提升度则用于识别那些真正有意义的规则。在实际应用中,合理的阈值设定对提取高质量的关联规则至关重要。

# 示例代码:计算项集的支持度和置信度

from mlxtend.frequent_patterns import apriori, association_rules

from mlxtend.preprocessing import TransactionEncoder

import pandas as pd

# 假设我们有以下交易数据

dataset = [['牛奶', '面包', '尿布'],

['可乐', '面包', '尿布', '啤酒'],

['牛奶', '尿布', '啤酒', '鸡蛋'],

['面包', '牛奶', '尿布', '啤酒'],

['面包', '牛奶', '尿布', '可乐']]

te = TransactionEncoder()

te_ary = te.fit(dataset).transform(dataset)

df = pd.DataFrame(te_ary, columns=te.columns_)

# 应用Apriori算法找出频繁项集

frequent_itemsets = apriori(df, min_support=0.6, use_colnames=True)

# 生成关联规则

rules = association_rules(frequent_itemsets, metric="confidence", min_threshold=0.7)

# 输出支持度和置信度

print(rules[['support', 'confidence']])

在这个代码示例中,我们使用了 mlxtend 库来演示如何计算项集的支持度和置信度。我们首先创建了一个交易数据集,然后使用 TransactionEncoder 将其转换为适合关联规则挖掘的格式,接着使用 apriori 算法来生成频繁项集,最后应用 association_rules 函数来得到关联规则及其支持度和置信度。

5.1.2 规则生成与剪枝策略

规则生成是从频繁项集中提取出有用的关联规则的过程。当频繁项集被找出后,下一步是从这些项集中产生规则,这些规则需要满足用户定义的最小支持度和置信度阈值。生成规则时需要注意以下几点:

- 规则生成算法 : 这是生成关联规则的过程。对于频繁项集中的每一个项集,算法会生成所有可能的规则,然后根据最小支持度和置信度来筛选。

- 剪枝策略 : 生成的规则中可能有很多是冗余的或不感兴趣的。剪枝策略帮助我们去除那些不重要或不相关的规则。常用的剪枝方法包括基于置信度和提升度的剪枝,以及利用统计检验方法来评估规则的显著性。

关联规则挖掘的剪枝步骤对于过滤掉无用或低质量的规则至关重要。它不仅能够提高数据挖掘的效率,还能提升分析结果的质量和解释性。

5.2 应用实例与算法优化

5.2.1 频繁项集挖掘算法

在关联规则挖掘中,频繁项集挖掘是核心步骤之一。一个项集如果满足最小支持度阈值,那么它就被认为是频繁的。最著名的频繁项集挖掘算法是Apriori算法,此外还有FP-Growth算法等。

-

Apriori算法 : Apriori算法采用迭代方法,逐层搜索频繁项集。它利用了频繁项集的先验知识,即一个项集是频繁的,那么它的所有非空子集也必定是频繁的。通过连接和剪枝两个步骤,Apriori算法逐步构建出所有频繁项集。

-

FP-Growth算法 : FP-Growth算法通过使用一个称为FP树(Frequent Pattern Tree)的数据结构来压缩数据集,并递归地挖掘频繁项集。它不需要生成候选集,因此相较于Apriori算法具有更高的效率。

5.2.2 关联规则的应用场景与实践

关联规则被广泛应用于市场篮分析、库存管理、推荐系统等多个领域。在市场篮分析中,零售商可以通过关联规则了解哪些商品经常被一起购买,从而调整商品摆放策略,实施交叉销售和捆绑销售。

在实践关联规则挖掘时,需要根据应用场景选择合适的算法,并对结果进行分析和解释。例如,如果数据集非常大,FP-Growth算法可能是更合适的选择;如果数据集相对较小,Apriori算法可能会更简单易行。

graph TD

A[开始] --> B[数据准备]

B --> C[选择算法]

C --> D[Apriori]

C --> E[FP-Growth]

D --> F[生成频繁项集]

E --> G[生成频繁项集]

F --> H[生成关联规则]

G --> H

H --> I[规则评估]

I --> J[剪枝]

J --> K[分析结果]

K --> L[应用优化]

L --> M[结束]

此mermaid格式流程图描述了关联规则挖掘的一般过程,从开始到结束的步骤中涉及到算法的选择、频繁项集的生成、关联规则的产生、规则评估和优化的流程。

在应用关联规则时,应关注最终的目标,并通过不断的实验与优化来提升规则的质量。同时,要考虑挖掘结果的可解释性,确保关联规则能够被业务人员理解和使用。

在关联规则挖掘的实践中,需要注意数据的质量和算法参数的选择。数据预处理是保证关联规则挖掘质量的重要步骤,而算法参数的合理设置则能够帮助挖掘到高质量的规则。此外,从挖掘结果中筛选出真正有用的规则,需要结合业务知识和数据挖掘的专业技能,以实现数据驱动的决策支持。

6. 异常检测应用

异常检测是数据挖掘中的一个重要领域,主要用于识别数据中的异常或不规则模式,这些模式可能表明潜在的问题、罕见事件或非标准情况。异常检测方法广泛应用于网络安全、欺诈检测、医疗诊断、公共安全等多个领域。

6.1 异常检测的基本理论

6.1.1 异常点的定义与特征

异常点指的是那些与数据集中的其他数据显著不同的数据点。这些数据点的统计特性或者行为模式与数据集的主流趋势不一致。异常点的特征通常与正常数据的特征有很大的不同,例如在信用卡交易数据中,一笔远高于用户平均消费额的交易可能是异常点。

6.1.2 基于统计的异常检测方法

统计学方法依赖于数据点的统计特性。比如,一种简单的方法是使用数据的均值和标准差来确定异常点。通常,数据点如果超出均值加减三个标准差的范围,则被认为是异常的。基于统计的方法假定数据遵循特定的分布(如正态分布)。

6.2 异常检测算法实战

6.2.1 机器学习方法在异常检测中的应用

机器学习方法通过训练模型来识别数据中的异常模式。这些方法通常需要有标记的训练数据集,其中包含正常和异常的数据点。一些常见的算法包括:

- 一种使用随机森林的异常检测方法是,通过训练一组决策树来学习正常数据的分布,然后在实际数据上评估其得分,低得分为异常。

- 支持向量机(SVM)也可以用于异常检测,通过寻找能够最大化正常数据与异常数据之间的间隔的超平面来实现。

6.2.2 实际案例分析与模型部署

在实际案例中,异常检测模型通常需要在真实的数据集上进行训练和测试。以信用卡欺诈检测为例,模型需要学习用户日常的消费行为模式,然后在实时交易数据上运行以发现潜在的欺诈行为。

案例实施步骤:

- 数据收集:收集一段时间内的信用卡交易数据。

- 数据预处理:处理缺失值,剔除无效记录,进行特征工程。

- 模型选择:选择合适的机器学习模型,如随机森林或SVM。

- 训练模型:使用标记的数据训练模型。

- 测试与验证:用未标记的数据测试模型的性能。

- 部署模型:将模型部署到生产环境,实时监控新的交易数据。

异常检测是一个持续的过程,需要不断地更新模型以适应新的数据模式。在模型部署之后,还需要定期评估其准确性,以确保异常检测系统的有效性和可靠性。

代码示例(Python):

from sklearn.ensemble import IsolationForest

# 假设 X_train 是训练数据集

# 训练模型

clf = IsolationForest(n_estimators=100, contamination=0.01)

clf.fit(X_train)

# 使用模型进行异常值预测

predictions = clf.predict(X_test)

# predictions 中的 -1 表示异常点,1 表示正常点

在上述代码中,我们使用了 IsolationForest 类来训练一个异常检测模型,并使用它来对测试数据集 X_test 进行异常值的预测。

通过本文的介绍,我们了解了异常检测的基本理论和实战方法,并通过案例展示了如何使用机器学习方法进行异常点的检测。异常检测技术对于维护系统安全、提高数据质量具有重要意义。

简介:本实验项目集深入探讨了数据挖掘领域中的关键技术和应用,包括数据预处理、分类与预测、聚类分析、关联规则学习和异常检测。每个实验涵盖了实验目的、步骤、工具和方法,以及结果分析和结论,旨在帮助学习者通过实际操作掌握数据挖掘的基本流程并提升解决问题的能力。实验中所用到的工具包括R和Python的pandas、scikit-learn库等,为数据挖掘的学习和研究提供了宝贵的实践经验和理论支持。

更多推荐

已为社区贡献173条内容

已为社区贡献173条内容

所有评论(0)