【论文解读】RAGEN: 基于多轮强化学习的LLM智能体自进化理解

RAGEN这篇论文为理解和训练**多轮交互LLM智能体**提供了一个立足点。它深入剖析了这一现有**RL算法**范式下的**核心挑战**——**训练不稳定性**,并提出了一个**以数据为中心**的有效解决方案。

1st author: Zihan Wang’s Homepage 王子涵

paper: [2504.20073] RAGEN: Understanding Self-Evolution in LLM Agents via Multi-Turn Reinforcement Learning

5. 总结 (结果先行)

RAGEN这篇论文为理解和训练多轮交互LLM智能体提供了一个立足点。它深入剖析了这一现有RL算法范式下的核心挑战——训练不稳定性,并提出了一个以数据为中心的有效解决方案。

这项工作最核心的贡献在于,它清晰地揭示了 “结果导向”奖励的局限性。StarPO框架虽然将优化单元从“单步”扩展到了“轨迹”,但其奖励 R ( τ ) R(\tau) R(τ) 依然是基于最终结果的。实验中“推理消退”的现象证明,仅有结果正确是不够的。智能体训练的真正难点在于信誉分配(Credit Assignment):在一条漫长的轨迹中,究竟是哪一步思考、哪一个决策真正促成了最终的成功?

因此,这项工作也为未来指明了方向。下一步的研究必须深入到过程监督(Process Supervision)中。我们需要开发能够评估智能体“思考”过程质量的奖励模型,而不仅仅是评估其行动结果。这可能需要更细粒度的人类标注,或者发展出新的、能够自我评估推理逻辑一致性的无监督方法。

1. 思想

大型语言模型(LLM)作为交互式智能体(Agent),其核心挑战在于如何在与环境的持续互动中自我改进。这不同于单次问答或代码生成,智能体学习是一个多轮(multi-turn)、长时序(long-horizon) 且常常伴随随机反馈(stochastic feedback) 的决策过程。

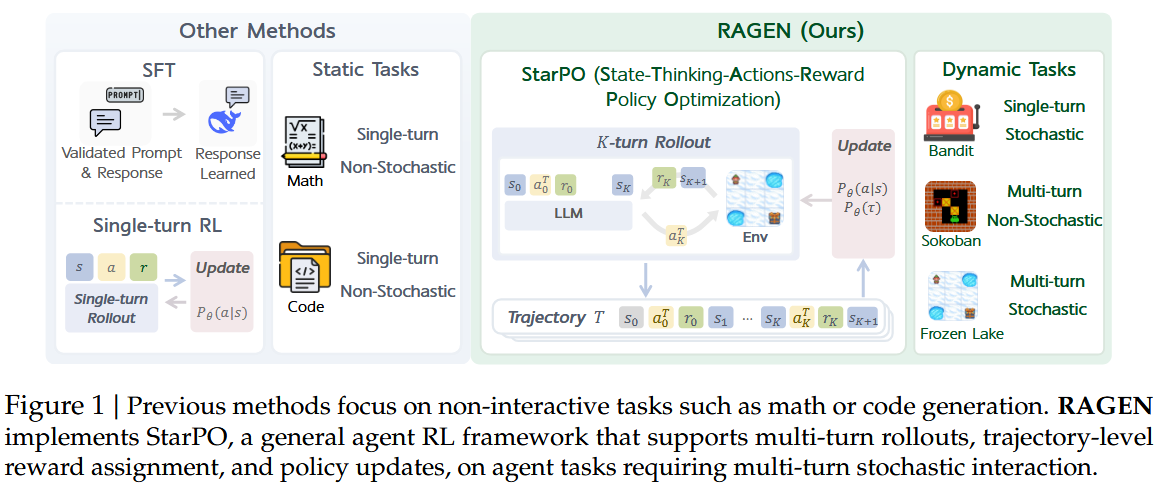

当前主流的RLHF(Reinforcement Learning from Human Feedback)或DPO(Direct Preference Optimization)主要优化单轮对话的偏好(Figure 1) ,而对于需要进行规划、试错和适应的智能体任务,这些方法显得力不从心。这引出了几个根本性问题:

- 稳定性问题:在多轮交互中,模型极易陷入一种名为“回声陷阱(Echo Trap)”的失败模式。即模型会过度拟合到自身生成的、在局部看起来不错的“思考-行动”模板上,导致多样性锐减、性能最终崩溃。我们如何识别并规避这种自我强化的陷阱?

- 数据质量问题:强化学习的训练数据来自于模型的自我探索(rollout)。什么样的探索轨迹对于学习是最高效的?是成功的轨迹,失败的轨迹,还是那些结果不确定的轨迹?我们应如何设计探索策略来生成高质量的训练数据?

- 推理与奖励的对齐问题:我们期望智能体不仅能完成任务,还能进行有效的“思考”。但如果奖励信号只与最终任务成功与否挂钩,模型会学会走捷径,其“思考”过程可能变得肤浅甚至产生幻觉。如何设计奖励机制,才能真正激励并塑造有价值的推理能力?

论文的核心思想是:将智能体的多轮交互过程整体建模为一个轨迹优化问题,并通过系统性的实验和分析,诊断出多轮RL中的关键不稳定性来源,最终提出一套以数据为中心的稳定化框架。

2. 方法

作者将智能体学习过程形式化为一个马尔可夫决策过程(Markov Decision Process, MDP),其中 M = ( S , A , P ) M = (S, A, P) M=(S,A,P)。

- S S S (States): 状态空间,通常是包含历史观测和交互的文本序列。

- A A A (Actions): 动作空间,是模型生成的包含推理(thinking)和可执行指令(action)的token序列。

- P P P (Transition & Reward): 环境的动态,根据当前状态 s t s_t st 和动作 a t a_t at 给出下一状态 s t + 1 s_{t+1} st+1 和奖励 r t r_t rt。

智能体的策略 π θ \pi_{\theta} πθ 在每个时间步 t t t 生成一个动作 a t ∼ π θ ( ⋅ ∣ s t , τ < t ) a_t \sim \pi_{\theta}(\cdot|s_t, \tau_{<t}) at∼πθ(⋅∣st,τ<t),其中 τ < t \tau_{<t} τ<t 代表到 t t t 为止的交互历史。一次完整的交互产生一条轨迹 τ = { s 0 , a 0 , r 0 , . . . , s K } \tau = \{s_0, a_0, r_0, ..., s_K\} τ={s0,a0,r0,...,sK}。

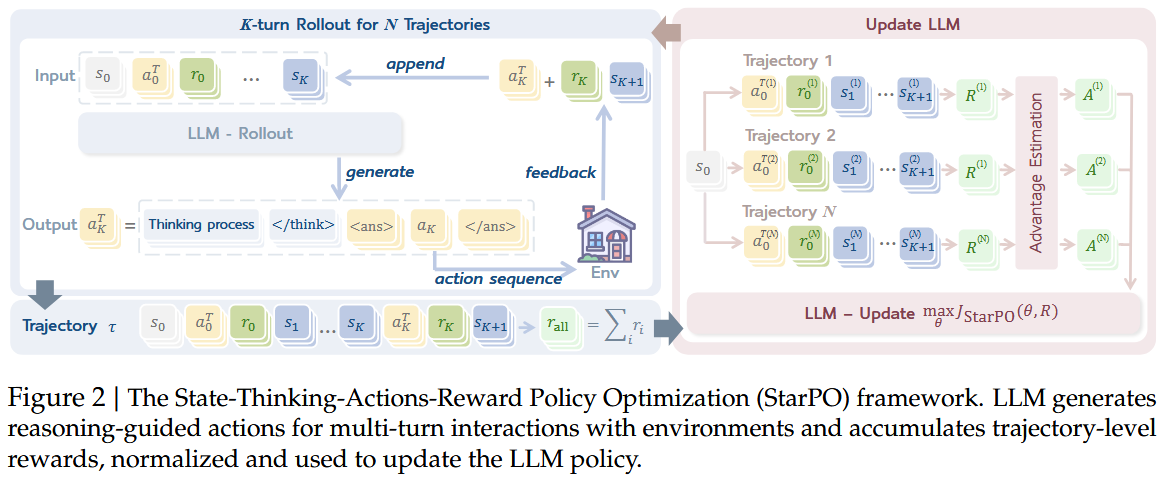

2.1 StarPO 框架:面向轨迹的策略优化

与传统RL方法优化单步响应 R ( s , a ) R(s, a) R(s,a) 不同,StarPO (State-Thinking-Actions-Reward Policy Optimization) 框架的核心是将整个轨迹 τ \tau τ 视为一个不可分割的优化单元,其目标函数是最大化整条轨迹的期望累积奖励 R ( τ ) R(\tau) R(τ):

J S t a r P O ( θ ) = E τ ∼ π θ [ R ( τ ) ] J s t e p ( θ ) = E x ∼ D , y ∼ π θ ( ⋅ ∣ x ) [ R ( x , y ) ] J_{StarPO}(\theta) = \mathbb{E}_{\tau \sim \pi_{\theta}} [R(\tau)]\\ \textcolor{red}{J_{\mathrm{step}}(\theta)=\mathbb{E}_{x\sim\mathcal{D},y\sim\pi_\theta(\cdot|x)}\left[R(x,y)\right]} JStarPO(θ)=Eτ∼πθ[R(τ)]Jstep(θ)=Ex∼D,y∼πθ(⋅∣x)[R(x,y)]

这里的 R ( τ ) = ∑ t = 0 K γ t r t R(\tau) = \sum_{t=0}^{K} \gamma^t r_t R(τ)=∑t=0Kγtrt 是轨迹的总回报。由于LLM是自回归模型,轨迹的概率 π θ ( τ ) \pi_{\theta}(\tau) πθ(τ) 可以自然地分解为一系列条件token概率的乘积,这使得StarPO可以直接应用梯度策略优化算法,如PPO或其变体。

红色公式是给定输入 x x x 优化单轮输出 y y y 的对比。

2.2 StarPO-S:稳定化的StarPO

为了解决 “回声陷阱” 问题,作者提出了StarPO的稳定变体StarPO-S,其核心是三项改进:

-

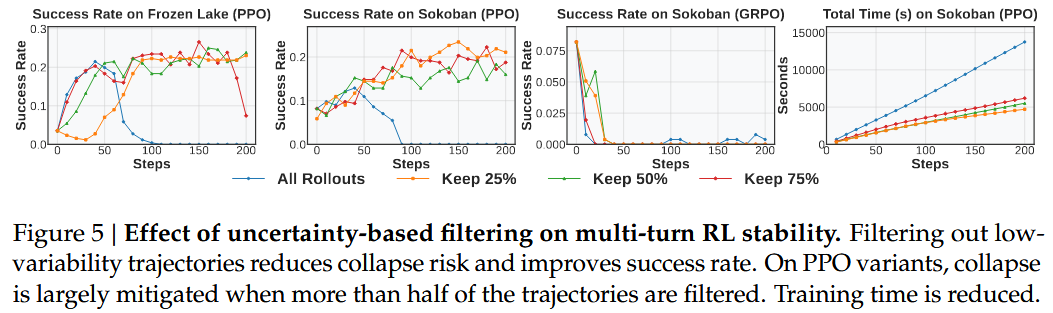

基于不确定性的轨迹过滤(Uncertainty-based Trajectory Filtering)

这个想法非常直观,源于主动学习(Active Learning)。对于同一个初始任务,如果模型多次尝试后得到的奖励差异很大,说明模型对这个任务的策略还很不确定,这恰恰是信息量最大的训练样本。

具体操作是:- 计算 每个初始状态 s 0 s_0 s0 下,通过策略 π θ \pi_{\theta} πθ 生成的多条轨迹的奖励标准差 (standard deviation),将其作为该任务实例的不确定性度量 U ( π θ , M , s 0 ) = Std τ ∼ π θ ( ⋅ ∣ s 0 ) [ R ( τ ) ] U(\pi_{\theta}, M, s_0) = \text{Std}_{\tau \sim \pi_{\theta}(\cdot|s_0)}[R(\tau)] U(πθ,M,s0)=Stdτ∼πθ(⋅∣s0)[R(τ)]。

- 在每个训练批次中,只保留不确定性最高(即奖励标准差最大)的 top-p% 的任务实例所对应的轨迹进行梯度更新。

- 这样可以过滤掉模型已经掌握的(奖励稳定且高)或完全无法解决的(奖励稳定且低)低信息量样本,从而提高训练效率和稳定性。

-

评论家(Critic)与基线(Baseline)

在PPO算法中,引入一个价值网络(Critic)来估计状态的价值 V ( s ) V(s) V(s),并计算优势函数(Advantage) A t A_t At,可以显著降低梯度的方差。相比于GRPO等无评论家方法直接使用标量轨迹回报 R ( τ ) R(\tau) R(τ) 作为所有时间步的优势信号,PPO提供的时序差分(TD-error)基线能为每个时间步的决策提供更精细、更稳定的学习信号。 -

梯度稳定化(Gradient Stabilization)

作者借鉴了近期研究,采用了两种梯度塑造技巧:- 移除KL散度惩罚项:在PPO的传统目标函数中,通常有一个KL散度项来约束新旧策略的差异。移除它可以给予模型更大的探索自由度。

- 非对称裁剪(Asymmetric Clipping):在PPO的裁剪目标中,对优势为正(好轨迹)和优势为负(坏轨迹)的更新采用不同的裁剪范围。具体来说,放宽对好轨迹的更新上限(

clip_high > 0.2),允许模型从高奖励的探索中进行更大幅度的学习。

3. 优势

- 聚焦并处理了多轮RL的核心困难:它不仅仅是简单地将PPO等算法应用到新任务上,而是首次系统性地识别、命名(“Echo Trap”)并量化了智能体自学习过程中的一种关键失败模式。

- 提出了以数据为中心的稳定化方案:StarPO-S的观点——基于不确定性的轨迹过滤,是一种数据策展(Data Curation) 的思路。它强调了在 RL“内循环” 中动态筛选高质量训练数据的重要性,而不仅仅是依赖于优化算法本身。

- 构建了模块化的研究平台(RAGEN系统):通过在四个难度和特性各异的环境(从纯符号到开放域)中进行受控实验,该工作为领域内研究者提供了一套分析和复现问题的基准和工具。

4. 实验

实验设置在四个环境中进行:Bandit(单轮、随机)、Sokoban(多轮、确定性、长规划)、FrozenLake(多轮、随机)和 WebShop(多轮、开放域)。

实验得出了几个极具价值的结论:

-

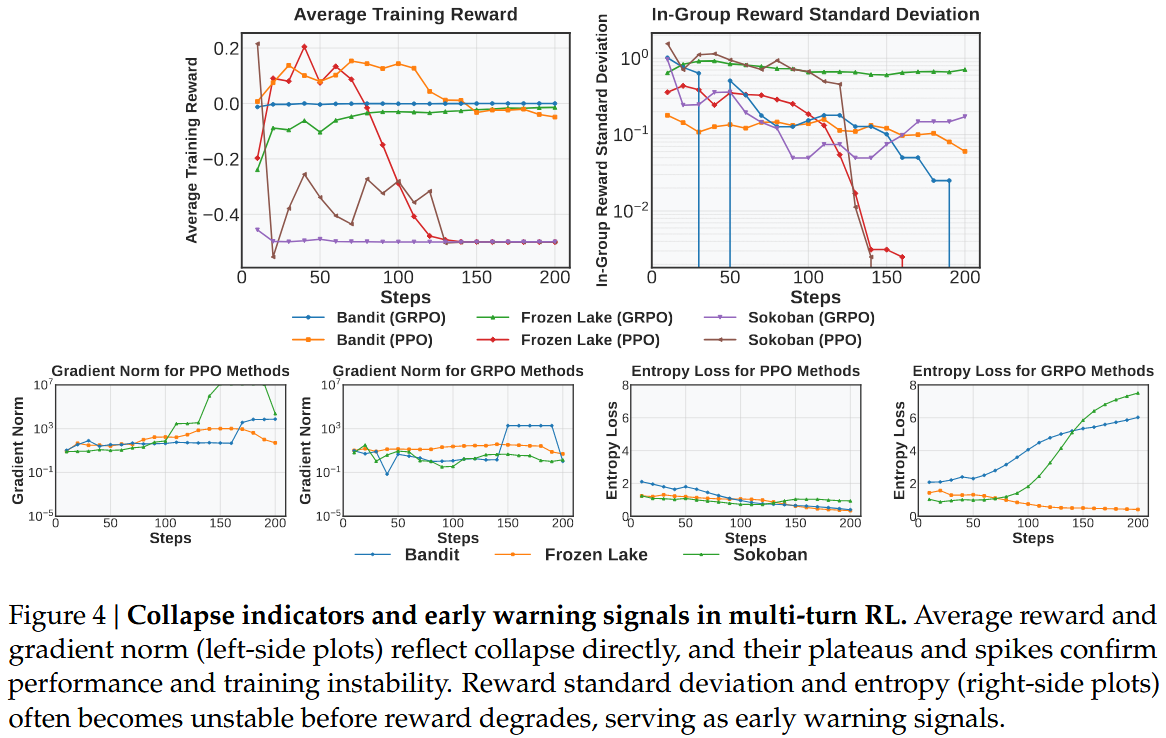

“回声陷阱”的量化指标:实验数据表明(Figure 4),在模型性能崩溃前,可以观测到明确的预警信号。奖励标准差的急剧下降是探索停滞的先行指标,而梯度范数的剧烈尖峰则标志着模型已进入不可逆的崩溃阶段。 这些指标为训练监控提供了有效的诊断工具。

可以把 “回声陷阱” 想象成学生备考时只背解题模板,初期样题得分高便不再探索其他解法,最终因题目变化而失败的现象。智能体的“回声陷阱”也类似,可通过监控两层信号检测:早期预警信号(如只背模板)和直接崩溃指标(如考试考砸)。

早期预警信号:反映模型行为多样性丧失

1. 奖励标准差

- 定义:同一任务让智能体独立尝试N次,计算奖励值的标准差。

- 危险信号:训练中途标准差急剧下降至趋近于零。

- 解读:模型对同一任务的输出完全一致,停止探索,陷入固定行为模式。

2. 输出熵

- 定义:衡量模型生成下一个token时的不确定性。

- 危险信号:熵过早急剧下降或剧烈波动。

- 解读:模型不再考虑多种可能性,策略僵化如“机械背模板”。

直接崩溃指标

1. 平均奖励

- 定义:验证集上的任务成功率或平均得分。

- 危险信号:达到峰值后突然急剧下跌。

- 解读:固化策略因缺乏泛化能力失效,导致性能崩溃。

2. 梯度范数

- 定义:反向传播中策略梯度向量的L2范数。

- 危险信号:出现孤立的极大尖峰。

- 解读:模型过拟合严重,训练失控,梯度更新异常导致不可恢复的崩溃。

总结:诊断指标对比表

指标类型 指标名称 危险信号 诊断解读 早期预警 奖励标准差 急剧下降并趋近于零 行为多样性崩溃,停止探索 早期预警 输出熵 急剧下降或剧烈波动 策略僵化,不再考虑可能性 直接崩溃 平均奖励 峰值后急剧下跌 固化策略失效,性能崩溃 直接崩溃 梯度范数 出现巨大尖峰 训练失控,过拟合至不可恢复 -

StarPO-S的有效性:在Sokoban和FrozenLake等容易崩溃的环境中,StarPO-S通过轨迹过滤显著延迟甚至避免了崩溃,并取得了更高的最终性能 (Figure 5)。

-

高质量Rollout的设计原则:实验揭示了决定训练数据质量的三个关键因素:

- 任务多样性与响应对比:在固定批次大小下,使用更多样的初始任务、每个任务产生较少(但多于1)的响应轨迹,其泛化效果最好。这使得模型能对比不同策略在相似情境下的优劣。

- 适中的交互粒度:每轮允许 5-6个原子动作 的预算在复杂任务中表现最佳。太短则无法进行有效规划,太长则会引入过多噪声和无效探索。

- 高频的在线数据:每次策略更新都使用最新策略生成的Rollout数据(Online-1),比重复使用旧数据进行多次更新效果好得多。

-

推理能力的消退:一个发人深省的发现。即使在prompt中明确要求模型输出

<think>部分,如果没有细粒度的、与推理过程质量直接相关的奖励信号,仅仅依靠最终任务成败作为奖励,模型的推理链会随着训练的进行而逐渐退化、缩短。模型会找到绕过复杂推理的“捷径”,最终只输出最短的、能触发正确动作的模板化“思考”。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)