鸿蒙音视频通信也能打高端局?低延迟优化你真的懂了吗?

你那边卡了吗?”、“咋声音延迟这么大?”、“你这画面和嘴不对啊……”——如果你曾经视频通话时发出过这样的灵魂三问,那你就已经踩到了音视频通信中“延迟”这颗雷了。而现在,鸿蒙OS正走向全场景、全设备生态的高质量通信体验时代,低延迟音视频通信优化,已经成了它迈向更高端交互体验的必经之路。鸿蒙OS的音视频通信优化路径不是“猛堆配置”,而是通过一整套跨层次协同机制来达成:从底层采集到网络传输,从实时编码到

👋 你好,欢迎来到我的博客!我是【菜鸟不学编程】

我是一个正在奋斗中的职场码农,步入职场多年,正在从“小码农”慢慢成长为有深度、有思考的技术人。在这条不断进阶的路上,我决定记录下自己的学习与成长过程,也希望通过博客结识更多志同道合的朋友。

🛠️ 主要方向包括 Java 基础、Spring 全家桶、数据库优化、项目实战等,也会分享一些踩坑经历与面试复盘,希望能为还在迷茫中的你提供一些参考。

💡 我相信:写作是一种思考的过程,分享是一种进步的方式。

如果你和我一样热爱技术、热爱成长,欢迎关注我,一起交流进步!

全文目录:

前言

“你那边卡了吗?”、“咋声音延迟这么大?”、“你这画面和嘴不对啊……”——如果你曾经视频通话时发出过这样的灵魂三问,那你就已经踩到了音视频通信中“延迟”这颗雷了。

而现在,鸿蒙OS正走向全场景、全设备生态的高质量通信体验时代,低延迟音视频通信优化,已经成了它迈向更高端交互体验的必经之路。

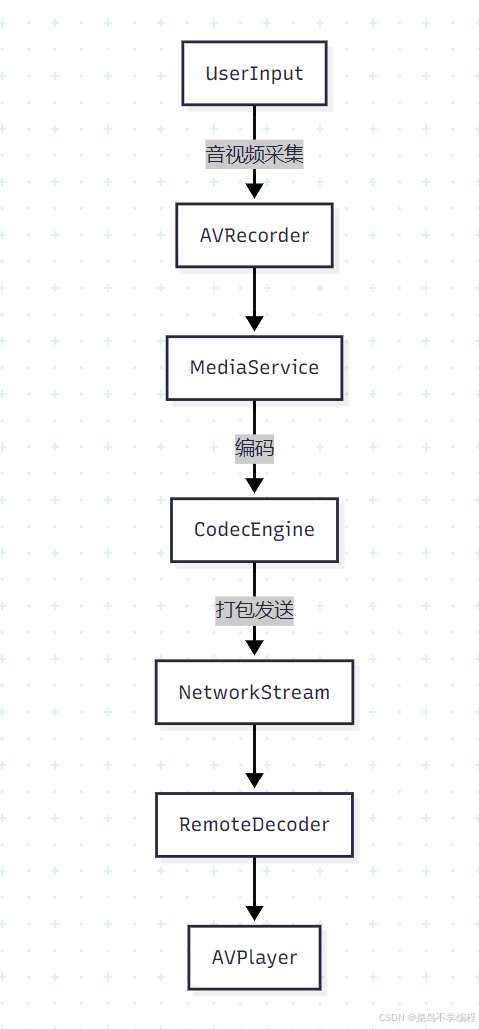

🎬 一、鸿蒙OS音视频通信的基本盘都有哪些?

鸿蒙OS不是一套传统意义上的操作系统,它的“分布式架构”让音视频通信不再局限于某一个设备。鸿蒙提供了一个完整的多媒体框架:

- AVPlayer & AVRecorder:本地播放与录制能力;

- MediaService:服务化的统一媒体资源管理中枢;

- AudioRenderer & VideoDecoder:底层驱动支持;

- HiStream & HiMedia:多设备间媒体共享与流转;

这套架构天然支持低功耗、高实时响应,并可通过分布式调用远程摄像头、麦克风、扬声器资源。

🔥 二、低延迟通信的“魔鬼细节”都藏在哪里?

低延迟音视频通信,说到底就是一句话:减少从“你张嘴”到“我听见”的时间差。

但在实际链路中,涉及多个阶段:

- 采集延迟:从摄像头/麦克风采集到缓存;

- 编码延迟:原始音视频压缩处理时间;

- 网络延迟:数据包在网络中传输所耗时间;

- 解码渲染延迟:接收端解码及播放渲染耗时;

而鸿蒙的多设备通信又叠加了“分布式调用延迟”、“跨终端同步延迟”这些新挑战。

🎯 三、音视频流优化核心在哪?

🧪 编码压缩算法升级

鸿蒙OS通过集成 HEVC(H.265)、AAC-LC、Opus 等编解码器,配合软硬件加速机制,减少每一帧音视频在编码解码过程中的阻塞时间。

- H.265 + 硬编加速:平均降低 30~40% 帧处理耗时;

- Opus自适应码率:动态调整音频比特率,兼顾延迟与清晰度;

🧵 AVSync:同步管理机制

音视频同步 AVSync 机制是鸿蒙多媒体服务中的“调度中枢”,确保画面和声音的毫秒级对齐。

class AVSyncManager:

def __init__(self):

self.audio_ts = 0

self.video_ts = 0

def sync(self):

if abs(self.audio_ts - self.video_ts) > threshold:

delay = self.audio_ts - self.video_ts

# 调整播放时间戳

📶 自适应网络策略

- FEC 前向纠错技术:丢包时用冗余恢复数据;

- Jitter Buffer 优化:处理突发网络抖动;

- UDP Hole Punching:穿透NAT提升P2P通信速率;

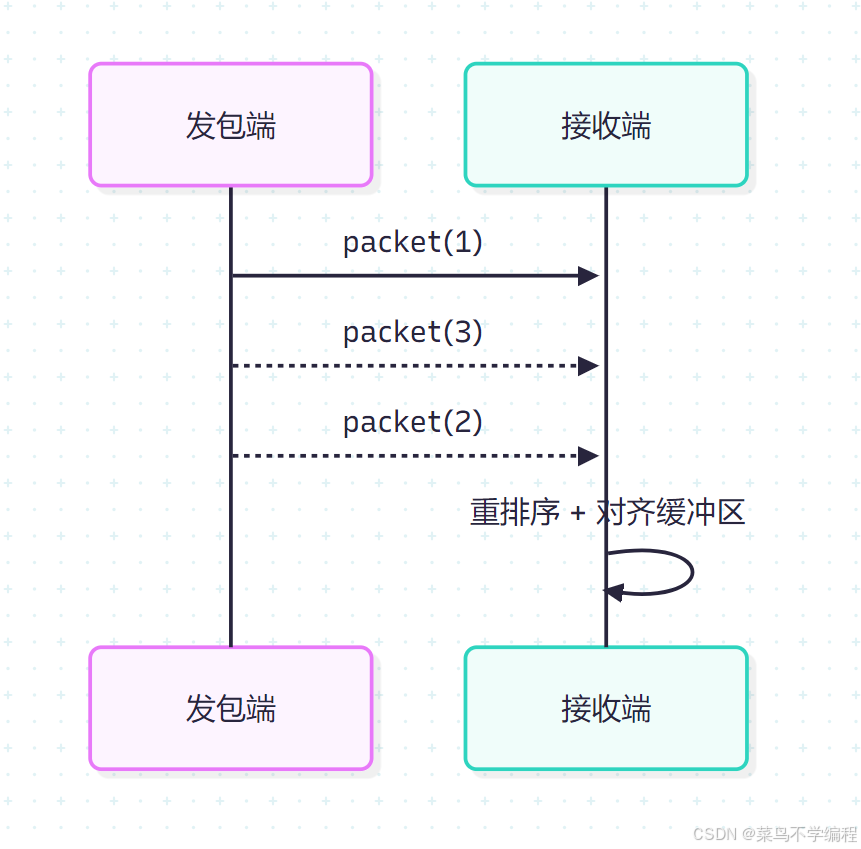

🚧 四、实时传输中抖动和丢包怎么破?

网络抖动和丢包,简直是音视频体验的头号公敌。

🧊 网络抖动处理

鸿蒙采用了改进型 Jitter Buffer 策略:

- 动态窗口调整:根据实时RTT变动微调缓冲区;

- 时间戳标定:对齐到关键帧时钟;

📉 丢包控制机制

鸿蒙集成 NACK/ARQ 与 FEC 相结合的策略:

- 轻量重传机制(ARQ):对关键帧请求重传;

- 冗余片段(FEC):1个冗余包可恢复最多2~3个丢失包;

⚖️ 五、鸿蒙 vs Android / iOS:谁的底子更硬?

| 特性 | 鸿蒙OS | Android | iOS |

|---|---|---|---|

| 编解码接口 | 基于OpenHarmony多媒体模块,支持分布式硬编 | MediaCodec + 自定义FFmpeg | AVFoundation + Metal |

| 实时性 | 分布式场景低延迟切换能力强 | 依赖系统调度,延迟波动大 | 延迟低但封闭性强 |

| 网络抗性 | 高,FEC + Jitter Buffer 多层优化 | 中,第三方SDK依赖多 | 高,但系统不可控性大 |

| 多设备协同 | 原生支持 | 需额外实现 | 限制多 |

结论:鸿蒙在全场景协同 + 弹性网络适应性上占据优势。

🛠️ 六、终极优化路径:怎么做才真低延迟?

- 软硬件结合压缩优化:利用GPU/ISP模块硬编加速;

- 动态码率控制:根据RTT、丢包率动态调整音/视频码率;

- 帧率自适应调整:保持关键帧稳定,跳过非关键帧;

- 预测性缓冲窗口:延迟预估与提前加载机制结合;

- QoS智能调度:引入优先队列机制,高优数据包抢占通道;

✅ 总结:低延迟不是拼参数,是拼架构

鸿蒙OS的音视频通信优化路径不是“猛堆配置”,而是通过一整套跨层次协同机制来达成:从底层采集到网络传输,从实时编码到端上同步,从多终端流畅切换到智能容灾处理——真正做到全场景、全链路的延迟控制。

下一次你在鸿蒙设备上视频会议不卡顿、语音秒回应时,记得感谢那一套在幕后“打满补丁”的低延迟系统优化逻辑吧😉。

如果你还想深入探索鸿蒙音视频 SDK 实战项目或者构建自己的 WebRTC 服务端落地系统,我可以继续扩展更硬核的系列文章,记得点个“继续”!

📝 写在最后

如果你觉得这篇文章对你有帮助,或者有任何想法、建议,欢迎在评论区留言交流!你的每一个点赞 👍、收藏 ⭐、关注 ❤️,都是我持续更新的最大动力!

我是一个在代码世界里不断摸索的小码农,愿我们都能在成长的路上越走越远,越学越强!

感谢你的阅读,我们下篇文章再见~👋

✍️ 作者:某个被流“治愈”过的 Java 老兵

📅 日期:2025-07-24

🧵 本文原创,转载请注明出处。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)