深度学习不会特征融合就死记这6种方法!!!

具体做法是将特征图进行不同尺度的池化操作,生成多尺度特征图,并将多尺度特征图拼接在一起,形成一个综合的特征表示。6.反卷积,用于将高层特征上采样到与低层特征相同的分辨率,然后将两个特征图拼接在一起,从而得到更准确的分割结果,典型应用场景:分割任务中的FCN(Fully Convolutional Networks)典型应用场景:U-Net结构。对了,这里还整理了80多个即插即用的深度学习模块,能快

深度学习不会特征融合就死记这6种方法!

1.拼接,这种方法能够保留所有输入特征的信息,从而获得更丰富的特征表达

具体做法是将低层特征和高层特征在深度维度(通常是通道维度)上进行拼接。拼接后的特征图包含了更多的上下文信息和细节信息,有助于提高模型的性能。典型应用场景:U-Net结构

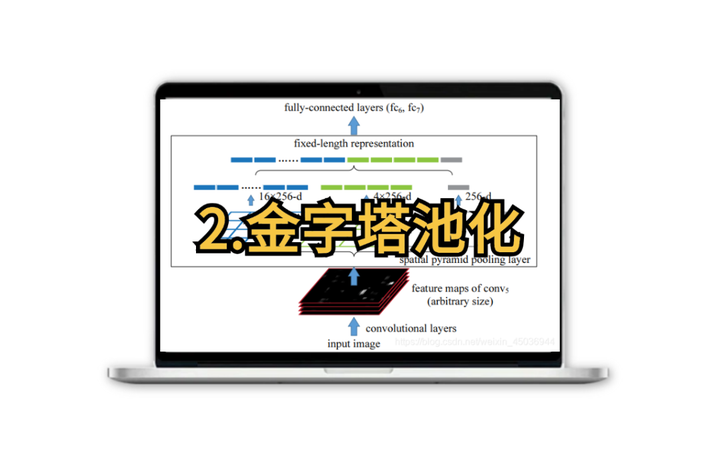

2.金字塔池化,这种方法能够有效捕捉不同尺度的信息,提高模型的性能

具体做法是将特征图进行不同尺度的池化操作,生成多尺度特征图,并将多尺度特征图拼接在一起,形成一个综合的特征表示。金字塔池化能够增强模型对多尺度物体的感知能力,典型应用场景:Pyramid Scene Parsing Network(PSPNet)

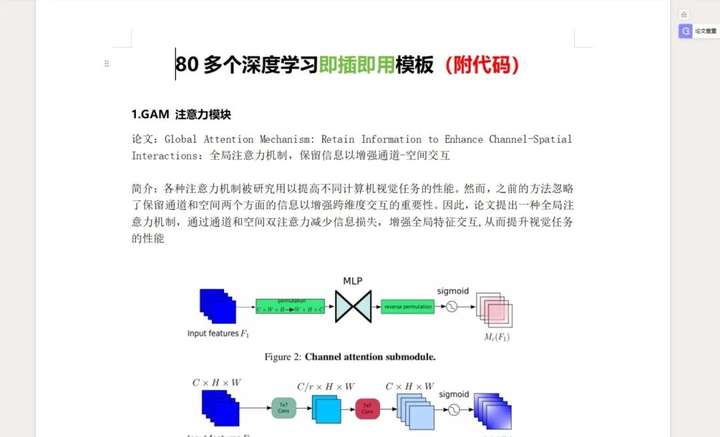

对了,这里还整理了80多个即插即用的深度学习模块,能快速组合出各种设计好的模块,搭建出我们需要的模型,这样做不仅让建模速度提升,还保证了模型的创新性和有效性

以及特征工程书籍,包含了特征工程中的数字处理技巧、文本数据处理方式、特征缩放、类别特征、降维等方面,带你从原始数据中提取出正确的特征并将其转换为适合机器学习模型的格式

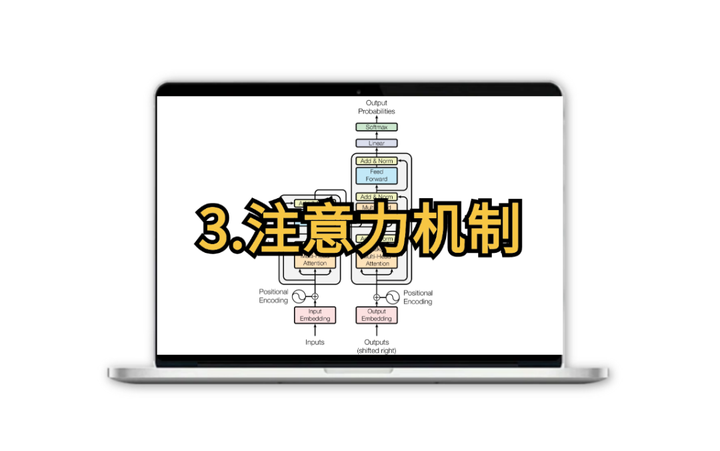

3.注意力机制,通过学习一组权重,对不同尺度的特征进行加权,从而提高重要特征的响应,在处理多尺度问题时特别有用

具体做法是对不同特征图计算注意力权重,根据权重对特征图进行加权求和,得到最终的融合特征图。这种方法能够动态调整特征的重要性,突出关键信息,典型应用场景:自注意力(Self-Attention)

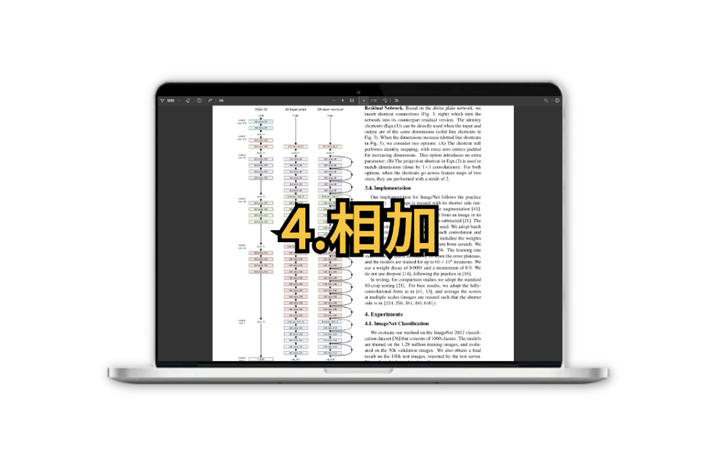

4.相加,是指将多个特征图逐元素相加,得到一个新的特征图。这种方法能够平滑特征表示,减少噪声的影响,常用于ResNet中的跳跃连接。具体操作是把对应位置的特征值相加,生成新的特征图,典型应用场景:残差网络(ResNet)

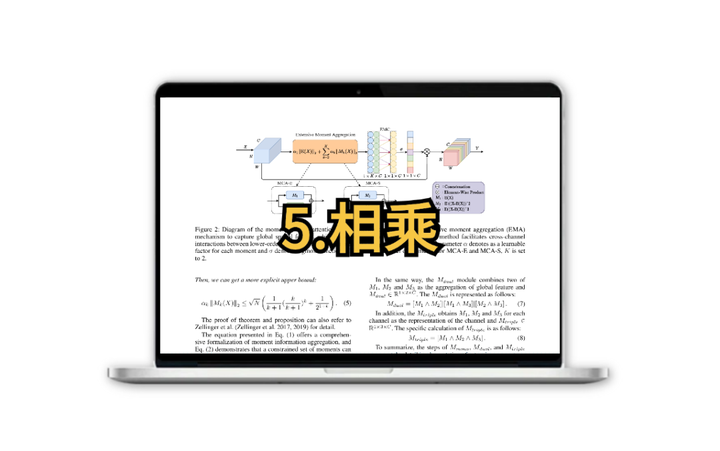

5.相乘,这种方法可以突出重要特征,抑制不相关特征。具体做法是将对应位置的特征值相乘,生成新的特征图。相乘后的特征图在保留细节的同时增强了特征的表达能力,典型应用场景:注意力机制中的通道注意力(Channel Attention)

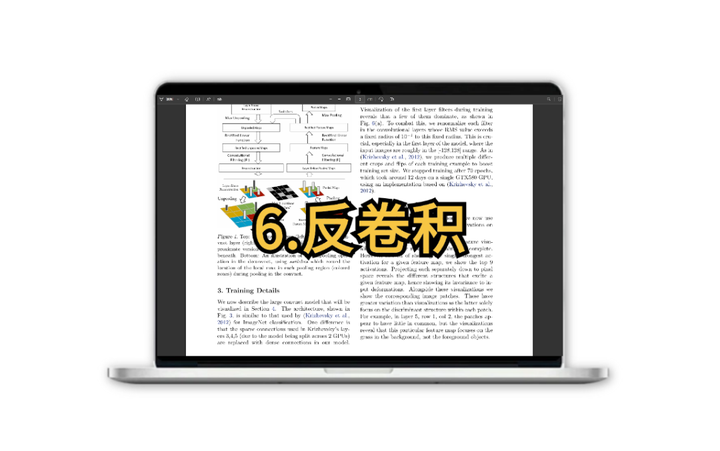

6.反卷积,用于将高层特征上采样到与低层特征相同的分辨率,然后将两个特征图拼接在一起,从而得到更准确的分割结果,典型应用场景:分割任务中的FCN(Fully Convolutional Networks)

具体做法是对高层特征图进行反卷积操作,将其上采样到目标分辨率,并将上采样后的高层特征图与低层特征图在深度维度上进行拼接。这种方法在语义分割任务中非常有效,能够结合不同层次的特征,提高分割精度

这些方法可以单独使用,也可以组合使用,以提高模型的准确性和鲁棒性。选择适当的特征融合方法需要根据具体的应用场景和数据特性进行权衡和实验。

更多推荐

已为社区贡献50条内容

已为社区贡献50条内容

所有评论(0)