基于Python+爬虫的京东美妆产品评价数据可视化分析系统设计与实现

今天带来的是基于Python+爬虫的京东美妆产品评价数据可视化分析系统设计与实现。该系统采用Django框架搭建后端,结合Scrapy爬虫技术从京东平台采集美妆评价数据,利用Echarts进行可视化展示,并应用聚类算法进行预测分析。系统分为管理员和用户两大角色:管理员负责数据采集、清洗、算法预测和系统管理;用户可查看美妆产品信息、评价数据及预测结果。系统通过数据可视化大屏直观展示分析结果,为商家提

💗博主介绍:✌全网粉丝20W+,CSDN全栈领域优质创作者,博客之星、掘金/华为云/阿里云等平台优质作者,计算机毕设实战导师。目前专注于大学生项目实战开发,讲解,毕业答疑辅导,欢迎高校老师/同行前辈交流合作✌

💗主要服务内容:免费功能设计、选题定题、开题报告、任务书、程序开发、论文编写和辅导、论文降重、程序讲解、答辩辅导等,欢迎咨询~

👇🏻 精彩专栏 推荐订阅👇🏻

计算机毕业设计精品项目案例(持续更新,值得收藏!)✅

2025-2026年计算机毕业设计选题推荐:计算机专业毕业设计题目大全✅

全网最全计算机毕业设计选题推荐:计算机毕设选题指导及避坑指南✅

🌟文末获取源码+数据库+文档🌟

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及论文编写等相关问题都可以和学长沟通,希望帮助更多的人

一.前言

在当今数字化时代,美妆市场蓬勃发展,网络评价成为消费者了解美妆产品的重要信息来源。随着互联网技术的不断进步,大量的美妆产品网络评价数据蕴含着丰富的价值,对其进行有效的采集与分析,有助于商家精准把握消费者需求,优化产品和服务,也能为消费者提供更具参考性的购物建议。

本系统基于B/S开发模式进行构建,综合运用多种先进技术。采用Scrapy爬虫技术,能够高效地从京东平台采集美妆产品的相关网络评价数据。借助Python语言强大的数据处理能力,对采集到的数据进行清洗、预处理等操作。利用Django框架搭建系统的后端,实现对用户信息、京东美妆数据等的管理。同时,运用Echarts工具对数据进行可视化展示,以直观的图表形式呈现分析结果。引入聚类算法对美妆产品的网络评价数据进行预测分析,挖掘数据背后的潜在模式和规律。系统的管理员可对用户、京东美妆相关数据以及聚类算法预测等功能进行全面管理,确保系统的稳定运行和数据的安全。该系统的意义在于通过对美妆产品网络评价数据的深入采集与分析,为美妆行业的商家提供了科学的决策依据,帮助其改进产品和营销策略。同时,也为消费者提供了更有价值的参考信息,提升了消费者的购物体验。对于推动美妆行业的数字化、智能化发展具有积极的促进作用。

二.技术环境

开发语言:Python

Python框架:Django

数据库:mysql 5.7或更高版本

数据库工具:Navicat11

爬虫框架:Scrapy

开发软件:Pycharm

前端框架:vue.js

可视化技术:Echarts

三.功能设计

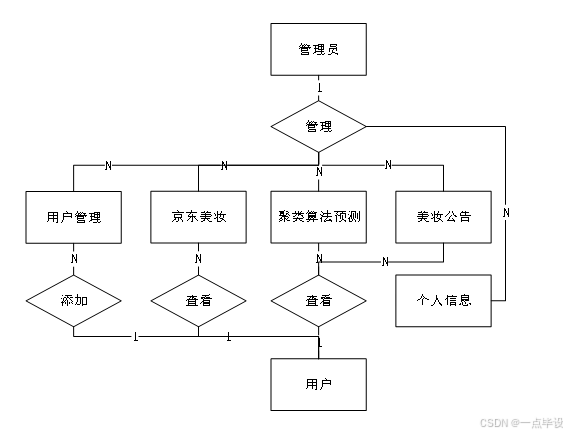

UML用例图是一种图形化手段,专门用于阐述系统的功能需求。它通过描绘系统与外部参与者之间的交互场景,清晰地界定了系统的功能边界。在用例图中,用例代表着系统所能执行的特定服务或功能,而参与者则象征着与系统发生交互的各种用户或外部实体。这一工具的使用,极大地促进了系统功能的明确与理解。本文将对系统按照角色模块进行需求分析。

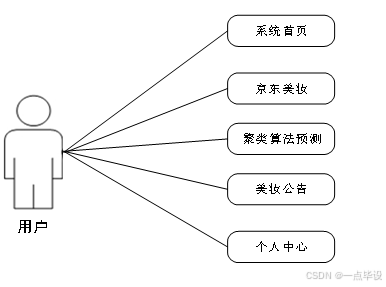

用户可以查看系统首页、京东美妆、聚类算法预测、美妆公告、个人中心。用户用例图如图所示。

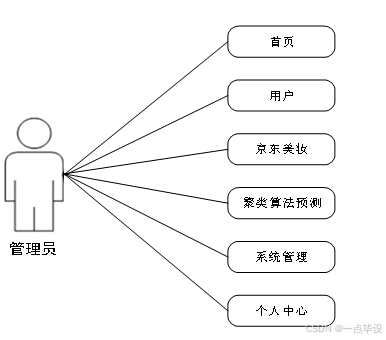

管理员可以进行首页、用户、京东美妆、聚类算法预测、系统管理、个人中心。管理员用例图如图所示。

该系统用户角色分为管理员和普通用户。管理员功能首页:系统入口,可快速概览关键信息。用户管理:对系统用户进行增删改查等操作,保障用户信息安全与权限合理分配。京东美妆数据处理:负责采集、整理京东平台美妆产品评价数据。聚类算法预测:运用算法挖掘数据,预测美妆市场趋势、用户需求偏好等。系统管理:维护系统基础设置、服务器配置等,确保系统稳定运行。个人中心:管理管理员个人信息、密码修改等。用户功能系统首页:展示系统信息与功能入口。京东美妆:查看京东平台美妆产品及评价数据。聚类算法预测结果查看:获取算法预测结论辅助消费决策。美妆公告:接收美妆行业动态、系统通知等。个人中心:管理个人信息、收藏等。系统功能结构图如图所示。

四.数据设计

系统需要数据库存储系统中的信息,MySQL数据库能够处理系统的信息,当考研信息爬虫与分析需要数据的时候,MySQL数据库能够取得数据交给服务端处理。MySQL数据库能够使用可视化软件操作,管理员可以在可视化软件对数据库的信息管理。

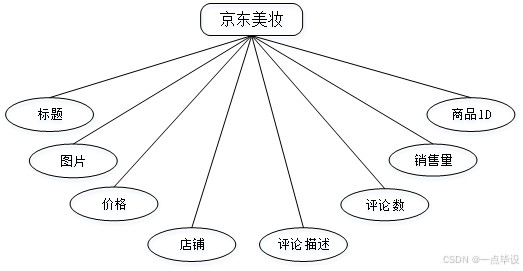

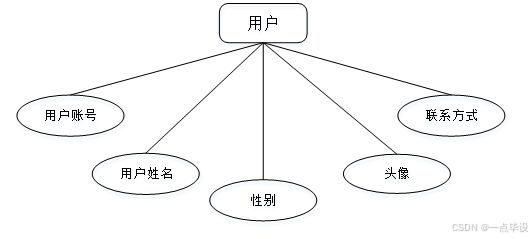

系统数据层设计包括了E-R设计,系统数据实体的设计依赖于E-R的分析和设计,通过E-R能够得到数据库表的设计,E-R能够描述系统所涉及到的实体,还能够描述系统中不同实体的联系和关系。系统部分实体E-R图如下所示:

系统总体E-R图如图所示:

五.部分效果展示

5.1前台用户功能实现效果

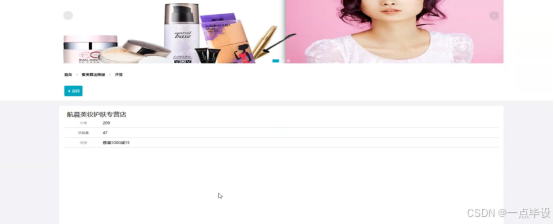

用户在京东美妆查看页面可以查看京东美妆,并根据标题、价格、店铺等条件筛选数据。展示的数据包括标题、图片、价格、店铺、评论描述、评论数、销售量、商品ID等信息。京东美妆查看界面如图所示。

用户在聚类算法预测查看页面可以查看聚类算法预测,并根据店铺、价格、销售量等条件筛选数据。展示的数据包括店铺、价格、销售量、支持等。聚类算法预测查看界面如图所示。

用户可以在此页面对个人信息、修改密码、我的收藏进行相关操作。个人中心界面如图所示。

5.2后台管理员功能实现效果

管理员在用户页面查看和管理用户账号、用户姓名、性别、头像、联系方式等信息,进行添加、删除或修改等操作。用户界面如图所示。

管理员在京东美妆页面查看、清洗数据、添加或删除京东美妆信息。管理员还能爬取数据,系统会自动爬取标题、图片、价格、店铺、评论描述、评论数、销售量、商品ID等,管理员爬取的京东美妆信息会在前台显示,京东美妆爬取页面如图所示。

管理员在聚类算法预测页面查看和管理店铺、价格、销售量、支持等信息,进行查询、预测图表、添加或修改等操作,聚类算法预测界面如图所示。

管理员在美妆公告页面查看标题、分类名称、发布人、点击次数、收藏数、图片等信息,进行查询、添加或者删除等操作;美妆公告界面如图所示。

5.3可视化大屏展示功能实现效果

美妆产品评价数据采集可视化分析系统展示图折线图:可能用于展示美妆产品在一段时间内的相关数据变化趋势,比如销量、用户评价分数等随时间的波动,能直观呈现数据的增减态势。柱状图:或许用来对比不同美妆产品的某些指标,像不同品牌的销售额、好评率等,通过柱体高度差异可清晰看出数据间差距。环形图:大概率用于呈现各部分占比情况,比如不同类型美妆产品(如护肤、彩妆等)在整体市场中的份额,或不同评价等级(好评、中评、差评)的比例分布 。中间的表格可能详细记录了美妆产品的各项具体数据,包括产品名称、规格、价格、销量、用户评价数量等,方便用户查阅具体产品信息。界面中可能还设有筛选、查询等功能按钮,用户可以通过这些操作,按照自身需求,如按品牌、按时间范围等条件,对数据进行筛选和深入分析,提升数据查看和使用的灵活性。如图所示。

六.部分功能代码

import scrapy

import pymysql

import pymssql

from ..items import xiangmuItem

import time

import re

import random

import platform

import json

import os

from urllib.parse import urlparse

import requests

import emoji

class xiangmuSpider(scrapy.Spider):

name = 'xiangmuSpider'

spiderUrl = 'https://url网址'

start_urls = spiderUrl.split(";")

protocol = ''

hostname = ''

def __init__(self, *args, **kwargs):

super().__init__(*args, **kwargs)

# 列表解析

def parse(self, response):

_url = urlparse(self.spiderUrl)

self.protocol = _url.scheme

self.hostname = _url.netloc

plat = platform.system().lower()

if plat == 'windows_bak':

pass

elif plat == 'linux' or plat == 'windows':

connect = self.db_connect()

cursor = connect.cursor()

if self.table_exists(cursor, 'xiangmu') == 1:

cursor.close()

connect.close()

self.temp_data()

return

list = response.css('ul.subject-list li.subject-item')

for item in list:

fields = xiangmuItem()

fields["laiyuan"] = self.remove_html(item.css('div.pic a.nbg::attr(href)').extract_first())

if fields["laiyuan"].startswith('//'):

fields["laiyuan"] = self.protocol + ':' + fields["laiyuan"]

elif fields["laiyuan"].startswith('/'):

fields["laiyuan"] = self.protocol + '://' + self.hostname + fields["laiyuan"]

fields["fengmian"] = self.remove_html(item.css('div.pic a.nbg img::attr(src)').extract_first())

fields["xiaoshuoming"] = self.remove_html(item.css('div.info h2 a::attr(title)').extract_first())

detailUrlRule = item.css('div.pic a.nbg::attr(href)').extract_first()

if self.protocol in detailUrlRule:

pass

elif detailUrlRule.startswith('//'):

detailUrlRule = self.protocol + ':' + detailUrlRule

else:

detailUrlRule = self.protocol + '://' + self.hostname + detailUrlRule

fields["laiyuan"] = detailUrlRule

yield scrapy.Request(url=detailUrlRule, meta={'fields': fields}, callback=self.detail_parse)

# 详情解析

def detail_parse(self, response):

fields = response.meta['fields']

try:

if '(.*?)' in '''div#info span a::text''':

fields["zuozhe"] = re.findall(r'''div#info span a::text''', response.text, re.S)[0].strip()

else:

if 'zuozhe' != 'xiangqing' and 'zuozhe' != 'detail' and 'zuozhe' != 'pinglun' and 'zuozhe' != 'zuofa':

fields["zuozhe"] = self.remove_html(response.css('''div#info span a::text''').extract_first())

else:

fields["zuozhe"] = emoji.demojize(response.css('''div#info span a::text''').extract_first())

except:

pass

# 去除多余html标签

def remove_html(self, html):

if html == None:

return ''

pattern = re.compile(r'<[^>]+>', re.S)

return pattern.sub('', html).strip()

# 数据库连接

def db_connect(self):

type = self.settings.get('TYPE', 'mysql')

host = self.settings.get('HOST', 'localhost')

port = int(self.settings.get('PORT', 3306))

user = self.settings.get('USER', 'root')

password = self.settings.get('PASSWORD', '123456')

try:

database = self.databaseName

except:

database = self.settings.get('DATABASE', '')

if type == 'mysql':

connect = pymysql.connect(host=host, port=port, db=database, user=user, passwd=password, charset='utf8')

else:

connect = pymssql.connect(host=host, user=user, password=password, database=database)

return connect

# 断表是否存在

def table_exists(self, cursor, table_name):

cursor.execute("show tables;")

tables = [cursor.fetchall()]

table_list = re.findall('(\'.*?\')',str(tables))

table_list = [re.sub("'",'',each) for each in table_list]

if table_name in table_list:

return 1

else:

return 0

@main_bp.route("/python05c7298x/danchexinxi/save", methods=['POST'])

def python05c7298x_danchexinxi_save():

'''

'''

if request.method == 'POST':

msg = {"code": normal_code, "msg": "success", "data": {}}

req_dict = session.get("req_dict")

if danchexinxi.count(danchexinxi, danchexinxi, {"danchebianhao":req_dict["danchebianhao"]})>0:

msg['code'] = crud_error_code

msg['msg'] = "单车编号已存在"

return jsonify(msg)

for key in req_dict:

if req_dict[key] == '':

req_dict[key] = None

error= danchexinxi.createbyreq(danchexinxi, danchexinxi, req_dict)

if error!=None:

msg['code'] = crud_error_code

msg['msg'] = error

return jsonify(msg)

为什么选择我们

大学毕业那年,曾经有幸协助指导老师做过毕业设计课题分类、论文初选(查看论文的格式)、代码刻录等打杂的事情,也帮助过同界N多同学完成过毕业设计工作,毕业后在一家互联网大厂工作8年,先后从事Java前后端开发、系统架构设计等方面的工作,有丰富的编程能力和水平,也在工作之余指导过别人完成过一些毕业设计的工作。2016年至今,团队已指导上万名学生顺利通过毕业答辩,目前是csdn特邀作者、CSDN全栈领域优质创作者,博客之星、掘金/华为云/B站/知乎等平台优质作者,计算机毕设实战导师,专注于大学生项目实战开发,讲解,毕业答疑辅导,欢迎咨询~✌

最后

💕💕

最新计算机毕业设计选题篇-选题推荐

小程序毕业设计精品项目案例-200套

Java毕业设计精品项目案例-200套

Python毕业设计精品项目案例-200套

大数据毕业设计精品项目案例-200套

💟💟如果大家有任何疑虑,欢迎在下方位置详细交流。

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)