10大创新思路!GNN+强化学习,没灵感看这篇就够了!

近期研究聚焦于图神经网络(GNN)与强化学习(RL)的融合,以突破传统方法在复杂关联场景中的局限。斯坦福团队提出图强化决策模型,在智能交通和电网调度中显著提升效率(30%通行率提升,22%能源浪费减少)。

GNN与强化学习的融合研究迎来重大突破!ICML'2025 上,斯坦福大学团队提出的图强化决策模型,直接解决了传统强化学习处理复杂关联场景时决策效率低、GNN缺乏动态优化能力的瓶颈,成了AI决策领域的新趋势。

要知道GNN擅长捕捉图结构数据中的节点关联,比如社交网络、交通路网的复杂关系;而强化学习能通过试错迭代优化决策策略,却在处理高关联数据时容易陷入局部最优。两者结合刚好互补,用GNN提取场景关联特征,再引导强化学习动态调整决策策略,在智能交通调度任务中,通行效率提升30%;在电网负荷分配场景下,能源浪费减少22%,实用性拉满。

想发论文的伙伴,可从多场景图结构适配、决策策略动态优化入手;我也整理了10篇相关的前沿论文,顶会/顶刊论文+部分官方代码打包免费送,工种号 沃的顶会 扫码回复 “GNNRL” 领取。

SCALING UP WITHOUT FADING OUT: GOAL-AWARE SPARSE GNN FOR RL-BASED GENERALIZED PLANNING

文章解析

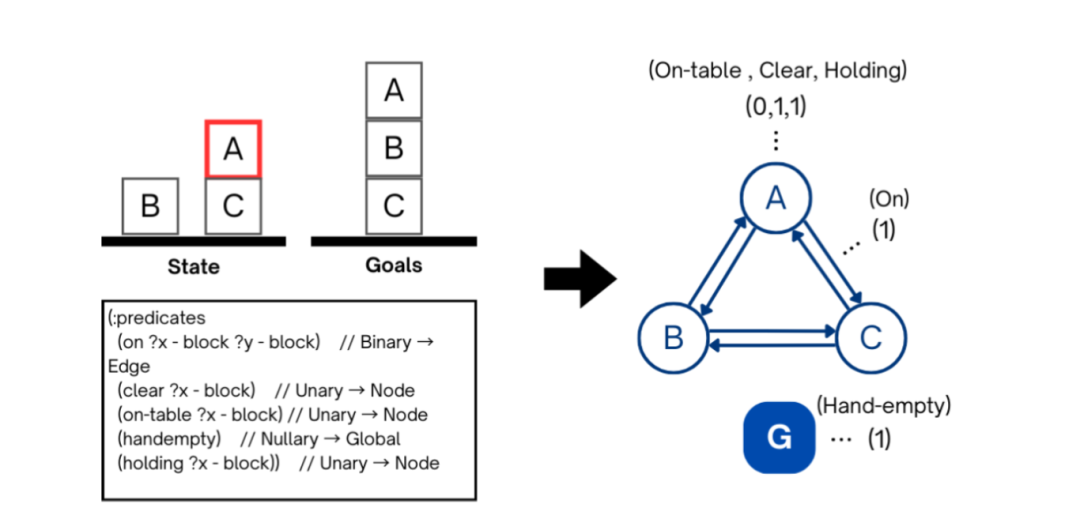

本文提出一种面向目标的稀疏图神经网络(GNN)表示方法,用于解决基于深度强化学习(RL)和PDDL的广义规划在大规模问题中因全连接图导致的信息稀释、内存爆炸和训练困难等问题。通过仅编码局部邻接关系并显式引入与目标相关的空间特征,该方法显著提升了在大型网格环境中的可扩展性、策略泛化能力和任务成功率。作者设计了基于PDDL的无人机任务场景进行验证,证明了该方法能有效扩展到以往密集图表示无法处理的网格规模。

创新点

提出一种稀疏且目标感知的GNN图表示方法,避免全连接图带来的组合爆炸问题。

在节点特征中显式嵌入与目标相关的空间信息,增强策略的方向感知能力。

首次在基于PDDL的大规模网格领域中实现成功的RL驱动广义规划。

通过局部关系建模提升GNN在大规模状态空间中的信息传递效率。

设计了适用于无人机任务的新型PDDL模拟环境以验证方法的有效性。

研究方法

将PDDL规划问题转化为图结构,仅保留局部邻接边以构建稀疏图。

在节点特征中引入相对于目标的位置编码等空间特征。

采用图神经网络(GNN)与深度强化学习(RL)框架结合进行策略学习。

在大型网格世界中构建多阶段无人机任务(如导航、扫描、重规划)作为实验场景。

通过对比密集图与稀疏图表示,在不同网格规模下评估策略的成功率与泛化能力。

研究结论

稀疏且目标感知的GNN表示显著提升了RL在大规模广义规划任务中的可扩展性。

该方法在大网格环境中实现了更高的策略成功率和更强的跨任务泛化能力。

显式的目标相关特征注入有效缓解了信息稀释问题。

所提方法为现实世界中大规模自主系统(如无人机)的广义规划提供了可行路径。

基于PDDL的符号建模与深度学习的结合在复杂任务规划中展现出巨大潜力。

MAG-GNN:Reinforcement Learning Boosted Graph Neural Network

文章解析

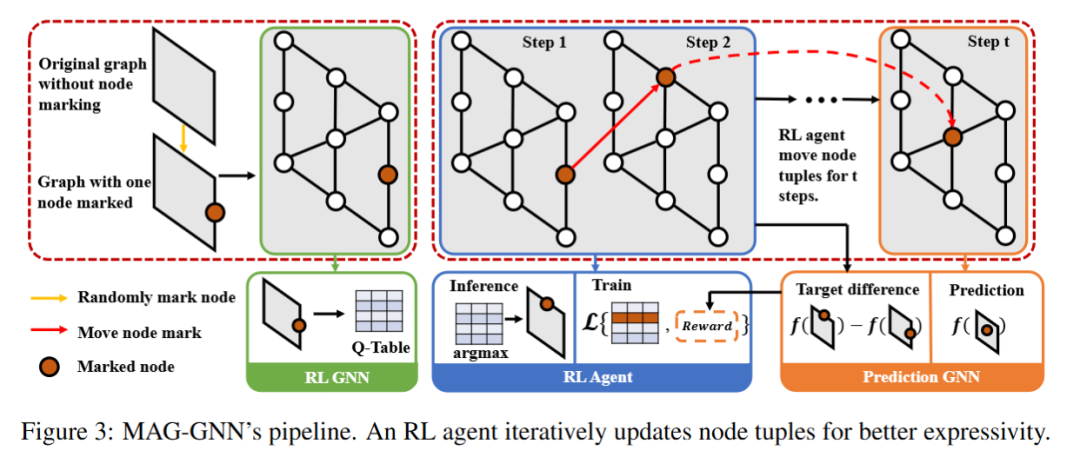

尽管图神经网络(GNN)在图学习任务中表现出色,但其表达能力受限于1-WL测试。子图GNN通过引入子图信息提升表达能力,但需枚举所有可能的子图,导致计算开销巨大。本文提出MAG-GNN,通过强化学习(RL)动态搜索最具表达力的少量子图,避免完全枚举,在保持高表达力的同时显著提升效率。实验表明,MAG-GNN在多个数据集上性能媲美甚至超越现有最先进方法,且运行时间更短。

创新点

提出并非所有子图都对提升GNN表达力必要,少量关键子图即可达到相近效果。

将最优子图选择建模为组合优化问题,并引入强化学习框架求解。

设计MAG-GNN框架,通过RL代理迭代更新候选子图集合,动态定位最具区分性的子图。

首次将强化学习与子图GNN结合,实现表达力与效率的平衡。

理论与实验证明部分子图信息足以实现强表达能力,挑战了全枚举必要性假设。

研究方法

从所有根节点子图中随机采样构建初始候选子图集。

利用Q-Table建模替换每个目标子图的预期奖励,指导强化学习决策。

RL代理每步选择能最大化奖励的新子图替换当前子图,逐步优化集合。

最终获得的高表达力子图集输入预测GNN完成下游任务。

整个搜索过程将指数级复杂度的枚举降为常数步的RL搜索。

研究结论

MAG-GNN在保持高表达力的同时,显著降低了子图GNN的计算复杂度。

在多个合成与真实图数据集上,MAG-GNN性能达到SOTA,部分超越子图GNN。

MAG-GNN大幅缩短了训练和推理时间,提升了实际应用可行性。

部分子图信息足以实现强大表达能力,无需完全枚举。

强化学习可有效引导图神经网络中的结构搜索过程。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)