【完整源码+数据集+部署教程】 流水线饮料容器图像分割系统源码&数据集分享 [yolov8-seg-EfficientRepBiPAN&yolov8-seg-FocalModulation等50+全

【完整源码+数据集+部署教程】 流水线饮料容器图像分割系统源码&数据集分享[yolov8-seg-EfficientRepBiPAN&yolov8-seg-FocalModulation等50+全

背景意义

随着人工智能技术的迅猛发展,计算机视觉领域的研究日益受到重视,尤其是在物体检测与图像分割方面。饮料容器的自动识别与分类不仅是智能零售、自动化仓储和回收系统中的重要环节,也是实现环境保护与资源再利用的关键技术之一。近年来,YOLO(You Only Look Once)系列模型因其高效的实时性和准确性,成为了目标检测领域的热门选择。特别是YOLOv8模型在处理复杂场景中的表现更是引人注目,具备了更强的特征提取能力和更快的推理速度。因此,基于改进YOLOv8的流水线饮料容器图像分割系统的研究具有重要的理论与实践意义。

本研究所使用的数据集“DatasetSkripsi_glo”包含1000张图像,涵盖了三类饮料容器:罐装饮料、非瓶罐类容器和塑料瓶。这一数据集的多样性为模型的训练与测试提供了丰富的样本,能够有效提升模型的泛化能力。通过对不同类型饮料容器的图像进行实例分割,研究旨在实现对饮料容器的精确识别与分类,进而推动智能回收系统的建设。当前,全球范围内的塑料污染问题日益严重,如何高效回收和再利用饮料容器成为了亟待解决的环境问题。基于改进YOLOv8的图像分割系统,能够在流水线中实现对饮料容器的自动识别与分类,从而提高回收效率,减少资源浪费,促进可持续发展。

此外,随着深度学习技术的不断进步,YOLOv8模型的改进也为本研究提供了新的思路。通过引入更先进的特征提取网络和优化算法,研究将进一步提升模型在复杂背景下的分割精度。相较于传统的图像处理方法,基于深度学习的图像分割技术能够更好地应对多样化的环境变化,提升系统的鲁棒性。这一研究不仅为饮料容器的自动识别提供了新的解决方案,也为其他领域的图像分割任务提供了借鉴。

综上所述,基于改进YOLOv8的流水线饮料容器图像分割系统的研究,不仅具有重要的学术价值,也具有广泛的应用前景。通过实现对饮料容器的高效识别与分类,研究将为推动智能回收技术的发展贡献力量,助力解决全球塑料污染问题。同时,该研究也为未来的计算机视觉技术在其他领域的应用提供了新的思路与方法,具有深远的社会意义和经济价值。

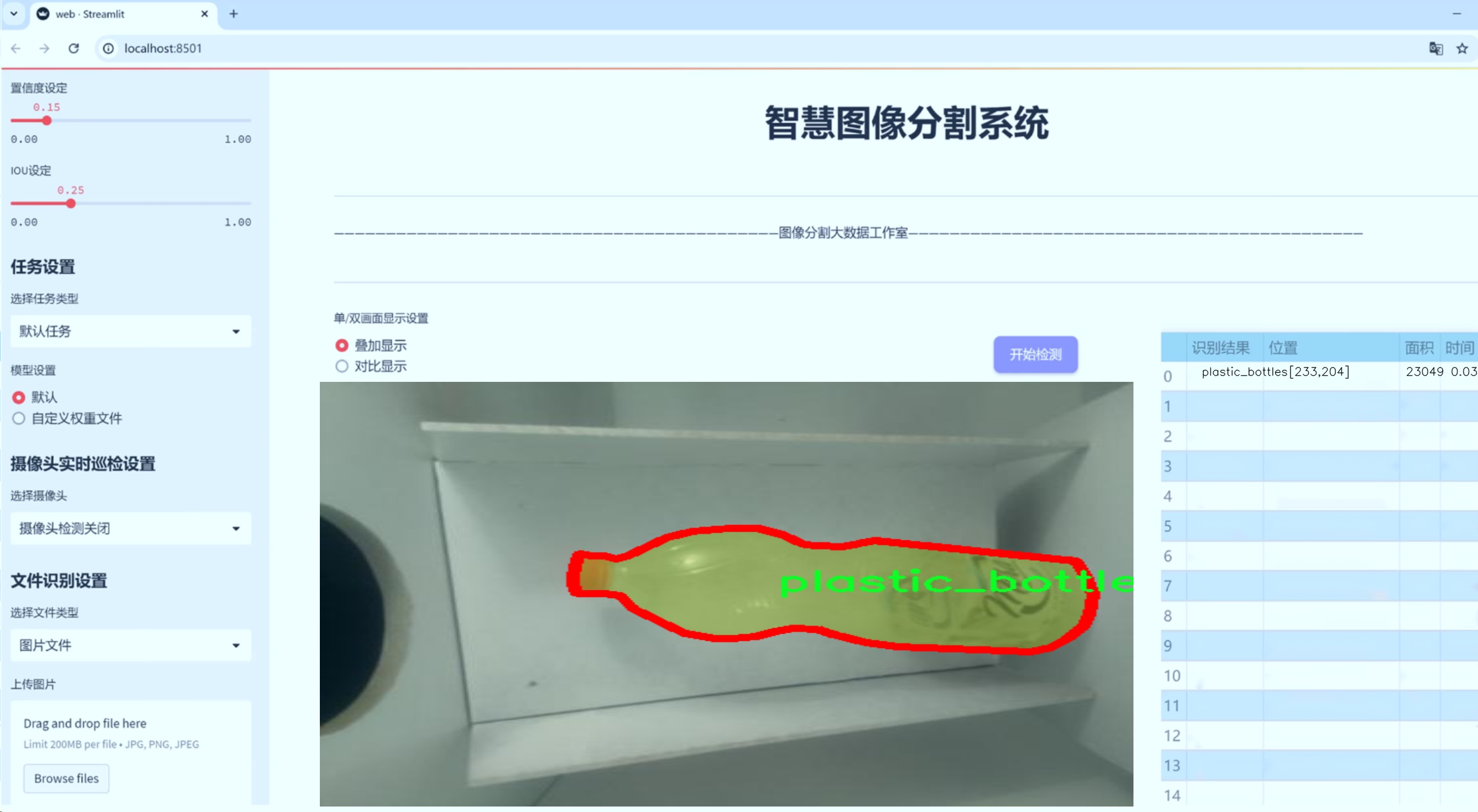

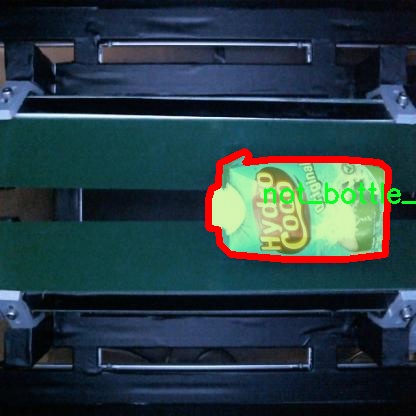

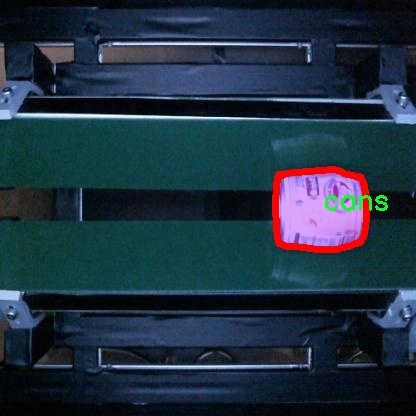

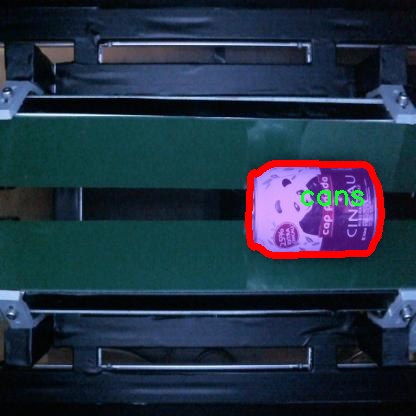

图片效果

数据集信息

在本研究中,我们采用了名为“DatasetSkripsi_glo”的数据集,以支持改进YOLOv8-seg的流水线饮料容器图像分割系统的训练和测试。该数据集专门设计用于处理饮料容器的图像分割任务,涵盖了三种主要类别,分别是“cans”(罐装饮料)、“not_bottle_or_can”(非瓶或罐的物品)以及“plastic_bottles”(塑料瓶)。这些类别的选择旨在帮助模型准确区分不同类型的饮料容器,从而提高图像分割的精度和效率。

“DatasetSkripsi_glo”数据集的构建过程注重多样性和代表性,确保所收集的图像能够覆盖各种实际场景中的饮料容器。这些图像来源于不同的环境,包括超市货架、家庭厨房、户外活动等,旨在模拟真实世界中可能遇到的各种情况。通过这种方式,数据集不仅包含了标准的饮料容器图像,还包括了各种可能干扰模型识别的背景和光照条件,从而提高了模型的鲁棒性。

在类别划分方面,数据集的设计考虑到了实际应用中的需求。首先,罐装饮料(cans)作为一种常见的饮料包装形式,具有多样的形状和尺寸,因此在数据集中占据了重要位置。其次,非瓶或罐的物品(not_bottle_or_can)类别的引入,旨在帮助模型学习如何识别和排除与饮料容器无关的物体,这对于提高分割精度至关重要。最后,塑料瓶(plastic_bottles)作为另一种广泛使用的饮料包装形式,具有其独特的特征和外观,模型需要能够有效识别和分割这些对象。

为了确保数据集的质量和标注的准确性,所有图像均经过严格的审核和标注流程。每一张图像都经过专业人员的仔细标注,确保每个类别的对象都被准确地框定和标识。这种高质量的标注不仅提高了模型训练的有效性,也为后续的评估和测试提供了可靠的基础。

在数据集的使用过程中,我们将其划分为训练集、验证集和测试集,以便于模型的训练和性能评估。训练集用于模型的学习和参数调整,验证集用于在训练过程中监控模型的性能,测试集则用于最终的性能评估,确保模型在未见数据上的泛化能力。

综上所述,“DatasetSkripsi_glo”数据集为改进YOLOv8-seg的流水线饮料容器图像分割系统提供了丰富的图像资源和准确的标注信息。通过合理的类别划分和多样化的图像来源,该数据集不仅能够支持模型的有效训练,还能在实际应用中提升图像分割的准确性和可靠性,为饮料容器的自动识别和分类提供坚实的基础。

核心代码

```python

import sys

import subprocess

def run_script(script_path):

"""

使用当前 Python 环境运行指定的脚本。

Args:

script_path (str): 要运行的脚本路径

Returns:

None

"""

# 获取当前 Python 解释器的路径

python_path = sys.executable

# 构建运行命令,使用 streamlit 运行指定的脚本

command = f'"{python_path}" -m streamlit run "{script_path}"'

# 执行命令,并等待其完成

result = subprocess.run(command, shell=True)

# 检查命令执行的返回码,如果不为0,表示执行出错

if result.returncode != 0:

print("脚本运行出错。")

# 主程序入口

if __name__ == "__main__":

# 指定要运行的脚本路径

script_path = "web.py" # 假设 web.py 在当前目录下

# 调用函数运行指定的脚本

run_script(script_path)

代码分析:

-

导入模块:

sys:用于访问与 Python 解释器紧密相关的变量和函数。subprocess:用于执行外部命令和与其交互。

-

run_script函数:- 功能:运行指定路径的 Python 脚本。

- 参数:

script_path是要运行的脚本的路径。 - 获取当前 Python 解释器的路径,构建运行命令。

- 使用

subprocess.run执行命令,并检查返回码以确定脚本是否成功运行。

-

主程序入口:

- 使用

if __name__ == "__main__":确保代码只在直接运行时执行。 - 指定要运行的脚本路径,并调用

run_script函数。```

这个程序文件名为ui.py,它的主要功能是运行一个指定的 Python 脚本,具体来说是使用 Streamlit 框架来启动一个 Web 应用。

- 使用

首先,文件中导入了一些必要的模块,包括 sys、os 和 subprocess。sys 模块用于访问与 Python 解释器相关的变量和函数,os 模块提供了与操作系统交互的功能,而 subprocess 模块则用于创建新进程、连接到它们的输入/输出/错误管道,并获取它们的返回码。

接下来,文件中定义了一个名为 run_script 的函数。这个函数接收一个参数 script_path,表示要运行的脚本的路径。在函数内部,首先获取当前 Python 解释器的路径,这通过 sys.executable 实现。然后,构建一个命令字符串,使用当前的 Python 解释器和 Streamlit 模块来运行指定的脚本。命令的格式是 "{python_path}" -m streamlit run "{script_path}",其中 python_path 是当前 Python 解释器的路径,script_path 是要运行的脚本路径。

接着,使用 subprocess.run 方法执行构建好的命令。如果命令执行的返回码不为 0,表示脚本运行出错,此时会打印出错误信息。

在文件的最后部分,使用 if __name__ == "__main__": 语句来判断当前模块是否是主程序。如果是,则指定要运行的脚本路径,这里是通过调用 abs_path("web.py") 获取的,abs_path 函数可能是用于获取文件的绝对路径。最后,调用 run_script 函数来执行指定的脚本。

总的来说,这个程序的功能是通过当前的 Python 环境来运行一个名为 web.py 的脚本,利用 Streamlit 框架来启动一个 Web 应用。

```python

import numpy as np

from typing import List

from urllib.parse import urlsplit

class TritonRemoteModel:

"""

与远程Triton推理服务器模型交互的客户端。

属性:

endpoint (str): Triton服务器上模型的名称。

url (str): Triton服务器的URL。

triton_client: Triton客户端(HTTP或gRPC)。

InferInput: Triton客户端的输入类。

InferRequestedOutput: Triton客户端的输出请求类。

input_formats (List[str]): 模型输入的数据类型。

np_input_formats (List[type]): 模型输入的numpy数据类型。

input_names (List[str]): 模型输入的名称。

output_names (List[str]): 模型输出的名称。

"""

def __init__(self, url: str, endpoint: str = '', scheme: str = ''):

"""

初始化TritonRemoteModel。

参数可以单独提供,也可以从一个集合的'url'参数解析,格式为

<scheme>://<netloc>/<endpoint>/<task_name>

参数:

url (str): Triton服务器的URL。

endpoint (str): Triton服务器上模型的名称。

scheme (str): 通信方案('http'或'gRPC')。

"""

# 如果没有提供endpoint和scheme,则从URL解析

if not endpoint and not scheme:

splits = urlsplit(url)

endpoint = splits.path.strip('/').split('/')[0] # 获取模型名称

scheme = splits.scheme # 获取通信方案

url = splits.netloc # 获取网络地址

self.endpoint = endpoint # 设置模型名称

self.url = url # 设置服务器URL

# 根据通信方案选择Triton客户端

if scheme == 'http':

import tritonclient.http as client

self.triton_client = client.InferenceServerClient(url=self.url, verbose=False, ssl=False)

config = self.triton_client.get_model_config(endpoint) # 获取模型配置

else:

import tritonclient.grpc as client

self.triton_client = client.InferenceServerClient(url=self.url, verbose=False, ssl=False)

config = self.triton_client.get_model_config(endpoint, as_json=True)['config']

# 按字母顺序排序输出名称

config['output'] = sorted(config['output'], key=lambda x: x.get('name'))

# 定义模型属性

type_map = {'TYPE_FP32': np.float32, 'TYPE_FP16': np.float16, 'TYPE_UINT8': np.uint8}

self.InferRequestedOutput = client.InferRequestedOutput

self.InferInput = client.InferInput

self.input_formats = [x['data_type'] for x in config['input']] # 获取输入数据类型

self.np_input_formats = [type_map[x] for x in self.input_formats] # 获取numpy数据类型

self.input_names = [x['name'] for x in config['input']] # 获取输入名称

self.output_names = [x['name'] for x in config['output']] # 获取输出名称

def __call__(self, *inputs: np.ndarray) -> List[np.ndarray]:

"""

使用给定的输入调用模型。

参数:

*inputs (List[np.ndarray]): 模型的输入数据。

返回:

List[np.ndarray]: 模型的输出。

"""

infer_inputs = [] # 存储推理输入

input_format = inputs[0].dtype # 获取输入数据类型

for i, x in enumerate(inputs):

# 如果输入数据类型与模型要求不匹配,则转换数据类型

if x.dtype != self.np_input_formats[i]:

x = x.astype(self.np_input_formats[i])

# 创建InferInput对象并设置数据

infer_input = self.InferInput(self.input_names[i], [*x.shape], self.input_formats[i].replace('TYPE_', ''))

infer_input.set_data_from_numpy(x)

infer_inputs.append(infer_input) # 添加到推理输入列表

# 创建输出请求

infer_outputs = [self.InferRequestedOutput(output_name) for output_name in self.output_names]

# 调用Triton客户端进行推理

outputs = self.triton_client.infer(model_name=self.endpoint, inputs=infer_inputs, outputs=infer_outputs)

# 返回输出结果并转换为原始输入数据类型

return [outputs.as_numpy(output_name).astype(input_format) for output_name in self.output_names]

代码注释说明:

- 类定义:

TritonRemoteModel类用于与远程Triton推理服务器进行交互,封装了模型的基本信息和推理方法。 - 初始化方法:

__init__方法用于设置模型的URL、名称和通信方式,并获取模型的配置。 - 推理调用:

__call__方法允许用户直接调用模型进行推理,接受输入数据并返回输出结果。```

这个程序文件定义了一个名为TritonRemoteModel的类,用于与远程的 Triton 推理服务器模型进行交互。该类的主要功能是通过 HTTP 或 gRPC 协议向 Triton 服务器发送推理请求,并处理返回的结果。

在类的构造函数 __init__ 中,首先接收一个 URL 和可选的模型端点及通信协议。若未提供端点和协议,则从 URL 中解析出这些信息。接着,根据指定的通信协议(HTTP 或 gRPC),导入相应的 Triton 客户端库,并创建一个 Triton 客户端实例。随后,通过客户端获取模型的配置,包括输入和输出的名称及数据类型。

类中定义了一些属性,例如 input_formats 和 output_names,用于存储模型输入和输出的相关信息。输入数据类型会被映射到 NumPy 数据类型,以便后续处理。

类的 __call__ 方法允许用户像调用函数一样使用该类实例。该方法接收一个或多个 NumPy 数组作为输入,首先检查输入数据的类型是否与模型要求的类型一致,必要时进行类型转换。然后,构建推理输入,并将其发送到 Triton 服务器进行推理。最后,方法返回模型的输出结果,输出结果也会被转换为原始输入数据的类型。

总的来说,这个类封装了与 Triton 推理服务器的交互细节,使得用户可以方便地进行模型推理,而无需关心底层的实现细节。

```python

import os

import re

import shutil

import socket

import sys

import tempfile

from pathlib import Path

from . import USER_CONFIG_DIR

from .torch_utils import TORCH_1_9

def find_free_network_port() -> int:

"""

查找本地主机上一个空闲的网络端口。

这个函数在单节点训练时非常有用,因为我们不想连接到真实的主节点,但必须设置

`MASTER_PORT` 环境变量。

"""

with socket.socket(socket.AF_INET, socket.SOCK_STREAM) as s:

s.bind(('127.0.0.1', 0)) # 绑定到本地地址和随机端口

return s.getsockname()[1] # 返回绑定的端口号

def generate_ddp_file(trainer):

"""生成一个 DDP 文件并返回其文件名。"""

# 获取训练器的模块和类名

module, name = f'{trainer.__class__.__module__}.{trainer.__class__.__name__}'.rsplit('.', 1)

# 构建文件内容

content = f'''overrides = {vars(trainer.args)} \nif __name__ == "__main__":

from {module} import {name}

from ultralytics.utils import DEFAULT_CFG_DICT

cfg = DEFAULT_CFG_DICT.copy()

cfg.update(save_dir='') # 处理额外的 'save_dir' 键

trainer = {name}(cfg=cfg, overrides=overrides)

trainer.train()'''

# 创建 DDP 目录(如果不存在)

(USER_CONFIG_DIR / 'DDP').mkdir(exist_ok=True)

# 创建临时文件并写入内容

with tempfile.NamedTemporaryFile(prefix='_temp_',

suffix=f'{id(trainer)}.py',

mode='w+',

encoding='utf-8',

dir=USER_CONFIG_DIR / 'DDP',

delete=False) as file:

file.write(content) # 写入内容到临时文件

return file.name # 返回临时文件名

def generate_ddp_command(world_size, trainer):

"""生成并返回用于分布式训练的命令。"""

import __main__ # 本地导入以避免某些问题

if not trainer.resume:

shutil.rmtree(trainer.save_dir) # 删除保存目录

file = str(Path(sys.argv[0]).resolve()) # 获取当前脚本的绝对路径

# 定义允许的文件名模式

safe_pattern = re.compile(r'^[a-zA-Z0-9_. /\\-]{1,128}$')

# 检查文件名是否合法,若不合法则生成 DDP 文件

if not (safe_pattern.match(file) and Path(file).exists() and file.endswith('.py')):

file = generate_ddp_file(trainer)

# 根据 PyTorch 版本选择分布式命令

dist_cmd = 'torch.distributed.run' if TORCH_1_9 else 'torch.distributed.launch'

port = find_free_network_port() # 查找空闲端口

# 构建命令

cmd = [sys.executable, '-m', dist_cmd, '--nproc_per_node', f'{world_size}', '--master_port', f'{port}', file]

return cmd, file # 返回命令和文件名

def ddp_cleanup(trainer, file):

"""如果创建了临时文件,则删除它。"""

if f'{id(trainer)}.py' in file: # 检查文件名是否包含临时文件后缀

os.remove(file) # 删除临时文件

代码说明:

- find_free_network_port: 该函数用于查找本地主机上一个空闲的网络端口,适用于设置分布式训练的环境变量。

- generate_ddp_file: 该函数生成一个临时的 DDP(分布式数据并行)文件,包含训练器的配置和训练逻辑,并返回该文件的路径。

- generate_ddp_command: 该函数生成用于启动分布式训练的命令,包括处理文件名的合法性检查、选择合适的分布式命令和查找空闲端口。

- ddp_cleanup: 该函数用于清理生成的临时文件,确保在训练结束后不留下无用的文件。```

这个程序文件是用于处理分布式训练相关功能的,主要是为Ultralytics YOLO模型提供支持。文件中包含几个主要的函数,分别用于查找可用的网络端口、生成分布式数据并行(DDP)文件、生成分布式训练命令以及清理临时文件。

首先,find_free_network_port函数用于查找本地主机上可用的网络端口。这在单节点训练时非常有用,因为我们不希望连接到一个真实的主节点,但又需要设置MASTER_PORT环境变量。该函数通过创建一个TCP套接字并绑定到本地地址和随机端口来实现,返回找到的可用端口号。

接下来,generate_ddp_file函数用于生成一个DDP文件并返回其文件名。它首先获取传入的训练器类的模块和名称,然后构建一个Python脚本的内容,这个脚本会导入训练器并调用其训练方法。生成的文件被保存在用户配置目录下的DDP文件夹中,使用临时文件的方式确保不会干扰其他文件。

generate_ddp_command函数用于生成分布式训练的命令。它首先检查训练器是否需要恢复训练,如果不需要,则删除保存目录。接着,它获取当前脚本的路径,并验证其安全性(确保文件名符合特定的模式)。如果当前脚本不符合要求,则调用generate_ddp_file生成一个新的DDP文件。然后,函数构建分布式训练的命令,使用torch.distributed.run或torch.distributed.launch来启动训练,并指定进程数和主端口。

最后,ddp_cleanup函数用于清理临时文件。如果在生成DDP文件时创建了临时文件,该函数会检查文件名中是否包含训练器的ID,并在确认是临时文件后将其删除,以保持文件系统的整洁。

整体来看,这个文件为Ultralytics YOLO的分布式训练提供了必要的工具,确保训练过程中的文件管理和网络配置能够顺利进行。

```python

import os

import torch

import yaml

from ultralytics import YOLO # 导入YOLO模型库

if __name__ == '__main__': # 确保该模块被直接运行时才执行以下代码

# 设置训练参数

workers = 1 # 数据加载的工作进程数

batch = 8 # 每个批次的样本数量

device = "0" if torch.cuda.is_available() else "cpu" # 检查是否有可用的GPU,选择设备

# 获取数据集配置文件的绝对路径

data_path = abs_path(f'datasets/data/data.yaml', path_type='current')

# 读取YAML文件,保持原有顺序

with open(data_path, 'r') as file:

data = yaml.load(file, Loader=yaml.FullLoader)

# 修改数据集路径

if 'train' in data and 'val' in data and 'test' in data:

directory_path = os.path.dirname(data_path.replace(os.sep, '/')) # 获取目录路径

data['train'] = directory_path + '/train' # 更新训练集路径

data['val'] = directory_path + '/val' # 更新验证集路径

data['test'] = directory_path + '/test' # 更新测试集路径

# 将修改后的数据写回YAML文件

with open(data_path, 'w') as file:

yaml.safe_dump(data, file, sort_keys=False)

# 加载YOLO模型配置文件和预训练权重

model = YOLO(r"C:\codeseg\codenew\50+种YOLOv8算法改进源码大全和调试加载训练教程(非必要)\改进YOLOv8模型配置文件\yolov8-seg-C2f-Faster.yaml").load("./weights/yolov8s-seg.pt")

# 开始训练模型

results = model.train(

data=data_path, # 指定训练数据的配置文件路径

device=device, # 使用指定的设备进行训练

workers=workers, # 指定使用的工作进程数

imgsz=640, # 输入图像的大小

epochs=100, # 训练的轮数

batch=batch, # 每个批次的样本数量

)

代码注释说明:

- 导入必要的库:引入操作系统相关的库、PyTorch、YAML解析库以及YOLO模型库。

- 主程序入口:使用

if __name__ == '__main__':确保只有在直接运行该脚本时才执行后续代码。 - 设置训练参数:定义数据加载的工作进程数、批次大小和设备选择(GPU或CPU)。

- 获取数据集配置文件路径:使用

abs_path函数获取数据集配置文件的绝对路径。 - 读取和修改YAML文件:读取YAML文件,更新训练、验证和测试集的路径,并将修改后的内容写回文件。

- 加载YOLO模型:指定模型配置文件和预训练权重,加载YOLO模型。

- 训练模型:调用

model.train方法开始训练,传入数据路径、设备、工作进程数、图像大小、训练轮数和批次大小等参数。```

这个程序文件train.py是一个用于训练 YOLO(You Only Look Once)模型的脚本,主要功能是设置训练参数、加载数据集、配置模型并开始训练。

首先,程序导入了必要的库,包括 os、torch、yaml 和 ultralytics 中的 YOLO 模型。matplotlib 库被导入并设置为使用 TkAgg 后端,这通常用于图形界面的绘图。

在 if __name__ == '__main__': 这一部分,程序首先定义了一些训练参数。workers 设置为 1,表示使用一个工作进程来加载数据;batch 设置为 8,表示每个批次处理 8 张图像。接着,程序检查是否有可用的 GPU,如果有,则将 device 设置为 “0”(表示使用第一个 GPU),否则使用 CPU。

接下来,程序通过 abs_path 函数获取数据集配置文件 data.yaml 的绝对路径,并将路径中的分隔符统一为 Unix 风格的斜杠。然后,程序提取出数据集所在的目录路径。

程序打开 data.yaml 文件并读取其内容。该 YAML 文件包含训练、验证和测试数据集的路径。程序检查是否存在 train、val 和 test 这三个键,如果存在,则将它们的路径修改为相对于数据集目录的路径,并将修改后的内容写回到 YAML 文件中。

在加载模型部分,程序使用指定的配置文件 yolov8-seg-C2f-Faster.yaml 来初始化 YOLO 模型,并加载预训练的权重文件 yolov8s-seg.pt。需要注意的是,不同的模型对设备的要求不同,如果遇到内存不足的错误,可以尝试更换其他模型配置文件。

最后,程序调用 model.train() 方法开始训练模型。该方法的参数包括数据配置文件路径、设备、工作进程数、输入图像大小(640x640)、训练的轮数(100个 epoch)以及每个批次的大小(8)。通过这些设置,程序将开始进行模型的训练过程。

```python

class BaseTransform:

"""

图像变换的基础类。

这个通用的变换类可以根据特定的图像处理需求进行扩展。

该类旨在与分类和语义分割任务兼容。

方法:

__init__: 初始化 BaseTransform 对象。

apply_image: 对标签应用图像变换。

apply_instances: 对标签中的对象实例应用变换。

apply_semantic: 对图像应用语义分割变换。

__call__: 对图像、实例和语义掩码应用所有标签变换。

"""

def __init__(self) -> None:

"""初始化 BaseTransform 对象。"""

pass

def apply_image(self, labels):

"""对标签应用图像变换。"""

pass

def apply_instances(self, labels):

"""对标签中的对象实例应用变换。"""

pass

def apply_semantic(self, labels):

"""对图像应用语义分割变换。"""

pass

def __call__(self, labels):

"""对图像、实例和语义掩码应用所有标签变换。"""

self.apply_image(labels)

self.apply_instances(labels)

self.apply_semantic(labels)

class Mosaic(BaseMixTransform):

"""

马赛克增强。

该类通过将多个(4或9)图像组合成一个马赛克图像来执行马赛克增强。

增强应用于具有给定概率的数据集。

属性:

dataset: 应用马赛克增强的数据集。

imgsz (int, optional): 单个图像的马赛克管道后的图像大小(高度和宽度)。默认为640。

p (float, optional): 应用马赛克增强的概率。必须在0-1范围内。默认为1.0。

n (int, optional): 网格大小,可以是4(2x2)或9(3x3)。

"""

def __init__(self, dataset, imgsz=640, p=1.0, n=4):

"""初始化对象,包含数据集、图像大小、概率和边界。"""

assert 0 <= p <= 1.0, f'概率应在[0, 1]范围内,但得到的是 {p}。'

assert n in (4, 9), '网格必须等于4或9。'

super().__init__(dataset=dataset, p=p)

self.dataset = dataset

self.imgsz = imgsz

self.border = (-imgsz // 2, -imgsz // 2) # 宽度,高度

self.n = n

def get_indexes(self, buffer=True):

"""返回数据集中随机索引的列表。"""

if buffer: # 从缓冲区选择图像

return random.choices(list(self.dataset.buffer), k=self.n - 1)

else: # 选择任何图像

return [random.randint(0, len(self.dataset) - 1) for _ in range(self.n - 1)]

def _mix_transform(self, labels):

"""对标签字典应用 MixUp 或 Mosaic 增强。"""

assert labels.get('rect_shape', None) is None, 'rect 和 mosaic 是互斥的。'

assert len(labels.get('mix_labels', [])), '没有其他图像用于马赛克增强。'

return self._mosaic4(labels) if self.n == 4 else self._mosaic9(labels)

def _mosaic4(self, labels):

"""创建一个 2x2 图像马赛克。"""

mosaic_labels = []

s = self.imgsz

yc, xc = (int(random.uniform(-x, 2 * s + x)) for x in self.border) # 马赛克中心 x, y

for i in range(4):

labels_patch = labels if i == 0 else labels['mix_labels'][i - 1]

img = labels_patch['img']

h, w = labels_patch.pop('resized_shape')

# 将图像放置在 img4 中

if i == 0: # 左上角

img4 = np.full((s * 2, s * 2, img.shape[2]), 114, dtype=np.uint8) # 基础图像,包含4个图块

x1a, y1a, x2a, y2a = max(xc - w, 0), max(yc - h, 0), xc, yc # xmin, ymin, xmax, ymax(大图像)

x1b, y1b, x2b, y2b = w - (x2a - x1a), h - (y2a - y1a), w, h # xmin, ymin, xmax, ymax(小图像)

elif i == 1: # 右上角

x1a, y1a, x2a, y2a = xc, max(yc - h, 0), min(xc + w, s * 2), yc

x1b, y1b, x2b, y2b = 0, h - (y2a - y1a), min(w, x2a - x1a), h

elif i == 2: # 左下角

x1a, y1a, x2a, y2a = max(xc - w, 0), yc, xc, min(s * 2, yc + h)

x1b, y1b, x2b, y2b = w - (x2a - x1a), 0, w, min(y2a - y1a, h)

elif i == 3: # 右下角

x1a, y1a, x2a, y2a = xc, yc, min(xc + w, s * 2), min(s * 2, yc + h)

x1b, y1b, x2b, y2b = 0, 0, min(w, x2a - x1a), min(y2a - y1a, h)

img4[y1a:y2a, x1a:x2a] = img[y1b:y2b, x1b:x2b] # img4[ymin:ymax, xmin:xmax]

padw = x1a - x1b

padh = y1a - y1b

labels_patch = self._update_labels(labels_patch, padw, padh)

mosaic_labels.append(labels_patch)

final_labels = self._cat_labels(mosaic_labels)

final_labels['img'] = img4

return final_labels

def _cat_labels(self, mosaic_labels):

"""返回带有马赛克边界实例剪裁的标签。"""

if len(mosaic_labels) == 0:

return {}

cls = []

instances = []

imgsz = self.imgsz * 2 # 马赛克图像大小

for labels in mosaic_labels:

cls.append(labels['cls'])

instances.append(labels['instances'])

final_labels = {

'im_file': mosaic_labels[0]['im_file'],

'ori_shape': mosaic_labels[0]['ori_shape'],

'resized_shape': (imgsz, imgsz),

'cls': np.concatenate(cls, 0),

'instances': Instances.concatenate(instances, axis=0),

'mosaic_border': self.border} # 最终标签

final_labels['instances'].clip(imgsz, imgsz)

good = final_labels['instances'].remove_zero_area_boxes()

final_labels['cls'] = final_labels['cls'][good]

return final_labels

代码核心部分说明

- BaseTransform 类: 这是一个基础变换类,定义了图像处理的基本接口,包括对图像、实例和语义分割的变换。

- Mosaic 类: 这个类实现了马赛克增强,通过将多个图像组合成一个马赛克图像来增强数据集。它包含生成随机索引、应用变换和更新标签的方法。

- _mosaic4 方法: 该方法实现了 2x2 的马赛克图像生成,计算每个图像在马赛克中的位置,并更新标签信息。

- _cat_labels 方法: 该方法将多个图像的标签合并为一个,确保最终输出的标签包含所有合并后的信息。

这些核心部分是图像增强和数据预处理的重要组成部分,适用于目标检测和图像分割任务。```

这个程序文件ultralytics\data\augment.py主要用于实现图像增强的功能,尤其是在目标检测和图像分类任务中。文件中定义了多个类和方法,用于对图像进行各种变换和增强,以提高模型的鲁棒性和泛化能力。

首先,文件中引入了一些必要的库,包括数学运算、随机数生成、OpenCV、NumPy、PyTorch等。接着,定义了一个基类BaseTransform,该类为图像变换提供了基础框架,包含了初始化方法和应用不同类型变换的方法。具体的图像变换类将继承这个基类。

接下来,Compose类用于将多个图像变换组合在一起。它接收一个变换列表,并在调用时依次应用这些变换。这种设计使得用户可以灵活地定义变换的顺序和组合。

BaseMixTransform类是一个用于实现混合增强(如MixUp和Mosaic)的基类。它接收数据集、预处理变换和应用概率作为参数,并定义了如何获取随机索引和应用混合变换的方法。Mosaic和MixUp类继承自BaseMixTransform,分别实现了马赛克增强和MixUp增强的具体逻辑。

Mosaic类通过将多个图像组合成一个马赛克图像来增强数据。它支持4个或9个图像的组合,并在合成过程中更新标签信息。MixUp类则通过对两张图像进行加权平均来生成新的图像,从而实现数据增强。

RandomPerspective类实现了随机透视变换和仿射变换,可以对图像及其对应的边界框、分割和关键点进行变换。它允许用户设置旋转、平移、缩放、剪切和透视失真等参数。

RandomHSV类负责对图像的色调、饱和度和亮度进行随机调整,以增加图像的多样性。RandomFlip类则实现了随机翻转图像的功能,支持水平和垂直翻转,并相应地更新实例的边界框和关键点。

LetterBox类用于调整图像大小并添加边框,以适应目标检测模型的输入要求。它可以保持图像的纵横比,并在需要时进行填充。

CopyPaste类实现了一种增强方法,通过将一个图像的实例复制到另一个图像上,从而生成新的训练样本。Albumentations类则提供了一系列图像增强操作,利用Albumentations库进行更复杂的变换。

最后,Format类用于格式化图像注释,以便在PyTorch的DataLoader中使用。它可以将边界框、分割和关键点的格式标准化,并返回适合模型输入的图像和标签。

文件还包含了一些用于分类任务的变换函数,如classify_transforms和classify_albumentations,这些函数定义了在分类任务中应用的图像预处理和增强操作。

总体而言,这个文件为图像增强提供了丰富的功能,支持多种变换和组合方式,旨在提高模型在不同任务中的表现。

```python

# 导入Ultralytics YOLO模块所需的组件

from .block import * # 导入模块中的块(block)相关功能

from .conv import * # 导入卷积(conv)相关功能

from .head import * # 导入头部(head)相关功能

from .transformer import * # 导入变换器(transformer)相关功能

代码注释说明:

-

模块导入:

- 这段代码的主要功能是导入Ultralytics YOLO模型所需的各个模块。每个模块负责不同的功能,以便于构建和训练YOLO模型。

-

具体模块:

block:通常包含模型中的基本构建块,比如卷积层、激活函数等。conv:专门处理卷积操作的模块,可能包含不同类型的卷积层实现。head:通常是模型的输出部分,负责将特征图转换为最终的预测结果,比如边界框和类别概率。transformer:可能用于处理输入数据的变换,或者实现某种形式的注意力机制。

通过这些模块的组合,Ultralytics YOLO能够实现高效的目标检测任务。```

这个程序文件是Ultralytics YOLO(一个目标检测模型)的模块初始化文件,遵循AGPL-3.0许可证。文件的主要功能是导入和组织不同的模块,以便在其他地方使用。

文件开头的注释部分提供了一个示例,展示了如何使用这些模块。示例中首先导入了必要的库,包括ultralytics.nn.modules和torch,并且还使用了os库来执行系统命令。接着,创建了一个形状为(1, 128, 40, 40)的张量x,这个张量通常用于神经网络的输入。

然后,示例中实例化了一个卷积层Conv,输入和输出通道数均为128。接下来,定义了一个文件名f,用于保存导出的ONNX模型。通过torch.onnx.export函数,将模型m和输入张量x导出为ONNX格式,并保存到文件中。

最后,使用os.system命令调用onnxsim工具对导出的ONNX模型进行优化,并尝试打开生成的文件。

在文件的最后部分,使用相对导入的方式引入了多个模块,包括block、conv、head和transformer。这些模块可能包含了YOLO模型的不同组件,如卷积层、头部结构和变换器等。

总的来说,这个文件的作用是为Ultralytics YOLO模型提供模块化的结构,方便用户在构建和训练模型时进行导入和使用。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式

更多推荐

已为社区贡献92条内容

已为社区贡献92条内容

所有评论(0)