【四足机器人】最大熵强化学习与CPG耦合:四足机器人步态控制的原理与实现

本文针对四足机器人运动控制的高维非线性难题,提出结合深度强化学习(SAC)与中枢模式发生器(CPG)的混合控制框架。系统采用SAC学习环境状态到CPG参数的映射策略,通过Hopf振荡器生成节律性运动模式,再经逆运动学转换为关节控制命令,形成高效稳定的闭环控制。重点阐述了SAC×CPG的理论基础、架构设计及关键实现方法,包括最大熵强化学习框架、CPG数学模型和分层控制系统设计,有效提升了样本效率和运

·

四足机器人(Quadruped)运动控制具有高维非线性、接触不确定与地形多样等挑战。深度强化学习(DRL) 能端到端学习复杂策略,但在高维连续控制中往往需要大量数据和良好的先验。中枢模式发生器(CPG) 提供 低维、节律化的运动先验,将两者结合可显著提升样本效率与稳定性。本文系统阐释SAC×CPG的理论与工程实践,并给出关键公式与推导。

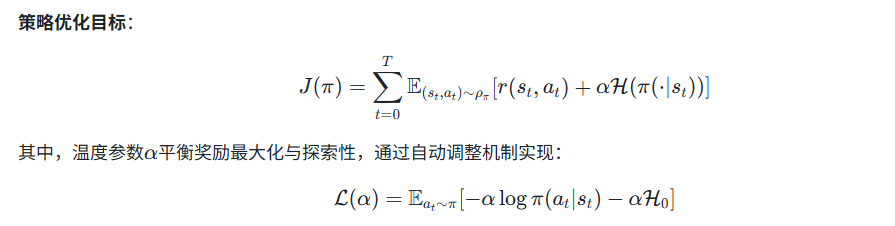

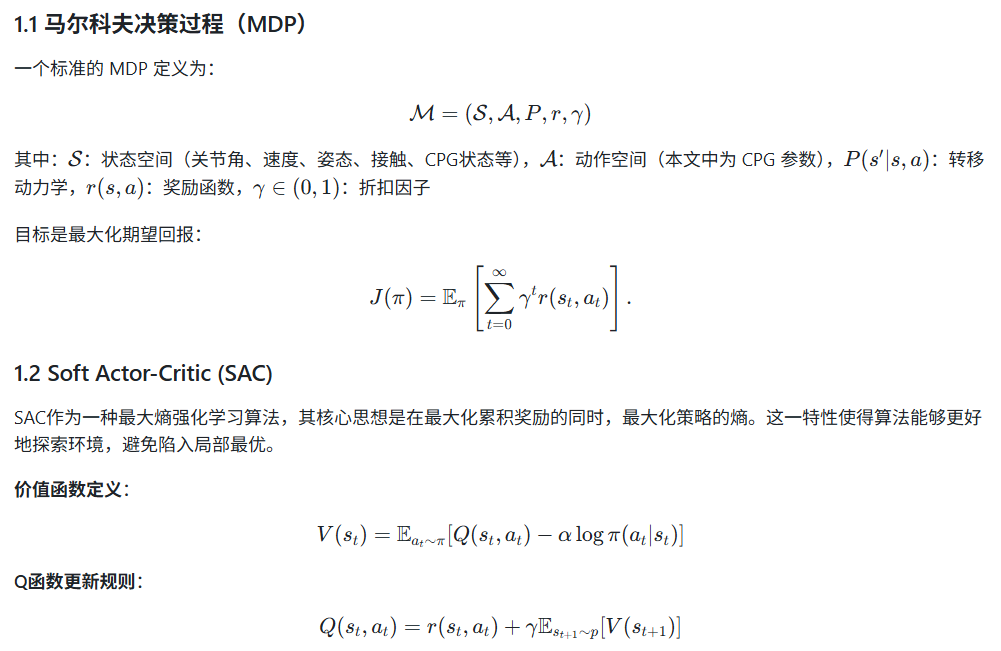

1. 强化学习与最大熵框架

2. 中枢模式发生器(CPG)与Hopf振荡器

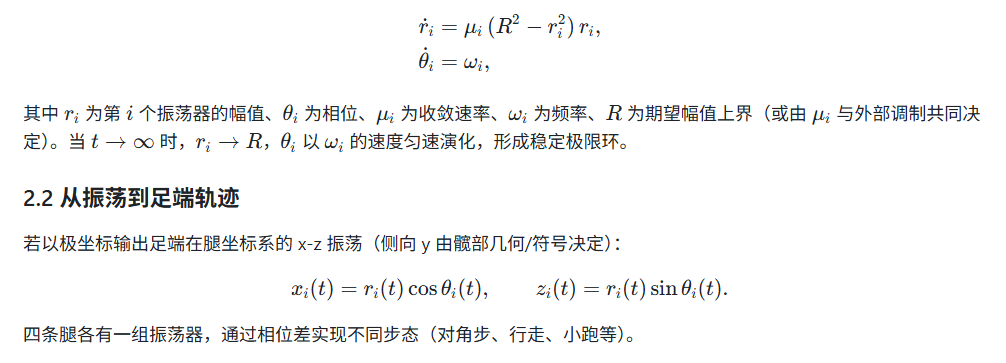

2.1 基本方程

常用的 Hopf 振荡器 模型:

3. SAC × CPG 的总体架构

在本系统中,SAC 的 Actor 并不直接输出 12 个关节扭矩,而是输出 低维 CPG 参数。然后通过 Hopf 振荡器 更新得到足端轨迹,再经 IK/PD 生成关节扭矩。整个系统形成一个稳定的闭环。

- 高层决策层:SAC算法学习环境状态到CPG参数调制的映射策略

- 底层执行层:CPG网络生成节律性运动模式

- 运动控制层:将CPG输出转换为具体的关节控制命令

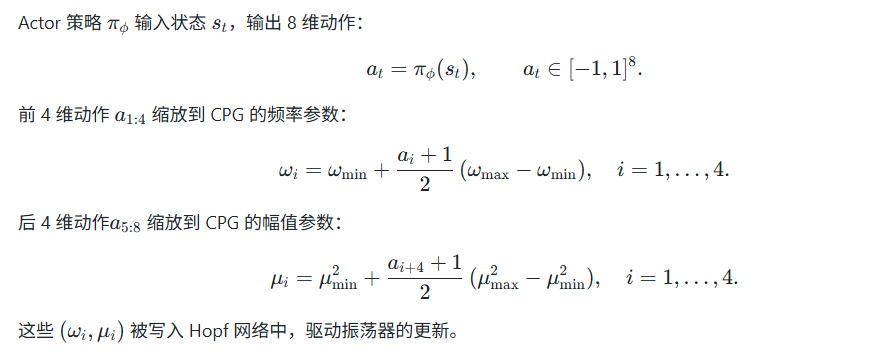

3.1 策略到 CPG 参数的映射

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)