循环神经网络RNN与长短期记忆网络LSTM(理论篇)

摘要:循环神经网络(RNN)通过链式连接节点处理序列数据,具有记忆更新和权重共享特性。长短期记忆网络(LSTM)引入输入门、遗忘门和输出门解决长期依赖问题。

1.循环神经网络(RNN)

循环神经网络(RecurrentNeuralNetwork,RNN)是一类以序列数据为输入,在序列演进方向进行递归且所有节点按链式连接的递归神经网络。可以把RNN想象成一个会“记忆”的接力选手,序列数据就像接力棒,选手在每一次接棒(处理当前数据)时,都会参考之前的记忆(之前处理的数据信息),而所有选手之间手拉手(节点链式连接),传递和更新这个“记忆”,它具有权重共享特性,就好比每个选手都使用同一套接力技巧,这使得一个完全连接的循环神经网络理论上可以近似解决所有可计算问题。并且它具有记忆更新特性,即由上一时刻的隐含状态(上一棒选手的状态)和本时刻的输入(当前接力棒的情况)共同更新新的记忆(当前选手的状态)。

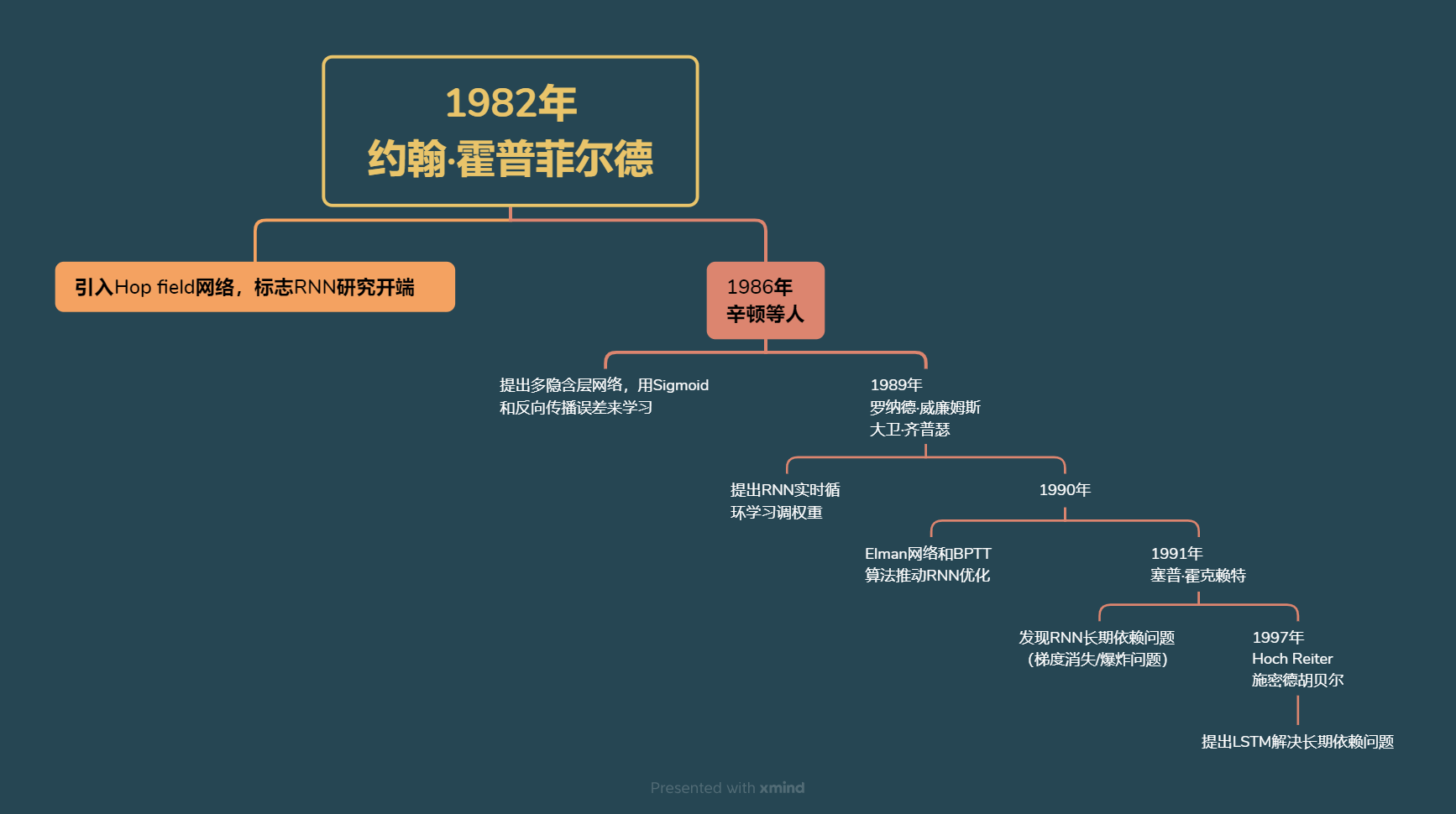

发展历程:

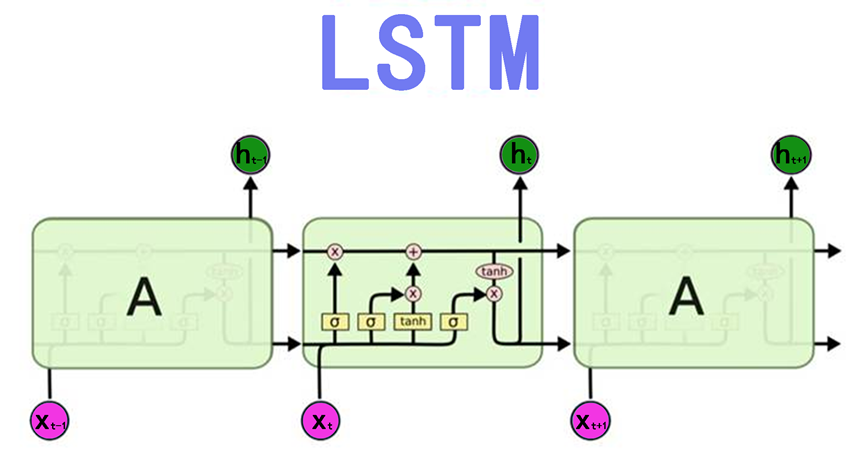

2.长短期记忆网络(LSTM)

长短期记忆网络(LSTM)通过引入输入门、遗忘门和输出门来控制信息的流动,这就像给 “记忆” 装上了三个智能阀门。输入门决定哪些新信息可以进入 “记忆仓库”,遗忘门决定哪些旧信息需要被清理出去,输出门决定哪些信息可以被拿出来使用,有效解决了长期依赖问题,扩展了 RNN 的应用场景。双向循环神经网络(bidirectionalrecurrentneuralnetworks,BRNN)也在这一时期出现,它由两层循环神经网络组成,输入相同但信息传递方向相反,就像让两组接力选手同时从起点和终点出发,能同时利用过去和未来的信息解决当前问题。

发展历程:

2010年,RNN在语言建模、机器翻译、数据压缩和语音识别等领域展现出显著能力,进入新的发展阶段。

2014年,KyunghyunCho等人提出门控循环网络(gatedrecurrentunits,GRU),同年艾利克斯・格雷夫斯等人在神经图灵机(neuralturingmachine,NTM)方面的工作提升了RNN的学习表现。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)