风格迁移--当照片遇见梵高:用神经网络重构艺术风格的深度之旅

神经风格迁移技术的演进,展现了深度学习理解与创造视觉艺术的惊人能力。从最初需要数分钟迭代的优化方法,到如今可以实时处理任意风格的轻量模型,技术正在不断突破边界。但更重要的是,这项技术正在改变艺术创作的方式。艺术家不再需要从零开始模仿梵高的笔触——他们可以将精力集中在构图、情感表达等更具创造性的层面,而将风格实现交给算法。这是工具与创作者的完美协作:AI负责“如何画”,人类决定“画什么”。当你下次拿

引言:一场技术与艺术的邂逅

想象一下,你随手拍下的一张街景照片,经过算法的魔法,瞬间变成了梵高笔下的《星夜》——天空中涌动着旋涡状的云彩,柏树如火焰般燃烧,整个画面充满了流动的笔触与强烈的情感。这并非科幻电影的场景,而是过去十年间计算机视觉领域最迷人的成就之一:神经风格迁移。

2015年,当德国图宾根大学的Gatys等人发表《A Neural Algorithm of Artistic Style》时,他们或许没有预料到,这项技术将开启人工智能与艺术创作融合的新纪元。从此,深度神经网络不仅能够“识别”图像中的物体,更能够“理解”并“重构”艺术的灵魂——风格。

本文将带领读者深入探索这项技术的核心原理,从最初的优化方法到最新的扩散模型应用,并手把手教你如何用代码将普通照片转化为梵高风格的杰作。

一:风格的密码——神经网络如何理解艺术

1.1 从像素到感知

要理解神经风格迁移,我们首先需要回答一个根本性问题:什么是“风格”?对观者而言,梵高的风格是他那标志性的旋涡笔触、高饱和度的色彩搭配,以及画面中涌动的生命力。但对计算机而言,这一切必须转化为可量化的数学表达。

传统计算机视觉方法试图通过纹理合成算法来捕捉风格——例如分析局部像素块的统计规律。但这种方法如同盲人摸象,只能捕捉到表面的纹理重复,却无法理解风格背后复杂的语义结构。真正的突破来自卷积神经网络(CNN)的崛起。

1.2 VGG网络的双重角色

预训练的图像分类网络(如VGG-19)成为解开风格密码的钥匙。这类网络在ImageNet数据集上经过数百万张图像的训练,已经学会了从像素中提取层次化的视觉特征:

-

浅层网络(如第一个卷积层)对边缘、颜色块等低级特征敏感

-

中层网络开始响应纹理模式,如梵高笔触的重复单元

-

深层网络则捕捉高级语义——画面中的物体、场景结构

研究者们发现一个关键事实:内容主要存在于深层特征中,而风格则分布在所有层级的特征相关性中。正是这一发现,使得内容与风格的分离与重组成为可能。

1.3 格拉姆矩阵:风格的数学指纹

如何量化“风格”?答案藏在一个优雅的数学工具中:格拉姆矩阵(Gram Matrix)。

假设我们从VGG网络的某一层提取出特征图,其形状为(C, H, W),其中C是通道数(如64或128),H和W是特征图的高宽。格拉姆矩阵的计算如下:

-

将特征图重塑为(C, H×W)的矩阵

-

将该矩阵与其转置相乘,得到C×C的格拉姆矩阵

-

对矩阵元素除以C×H×W进行归一化

这个C×C矩阵中的每个元素,代表两个不同特征通道之间的相关性。直观理解:如果一个通道负责检测“橙色”,另一个通道负责检测“旋涡状纹理”,那么它们在梵高画作中同时出现的频率就编码在格拉姆矩阵中。

因此,格拉姆矩阵捕捉的是特征之间的共生关系——这正是纹理与风格的数学本质。将目标风格的格拉姆矩阵应用到内容图像上,就相当于强迫内容图像的特征也表现出相同的统计相关性。

二:从理论到实践——风格迁移的三次革命

2.1 第一次革命:基于优化的方法

Gatys等人最初提出的方法本质上是一个优化问题。我们需要生成一张图像G,使得:

-

G的内容特征与内容图像C接近(内容损失)

-

G的风格特征(由多层格拉姆矩阵表示)与风格图像S接近(风格损失)

总损失函数可表示为:

Ltotal=αLcontent(C,G)+βLstyle(S,G)Ltotal=αLcontent(C,G)+βLstyle(S,G)

其中α和β是控制内容-风格平衡的超参数。

这一方法的实现流程如下:

python

# 伪代码:基于优化的风格迁移

def style_transfer(content_img, style_img, num_iterations=1000):

# 初始化生成图像(可用内容图像副本或随机噪声)

generated = content_img.clone().requires_grad_(True)

# 加载预训练VGG并提取特征

vgg = models.vgg19(pretrained=True).features

content_features = extract_features(vgg, content_img, content_layers)

style_features = extract_features(vgg, style_img, style_layers)

style_grams = {layer: gram_matrix(feat) for layer, feat in style_features.items()}

# 定义优化器

optimizer = torch.optim.LBFGS([generated], lr=1.0)

for i in range(num_iterations):

def closure():

optimizer.zero_grad()

gen_features = extract_features(vgg, generated, content_layers + style_layers)

# 计算内容损失

c_loss = 0

for layer in content_layers:

c_loss += F.mse_loss(gen_features[layer], content_features[layer])

# 计算风格损失

s_loss = 0

for layer in style_layers:

gen_gram = gram_matrix(gen_features[layer])

s_loss += F.mse_loss(gen_gram, style_grams[layer])

# 总损失

total_loss = alpha * c_loss + beta * s_loss

total_loss.backward()

return total_loss

optimizer.step(closure)

return generated

这一方法的优点是质量极高,能够忠实再现复杂的艺术风格。但缺点同样明显:生成一张图像需要数百次迭代,耗时数分钟甚至更久,难以实用。

2.2 第二次革命:快速前馈网络

2016年,Johnson等人提出了突破性的解决方案:训练一个前馈网络直接完成风格迁移。核心思想是:

-

训练阶段:固定风格图像,训练一个图像转换网络(通常采用编码器-转换器-解码器架构)

-

推理阶段:输入任意内容图像,网络单次前向传播即可输出风格化结果

这一架构通常包含三个部分:

-

编码器:下采样提取多尺度特征

-

转换器:多个残差块进行特征变换

-

解码器:上采样重建图像

损失函数设计也更为复杂:除了内容损失和风格损失,还加入总变分损失(TV Loss)抑制噪声,以及感知损失(Perceptual Loss)提升视觉质量。

快速前馈网络的推理速度可达毫秒级,真正实现了实时风格迁移。代价是:每个风格需要单独训练一个网络,灵活性受限。

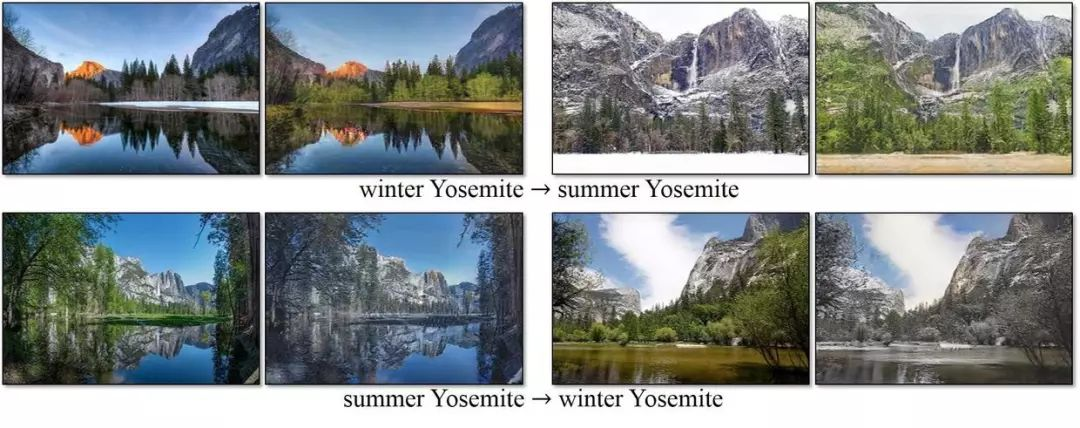

2.3 第三次革命:任意风格迁移

理想的应用场景是:用一个模型支持任意风格的迁移。Huang等人提出的自适应实例归一化(AdaIN)实现了这一愿景。

AdaIN的核心洞察来自对特征统计量的观察。研究发现,卷积特征图的均值和方差编码了图像的风格信息。因此,将内容特征的统计量对齐到风格特征的统计量,即可实现风格迁移:

python

def adain(content_features, style_features):

# 计算内容特征的均值和标准差

c_mean = content_features.mean(dim=[2, 3], keepdim=True)

c_std = content_features.std(dim=[2, 3], keepdim=True)

# 计算风格特征的均值和标准差

s_mean = style_features.mean(dim=[2, 3], keepdim=True)

s_std = style_features.std(dim=[2, 3], keepdim=True)

# 归一化内容特征,再缩放至风格特征的统计量

normalized = (content_features - c_mean) / (c_std + 1e-5)

return normalized * s_std + s_mean

这一简单的特征变换操作,使单一网络能够实时处理任意风格,极大提升了实用价值。

三:梵高风格的秘密——从理论到创作

3.1 梵高的视觉语言

要将照片转化为梵高风格,我们首先需要理解梵高风格的视觉元素:

-

笔触纹理:短促、扭曲的线条,形成旋涡状或火焰状图案

-

色彩特征:高饱和度的黄、蓝、绿色彩,强烈的互补色对比

-

光影处理:非自然的光源分布,用色彩明度而非阴影表达体积

-

情感表达:画面充满动感与张力,反映艺术家内心的情感波动

在神经风格迁移中,这些元素通过多层特征的格拉姆矩阵被捕捉和再现。浅层网络负责笔触纹理的迁移,中层网络处理图案重复模式,深层网络则确保整体视觉概念的协调。

3.2 实践指南:用PyTorch实现梵高风格迁移

下面是一个完整的实现流程,我们将使用预训练的VGG-19网络,将普通照片转化为梵高《星夜》风格。

环境准备

python

import torch

import torch.nn as nn

import torch.optim as optim

import torchvision.transforms as transforms

import torchvision.models as models

from PIL import Image

import matplotlib.pyplot as plt

import copy

import numpy as np

# 检查GPU可用性

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(f"使用设备: {device}")

图像预处理

python

# 图像加载与预处理

def load_image(image_path, max_size=512):

image = Image.open(image_path).convert('RGB')

# 调整尺寸

if max(image.size) > max_size:

ratio = max_size / max(image.size)

new_size = tuple(int(dim * ratio) for dim in image.size)

image = image.resize(new_size, Image.Resampling.LANCZOS)

# 转换为tensor并归一化

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225])

])

image = transform(image).unsqueeze(0)

return image.to(device)

# 图像反归一化(用于显示)

def denormalize(tensor):

mean = torch.tensor([0.485, 0.456, 0.406]).to(device)

std = torch.tensor([0.229, 0.224, 0.225]).to(device)

tensor = tensor.clone().detach()

for t, m, s in zip(tensor[0], mean, std):

t.mul_(s).add_(m)

return tensor.clamp(0, 1)

# 加载内容和风格图像

content = load_image("your_photo.jpg") # 你的照片

style = load_image("starry_night.jpg") # 梵高《星夜》

模型与特征提取

python

class StyleTransferModel:

def __init__(self):

# 加载预训练的VGG-19

vgg = models.vgg19(pretrained=True).features.to(device).eval()

# 冻结参数

for param in vgg.parameters():

param.requires_grad = False

self.vgg = vgg

# 定义用于内容和风格的特征层

self.content_layers = ['conv_4_2'] # 内容特征层

self.style_layers = ['conv_1_1', 'conv_2_1', 'conv_3_1',

'conv_4_1', 'conv_5_1'] # 风格特征层

# 记录各层名称

self.layer_names = []

layer_name = None

conv_count = 1

relu_count = 1

for layer in self.vgg:

if isinstance(layer, nn.Conv2d):

layer_name = f'conv_{conv_count}_{relu_count}'

self.layer_names.append(layer_name)

elif isinstance(layer, nn.ReLU):

layer_name = f'relu_{conv_count}_{relu_count}'

relu_count += 1

elif isinstance(layer, nn.MaxPool2d):

layer_name = f'pool_{conv_count}'

conv_count += 1

relu_count = 1

def get_features(self, x, layers):

"""提取指定层的特征"""

features = {}

for name, layer in zip(self.layer_names, self.vgg):

x = layer(x)

if name in layers:

features[name] = x

if name == self.content_layers[0]:

break

return features

def gram_matrix(self, x):

"""计算格拉姆矩阵"""

b, c, h, w = x.size()

features = x.view(b, c, h * w)

gram = torch.bmm(features, features.transpose(1, 2))

return gram / (c * h * w)

# 初始化模型

model = StyleTransferModel()

损失函数与优化

python

def train_style_transfer(content, style, num_steps=500,

style_weight=1e6, content_weight=1):

"""执行风格迁移训练"""

# 提取内容和风格的特征(一次计算,重复使用)

content_features = model.get_features(content, model.content_layers)

style_features = model.get_features(style, model.style_layers)

# 计算风格的格拉姆矩阵

style_grams = {}

for layer in model.style_layers:

style_grams[layer] = model.gram_matrix(style_features[layer])

# 初始化生成图像(使用内容图像的副本)

generated = content.clone().requires_grad_(True)

# 定义优化器

optimizer = optim.LBFGS([generated], lr=1.0, max_iter=1)

# 训练循环

for step in range(num_steps):

def closure():

optimizer.zero_grad()

# 提取生成图像的特征

gen_features = model.get_features(generated,

model.content_layers + model.style_layers)

# 计算内容损失

c_loss = 0

for layer in model.content_layers:

c_loss += nn.MSELoss()(gen_features[layer],

content_features[layer])

# 计算风格损失

s_loss = 0

for layer in model.style_layers:

gen_gram = model.gram_matrix(gen_features[layer])

s_loss += nn.MSELoss()(gen_gram, style_grams[layer])

# 总损失

total_loss = content_weight * c_loss + style_weight * s_loss

total_loss.backward()

if step % 50 == 0:

print(f'Step {step}: Content Loss={c_loss.item():.4f}, '

f'Style Loss={s_loss.item():.4f}')

return total_loss

optimizer.step(closure)

return generated

# 执行训练(根据你的GPU内存调整步数)

result = train_style_transfer(content, style, num_steps=300)

# 显示结果

plt.figure(figsize=(15, 5))

plt.subplot(1, 3, 1)

plt.imshow(denormalize(content).cpu().squeeze().permute(1, 2, 0))

plt.title('内容图像(你的照片)')

plt.axis('off')

plt.subplot(1, 3, 2)

plt.imshow(denormalize(style).cpu().squeeze().permute(1, 2, 0))

plt.title('风格图像(梵高星夜)')

plt.axis('off')

plt.subplot(1, 3, 3)

plt.imshow(denormalize(result).cpu().squeeze().permute(1, 2, 0))

plt.title('生成图像(风格迁移结果)')

plt.axis('off')

plt.tight_layout()

plt.show()

3.3 参数调优的艺术

在风格迁移实践中,参数调整对最终效果至关重要:

-

风格权重(style_weight):典型取值范围1e5-1e8。权重越高,风格化越强烈,但可能牺牲内容可识别性

-

内容层选择:通常使用conv4_2作为内容层。使用更浅的层会保留更多细节(如面部特征),但风格化效果减弱

-

多尺度策略:先从低分辨率开始优化,逐步上采样细化,可大幅提升收敛速度和质量

四:前沿探索——风格迁移的现在与未来

4.1 注意力机制的革新

传统的风格迁移方法往往难以处理复杂场景,容易导致内容结构扭曲或局部风格不匹配。近年来的注意力机制方法试图解决这一问题。

CSPANet(Cross-Route Statistical Partition Attention Network)是这一方向的最新突破。该方法通过交叉路径统计分区注意力机制,能够更好地捕捉风格图像的局部细节与全局视觉概念。其核心创新包括:

-

统计分区注意力迁移器(SPAM):先通过白化和着色变换迁移色彩与纹理,再通过注意力权重矩阵实现像素级的风格语义匹配

-

细节感知跳跃连接(DSC):动态将编码器的浅层信息注入解码器,保留内容图像的细节结构

实验表明,CSPANet在保持内容结构完整性的同时,能更真实地再现复杂艺术风格的纹理细节。

4.2 扩散模型的崛起

扩散模型(Diffusion Models)正在改变图像生成的格局,风格迁移领域也不例外。基于扩散的方法通过逐步去噪的过程,能够更自然地融合内容与风格。

与传统的单步优化不同,扩散模型的反向过程可以逐步引入风格约束,在保持内容结构的同时实现细腻的风格化。结合预训练的大型模型(如Stable Diffusion),甚至可以实现文本引导的风格迁移——只需输入“梵高星夜风格”的描述,即可获得风格化结果。

4.3 3D与视频风格迁移

风格迁移正从2D图像走向3D空间与时间维度。4DStyleGaussian将3D高斯泼溅技术引入风格迁移,实现了动态场景的实时风格化,同时保持多视角一致性和时间连续性。

这项技术的核心在于将风格特征嵌入到4D高斯点云中,通过可逆神经网络保留内容信息,再通过4D风格变换矩阵确保空间与时间的一致性。未来,我们或许能实时将整个电影片段转化为特定艺术风格,而无需逐帧处理。

结语:艺术家与AI的共创时代

神经风格迁移技术的演进,展现了深度学习理解与创造视觉艺术的惊人能力。从最初需要数分钟迭代的优化方法,到如今可以实时处理任意风格的轻量模型,技术正在不断突破边界。

但更重要的是,这项技术正在改变艺术创作的方式。艺术家不再需要从零开始模仿梵高的笔触——他们可以将精力集中在构图、情感表达等更具创造性的层面,而将风格实现交给算法。这是工具与创作者的完美协作:AI负责“如何画”,人类决定“画什么”。

当你下次拿起手机拍下一张照片,不妨试试将它转化为梵高或莫奈的风格。在那一刻,你正在见证并参与一场静默的艺术革命——当代码遇见画布,当算法邂逅灵感,新的可能性正在无限展开。

参考文献

[1] Zhang et al. CSPANet: Cross-route statistical partition attention network for style transfer. Neurocomputing, 2025.

[2] 深度剖析:图像风格迁移技术全览与实践指南. 百度开发者中心, 2025.

[3] 扩散模型实现风格迁移图像到艺术作品的生成技术. 华为云社区, 2025.

[4] 深度学习赋能艺术:图像风格迁移技术解析与实践. 百度开发者中心, 2025.

[5] 基于PyTorch的迁移学习:深度解析风格迁移技术实践. 百度智能云, 2025.

[6] Liang et al. 4DStyleGaussian: Generalizable 4D style transfer with Gaussian splatting. Pattern Recognition, 2025.

[7] 深度解析:图像风格迁移技术原理与应用实践. 百度开发者中心, 2025.

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)