车道线检测小结

车道线检测技术面临光照变化、道路多样性、遮挡等复杂挑战。传统方法依赖手工特征(如边缘检测、霍夫变换),在结构化道路表现尚可但泛化性差。深度学习方法展现出更强适应性:Ultra-Fast系列通过行/列锚点建模车道线位置;YOLOP实现多任务联合感知;CondLaneNet和CLRNet(未展开)进一步优化检测精度。当前技术路线正从单一检测向多模态融合演进,但实时性、复杂场景鲁棒性仍是核心突破方向。(

一、介绍

这里考虑通过相机传感器即计算机视觉来进行检测。

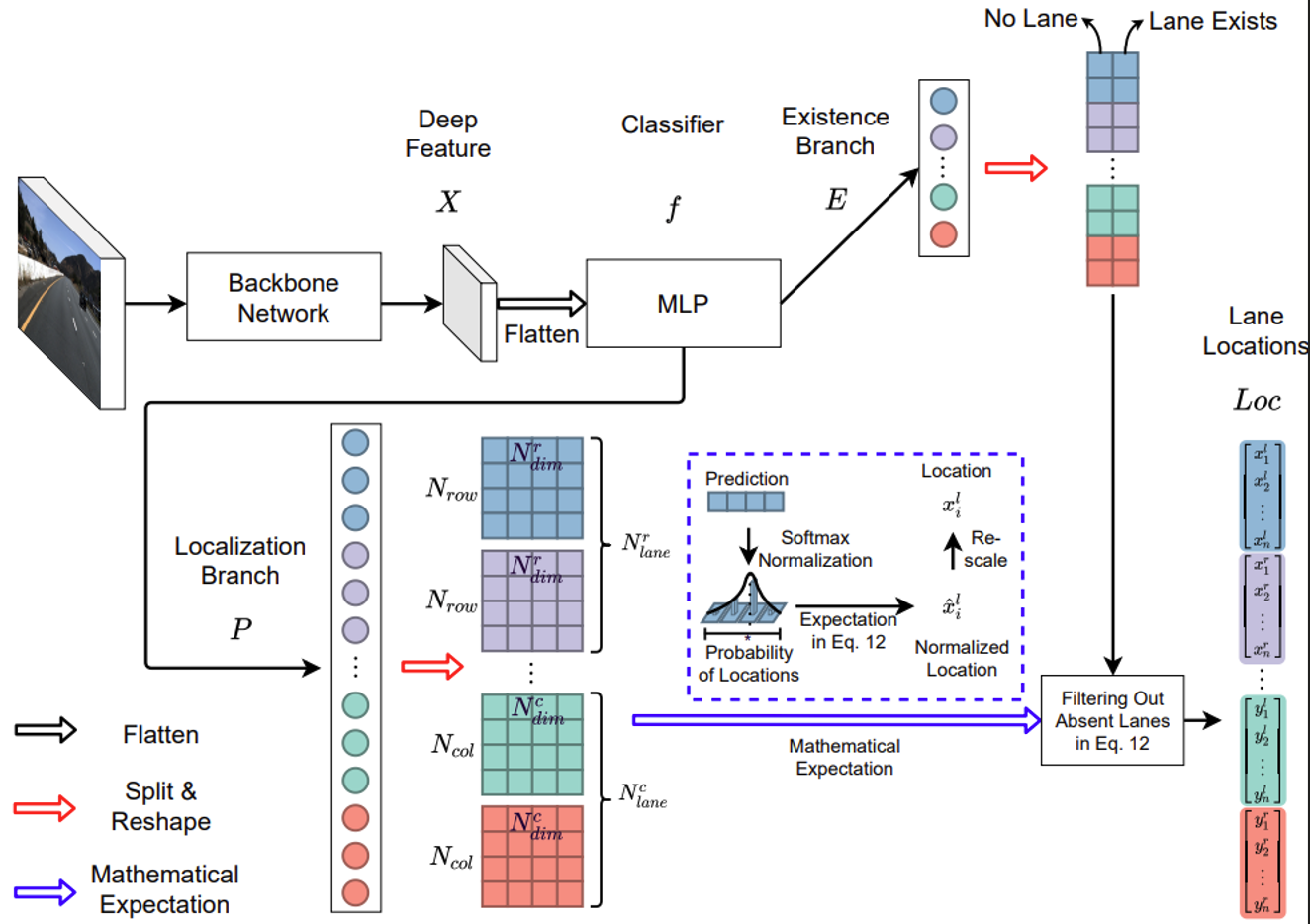

(摘自Ultra-Fast-Lane-Detection-v2的网络架构示意图)

检测过程中难点问题:

(1)光照变化:日照强度的变化、阴影、反光等都可能导致车道线难以检测。例如,在太阳直射或低日照条件下,车道线的可见性会大大降低。

(2)道路材料和颜色的多样性:不同的道路可能使用不同的材料或颜色来标记车道线,这增加了检测的复杂性。

(3)遮挡问题:其他车辆、行人或其他物体可能会遮挡车道线,特别是在交通繁忙的路段。

道路磨损和老化:随着时间的推移,**车道线可能会因磨损、污渍或其他因素而变得模糊或不清晰。

(4)复杂的道路几何形状:例如,弯道、交叉口和分叉路口可能导致车道线形状的快速变化。

(5)道路条件变化:雨、雪或冰可能会改变车道线的外观或完全遮盖车道线。

(6)近似并行的非车道线:如路边的缝隙、道路维修标记或其他临时标记可能被误识别为车道线。

(7)视角和相机校准:摄像机的位置、角度或校准可能会影响到车道线的检测。

(8)实时性要求:在自动驾驶或驾驶辅助系统中,车道线检测需要实时进行,这对算法的效率提出了挑战。

(8)多车道和交叉车道的处理:在多车道道路或交叉口,车道线的数量、方向和模式变得更加复杂。

(9)与其他道路标记的区分:需要将车道线与其他道路标记(如行人横道、停车区域等)区分开。

参考:车道线检测综述(难点/数据集/主要方案/后处理)-CSDN博客![]() https://blog.csdn.net/CV_Autobot/article/details/133224432

https://blog.csdn.net/CV_Autobot/article/details/133224432

(29 封私信 / 80 条消息) 2D车道线检测方法总结 - 知乎![]() https://zhuanlan.zhihu.com/p/658137874

https://zhuanlan.zhihu.com/p/658137874

二、传统方法

传统算法基于手工设计调节的特征(如边缘检测、霍夫变换、RANSAC等),在结构化道路(如高速公路)上表现尚可,但在光照变化、遮挡、弯曲道路等复杂场景下鲁棒性较差。其优势在于计算开销低、不依赖大规模标注数据。

(应用场景受限)

【快车道线检测项目】项目学习总结 - 逍遥划水真君 - 博客园![]() https://www.cnblogs.com/zkChange/p/18731542

https://www.cnblogs.com/zkChange/p/18731542

检测效果:

==》实现步骤

(1)颜色筛选

(2)边缘检测

(3)检测区域筛选

(4)霍夫变化获取车道线位置进行绘制

三、深度学习

深度学习车道线检测方法可分为基于分割、基于检测、基于关键点、基于曲线四类。

(1)Ultra-Fast-Lane-Detection

参考:https://github.com/cfzd/Ultra-Fast-Lane-Detection![]() https://github.com/cfzd/Ultra-Fast-Lane-Detection

https://github.com/cfzd/Ultra-Fast-Lane-Detection

(29 封私信 / 80 条消息) (五十九)通俗易懂理解——UFLD超快车道线检测原理 - 知乎![]() https://zhuanlan.zhihu.com/p/608421808

https://zhuanlan.zhihu.com/p/608421808

UFLD(Ultra-Fast-Lane-Detection)将车道线检测建模为 “基于行方向的分类” 问题,而非传统的像素级分割。它将图像划分为多个行(row),模型只需预测每一行中车道线最可能出现的列位置。

检测效果:

(2)Ultra-Fast-Lane-Detection-v2

Ultra-Fast-Lane-Detection-v2:Ultra Fast Deep Lane Detection With Hybrid Anchor Driven Ordinal Classification (TPAMI 2022) - AtomGit | GitCode![]() https://gitcode.com/gh_mirrors/ul/Ultra-Fast-Lane-Detection-v2/?utm_source=gitcode_aigc_v1_t1&index=bottom&type=card&&uuid_tt_dd=10_30855585570-1765685666449-329195&isLogin=1&from_id=141374188&from_link=70208530a298d6729afaed12c4ad5eff#%E5%8F%AF%E8%A7%86%E5%8C%962206.07389

https://gitcode.com/gh_mirrors/ul/Ultra-Fast-Lane-Detection-v2/?utm_source=gitcode_aigc_v1_t1&index=bottom&type=card&&uuid_tt_dd=10_30855585570-1765685666449-329195&isLogin=1&from_id=141374188&from_link=70208530a298d6729afaed12c4ad5eff#%E5%8F%AF%E8%A7%86%E5%8C%962206.07389![]() https://arxiv.org/pdf/2206.07389

https://arxiv.org/pdf/2206.07389

UFLD方法虽然在直道和当前车道表现优异,但在弯道和侧车道上,定位误差会被放大。V2的解决方案是引入混合锚点(Hybrid Anchor) 系统,也就是用行锚(Row Anchor)和列锚(Column Anchor)共同来表示车道线。

检测效果:

(3)YOLOP(You Only 👀 Once for Panoptic 🚗 Perception)

参考:基于yolov5的车道线检测及安卓部署_车道线检测yolov5代码-CSDN博客

GitHub - hustvl/YOLOP:全景驾驶感知只需查找一次。(MIR2022) ·GitHub![]() https://github.com/hustvl/YOLOP

https://github.com/hustvl/YOLOP

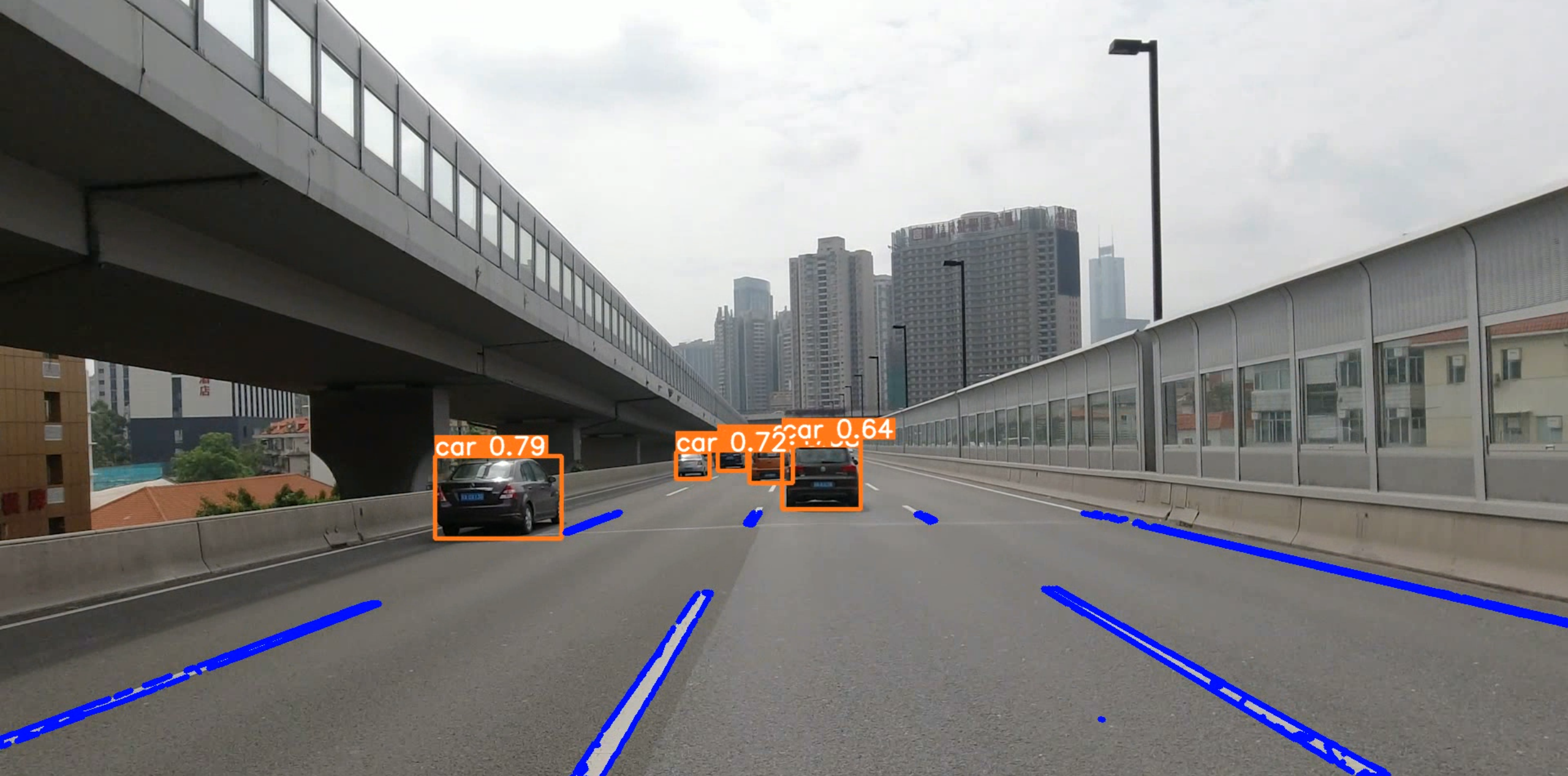

通过多任务学习,构建神经网络,在模型中端到端地完成三项任务:识别车辆行人、识别可通行区域、识别分割车道线。

检测效果:

(4) CondLaneNet

参考:(30 封私信 / 80 条消息) CondLaneNet|使用动态卷积核预测每个车道线实例 - 知乎![]() https://zhuanlan.zhihu.com/p/393167538

https://zhuanlan.zhihu.com/p/393167538

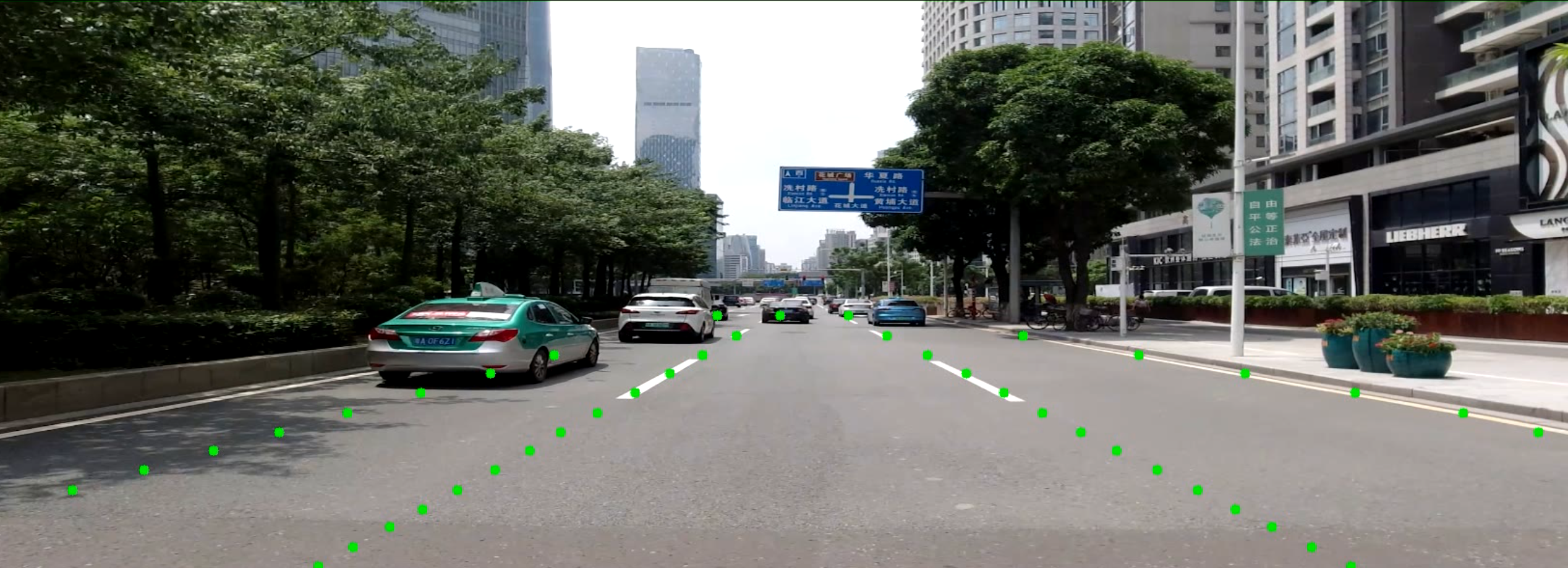

检测效果:

(4) CLRNet

参考:https://github.com/Turoad/CLRNet![]() https://github.com/Turoad/CLRNet

https://github.com/Turoad/CLRNet

通过结合图像的高层语义和低层细节来提升车道线检测的准确性

待续

(5) CLRerNet

参考:CLRerNet推理详解及部署实现(上)-CSDN博客![]() https://blog.csdn.net/qq_40672115/article/details/141275384?ops_request_misc=elastic_search_misc&request_id=c0f4f316b98f4f12f893d3e022d89a0b&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~baidu_landing_v2~default-4-141275384-null-null.142^v102^pc_search_result_base2&utm_term=%20CLRerNet&spm=1018.2226.3001.4187CLRerNet推理详解及部署实现(下)-CSDN博客

https://blog.csdn.net/qq_40672115/article/details/141275384?ops_request_misc=elastic_search_misc&request_id=c0f4f316b98f4f12f893d3e022d89a0b&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~baidu_landing_v2~default-4-141275384-null-null.142^v102^pc_search_result_base2&utm_term=%20CLRerNet&spm=1018.2226.3001.4187CLRerNet推理详解及部署实现(下)-CSDN博客![]() https://blog.csdn.net/qq_40672115/article/details/141275949?ops_request_misc=&request_id=&biz_id=102&utm_term=%20CLRerNet&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduweb~default-6-141275949.142^v102^pc_search_result_base2&spm=1018.2226.3001.4187https://github.com/hirotomusiker/CLRerNet

https://blog.csdn.net/qq_40672115/article/details/141275949?ops_request_misc=&request_id=&biz_id=102&utm_term=%20CLRerNet&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduweb~default-6-141275949.142^v102^pc_search_result_base2&spm=1018.2226.3001.4187https://github.com/hirotomusiker/CLRerNet![]() https://github.com/hirotomusiker/CLRerNet

https://github.com/hirotomusiker/CLRerNet

CLRerNet 是在 CLRNet 基础上的一项重要改进。

提出一个跨层优化的车道线检测网络CLRNet,用高层次特征检出车道线,用低层次特征调节车道线位置。

提出ROIGather模块,收集全局上下文信息,增强车道线的特征表示。

提出Line IoU loss,提高车道线的回归准确性。

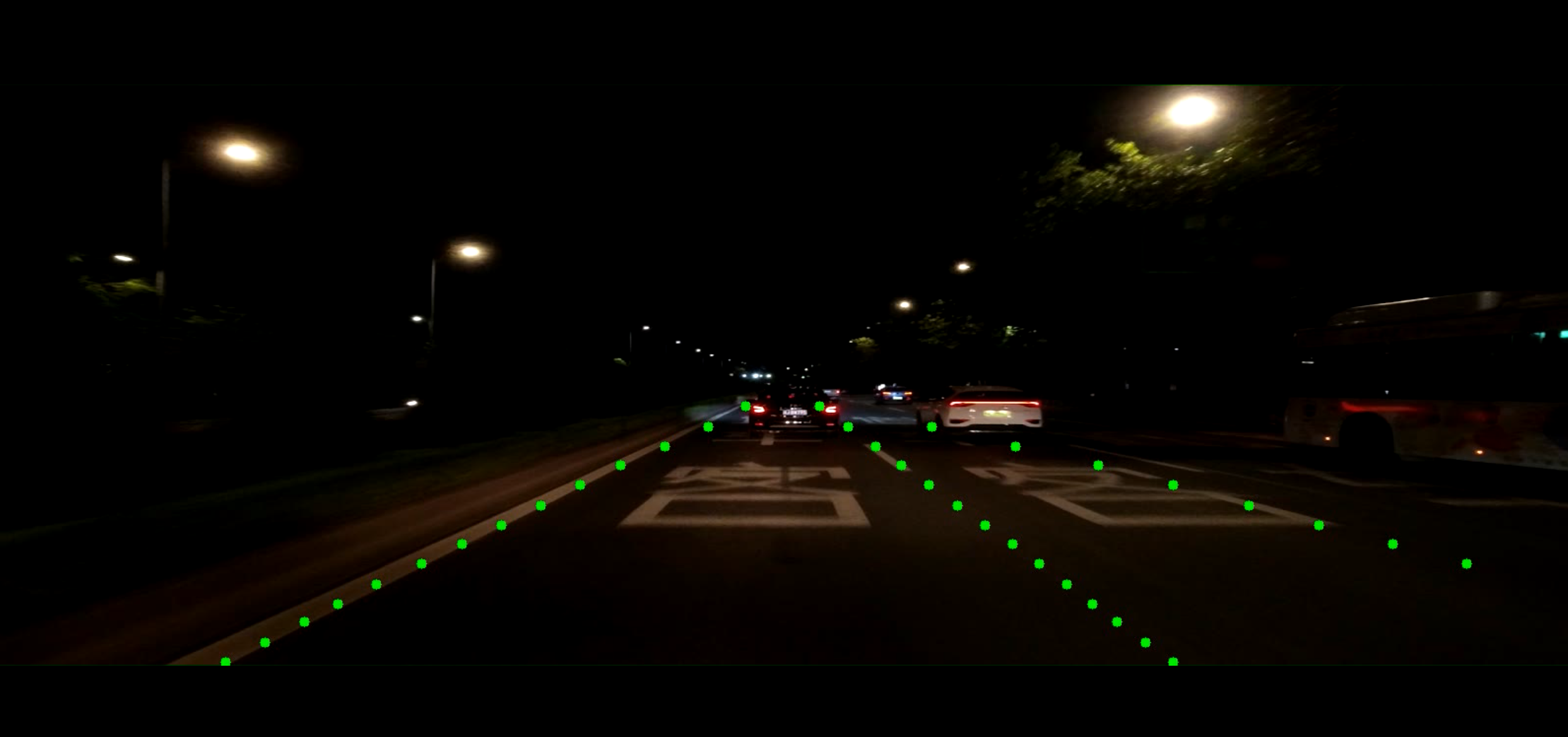

检测效果:

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)