【CV】Python 中如何正确查看一张图片的 shape(以及那些你一定会踩的坑)

文章摘要: 本文探讨了计算机视觉中不同图像库读取图片shape的差异及常见问题。OpenCV默认输出BGR顺序且灰度图缺少通道维度;PIL的shape信息隐藏在NumPy转换后,其size属性与shape概念不同;matplotlib会保留PNG的alpha通道,导致通道数不符预期。这些差异容易引发模型输入错误,但往往被忽视。核心观点是:图像shape不是附带信息,而是数据的第一层语义,必须显式验

在做计算机视觉、深度学习或数据分析时,我们几乎每天都会和图片打交道。

但一个看似再基础不过的问题,却经常引发 bug:**一张图片的 shape 到底是什么?**更准确地说:不同库读出来的 shape,到底代表什么?

这篇文章我想把这个问题一次性讲清楚。

一、为什么「看 shape」这件事很重要?

1.1 报错只是结果,根因往往在 shape

在实际项目中,很多看起来像“模型问题”的报错,本质上都源自图像 shape 不符合预期。

-

例如:

expected 3 channels, got 4size mismatchRuntimeError: Given groups=1...

-

这些错误通常发生在模型 forward 阶段,但真正的错误,往往早在数据读取那一刻就已经埋下了。

-

回头看才发现,这些报错并不是“模型太脆弱”,而是我在数据入口处给了它一个错误的世界。

1.2 图像“看起来正常”,并不代表 shape 是对的

一个非常具有迷惑性的场景是图像可以正常显示、resize、保存,但一送进模型就炸。

-

原因在于:

- 可视化工具往往会自动忽略或处理多余维度

- 模型却对输入 shape 严格敏感

-

例如:

- 显示层面看不出 RGBA 和 RGB 的差别

- 模型却明确要求

(H, W, 3)

1.3 轴顺序错误,是最危险的一类 bug

相比“直接报错”,下面这种情况更危险:(H, W, C) 和 (C, H, W) 混用。

-

因为它可能不会立刻报错,而是:

- 模型可以正常运行

- loss 正常下降

- 结果却完全不可解释(silently wrong)

-

这是典型的形状语义错误,比维度不匹配更难排查。

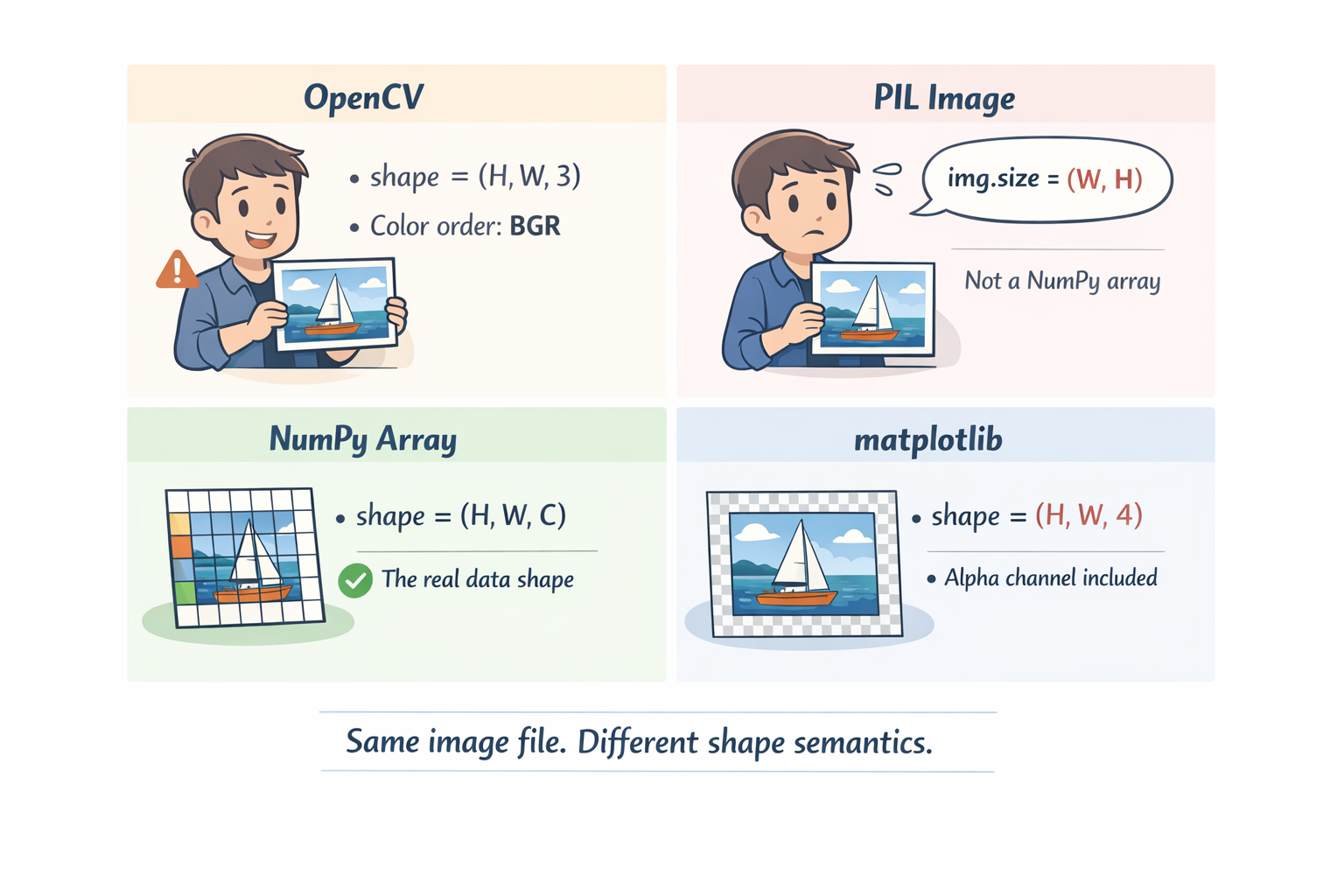

1.4 同一张图,不同库给你完全不同的“世界观”

-

即便你拿的是同一张图片文件:

- PIL 认为它是 RGB

- OpenCV 默认按 BGR 读取

- matplotlib 可能多给你一个 alpha 通道

-

如果你没有在代码中显式检查 shape 和通道含义,这些差异会在下游被无限放大。

1.5 本质问题:我们往往“默认它是对的”

这些问题反复出现,并不是因为它们复杂,而是因为我们太容易对图像的 shape 做出未经验证的假设。

-

默认它是 3 通道

-

默认它是

(H, W, C) -

默认它和上一次处理的是一样的

而工程经验告诉我们,凡是默认的地方,都是 bug 最密集的地方。

综上所述,在 CV 工程中,shape 不是“附带信息”,而是输入数据的第一层语义。

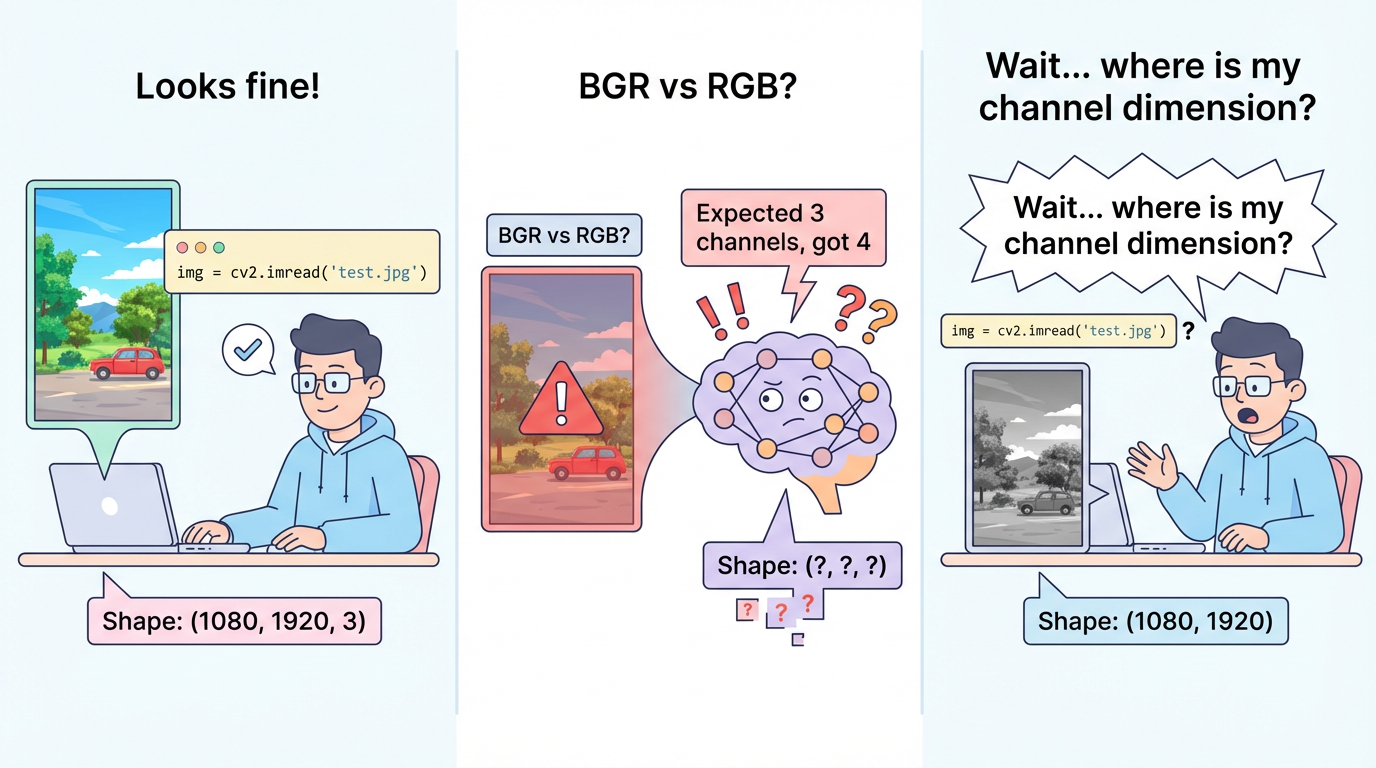

二、OpenCV:最常见,也最容易被忽略细节的方式

OpenCV 的问题不在于 shape 错,而在于它太“理所当然”。

OpenCV 是很多人接触图像处理时的第一站,也是 shape 误判最频繁发生的地方之一。

原因很简单,用得太熟了,反而不再检查它到底给了你什么。

2.1 图像加载方式

import cv2

img = cv2.imread("test.jpg")

print(img.shape)

OpenCV 读入彩色图像后,shape 的含义始终是:

(height, width, channels)

例如:

(1080, 1920, 3)

这一点本身没有问题,问题在于我们往往在这里就停止思考了。

2.2 关键细节:OpenCV 读出来的是 BGR,不是 RGB

-

这是一个几乎人人知道,但几乎人人都会忘记处理的事实:

- OpenCV 默认通道顺序是 BGR

- 不是 RGB

-

也就是说:

img[:, :, 0] # 不是 Red,而是 Blue -

在以下场景中,这个问题会被悄悄放大:

- OpenCV 读图 → PIL / matplotlib 显示

- OpenCV 预处理 → PyTorch / TensorFlow 模型

- 多个图像库混用的工程代码

-

很多“颜色不对”、“模型效果异常”的问题,并不是模型学错了,而是你一开始喂给它的颜色语义就错了。

2.3 关键细节二:灰度图没有 channel 维度

img = cv2.imread("test.jpg", cv2.IMREAD_GRAYSCALE)

print(img.shape)

输出是:

(1080, 1920)

注意这一点非常重要:OpenCV 不会给灰度图保留 (H, W, 1) 这个维度。

而是直接返回(H, W)

-

这在以下场景中非常容易踩坑:

- 你假设所有图像都有

shape[2] - 你直接做

img.transpose(2, 0, 1) - 你把灰度图和 RGB 图混在一个 pipeline 里

- 你假设所有图像都有

-

很多 tensor 相关的报错,其实不是出在模型层,而是出在这里。

2.4 一个常见但危险的“隐式假设”

在很多代码中,我们都会看到类似写法:

h, w, c = img.shape

这行代码的问题不在于“写错了”, 而在于它隐含了一个未经验证的前提:“我确定这张图一定是彩色图。”

一旦这个前提不成立,bug 就已经产生了。

综上所述,在 OpenCV 中,img.shape 看起来很直观,但真正需要警惕的,恰恰是这种“看起来没问题”的直观感。

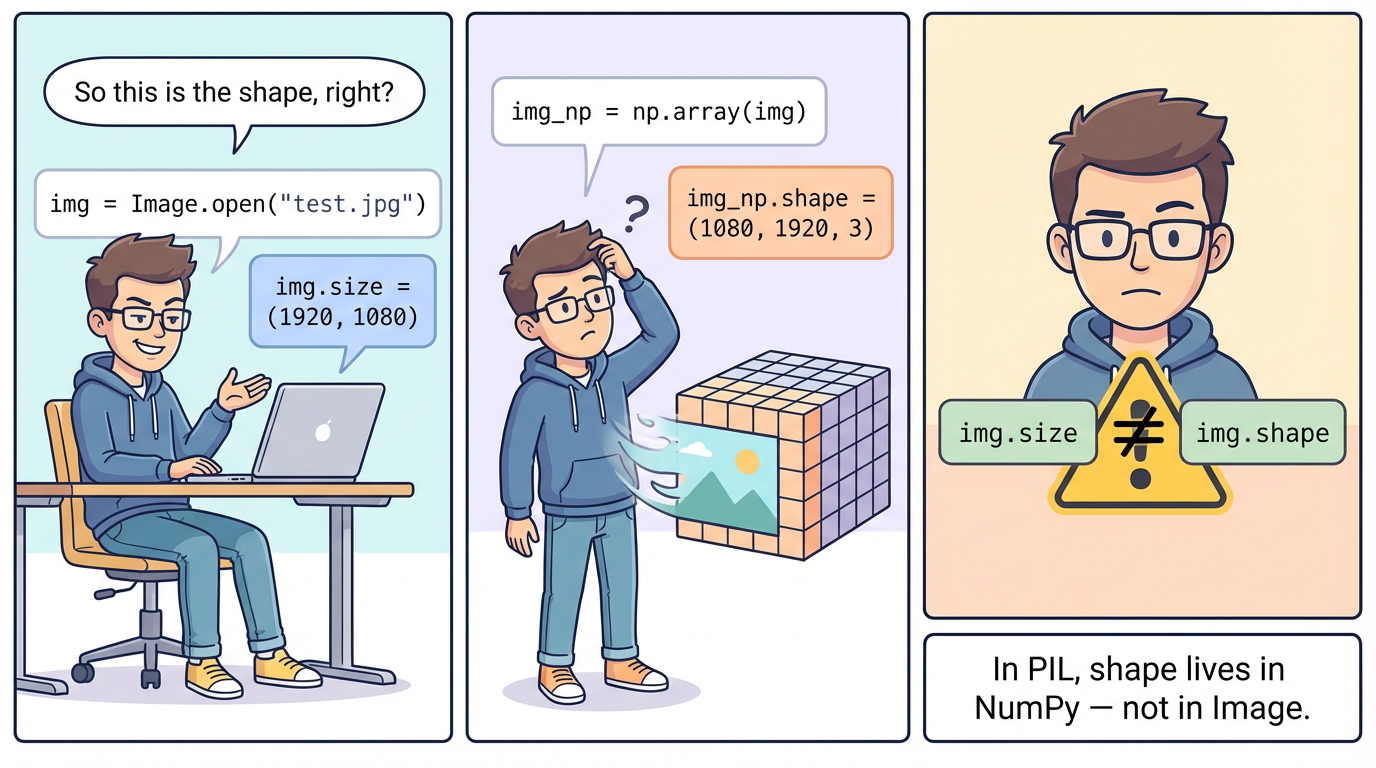

三、PIL:shape 不在 Image 里,而在 NumPy 里

在 PIL 里,shape 不是属性,而是你“转成数据”之后才获得的东西。

如果说 OpenCV 的坑在于“默认太多”,那 PIL 的坑就在于:它把 shape 藏得太深了。

PIL 的 Image 对象,本身并不是一个 NumPy 数组,因此它并不会直接告诉你“你现在拿到的张量结构是什么”。

3.1 Image.size:名字很像 shape,但它不是

from PIL import Image

import numpy as np

img = Image.open("test.jpg")

print(img.size)

输出是:(width, height)

-

⚠️ 这是第一个高频误区:size 的顺序是 (W, H),而不是 (H, W)

-

而且它只包含空间尺寸信息,完全不涉及通道数。

很多人在这里会下意识地以为

img.size == img.shape,但这在 PIL 中是不成立的。

3.2 真正的 shape:只在 NumPy 里存在

如果你想要真正意义上的 shape,必须先把 Image 转成 NumPy 数组:

img_np = np.array(img)

print(img_np.shape)

输出才是我们熟悉的形式:

(height, width, channels)

也只有在这一步之后,你才能安全地:

- 判断通道数

- 做维度变换

- 转成 tensor

3.3 一个极其常见、但很隐蔽的坑

这两行代码,看起来非常接近:

img.size

img_np.shape

-

但它们代表的是完全不同的语义层级:

img.size:PIL 的显示尺寸img_np.shape:数据层面的张量结构

-

所以这条等式

img.size == img.shape永远不应该被假设成立:

一旦在脑海里把这两者混为一谈,后面所有关于 resize、transpose、batch 的代码,都有可能在一个错误的前提下运行。

3.4 为什么这个设计这么容易踩坑?

-

从 API 设计的角度看,PIL 更关注的是:

- 图像显示

- 图像保存

- 人类可读的尺寸概念

-

而不是:

- 数值计算

- 张量运算

- 模型输入规范

-

这也解释了为什么:PIL 用起来很“顺手”,但在工程中必须格外小心。

综上所述,在 PIL 中,shape 并不属于 Image,而是你把它当作“数据”之后,才真正出现的概念。

四、matplotlib:看起来简单,其实暗藏玄机

matplotlib 给你的是“忠实的 shape”,但模型需要的是“受控的 shape”。

matplotlib 经常被当作“只是用来画图的工具”,但很多人第一次把图像送进模型,恰恰是从 plt.imread 开始的。

问题也正是从这里出现的。

4.1 最简单的用法,往往最容易掉以轻心

import matplotlib.pyplot as plt

img = plt.imread("test.png")

print(img.shape)

你通常会看到下面两种结果:

-

RGB 图像:

(H, W, 3) -

RGBA 图像:

(H, W, 4)表面看起来一切正常,但真正的风险就藏在这个 “4” 里。

4.2 Alpha 通道:你没意识到,但模型一定会意识到

很多 PNG 图片都带有 alpha(透明度)通道,而 matplotlib 会原样保留它。

于是你以为你拿到的是(H, W, 3),实际上却是(H, W, 4)。

-

这在以下场景中几乎必然出问题:

- 模型明确要求 3 通道输入

- 你在 pipeline 中混用了 JPG 和 PNG

- 你在训练集里无意中引入了带透明通道的图片

-

最终的结果通常是

expected 3 channels, got 4

4.3 为什么这个问题更隐蔽?

相比 OpenCV 和 PIL,matplotlib 的问题更“阴险”的原因在于:

-

图像显示完全正常

-

代码没有任何异常

-

shape看起来也“合理”唯一不合理的,是你默认了它一定是 3 通道。

4.4 一个工程中很容易被忽略的事实

matplotlib 不是图像预处理库,而是可视化库。

-

它不会帮你:

- 对齐模型输入规范

- 自动去掉 alpha 通道

- 统一数据语义

-

如果你把它当成“安全的数据入口”,那问题迟早会在模型阶段暴露出来。

五、如何写一段“不会出错”的通用代码?

在工程里,我通常不会直接相信 shape[2],而是这样写:

h, w = img.shape[:2]

if img.ndim == 2:

c = 1

else:

c = img.shape[2]

print(h, w, c)

这段代码的关键不在于“判断 ndim”,而在于拒绝对 shape 做任何未经验证的假设。

- 这样可以同时兼容:

- 灰度图

- RGB

- RGBA

六、常见图像 shape 对照表(强烈建议记住)

| 图像类型 | shape |

|---|---|

| 灰度图 | (H, W) |

| RGB | (H, W, 3) |

| RGBA | (H, W, 4) |

| OpenCV 彩色图 | (H, W, 3)(BGR) |

七、和深度学习相关的一个“致命细节”

如果你用的是 PyTorch,那么你迟早会遇到这一关:

(H, W, C) → (C, H, W)

例如:

import torch

img = torch.from_numpy(img_np)

img = img.permute(2, 0, 1) # CHW

img = img.unsqueeze(0) # batch 维度

最终 shape:

(1, C, H, W)

90% 的新手 CV bug,都是在这里产生的。

八、总结一句话

图片没有“标准 shape”,只有“上下文相关的 shape”。

-

不同库 → 不同约定

-

灰度 / RGB / RGBA → 维度不同

-

NumPy / Torch → 轴顺序不同

在工程中,与其记住所有 shape 规则,不如养成一个习惯:每次用之前,都打印一次。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)