UNet:一种用于图像分割的深度学习网络架构

这个被称为UNet的网络,用现在的话说就是"结构越怪,分割越快",不信你看它的架构图——活脱脱一个俄罗斯套娃式的对称结构。假设你要分割的肿瘤图像只有200张,传统网络可能直接过拟合到亲妈都不认识,但UNet的跳跃连接让解码器在恢复细节时,能直接"参考"编码器阶段记住的肿瘤边缘特征。想象你要把马赛克图片还原,UNet的做法是:先把压缩过的特征图放大(反卷积),然后和之前存好的高清局部特征图(跳跃连接

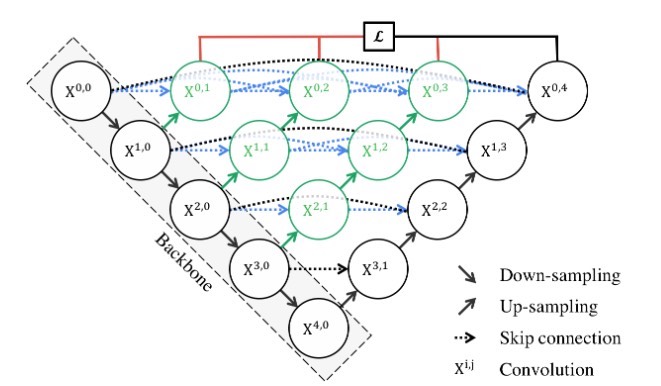

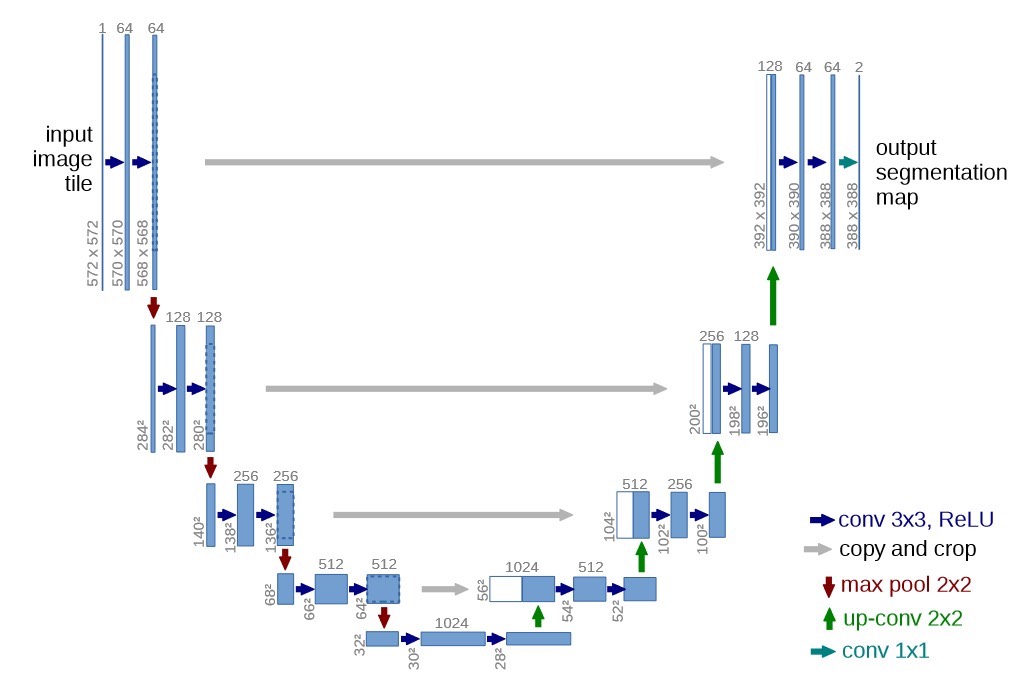

UNet是一种用于图像分割的深度学习网络架构,由Olaf Ronneberger、Philipp Fischer和Thomas Brox于2015年提出。 它在医学图像分割领域取得了很大的成功,尤其在细胞分割和医学影像分析方面广泛应用。 UNet网络的设计灵感来自于生物医学图像中观察到的图像特点。 它采用了一种U形的网络结构,其中上半部分称为编码器(Encoder),下半部分称为解码器(Decoder)。 编码器负责从输入图像中提取特征并逐渐减少空间分辨率,而解码器则逐步恢复空间分辨率,并生成与输入图像相同大小的输出分割结果。 UNet的编码器部分通常由一系列的卷积层和池化层组成,每个卷积层之后都会使用激活函数(如ReLU)进行非线性变换。 这样可以逐渐提取图像的局部和全局特征,并减少特征图的尺寸。 在每个池化层后,特征图的通道数会增加,这有助于捕捉更多的上下文信息。 解码器部分是编码器的镜像,它通过上采样(如反卷积)操作逐步恢复特征图的空间分辨率。 同时,解码器还会与对应的编码器层级进行连接,这样可以利用编码器中提取的高级语义信息来帮助精准的分割预测。 连接方式通常是通过跳跃连接(skip connections)实现的,其中将编码器的特征图与解码器的特征图进行级联或拼接。 在UNet的最后一层,通常使用1x1卷积操作将特征图转换为与目标分割类别数量相匹配的通道数。 然后,通过应用适当的激活函数(如Sigmoid或Softmax)对每个像素进行分类,得到最终的分割结果。 UNet的优点之一是其能够对具有不同尺寸和形状的目标进行准确的分割。 由于采用了跳跃连接,网络可以同时利用低级和高级特征,从而提高了分割的精度。 此外,UNet的网络结构相对简单,参数较少,训练速度较快。 可辅助调试多种注意力模块、多种网络主干、将最新的视觉模块应用于网络中改进指标

在医学影像实验室里,你可能见过这样的场景:研究人员对着显微镜下密密麻麻的细胞图像抓耳挠腮,试图手动勾画每个细胞的轮廓。直到2015年,三个德国人甩出了一张U型网络结构图,从此开启了医学图像分割的新纪元。这个被称为UNet的网络,用现在的话说就是"结构越怪,分割越快",不信你看它的架构图——活脱脱一个俄罗斯套娃式的对称结构。

这个U型结构的精髓在于它的编码器-解码器设计。编码器就像个层层压榨的资本家,不断压缩图像尺寸:"这个256x256的CT片子太占地方了,给我压成128x128!还不够,继续压!"而解码器则是贴心的修复师,把被压扁的特征图一点点还原。但光是这样还不够,UNet最骚的操作在于它让编码器和解码器玩起了传纸条——跳跃连接(skip connections)。就像考试时学霸给学渣递小抄,高层语义特征和底层细节特征直接勾搭上了。

来看段PyTorch实现的精华部分:

class DoubleConv(nn.Module):

def __init__(self, in_channels, out_channels):

super().__init__()

self.double_conv = nn.Sequential(

nn.Conv2d(in_channels, out_channels, kernel_size=3, padding=1),

nn.BatchNorm2d(out_channels),

nn.ReLU(inplace=True),

nn.Conv2d(out_channels, out_channels, kernel_size=3, padding=1),

nn.BatchNorm2d(out_channels),

nn.ReLU(inplace=True)

)

def forward(self, x):

return self.double_conv(x)这个双卷积模块是UNet的原子操作单元,相当于乐高积木的基础块。注意第二个ReLU激活函数的位置——这不是画蛇添足,而是为了让网络在两次卷积后都能获得非线性表达能力。BatchNorm层就像给特征图上了个紧箍咒,防止训练时特征分布跑偏。

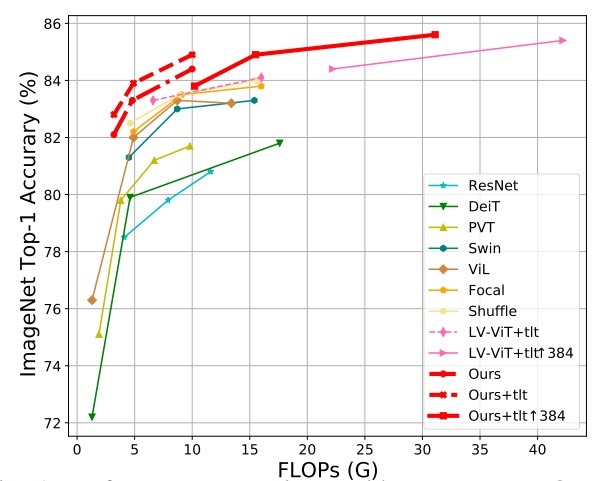

UNet是一种用于图像分割的深度学习网络架构,由Olaf Ronneberger、Philipp Fischer和Thomas Brox于2015年提出。 它在医学图像分割领域取得了很大的成功,尤其在细胞分割和医学影像分析方面广泛应用。 UNet网络的设计灵感来自于生物医学图像中观察到的图像特点。 它采用了一种U形的网络结构,其中上半部分称为编码器(Encoder),下半部分称为解码器(Decoder)。 编码器负责从输入图像中提取特征并逐渐减少空间分辨率,而解码器则逐步恢复空间分辨率,并生成与输入图像相同大小的输出分割结果。 UNet的编码器部分通常由一系列的卷积层和池化层组成,每个卷积层之后都会使用激活函数(如ReLU)进行非线性变换。 这样可以逐渐提取图像的局部和全局特征,并减少特征图的尺寸。 在每个池化层后,特征图的通道数会增加,这有助于捕捉更多的上下文信息。 解码器部分是编码器的镜像,它通过上采样(如反卷积)操作逐步恢复特征图的空间分辨率。 同时,解码器还会与对应的编码器层级进行连接,这样可以利用编码器中提取的高级语义信息来帮助精准的分割预测。 连接方式通常是通过跳跃连接(skip connections)实现的,其中将编码器的特征图与解码器的特征图进行级联或拼接。 在UNet的最后一层,通常使用1x1卷积操作将特征图转换为与目标分割类别数量相匹配的通道数。 然后,通过应用适当的激活函数(如Sigmoid或Softmax)对每个像素进行分类,得到最终的分割结果。 UNet的优点之一是其能够对具有不同尺寸和形状的目标进行准确的分割。 由于采用了跳跃连接,网络可以同时利用低级和高级特征,从而提高了分割的精度。 此外,UNet的网络结构相对简单,参数较少,训练速度较快。 可辅助调试多种注意力模块、多种网络主干、将最新的视觉模块应用于网络中改进指标

当数据量不足时(医学影像的常态),跳跃连接就显灵了。假设你要分割的肿瘤图像只有200张,传统网络可能直接过拟合到亲妈都不认识,但UNet的跳跃连接让解码器在恢复细节时,能直接"参考"编码器阶段记住的肿瘤边缘特征。这种跨层级的特征融合,就像老司机开车时既看后视镜又看前方,双保险确保不翻车。

上采样操作是解码器的核心魔法:

x = torch.cat([x, skip_connection], dim=1)

x = self.upconv(x)这段代码实现了特征图的拼接与反卷积。想象你要把马赛克图片还原,UNet的做法是:先把压缩过的特征图放大(反卷积),然后和之前存好的高清局部特征图(跳跃连接带来的)拼接。这种操作相当于PS里的"内容识别填充",用已知的细节线索来指导未知区域的重建。

在实战中,UNet的变体层出不穷。有人把VGG的预训练权重塞进编码器,有人往跳跃连接里加注意力机制(比如给肿瘤区域自动打高光),还有人玩起了嵌套U型结构(UNet++)。但万变不离其宗,那个标志性的U型结构始终是医学图像分割的定海神针。下次当你看到AI自动勾勒出CT片中的肿瘤区域时,别忘了背后站着这个优雅的U型网络——用最对称的结构,割最难的图像。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)