一篇文章就看懂了Ultralytics Yolo系列的演进,都到YOLO26!

1梳理了Ultralytics家族的演进路径:YOLOv5(2020)、YOLOv8(2023)、YOLO11(2024)和YOLO26(2025),重点突出设计选择、功能特性和单一供应商生态中的部署特点。相比之下,表2则梳理了独立于Ultralytics的主要社区版本,包括YOLOv1(2015)、YOLOv2(2016)、YOLOv3(2018)、YOLOv4(2020)、YOLOv6(202

点击蓝字

关注我们

关注并星标

从此不迷路

计算机视觉研究院

公众号ID|计算机视觉研究院

学习群|扫码在主页获取加入方式

https://arxiv.org/pdf/2510.09653

计算机视觉研究院专栏

Column of Computer Vision Institute

本文对UltralyticsYOLO系列目标检测器进行了全面综述,重点介绍其架构演进、性能基准、部署视角及未来挑战。

PART/1

概述

综述从最新发布的YOLO26(或称YOLOv26)展开,该模型引入了多项关键创新,包括移除分布焦点损失(DFL)、原生无NMS推理、渐进式损失平衡(ProgLoss)、小目标感知标签分配(STAL),以及用于稳定训练的MuSGD优化器。随后,本文追溯了该系列的演进历程:YOLO11具备混合任务分配与效率优先模块;YOLOv8采用了解耦检测头与无锚框预测;YOLOv5则奠定了模块化PyTorch基础,为现代YOLO的发展提供了支撑。

在MSCOCO数据集上的基准测试对YOLOv5、YOLOv8、YOLO11和YOLO26进行了详细的定量比较,并与YOLOv12、YOLOv13、RTDETR和DEIM等模型展开横向对比。通过分析精确率、召回率、F1分数、平均精度均值(mAP)和推理速度等指标,本文揭示了模型在精度与效率之间的权衡关系。

此外,本文还探讨了部署与应用视角,涵盖导出格式、量化策略,以及在机器人、农业、安防和制造业等领域的实际应用。最后,本文指出了当前面临的挑战与未来发展方向,包括密集场景下的性能局限、CNNTransformer混合架构融合、开放词汇检测,以及边缘感知训练方法。

PART/2

背景

目标检测已成为计算机视觉领域最关键的任务之一,它使机器不仅能识别复杂图像或视频流中的多个目标,还能对其进行定位。其重要性贯穿多个领域,包括自动驾驶、机器人、安防、医学影像、农业和智能制造——在这些场景中,可靠的实时性能直接关系到安全性、效率和自动化水平的提升。在过去十年提出的众多算法中,“YouOnlyLookOnce”(YOLO)系列已成为最具影响力且应用最广泛的实时目标检测模型,在高精度与前所未有的推理速度之间实现了出色平衡。自2016年首次发布以来,YOLO经历了多次架构迭代,每一代都针对前代的特定局限进行改进,并融入神经网络设计、训练策略、损失函数和部署效率等方面的最新进展。

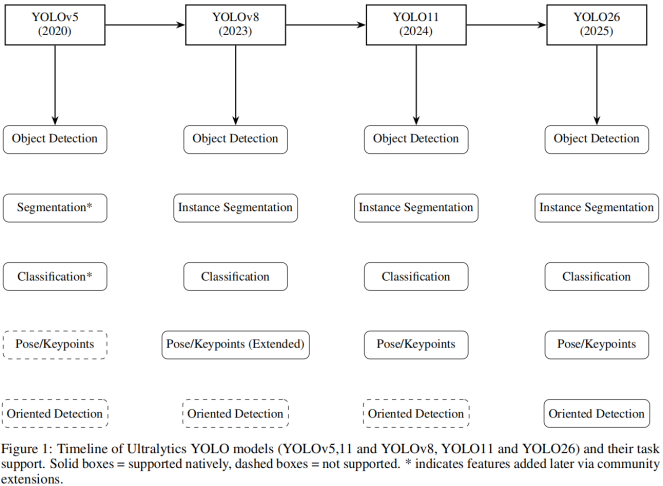

图1可视化了YOLO的演进历程,追溯了从早期Ultralytics版本(如YOLOv5)到最新YOLO26(2025年)的发展路径。YOLO26是首个原生支持五大任务的版本:目标检测、实例分割、分类、姿态/关键点检测和定向边界框检测。这一时间线清晰展示了YOLO如何从单纯的检测工具逐步扩展为适用于科研与边缘部署的通用多任务视觉框架。

YOLO26的发布

2025年9月发布的YOLO26是这一演进历程中的最新里程碑。它以简洁、高效与创新为设计核心,通过架构简化消除了非极大值抑制(NMS)和分布焦点损失(DFL)等性能瓶颈,采用新型MuSGD优化器确保训练收敛,并集成了渐进式损失平衡(ProgLoss)和小目标感知标签分配(STAL)等训练优化策略。这些创新共同使YOLO26成为针对低功耗嵌入式设备优化的前沿模型,在不牺牲精度的前提下显著提升了实际部署能力。

YOLO26的技术定位

为了将YOLO26置于更广阔的技术生态中,我们首先回顾Redmon等人(2016)开启的范式变革:他们将目标检测重构为单回归问题,摒弃区域建议,直接预测边界框与类别概率。与RCNN和FasterRCNN等两阶段流水线(将建议生成与分类解耦)不同,YOLOv1的设计在保持竞争力精度的同时实现了实时处理速度,使其在机器人和自主导航等对延迟敏感的领域极具吸引力。

随后的快速迭代包括:YOLOv2(2017)引入批量归一化、锚框和多尺度训练,以增强对复杂目标的鲁棒性;YOLOv3(2018)深化了骨干网络(Darknet53)并利用多尺度特征图,成为学术界与工业界广泛采用的基准。随着航空影像、农业和医学分析等领域对精度需求的增长,模型架构进一步多样化:YOLOv4(2020)集成了CSPNet、改进激活函数和高级训练策略(如马赛克增强、CIoU);Ultralytics的YOLOv5(2020)推广了基于PyTorch的模块化工具链,简化了分割、分类和边缘部署的适配流程。

社区后续版本(YOLOv6、YOLOv7)集成了参数高效模块和类Transformer结构,在保持实时推理速度的同时提升精度。Ultralytics随后通过YOLOv8(解耦检测头、无锚框预测)、YOLOv9(GELAN、渐进式蒸馏)、YOLOv10(延迟平衡分配)和YOLO11(高效设计+强小目标性能)对模型进行了重构。与此同时,非Ultralytics主导的分支(YOLOv12、YOLOv13)探索了注意力中心的设计(多头自注意力、改进特征融合、更强正则化),但仍受限于NMS和DFL,在低功耗设备上存在延迟与导出兼容性问题。

为解决这些瓶颈,YOLO26推进了延迟优先的设计理念:移除DFL,采用端到端(无NMS)推理,并引入ProgLoss和STAL以提升训练稳定性与小目标检测性能,同时通过MuSGD加速训练。

图1总结了这一演进路径,并明确YOLO26是首个原生统一目标检测、实例分割、分类、姿态/关键点检测和定向边界框检测的Ultralytics版本。

本文旨在系统梳理Ultralytics如何将YOLO系列发展至当前以YOLO26为代表的形态。通过对这四个里程碑版本的系统比较,本综述不仅强调了架构创新,还解读了性能权衡、基准测试结果和部署就绪性。在此过程中,本文完整呈现了YOLO从一个快速但功能有限的检测器,演变为通用、多任务、边缘优化框架的发展脉络——该框架至今仍在实时目标检测领域引领标准。

PART/3

YOLO模型的架构演进

为提供精确的时间线与架构背景,我们将Ultralytics维护的版本与社区驱动的变体分开讨论。

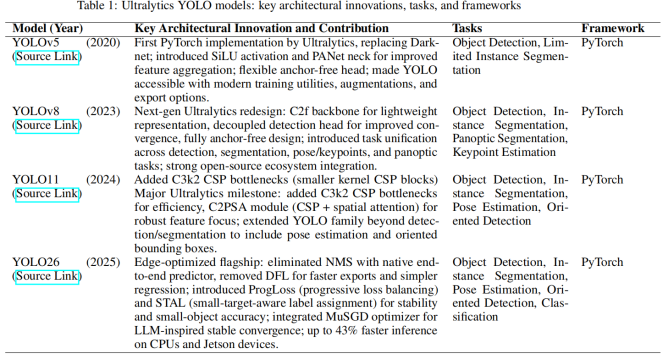

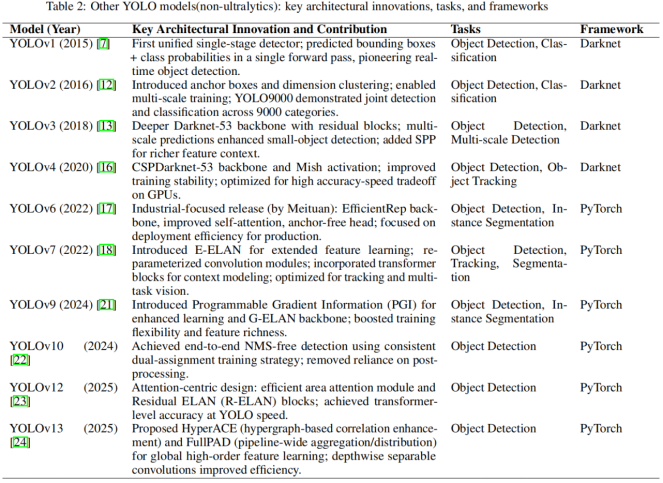

表1梳理了Ultralytics家族的演进路径:YOLOv5(2020)、YOLOv8(2023)、YOLO11(2024)和YOLO26(2025),重点突出设计选择、功能特性和单一供应商生态中的部署特点。相比之下,表2则梳理了独立于Ultralytics的主要社区版本,包括YOLOv1(2015)、YOLOv2(2016)、YOLOv3(2018)、YOLOv4(2020)、YOLOv6(2022)、YOLOv7(2022)、YOLOv9(2024)、YOLOv10(2024)及其同期变体。

这些表格共同呈现了YOLO生态系统中逐年的架构创新、任务扩展与性能趋势,清晰展示了该框架如何逐步成熟至YOLO26所代表的状态(表1–2)。

非Ultralytics维护的YOLO版本

Ultralytics维护的YOLO版本展现出一条清晰的演进轨迹,持续向模块化、任务统一化和部署效率方向发展,最终在YOLO26中形成首个集检测、分割、姿态估计、定向边界框和分类于一体的全集成框架。相比之下,社区驱动的模型往往更侧重实验性架构特性:从YOLOv1–YOLOv4基于Darknet的基础架构,到YOLOv6–YOLOv13中受Transformer启发的机制与注意力模块。尽管这些变体提升了精度基准,并引入了GELAN或基于超图的特征聚合等创新思路,但它们通常保留了NMS或DFL等计算成本较高的组件,限制了在边缘设备上的无缝部署。而Ultralytics的模型则始终强调可导出性、量化能力和生产级API,体现了务实的设计理念——这种理念是对学术原型的补充而非竞争。表2中的对比概述进一步表明,Ultralytics通过精简的设计选择,已将YOLO26定位为整个YOLO生态中兼具科研价值与工业就绪性的里程碑。

YOLO26:移除DFL、无NMS推理、ProgLoss、STAL与MuSGD

YOLO26(2025)是一款边缘优先的重构版本,其核心是端到端的简洁性与鲁棒的导出能力。该版本包含两项决定性的架构改进:

1.检测头移除了基于分布焦点损失(DFL)的分布回归,改用更轻量、更硬件友好的边界框参数化方式。移除DFL后,消除了在不同编译器与运行时环境中兼容性较差的算子,降低了计算图复杂度并简化了量化流程。

2.解码路径重构为无NMS的端到端推理:检测头直接生成紧凑、无冗余的预测结果,无需后处理抑制步骤。这一改进消除了传统的延迟瓶颈,同时移除了部署时需根据场景调优的超参数(如IoU/分数阈值)。

训练稳定性通过ProgLoss(渐进式损失平衡)与STAL(小目标感知标签分配)得到保障:

ProgLoss通过动态调整分类、定位及辅助损失项的相对权重,避免训练后期易分负样本或大目标主导损失,从而提升收敛平滑性。

STAL通过调整分配先验与空间容忍度,确保微小、遮挡或低对比度目标获得足够的监督信号,从而提升边缘场景(如无人机、智能相机、移动机器人)下的召回率。

优化器采用MuSGD,这是一种混合优化器,结合了SGD的泛化性与简洁性,同时融入了现代大模型训练中启发的曲率感知和动量感知更新策略。实验表明,MuSGD缩短了模型达到目标精度的时间,并缓解了训练后期的震荡,有助于在不同尺度(n/s/m/l/x)下实现可复现的收敛。

在系统层面,YOLO26着重优化了可移植性与量化能力。通过移除DFL与NMS,导出的计算图可更简洁地映射到ONNX、TensorRT、CoreML和TFLite等框架,减少了自定义算子的使用,从而在精度损失极小的情况下实现INT8与FP16部署。简化的算子表面降低了转换过程中的兼容性问题,并提升了跨编译器的确定性。

延迟收益在CPU与嵌入式GPU上尤为显著,特别是在批量大小为1的场景中(此前该场景下后处理是主要延迟来源)。YOLO26原生支持目标检测、实例分割、分类、姿态/关键点检测与定向边界框任务,将整个YOLO家族整合为一个统一的多任务框架。这一设计实现了实时检测领域的长期目标:在保持顶尖精度的同时,提供极简且易于导出的计算图,可从云端GPU无缝扩展到资源受限的边缘设备。

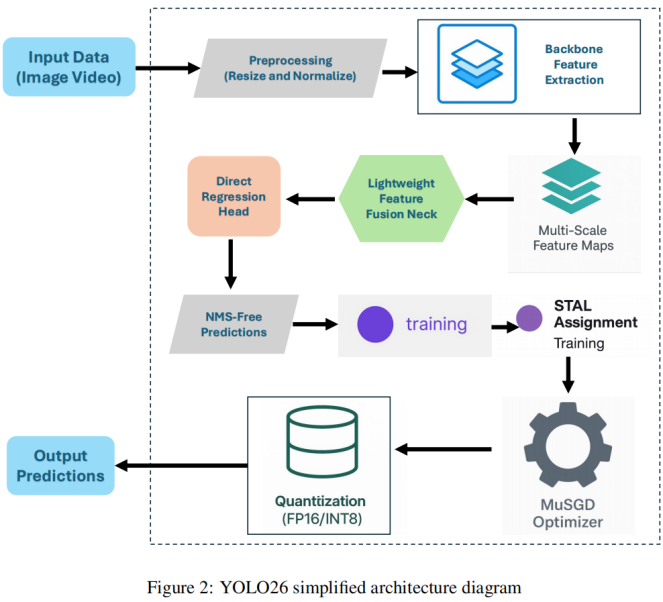

YOLO26的架构(图2)通过两项核心简化实现了部署性与精度的平衡:

移除分布焦点损失,提升导出/硬件兼容性;

原生支持端到端(无NMS)推理,消除后处理延迟。

训练稳定性与小目标召回率通过渐进式损失平衡和小目标感知标签分配得到增强,而MuSGD则融合了SGD与Muon风格的曲率/动量更新机制,实现快速平滑的收敛。早期测试显示,CPU端推理速度提升约43%,且在FP16/INT8量化下性能稳定,这使得该系列模型既适合边缘设备(Jetson/CPU),也兼容标准GPU流水线。

YOLO11:混合任务分配与效率优化

YOLO11(2024)的核心目标是平衡精度、稳定性与设备效率,其改进覆盖了特征表示与监督信号两个方面:

特征表示层面:强调紧凑的CSP变体(如C3/C3k2瓶颈结构)与轻量注意力模块,在不增加延迟的前提下增强通道交互。这些改进提升了特征复用率,减少了冗余,在主流GPU与边缘SoC上实现了更优的FLOPstomAP比值。

颈部设计:继续聚焦低损失的多尺度融合,通过精细调整步长以限制混叠效应,提升小目标的定位精度。

监督信号采用了混合式任务感知分配策略:标签分配与损失权重会在分类、定位及(启用时的)分割或姿态等辅助任务中联合优化。这种混合设计减少了密集场景下的失效模式,通过稳定不同训练阶段各特征对应的优化目标,在固定精度下提升了召回率。尤为重要的是,该分配策略对批量大小变化具有鲁棒性,这在边缘训练与微调场景中日益常见。

从系统视角看,YOLO11增强了Ultralytics框架的多任务支持,涵盖目标检测、实例分割、分类、姿态估计,以及(在支持版本中)定向边界框,同时保留了此前版本引入的导出能力。它仍保留基于NMS的解码,但通过生成更清晰、冗余更少的预测结果降低了后处理负载。

效率提升与混合任务分配共同使YOLO11成为一个通用的中期版本:在相似延迟预算下精度优于YOLOv8,且在领域迁移(尤其是小目标与中等密度场景)中表现更稳定。

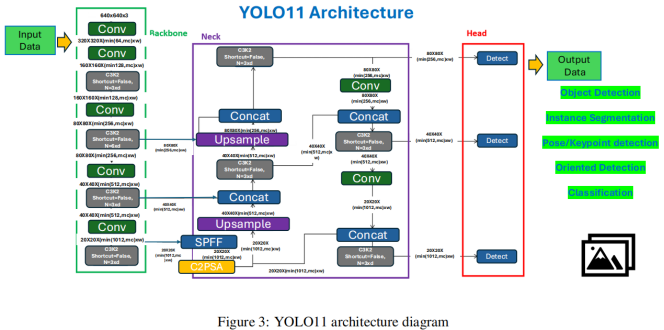

YOLO11的架构(图3)将C2f替换为紧凑的C3k2模块,保留SPPF以提取多尺度特征,并引入C2PSA增强空间注意力,从而得到更精简的骨干/颈部结构,提升了特征选择能力。实验表明,相比同规模的YOLOv8变体,其参数更少,推理速度略快于YOLOv10,并支持广泛的任务集(检测、分割、姿态、分类、定向边界框)。设计目标是在保持吞吐量的同时,提升在杂乱、小目标场景下的特征表示能力,同时兼容边缘与GPU部署。

YOLOv8:解耦检测头与无锚框预测

YOLOv8带来了更具系统性的检测头设计和现代化的特征表示流水线。

解耦检测头将分类与回归分支分离,缓解了定位与识别目标之间的梯度干扰。这一设计减少了优化过程中的耦合问题,提升了收敛平滑性,并能在特定工作点(如固定mAP或召回率)下实现更优的校准效果。

为配合这一检测头,YOLOv8引入了无锚框分配策略:不再围绕预设锚框回归偏移量,而是直接在特征图上的候选点预测归一化的边界框参数与置信度。无锚框检测头简化了超参数调优(无需锚框聚类),并提升了在不同目标宽高比统计特性数据集上的泛化能力。

骨干网络与颈部结构向更轻量、高吞吐的模块演进(如C2f风格的模块),在保持丰富感受野的同时降低了内存带宽压力。多尺度特征融合注重步长对齐与混叠抑制,保留了对小目标至关重要的清晰空间信息。

训练优化包括改进的标签分配启发式方法、类别不平衡缓解策略,以及在强数据增强下的更强正则化,这些改进共同稳定了长周期训练,并降低了模型对批量大小的敏感性。这些设计选择使模型能够从nano到extra-large的尺度上连贯缩放,同时避免了极端小尺度下的病态欠拟合或性能崩溃。

在功能层面,YOLOv8将一等公民支持从检测扩展到实例分割、分类,以及(通过扩展检测头实现的)关键点/姿态估计。其“PyTorch优先”的设计继续强调可导出性(支持ONNX、TensorRT、CoreML、TFLite)与FP16推理,进一步打通了从研究到部署的路径。

尽管YOLOv8仍使用传统NMS,且在多数场景下对边界框采用分布回归,但其检测头解耦与无锚框的设计理念,已预示了后续YOLO26所实现的端到端方向。

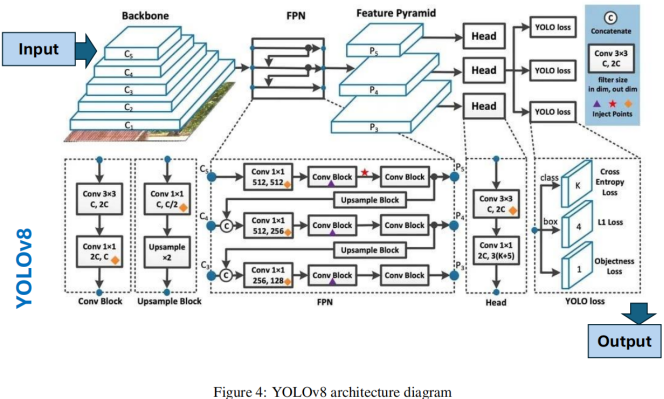

YOLOv8的架构(图4)提升了收敛性与小目标检测性能,并结合CIoU/DFL损失与扩展的任务集(检测、分割、跟踪、分类、姿态、跟踪)。

报告结果显示,该模型在TensorRT上实现了高吞吐量的同时,仍保持出色的COCOAP表现,并提供多尺度(n–x)模型以支持灵活部署。这些设计选择共同推动了精度提升,同时未牺牲实时性能。

YOLOv5:模块化与PyTorch适配

Ultralytics的YOLOv5标志着一次决定性的技术转向——从Darknet框架彻底迁移至原生PyTorch实现。它通过将训练工具、数据流水线、增强策略和导出工具整合到单一、易用的代码库中,极大地推动了模型的普及与采用。

在架构上,YOLOv5推广了一系列基于深度/宽度缩放的模型变体(n/s/m/l/x),其骨干网络受CSP思想启发,颈部采用PANet结构,以最小的延迟代价提升多尺度特征聚合效率。引入SiLU激活函数并精心选择归一化策略,有效缓解了优化过程中的病态问题(如深层网络中的梯度消失),同时保留了对小目标检测至关重要的高频细节。

YOLOv5的核心贡献在于模块化设计:骨干模块、颈部层、检测头和损失函数等组件可在极少重构的情况下进行替换、消融或扩展。这种模块化支撑了快速的任务适配,例如在不破坏基础检测器稳定性的前提下,轻松添加分割头或分类头。

在训练层面,YOLOv5系统化实现了强大且适合生产环境的数据增强(马赛克、复制粘贴、HSV抖动、随机透视),并配合可靠的调度策略(余弦退火、单周期学习率)与EMA权重跟踪,以生成鲁棒的最终模型权重。数据加载器与缓存逻辑针对通用硬件的吞吐量进行了优化,实现了高迭代速率,从而加速实验周期。

从部署角度,YOLOv5广泛支持多种导出格式(ONNX、TensorRT、CoreML)、混合精度推理(FP16)和轻量后处理。尽管它仍保留了NMS和传统边界框回归(后续分支中可选DFL),但其精简的计算图与保守的算子选择使其特别适合嵌入式和云端加速设备。这些设计选择共同将YOLOv5定位为一个务实的基准:尽管在架构上并非最具创新性,但在弥合研究级代码与大规模生产级推理之间的差距方面极为有效。

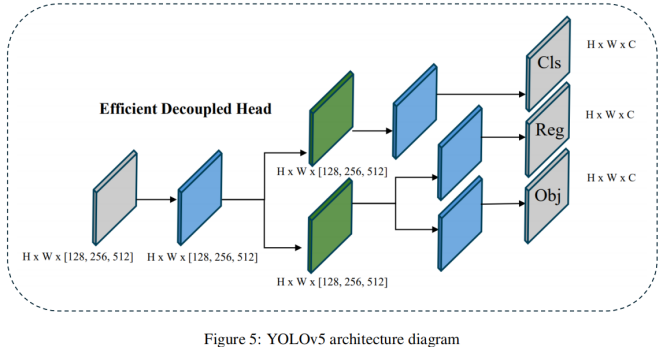

YOLOv5的架构(图5)在发布时优先考虑可复现性、精简的增强流水线和无障碍导出,这加速了它在科研与生产中的落地。对开发者体验和部署广度的重视,而非激进的新模块设计,使YOLOv5成为一个持久的基准,后续版本均在此基础上迭代以平衡精度与延迟。

PART/4

基准测试与对比分析

实时目标检测器的性能通常在MSCOCO数据集上进行评估,其中通过多交并比阈值(0.50至0.95)下的平均精度均值(mAP)衡量检测质量,而单图推理延迟则评估其边缘部署的适用性。

本节对比了Ultralytics发布的四个版本(YOLOv5、YOLOv8、YOLO11、YOLO26),并通过与YOLOv12、YOLOv13、RT-DETR变体及DEIM训练框架的横向比较,将它们置于更广阔的技术生态中。

内容分为三部分:

(i)Ultralytics模型在MSCOCO上的定量评估;

(ii)与近期面向Transformer的检测器的横向对比;

(iii)这些评估所使用的指标。

YOLOv5、YOLOv8、YOLO11和YOLO26的定量评估

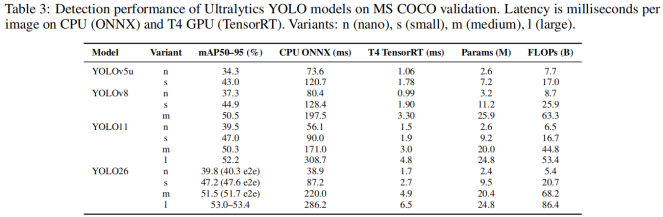

Ultralytics系列模型在迭代发布中展现出精度与效率的稳步提升(参见表3)。

YOLOv5(2020)引入了模块化的PyTorch实现,支持基于深度/宽度缩放的多尺寸变体(n、s、m、l、x)。其采用SiLU激活的骨干网络与PANet颈部结构实现了具备竞争力的精度,但依赖非极大值抑制(NMS),且在部分配置下使用分布焦点损失(DFL),增加了后处理开销。

在COCO验证集上,YOLOv5u-n(输入尺寸640px)在CPU(ONNX)上的mAP约为34.3%,单图推理延迟约73.6ms;而YOLOv5u-s的mAP可达约43.0%,延迟约120.7ms。这些结果为后续版本提供了务实的性能基准。

YOLOv8(2023)通过解耦检测头与无锚框设计,提升了收敛性与小目标检测性能。采用C2f骨干网络与SPPF结构,在保留丰富感受野的同时减少了参数量。

YOLOv8n(640px)在CPU上实现约37.3%mAP,单图延迟约80.4ms;更大尺寸的变体(s、m、l)则以延迟换取精度(例如,YOLOv8s约44.9%mAP,延迟约128.4ms;YOLOv8m约50.5%mAP,延迟约197.5ms)。

该版本将检测、实例分割与分类列为一等公民任务,但最终预测仍依赖NMS。

YOLO11(2024)以效率与小目标性能为核心,采用紧凑的C3k2瓶颈结构与C2PSA注意力模块实现鲁棒的特征聚合。

YOLO11n(640px)在CPU上的mAP约为39.5%,延迟(约56.1ms)显著低于YOLOv5u-n;YOLO11s与YOLO11m则分别在约90.0ms与171.0ms延迟下,达到约47.0%与50.3%的mAP。

该系列新增了姿态估计与定向边界框支持,但推理阶段仍需NMS。

YOLO26(2025)实现了最彻底的架构简化:移除DFL并原生支持端到端(无NMS)推理,同时集成渐进式损失平衡(ProgLoss)、小目标感知标签分配(STAL)与MuSGD优化器,以实现稳定、快速的收敛。

YOLO26n(640px)在CPU上的mAP约为39.8%(端到端模式下可达约40.3%),延迟约38.9ms,在精度相当的情况下比YOLO11n快得多。

YOLO26s与YOLO26m分别在约87.2ms与220.0ms延迟下,达到约47.2%与51.5%的mAP;YOLO26l则在约286.2ms延迟下将mAP提升至约53.0–53.4%。

这些结果凸显了其边缘优先的设计理念:通过消除NMS与DFL,CPU推理速度显著提升,同时在各尺寸下均保持了精度。

导出格式与硬件兼容性

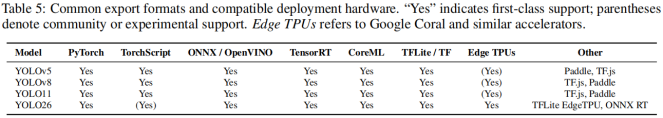

现代YOLO实现高度重视可移植性。Ultralytics生态提供导出脚本,可将PyTorch权重转换为多种部署格式,从而在不同硬件上实现高效推理。

YOLOv5引入了完整的导出流水线:模型可保存为原生PyTorch权重(.pt)、TorchScript(.torchscript,用于嵌入C++应用)、ONNX(.onnx,用于跨框架互操作)、OpenVINO(面向IntelCPU与VPU)、TensorRT(.engine,面向NVIDIAGPU)、CoreML(.mlmodel,面向iOS设备)、TensorFlowSavedModel、GraphDef与TFLite(.tflite,面向Android与微控制器),以及EdgeTPU、TensorFlow.js和PaddlePaddle等专用格式。

导出至ONNX或OpenVINO通常可使CPU推理速度提升3倍,而转换为TensorRT可使GPU速度提升5倍。表5总结了各Ultralytics版本支持的主要导出格式与目标硬件。

YOLOv8优化了导出接口,提供命令行参数选择格式并支持混合精度(如FP16)优化。

YOLO11保留了这一灵活性,并在ONNX与TensorRT导出中新增了定向边界框支持。

YOLO26简化的检测头与DFL移除进一步精简了转换流程:由于无需分布回归或NMS,导出的计算图包含更少的自定义算子,可更清晰地映射到ONNX、TensorRT、CoreML与TFLite后端。

这种增强的可移植性确保PyTorch训练的模型能以最小工程代价嵌入C++流水线、移动应用或网页环境。

量化与边缘推理

量化是将浮点模型转换为低精度表示的技术,旨在减少内存占用并加速推理。

YOLOv5的导出流水线支持通过ONNXRuntime、TensorRT或TFLite实现半精度(FP16)与8位整数(INT8)量化。FP16通常可使内存占用减半、吞吐量翻倍(在兼容GPU上);INT8可在CPU与NPU上进一步提升性能,但如果校准不当会导致小幅精度下降。

YOLOv8继承了这些能力,并集成了混合精度训练以简化量化感知部署。

YOLO11继续支持FP16/INT8导出,并通过减少深度卷积与归一化权重分布提升了量化后精度。

YOLO26特别强调量化鲁棒性:

通过消除DFL与采用无NMS解码器,其计算图避免了难以量化的自定义算子。实验表明,YOLO26的INT8导出版本在资源受限硬件(如NVIDIAJetsonOrin/Xavier系列、高通骁龙AI加速器、ARMCPU)上部署时,mAP几乎与FP32版本一致。此外,YOLO26支持张量分解与通道剪枝,可进一步减小模型尺寸。

Jetson平台是边缘推理的常见目标:

在TensorRTFP16模式下编译时,YOLOv5n在T4GPU上实现了低于2ms的延迟;YOLOv8n与YOLO11n也表现出相似的低延迟,且精度更高。

在JetsonXavierNX上进行INT8推理时,YOLOv8n能以18–20ms/帧的延迟保持高精度;而YOLO26n凭借简化的检测头,可在更低延迟下实现相当的精度。

在CPU上,使用OpenVINO或ONNXRuntime部署ONNX模型相比PyTorch可显著提速;例如,YOLO26n在x86处理器上的速度约为YOLOv8n的2倍,且精度相当。

在移动设备上,TFLite与CoreML导出支持实时推理;YOLOv8s与YOLO26s在现代智能手机上可实现30帧/秒的处理速度,为端侧视觉任务提供了极具吸引力的解决方案。

PART/5

挑战与未来方向

YOLO系列的持续进步不断突破实时目标检测的边界,但仍存在若干未解决的挑战。密集场景、领域自适应、CNN-Transformer混合架构的融合、基于基础模型的开放词汇检测,以及边缘感知训练,都是当前活跃的研究方向。本节将分析这些挑战,并展望未来发展的潜在方向。

现存局限:密集场景与领域自适应

在拥挤环境中,传统的非极大值抑制(NMS)难以区分重叠目标,容易导致漏检与误检。Soft-NMS、自适应框融合与加权抑制等技术试图缓解这一问题,但需要精细调参。无锚框检测器提升了定位粒度,但在密集场景下的性能仍落后于人类感知水平。

针对密集场景的专用数据集与合成数据增强可用于训练检测器识别紧密排列的目标,多尺度特征融合有助于识别小物体,但遮挡问题依然棘手。

领域自适应是另一大障碍:在源数据集上训练的模型,在光照、纹理或传感器特性不同的新场景中泛化能力较差。无监督领域自适应方法(如对抗对齐、循环一致风格迁移与伪标签优化)试图缩小这一差距,而元学习与持续学习方法则支持对新环境的快速适配。然而,稳定性、灾难性遗忘,以及缺乏领域偏移的标准化基准,仍阻碍着进展。未来工作可能结合显式场景理解与领域感知归一化层,并在多样化的无标注图像上进行自监督预训练,以进一步缩小差距。

潜在的CNN-Transformer混合设计

卷积网络能高效捕捉局部空间模式,而Transformer擅长建模长距离依赖。CNN-Transformer混合架构旨在结合两者优势,例如在卷积骨干中集成轻量注意力模块,或为目标查询添加Transformer解码器。

早期的例子包括在残差块中插入轴向或瓶颈自注意力层的网络,以及用多头注意力替代部分颈部结构以获取全局上下文的检测器。

检测Transformer(DETR)在CNN特征之上引入了Transformer解码器,但收敛速度较慢;后续变体结合了稀疏的层级注意力卷积,以平衡精度与效率。

视觉骨干网络(如CoAtNet与Next-ViT)系统性地融合了卷积与注意力阶段,而HyperACE等检测头则采用超图增强自注意力,以聚合超越两两交互的特征关联。

未来YOLO迭代可能采用动态适配器,根据场景复杂度在CNN与Transformer组件之间传递信息;基于搜索的设计工具可根据部署约束自动配置最优混合拓扑。随着计算资源的增长,混合架构有望缩小轻量检测器与基于Transformer的模型之间的性能差距。

开放词汇检测与基础模型的作用

传统检测器基于固定标签集训练,限制了其识别新类别的能力。开放词汇检测借助大规模视觉-语言模型与基础模型,突破封闭词汇的局限。

CLIP、ALIGN与BLIP等技术将视觉嵌入与语言嵌入对齐,使检测器能够理解文本提示,并检测任意描述定义的目标。

DETIC与GLIP等开放词汇检测器将对比预训练与区域提议网络结合,通过将图像区域与自然语言中的类别名称匹配,实现对未见类别的检测。

近期研究探索了零样本与少样本学习,模型通过读取类别定义或利用语义层次结构来推断新类别。

与基础模型的集成可扩展YOLO的能力:例如,检测器的骨干可加入CLIP编码器,或其分类头可替换为语言条件模块。结合图像-标题对、边界框标注与合成描述的多模态训练机制,有助于模型学习通用的目标概念。未来研究可能引入推理模块以解释组合查询(如“找到架子上的红色盒子”),并集成语言模型以实现交互式检测。挑战包括确保语言条件响应的可靠性、处理模糊描述,以及在复杂度增加的情况下维持实时性能。

边缘感知训练与硬件在环优化

在边缘设备上部署检测器需要算法与硬件的协同设计。量化感知训练与混合精度策略可在保持精度的同时降低内存与计算需求。通道剪枝与神经架构搜索可针对目标处理器调整网络拓扑,但静态优化可能无法适应运行时变化。

硬件在环优化通过在训练阶段引入部署环境的反馈(如延迟、功耗与温度数据)来解决这一问题,引导搜索满足约束的架构。Once-For-All等框架支持单个超网络动态适配不同设备,而强化学习方法则训练控制器根据实时反馈调整网络宽度、深度或输入分辨率。

边缘感知训练进一步扩展了这一概念,将设备特定操作(如张量核心、DSP)直接纳入计算图,确保梯度更新反映实际硬件行为。持续性能分析与自适应量化可在硬件或负载条件变化时维持效率。例如,在Jetson设备上运行的模型可在电池电量低时降低精度或跳过层,以牺牲精度换取能耗节省。未来研究可能探索从数据采集、预处理到神经网络推理与后处理的全流水线协同优化,以在异构边缘环境中实现稳健、高吞吐量的部署。

有相关需求的你可以联系我们!

END

转载请联系本公众号获得授权

计算机视觉研究院学习群等你加入!

ABOUT

计算机视觉研究院

计算机视觉研究院主要涉及深度学习领域,主要致力于目标检测、目标跟踪、图像分割、OCR、模型量化、模型部署等研究方向。研究院每日分享最新的论文算法新框架,提供论文一键下载,并分享实战项目。研究院主要着重”技术研究“和“实践落地”。研究院会针对不同领域分享实践过程,让大家真正体会摆脱理论的真实场景,培养爱动手编程爱动脑思考的习惯!

往期推荐

🔗

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)