混淆矩阵玩不转?场景里它的 “正反” 格式能坑哭算法工程师——两分钟带你搞明白

摘要:混淆矩阵是评估机器学习模型的核心工具,包含TP、TN、FP、FN四种判断结果。在安全领域(如入侵检测),正样本通常代表攻击流量,负样本为正常流量。混淆矩阵存在两种常见格式:理论标准格式(正例在前)和Python sklearn格式(负例在前)。关键指标如精确率(Precision)和召回率(Recall)存在权衡关系,安全场景更关注高召回率(减少漏报)。F1分数适合处理样本不平衡问题,而准确

引言:

“你以为混淆矩阵就只是 TP/TN/FP/FN 那四张表?在入侵检测这类安全场景里,它能把算法新人坑到怀疑人生 —— 同样是‘正样本’,放左上角和放右上角,可能直接让你的模型从‘业界标杆’变成‘漏报大王’。

今天这篇,我要扒光混淆矩阵的‘两副面孔’:为啥安全领域偏要把‘攻击流量’当正例?Python sklearn 的默认格式又埋了什么雷?看完这篇,别再让你的模型死在‘表格格式’这种低级错误上。”

一、混淆矩阵(Confusion Matrix)的两种定义

1.1 基本定义

混淆矩阵是所有评价指标的**“母体”**。它不仅仅是一张表,它代表了模型对现实世界的四种判断结果。

假设我们定义:

-

正样本 (Positive, 1) = 攻击流量 (Attack)

-

负样本 (Negative, 0) = 正常流量 (Benign)

逻辑映射如下:

| 简称 | 英文全称 | 逻辑含义 (IDS视角) | 结果好坏 |

| TP | True Positive | 真阳性:真的是攻击,模型也报警了。 | ✅ 抓住了坏人 |

| TN | True Negative | 真阴性:真的是正常,模型也放行了。 | ✅ 没打扰好人 |

| FP | False Positive | 假阳性:其实是正常,模型却报警了。(误报) | ❌ 狼来了(用户体验差) |

| FN | False Negative | 假阴性:其实是攻击,模型却放行了。(漏报) | ❌ 漏网之鱼(安全事故) |

1.2 理论/统计学标准格式(正例在前)

这是讲解公式(如召回率、F1值)时最常用的格式,强调“正例(Positive, 1)”在左上角。

| 预测为正 (Predicted Positive, 1) | 预测为负 (Predicted Negative, 0) | |

| 真实为正 (Actual Positive, 1) | TP (真阳性) | FN (假阴性/漏报) |

| 真实为负 (Actual Negative, 0) | FP (假阳性/误报) | TN (真阴性) |

记忆口诀: 对角线(TP, TN)是预测对的;非对角线(FP, FN)是预测错的。

1.3 代码实战格式(Python scikit-learn 默认)

注意! 这是面试官让你手写代码或看打印结果时最容易搞混的地方。 在 sklearn.metrics.confusion_matrix 中,默认是按照标签的排序(0在前,1在后)来排列的。因此,负例(Negative, 0)通常排在第一行/第一列。

代码输出的 Array 结构:

# array([[TN, FP],

# [FN, TP]])对应表格:

| 预测为 0 (Negative) | 预测为 1 (Positive) | |

| 真实为 0 (Negative) | TN (真阴性) | FP (假阳性) |

| 真实为 1 (Positive) | FN (假阴性) | TP (真阳性) |

二、举例数值计算说明

为了彻底搞懂,我们设定一个具体的测试集场景:

-

总共有 100条 流量数据。

-

现实中:10条是攻击,90条是正常(典型的不平衡样本)。

模型预测结果如下:

-

模型认为有 8条 是攻击(其中 6条是对的,2条是看走眼了)。

-

模型认为有 92条 是正常(其中 88条是对的,4条其实是攻击但没看出来)。

填入混淆矩阵:

| 预测为攻击 (Predicted 1) | 预测为正常 (Predicted 0) | 总计 (Actual) | |

| 真实为攻击 (Actual 1) | TP = 6 | FN = 4 | 10 |

| 真实为正常 (Actual 0) | FP = 2 | TN = 88 | 90 |

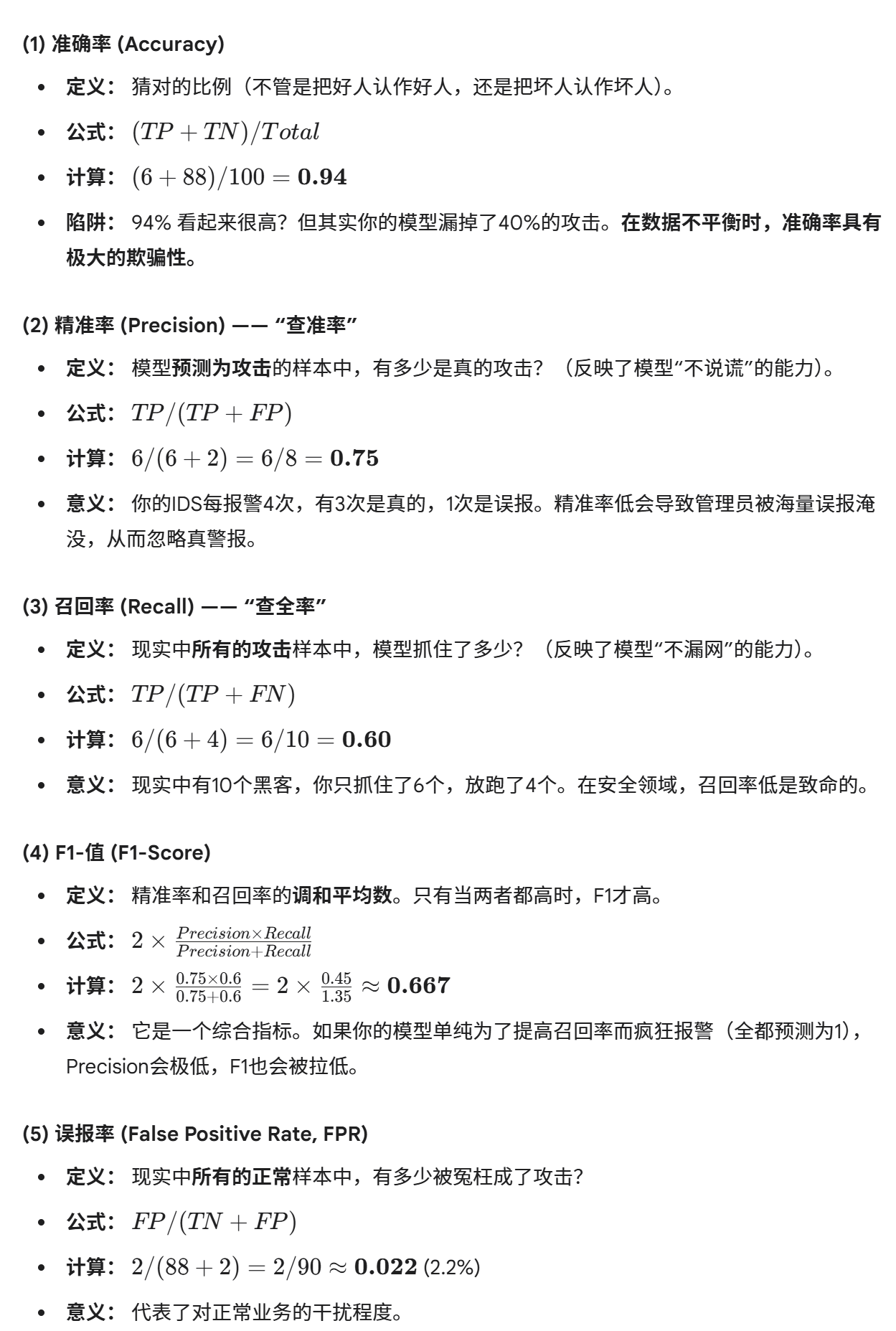

现在我们基于这组数据计算所有指标:

三、指标之间的关系与博弈

这几个指标并不是孤立的,它们之间存在**权衡(Trade-off)关系,主要体现在阈值(Threshold)**的移动上:

-

Precision vs. Recall(此消彼长):

-

如果你把IDS调得非常敏感(宁可错杀一千,不可放过一个),你的 Recall 会升高(FN减少),但 Precision 会降低(FP增加)。

-

如果你把IDS调得非常保守(必须有了实锤才报警),你的 Precision 会升高,但 Recall 会降低(容易漏掉隐蔽攻击)。

-

-

Accuracy vs. F1:

-

在正负样本极度不平衡(如 99:1)的情况下,全猜0也能得到 99% Accuracy,但 F1 是 0。此时 F1 才是真正的评判标准。

-

四、上述指标在整个流程中处于什么位置 & 作用

在机器学习/深度学习的全流程中,这些指标处于 “模型评估与验证 (Evaluation & Validation)” 阶段。

具体位置:

-

数据准备

-

模型训练

-

--> 阈值调整与模型评估 <-- (就是这里)

-

模型部署

具体作用:

-

模型优劣的“裁判”: 训练完模型后,Loss值(损失函数)只能告诉你收敛没,而 Precision/Recall 才能告诉你这个模型能不能用。

-

例子: 你的车联网IDS项目,如果Recall只有50%,那是绝对不能上线的,因为会漏掉一半攻击。

-

-

选取最佳阈值 (Threshold Tuning): 模型输出的通常是一个概率(如 0.85)。我们需要划一条线(比如大于 0.5 算攻击)。

-

通过观察 FPR 和 Recall 的关系(ROC曲线),你可以根据业务需求调整这个阈值。

-

场景: 对于金融支付风控,可能要求极高的 Recall(哪怕多打几个确认电话);对于垃圾邮件分类,可能要求较高的 Precision(绝不能把重要邮件扔进垃圾箱)。

-

-

指导模型优化方向:

-

如果 FP 高(误报多):说明模型对特征太敏感,可能需要更多“难负样本”进行训练,或者做数据清洗(去噪)。

-

如果 FN 高(漏报多):说明模型学得不够好,可能需要加强特征提取(如你用的 BiLSTM 提取时序特征),或者使用 Focal Loss 强迫模型关注少量的攻击样本。

-

五、总结

-

必答点: 必须提到“在安全场景下,我们通常更关注 Recall(不能漏防),但也要控制 FPR(用户体验)”。

-

加分点: 提到 F1-Score 是处理数据不平衡(Data Imbalance)时的核心指标,而 Accuracy 在安全领域通常是“虚荣指标”。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)