基于双自适应特征融合的工地不安全行为检测算法 DAF‑YOLO

计算机视觉研究院主要涉及深度学习领域,主要致力于目标检测、目标跟踪、图像分割、OCR、模型量化、模型部署等研究方向。研究院主要着重”技术研究“和“实践落地”。DAF-YOLO:mAP@0.5=93.8%,mAP@0.5:0.95=60.5%,精确率 92.4%,召回率 89.6%;监控摄像头多部署于塔吊、立杆等高机位,作业人员与安全帽在图像中占比极低,常规模型特征提取不足,漏检率居高不下。DAF‑

点击蓝字

关注我们

关注并星标

从此不迷路

计算机视觉研究院

公众号ID|计算机视觉研究院

学习群|扫码在主页获取加入方式

https://pmc.ncbi.nlm.nih.gov/articles/PMC12694353/pdf/sensors-25-07216.pdf

计算机视觉研究院专栏

Column of Computer Vision Institute

本文提出的一种双自适应特征融合检测算法 DAF‑YOLO,以 YOLOv5s 为基线模型,通过前端与后端双模块协同优化,显著提升复杂背景下小目标不安全行为的检测能力。

PART/1

难点挑战

施工现场视觉检测任务面临两大典型难点:

1.背景复杂度高

场地内钢筋、模板、建材等杂物堆叠,纹理与颜色干扰强烈,易导致模型特征误匹配与误检。

2.目标尺度极小

监控摄像头多部署于塔吊、立杆等高机位,作业人员与安全帽在图像中占比极低,常规模型特征提取不足,漏检率居高不下。

现有 YOLO 系列模型在通用数据集表现优异,但直接迁移至工地场景时,对小目标与复杂背景的适应性明显不足。

PART/2

DAF‑YOLO 网络架构设计

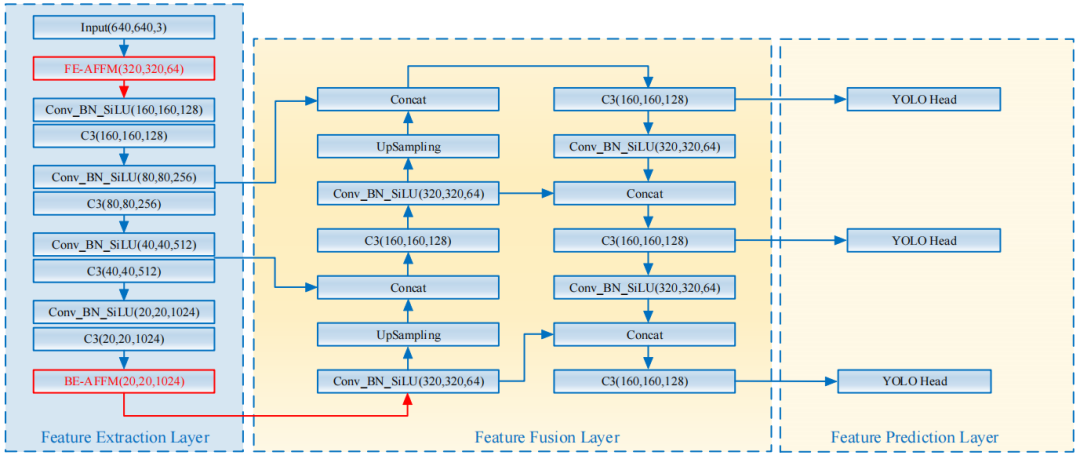

本文以YOLOv5s为基础框架,通过前端自适应特征融合模块(FE‑AFFM)与后端自适应特征融合模块(BE‑AFFM)构建双自适应融合机制,形成完整的DAF‑YOLO 架构。

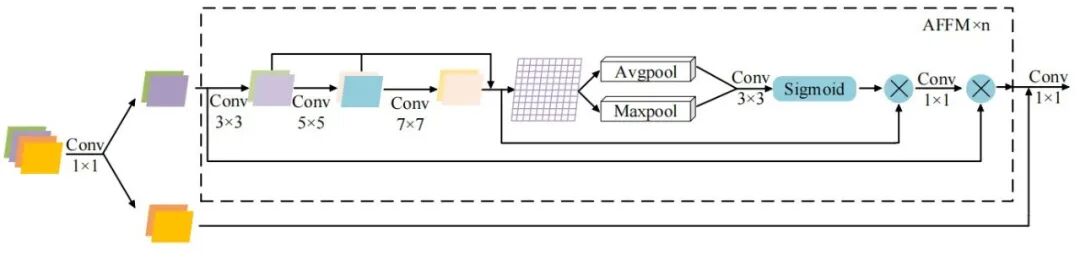

2.1 前端自适应特征融合模块 FE‑AFFM

在主干网络头部引入 FE‑AFFM,从输入源头强化特征挖掘能力:

-

采用 1×1 卷积进行通道压缩,降低计算开销;

-

多分支并行执行 3×3、5×5、7×7 卷积,实现多尺度特征提取;

-

结合平均池化与最大池化生成注意力权重,突出关键特征;

-

残差结构缓解梯度消失,提升网络非线性表达能力。

【FE‑AFFM 结构示意图】

FE‑AFFM 使模型在初始阶段即可滤除部分背景干扰,聚焦作业人员与防护装备特征,为后续深层提取提供高质量特征输入。

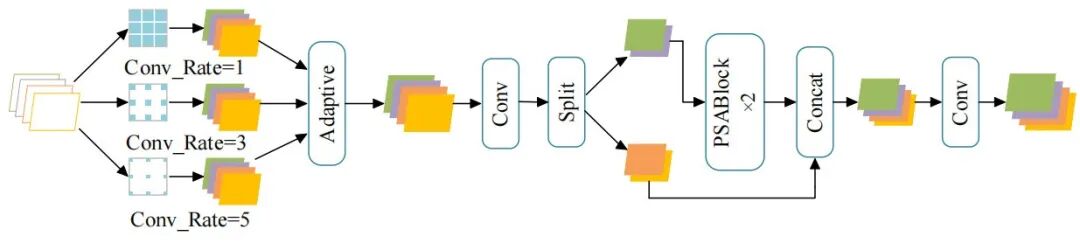

2.2 后端自适应特征融合模块 BE‑AFFM

以 BE‑AFFM 替换原 SPPF 模块,在主干网络尾部实现高效特征融合:

-

采用扩张率为 1、3、5 的空洞卷积,灵活扩展感受野,捕获多尺度上下文信息;

-

引入自适应特征融合机制,抑制冗余信息、强化显著特征;

-

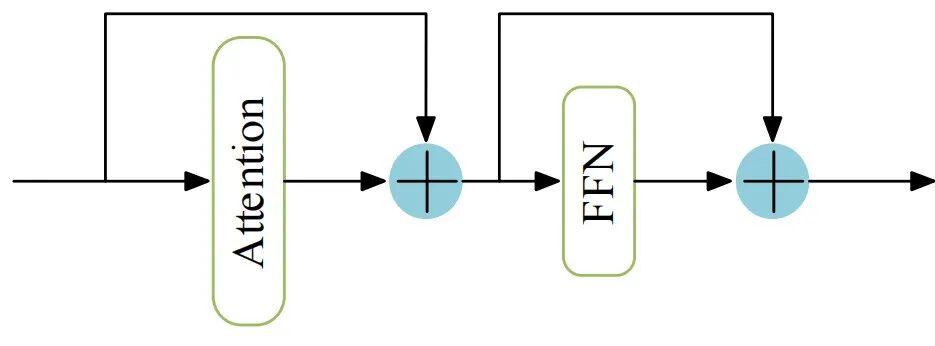

嵌入 PSABlock 多头注意力模块,提升关键区域特征聚焦能力;

-

通道拆分与多路特征提取,丰富梯度信息,增强整体表征能力。

【BE‑AFFM 结构示意图】

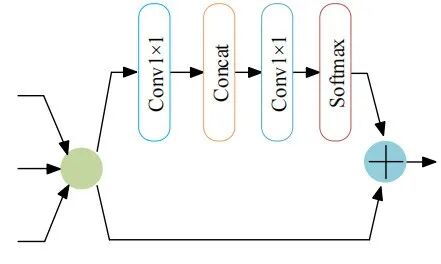

【自适应模块结构图】

【PSABlock 模块结构图】

2.3 整体网络结构

通过 FE‑AFFM 与 BE‑AFFM 前后协同,形成 “源头增强 — 深层融合” 的双自适应机制,全面提升模型在复杂工地场景的检测性能。

【DAF‑YOLO 整体网络架构图】

PART/3

实验设置与数据集

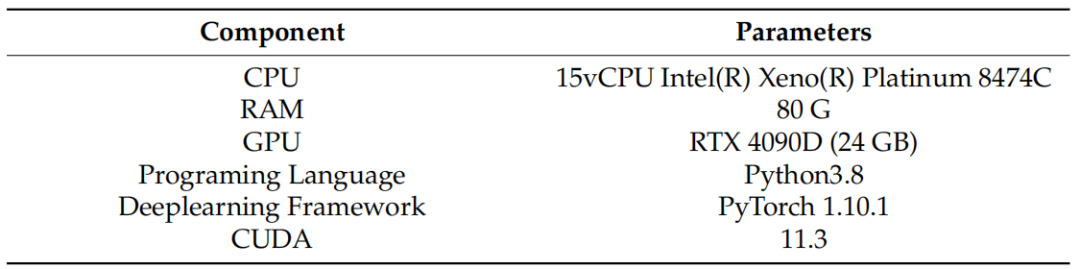

3.1 实验环境

-

自制数据集平台:Intel Xeon Platinum 8474C CPU、80GB RAM、RTX 4090D 24GB GPU;

-

框架:PyTorch 1.10.1、CUDA 11.3、Python 3.8;

-

训练参数:Epoch=150,Batch Size=16,初始学习率 = 0.01,Adam 优化器。

【自制数据集实验配置】

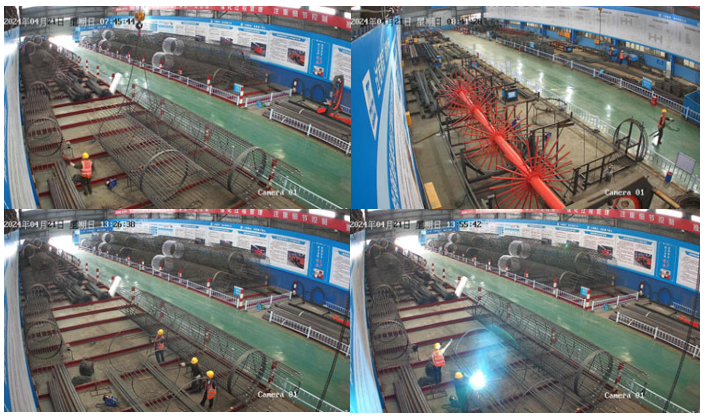

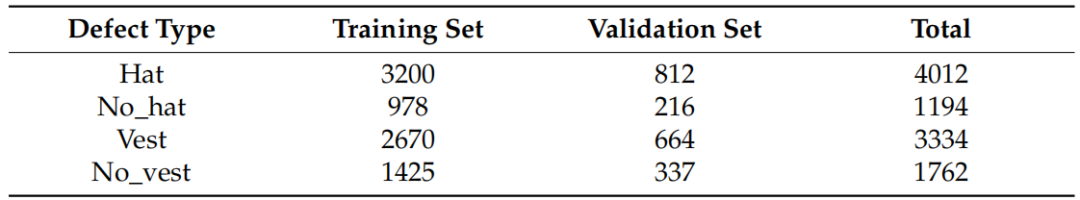

3.2 数据集构建

- 自制工地不安全行为数据集

原始图像 1055 张,经水平翻转等增强后得到 2110 张,标注目标 10302 个,包含:

-

佩戴安全帽 / 未佩戴安全帽(Hat/No_hat)

-

穿着反光背心 / 未穿着反光背心(Vest/No_vest)

【自制数据集样本示例】

【自制数据集目标类别与数量统计】

- 公开数据集 SHWD

Safety-Helmet-Wearing Dataset,共 7581 张图像,用于验证模型泛化能力。

【SHWD 数据集样本示例】

PART/4

实验结果与分析

4.1 评价指标

采用目标检测通用指标:精确率 P、召回率 R、mAP@0.5、mAP@0.5:0.95。

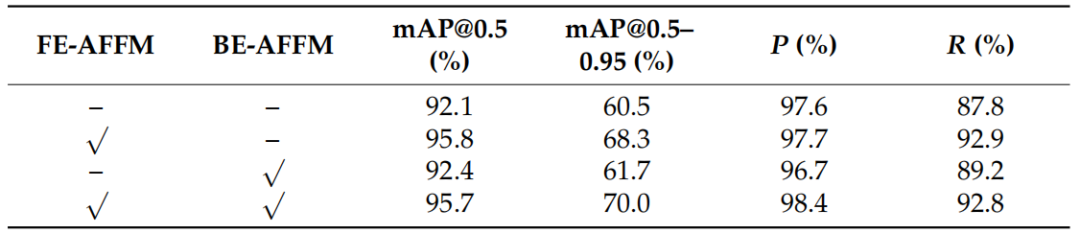

4.2 消融实验

在自制数据集上验证双模块有效性:

-

单独使用 FE‑AFFM:mAP@0.5 提升 3.7%;

-

单独使用 BE‑AFFM:性能增益有限;

-

双模块协同:mAP@0.5 达95.7%,较基线 YOLOv5s 提升3.6%;mAP@0.5:0.95 提升9.5%。

【消融实验结果表】

结果表明,前后端双自适应融合存在显著协同效应,可全面提升小目标检测精度。

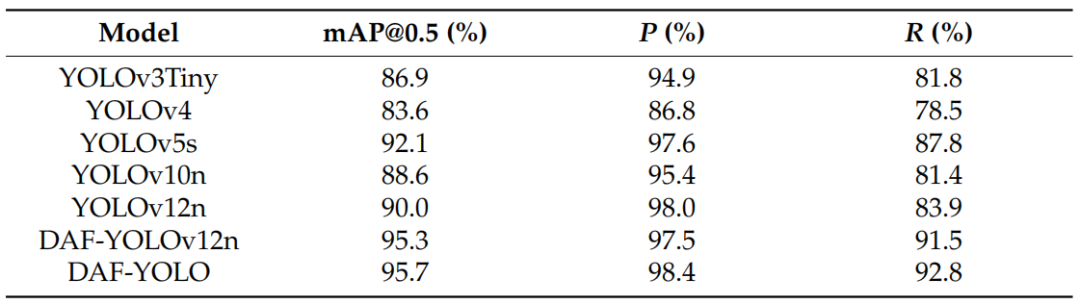

4.3 与主流算法对比

在自制数据集上对比 YOLOv3-Tiny、YOLOv4、YOLOv5s、YOLOv10n、YOLOv12n:

-

DAF‑YOLO 的 mAP@0.5=95.7%,精确率 98.4%,召回率 92.8%,全面领先对比算法;

-

将双模块迁移至 YOLOv12n 得到 DAF-YOLOv12n,mAP@0.5 提升 5.3%,验证模块通用性。

【自制数据集算法对比结果】

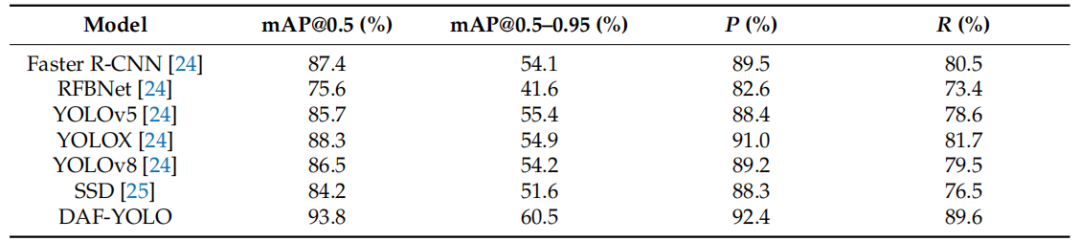

4.4 公开数据集 SHWD 验证

对比 Faster R-CNN、RFBNet、SSD、YOLOv5/YOLOX/YOLOv8 等模型:

-

DAF-YOLO:mAP@0.5=93.8%,mAP@0.5:0.95=60.5%,精确率 92.4%,召回率 89.6%;

-

显著优于两阶段与单阶段主流检测器,泛化能力突出。

【SHWD 数据集算法对比结果】

4.5 可视化结果分析

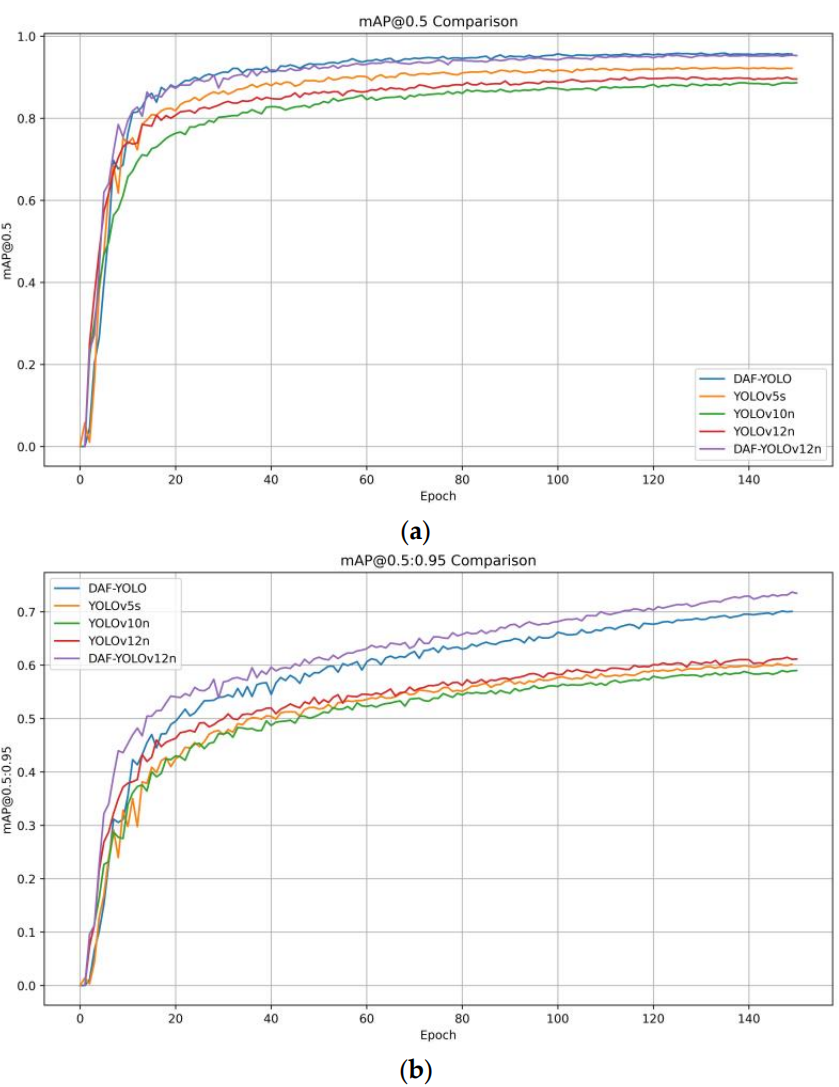

- mAP 曲线对比

训练 15 轮后,DAF-YOLO 收敛速度显著加快,mAP 稳定高于基线模型。

【mAP@0.5 与 mAP@0.5:0.95 曲线对比图】

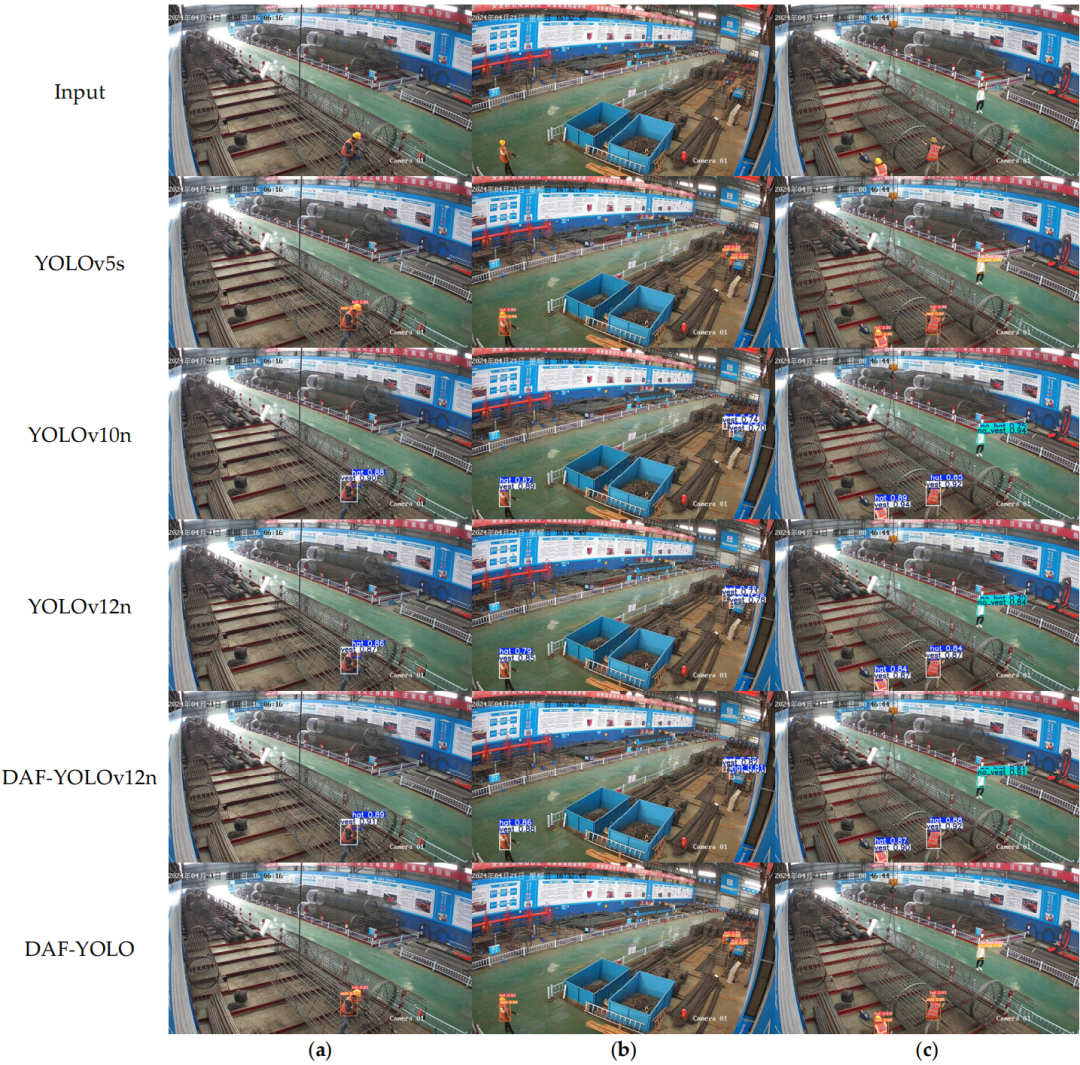

- 实景检测效果

远距离小目标安全帽:

-

YOLOv5s 置信度≈50%;

-

YOLOv10/v12≈60%;

- DAF-YOLO≈90%。

【实景检测结果对比图】

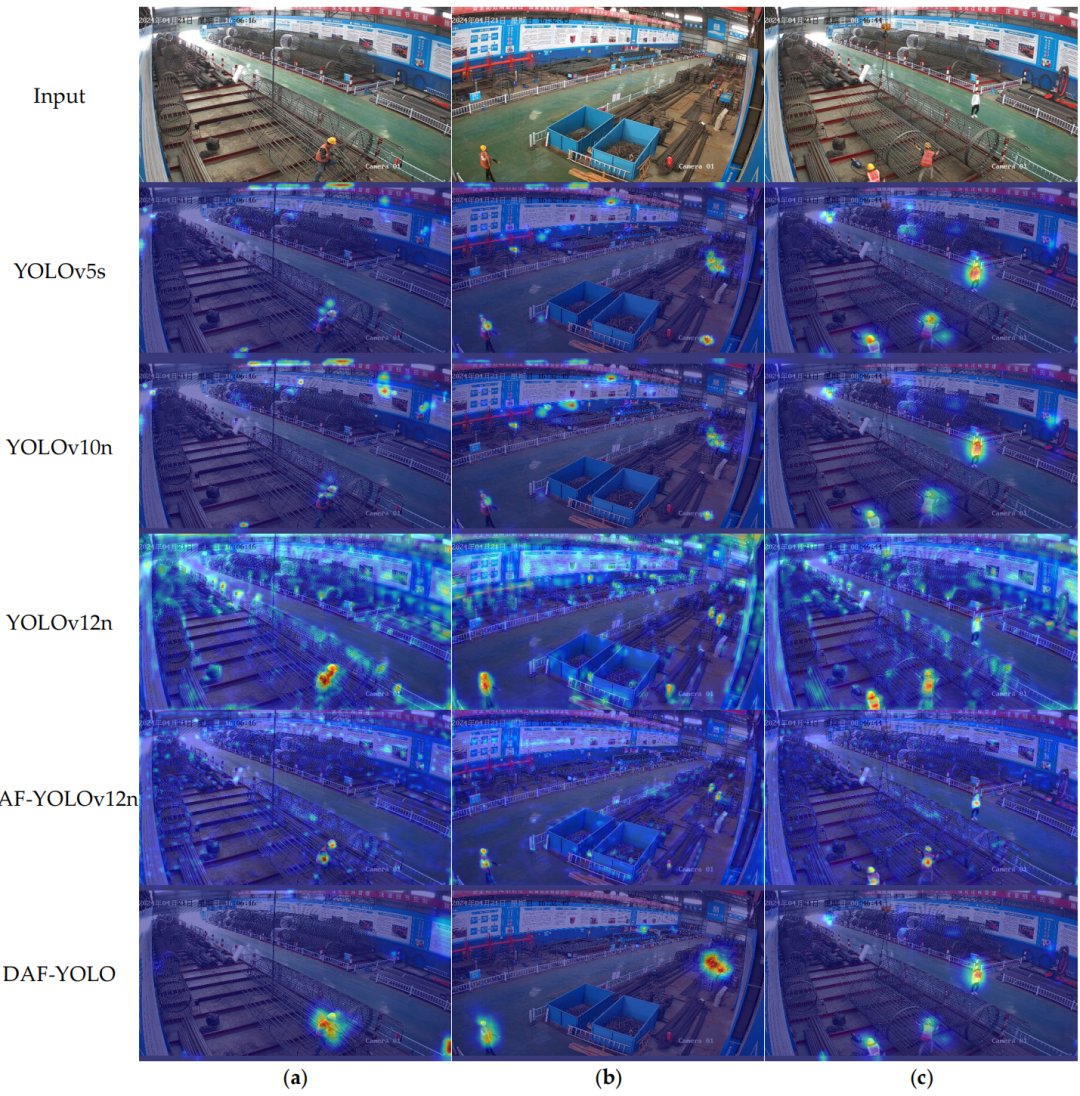

- 热力图分析

DAF-YOLO 可有效抑制工地杂物、警示柱、墙面海报等干扰,注意力高度聚焦于检测目标,抗干扰能力显著提升。

【热力图可视化对比图】

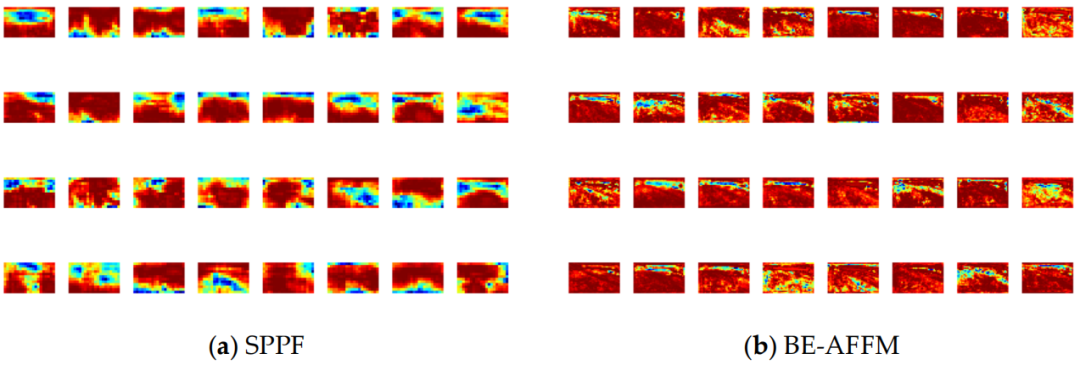

- 特征图可视化

BE-AFFM 输出特征层次清晰、边缘锐利,优于 SPPF 模块的模糊平滑特征。

【SPPF 与 BE-AFFM 特征图对比】

PART/5

结论

本文提出的DAF-YOLO通过双自适应特征融合机制,有效解决施工现场复杂背景与小目标检测难题:

-

以 FE‑AFFM 强化源头特征挖掘,提升抗干扰能力;

-

以 BE‑AFFM 替代 SPPF,实现多尺度灵活特征融合;

-

在自制数据集 mAP@0.5 达 95.7%,较 YOLOv5s 提升 3.6%;

-

在公开数据集 SHWD 同样取得最优性能,泛化性与实用性突出。

该模型轻量化程度高、部署友好,可直接应用于工地边缘端智能监控,为建筑施工不安全行为实时检测提供可靠技术方案。未来将进一步优化遮挡与极端光照鲁棒性,并向行为识别、多目标跟踪方向扩展,构建一体化智慧安全监控系统。

有相关需求的你可以联系我们!

END

转载请联系本公众号获得授权

计算机视觉研究院学习群等你加入!

ABOUT

计算机视觉研究院

计算机视觉研究院主要涉及深度学习领域,主要致力于目标检测、目标跟踪、图像分割、OCR、模型量化、模型部署等研究方向。研究院每日分享最新的论文算法新框架,提供论文一键下载,并分享实战项目。研究院主要着重”技术研究“和“实践落地”。研究院会针对不同领域分享实践过程,让大家真正体会摆脱理论的真实场景,培养爱动手编程爱动脑思考的习惯!

往期推荐

🔗

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)