本地部署ai大模型

本文介绍了使用Ollama快速部署AI模型的完整流程。首先需要从官网下载并安装Ollama软件,安装完成后程序会自动在后台运行。接着配置模型存储路径,通过修改系统环境变量完成。然后从Ollama官网选择合适的模型(示例选用qwen3.5模型),将下载命令复制到CMD窗口执行即可完成模型下载。最后推荐安装CherryStudio可视化工具,方便模型管理和使用。整个过程简明扼要,适合初学者快速上手AI

·

Ollama 一键部署(推荐)

1. 安装 Ollama

- 官网下载:ollama.com

- 安装后打开,后台自动运行(Mac 顶栏有图标,Windows 托盘有图标)。

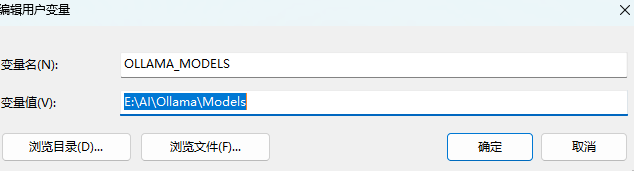

2.. 设置模型安装位置

打开系统环境变量

3.下载模型

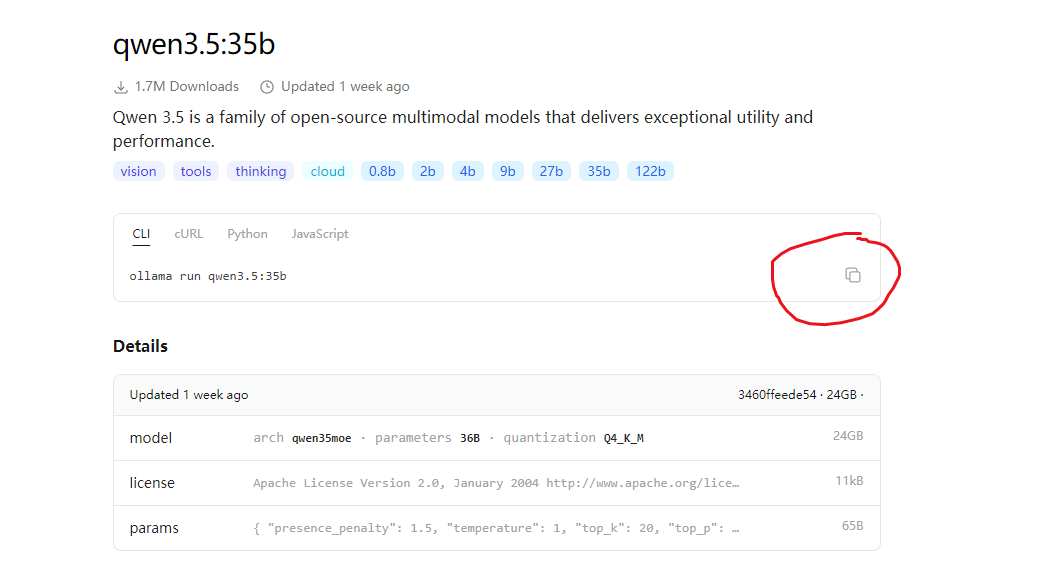

ollama官网左上角选择Models

选择自己要下的模型

我这里选择qwen3.5

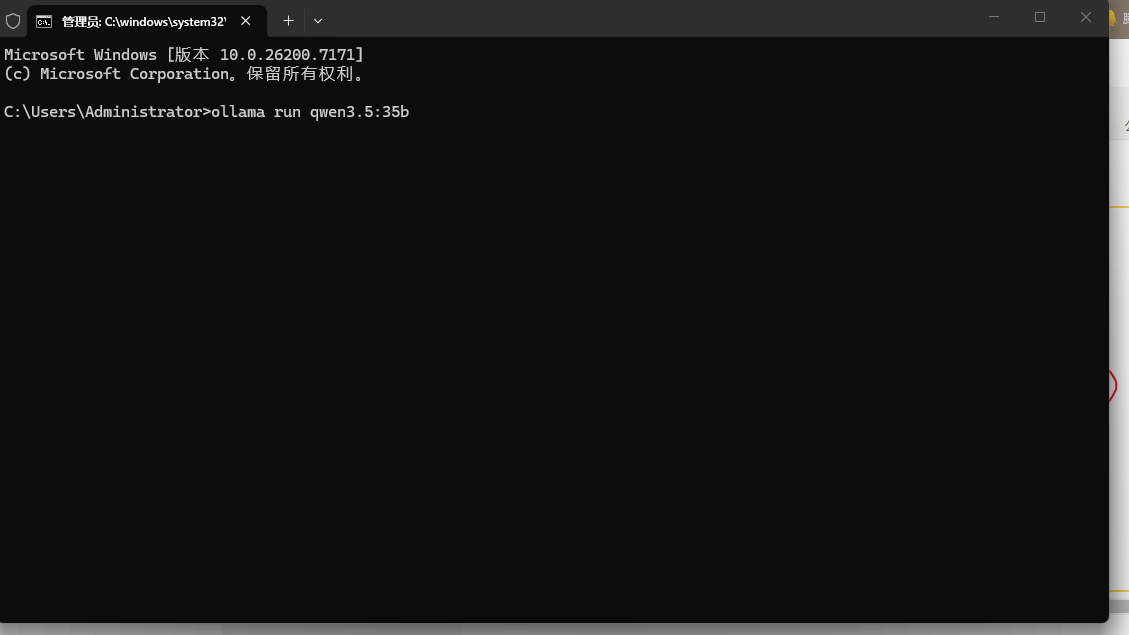

复制代码到cmd中运行(按回车):win+R 键输入CMD 回车

等待下载完成即可

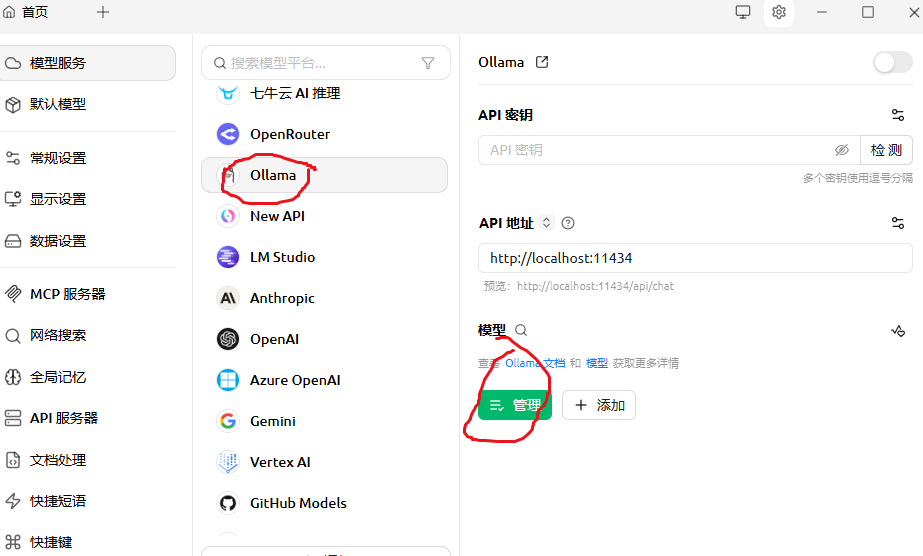

4.安装可视化工具

Cherry Studio

官网:https://www.cherry-ai.com/download

在Cherry Studio设置中找到ollama选择管理选择自己下载到本地的模型就可以使用了

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)