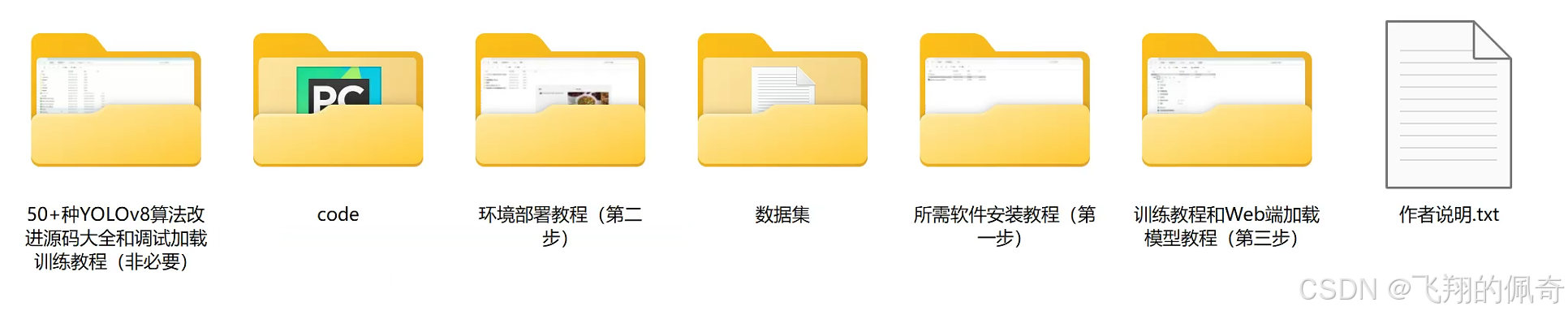

【完整源码+数据集+部署教程】条形码图像分割系统源码&数据集分享 [yolov8-seg-SPDConv&yolov8-seg-swintransformer等50+全套改进创新点发刊_一键训练教程

【完整源码+数据集+部署教程】条形码图像分割系统源码&数据集分享 [yolov8-seg-SPDConv&yolov8-seg-swintransformer等50+全套改进创新点发刊_一键训练教程

背景意义

随着信息技术的迅猛发展,条形码作为一种重要的商品识别和信息管理工具,广泛应用于零售、物流、制造等多个领域。条形码不仅提高了商品管理的效率,还为企业的供应链管理提供了重要支持。然而,传统的条形码识别方法在复杂环境下的识别率往往受到限制,尤其是在光照变化、遮挡和背景复杂等情况下,条形码的准确识别和分割变得尤为困难。因此,基于深度学习的图像分割技术在条形码识别中的应用逐渐受到重视。

YOLO(You Only Look Once)系列模型以其快速的检测速度和较高的准确率,成为目标检测领域的热门选择。YOLOv8作为该系列的最新版本,进一步提升了模型的性能和适用性。通过对YOLOv8进行改进,可以更好地适应条形码图像的特征,尤其是在实例分割任务中。实例分割不仅要求识别出条形码的位置,还需要精确分割出条形码的轮廓,这对于后续的条形码解码和信息提取至关重要。

本研究基于改进YOLOv8的条形码图像分割系统,旨在提高条形码在复杂环境下的识别和分割能力。为此,我们使用了名为“obj_bar_total_11_1”的数据集,该数据集包含2800张图像,涵盖了7个不同类别的条形码。这些图像的多样性为模型的训练提供了丰富的样本,有助于提升模型的泛化能力和鲁棒性。通过对数据集的深入分析,我们可以识别出不同类别条形码的特征,从而为模型的改进提供依据。

本研究的意义在于,首先,通过改进YOLOv8模型,我们能够实现对条形码的高效分割与识别,进而提升条形码在实际应用中的准确性和可靠性。其次,基于实例分割的技术方案,不仅能够处理标准条形码,还能够应对多种形态和背景的条形码,满足不同场景下的需求。此外,研究结果将为条形码识别技术的发展提供新的思路,推动相关领域的技术进步。

最后,随着智能设备和物联网技术的普及,条形码的应用场景将不断扩展,对条形码识别技术的需求也将日益增加。本研究的成果将为未来条形码识别系统的设计与实现提供重要的理论基础和实践指导,具有广泛的应用前景和社会价值。因此,基于改进YOLOv8的条形码图像分割系统的研究,不仅具有重要的学术价值,也为实际应用提供了切实可行的解决方案。

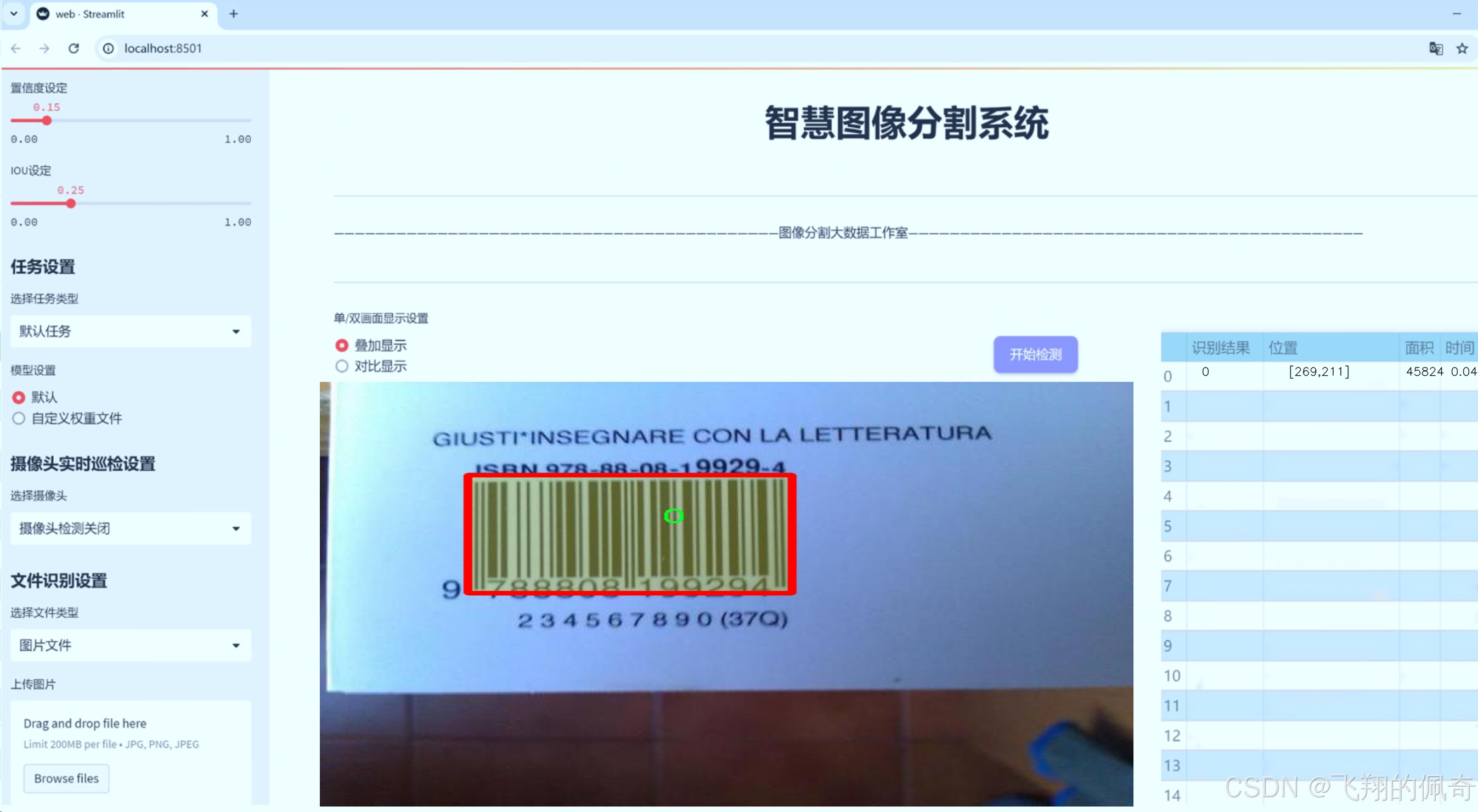

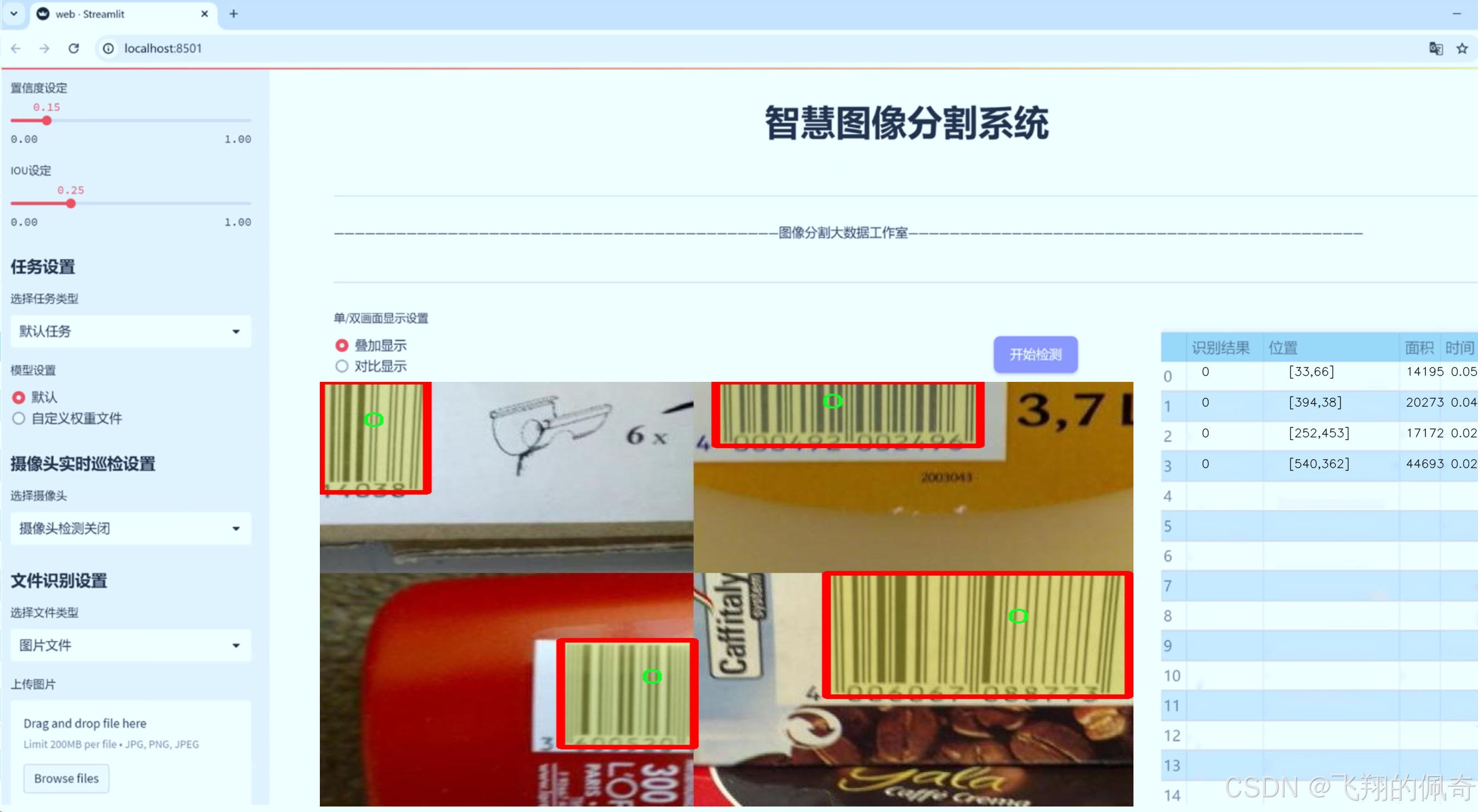

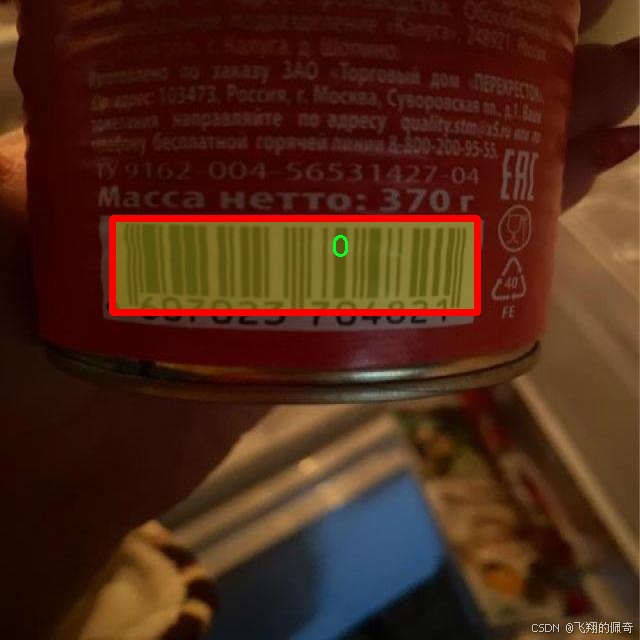

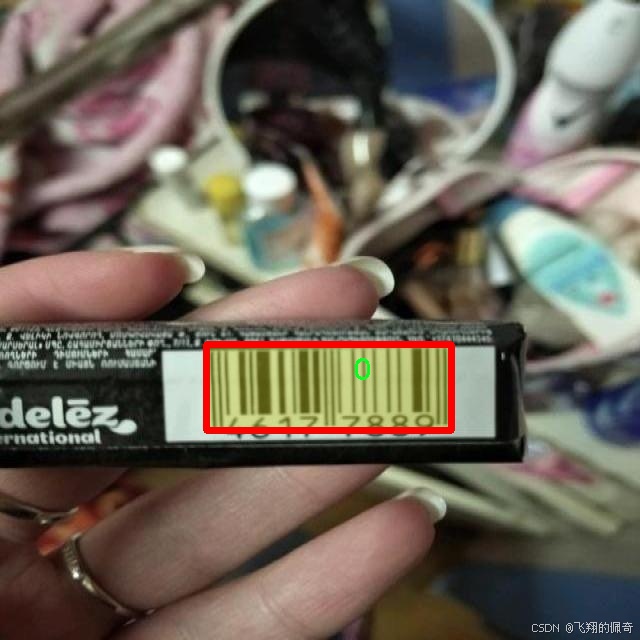

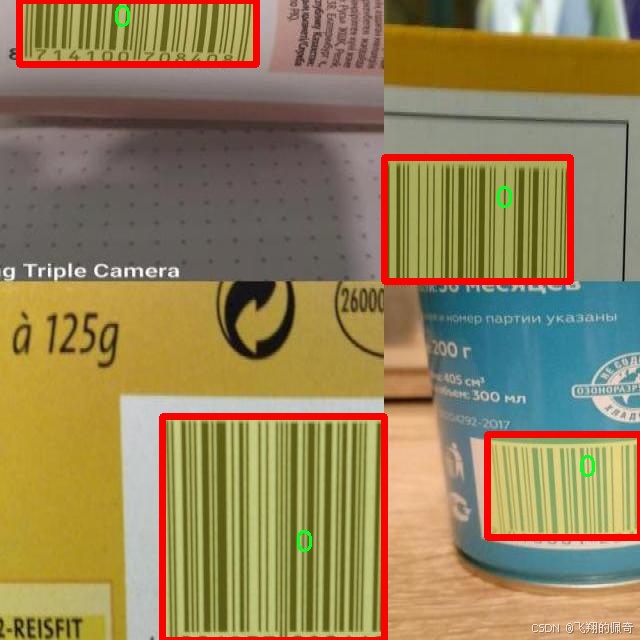

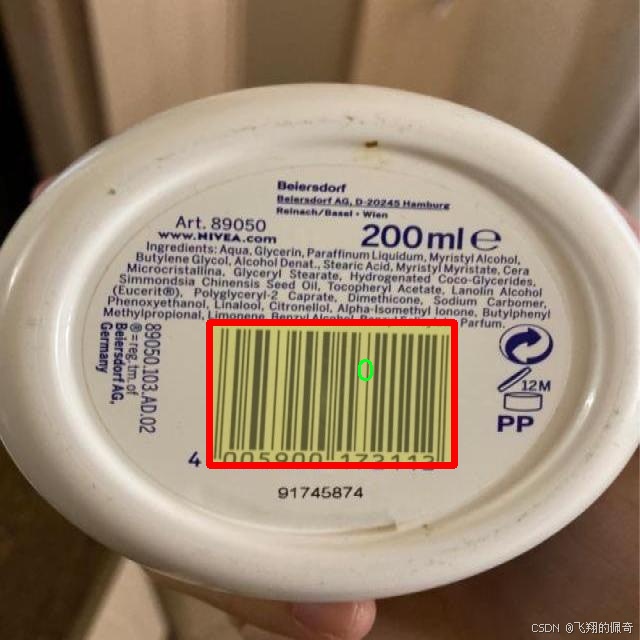

图片效果

数据集信息

在本研究中,我们使用的数据集名为“obj_bar_total_11_1”,该数据集专门用于训练和改进YOLOv8-seg的条形码图像分割系统。随着条形码在各个行业中的广泛应用,准确且高效的条形码识别和分割变得尤为重要。因此,构建一个高质量的数据集是实现这一目标的关键步骤。

“obj_bar_total_11_1”数据集包含七个类别,分别用数字“0”到“6”进行标识。这些类别的设计考虑了条形码的多样性和复杂性,确保系统能够在不同的环境和条件下进行有效的识别和分割。具体而言,这七个类别可能代表了不同类型的条形码、不同的背景或不同的条形码质量,这样的分类有助于模型在训练过程中学习到更多的特征,从而提高其在实际应用中的表现。

数据集的构建过程涉及大量的图像采集和标注工作。为了确保数据集的多样性和代表性,图像来源于不同的场景和条件,包括超市、仓库、物流中心等多种环境。这些图像不仅涵盖了不同类型的条形码,还考虑了不同的拍摄角度、光照条件和背景杂乱程度。这种多样性使得模型在训练时能够接触到更广泛的条形码特征,从而增强其泛化能力。

在数据标注方面,我们采用了精细化的标注策略。每个条形码图像都经过人工标注,确保每个类别的条形码在图像中被准确地框定和分割。这一过程不仅提高了数据集的质量,也为后续的模型训练提供了可靠的基础。标注的准确性直接影响到模型的学习效果,因此我们在标注过程中严格遵循标准化流程,确保每个标注人员都经过专业培训,以减少人为误差。

数据集的规模也是影响模型训练效果的重要因素。“obj_bar_total_11_1”数据集包含了大量的图像样本,确保了模型在训练过程中能够获得足够的样本量进行学习。这一方面能够提升模型的鲁棒性,另一方面也能有效防止过拟合现象的发生。此外,为了进一步提升模型的性能,我们还采用了数据增强技术,通过对原始图像进行旋转、缩放、翻转等处理,生成更多的训练样本,从而丰富数据集的多样性。

总之,“obj_bar_total_11_1”数据集为改进YOLOv8-seg的条形码图像分割系统提供了坚实的基础。通过精心设计的类别划分、严格的标注流程以及丰富的图像样本,该数据集不仅能够帮助模型学习到条形码的特征,还能提升其在实际应用中的准确性和可靠性。随着研究的深入,我们期待这一数据集能够为条形码识别技术的发展做出积极贡献。

核心代码

```python

import cv2

import numpy as np

from PIL import ImageFont, ImageDraw, Image

from hashlib import md5

from model import Web_Detector

from chinese_name_list import Label_list

def generate_color_based_on_name(name):

"""

根据名称生成稳定的颜色。

使用MD5哈希函数将名称转换为颜色值。

"""

hash_object = md5(name.encode())

hex_color = hash_object.hexdigest()[:6] # 取前6位16进制数

r, g, b = int(hex_color[0:2], 16), int(hex_color[2:4], 16), int(hex_color[4:6], 16)

return (b, g, r) # OpenCV 使用BGR格式

def draw_with_chinese(image, text, position, font_size=20, color=(255, 0, 0)):

"""

在图像上绘制中文文本。

"""

image_pil = Image.fromarray(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))

draw = ImageDraw.Draw(image_pil)

font = ImageFont.truetype("simsun.ttc", font_size, encoding="unic")

draw.text(position, text, font=font, fill=color)

return cv2.cvtColor(np.array(image_pil), cv2.COLOR_RGB2BGR)

def draw_detections(image, info):

"""

在图像上绘制检测结果,包括边界框、类别名称和掩膜。

"""

name, bbox = info['class_name'], info['bbox']

x1, y1, x2, y2 = bbox

# 绘制边界框

cv2.rectangle(image, (x1, y1), (x2, y2), color=(0, 0, 255), thickness=3)

image = draw_with_chinese(image, name, (x1, y1 - 30), font_size=20)

return image

def process_frame(model, image):

"""

处理每一帧图像,进行目标检测并绘制结果。

"""

pre_img = model.preprocess(image) # 预处理图像

pred = model.predict(pre_img) # 进行预测

det = pred[0]

if det is not None and len(det):

det_info = model.postprocess(pred) # 后处理获取检测信息

for info in det_info:

image = draw_detections(image, info) # 绘制检测结果

return image

if __name__ == "__main__":

model = Web_Detector()

model.load_model("./weights/yolov8s-seg.pt") # 加载模型

# 摄像头实时处理

cap = cv2.VideoCapture(0)

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

processed_frame = process_frame(model, frame) # 处理当前帧

cv2.imshow('Camera Feed', processed_frame) # 显示处理后的帧

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows() # 释放资源

代码分析与注释说明:

-

生成颜色:

generate_color_based_on_name函数使用 MD5 哈希函数将名称转换为颜色,确保相同的名称总是生成相同的颜色。

-

绘制中文文本:

draw_with_chinese函数使用 PIL 库在图像上绘制中文文本,支持自定义字体和颜色。

-

绘制检测结果:

draw_detections函数负责在图像上绘制检测结果,包括边界框和类别名称。

-

处理每一帧:

process_frame函数对每一帧图像进行预处理、预测和后处理,并调用绘制函数显示检测结果。

-

主程序:

- 在

__main__中,加载模型并从摄像头读取实时视频流,处理每一帧并显示结果,直到用户按下 ‘q’ 键退出。

- 在

通过这些核心功能,代码实现了实时目标检测并在视频流中标注检测结果。```

这个程序文件 demo_test_camera.py 是一个用于实时图像处理的 Python 脚本,主要功能是通过摄像头捕捉视频流,并对每一帧进行目标检测和分割。程序使用了 OpenCV 库进行图像处理,PIL 库用于绘制中文文本,同时还依赖于一个自定义的模型 Web_Detector 进行目标检测。

程序的主要结构和功能如下:

首先,导入了必要的库,包括 random、cv2、numpy、PIL 以及 hashlib。这些库分别用于随机数生成、计算机视觉、数值计算、图像处理和哈希函数。

接着定义了几个辅助函数。generate_color_based_on_name 函数通过对目标名称进行哈希处理,生成一个稳定的颜色值,这样可以确保同一名称的目标在图像中具有相同的颜色。calculate_polygon_area 函数用于计算多边形的面积,使用 OpenCV 的 contourArea 方法。

draw_with_chinese 函数则是用于在图像上绘制中文文本,使用了 PIL 库来处理中文字体。adjust_parameter 函数根据图像的大小调整参数,以便在不同分辨率下保持绘制效果的一致性。

draw_detections 函数是核心绘制函数,负责在图像上绘制检测到的目标。它会根据目标的边界框(bbox)或掩膜(mask)绘制矩形或多边形,并在图像上标注目标的名称、面积、周长、圆度和颜色等信息。特别地,当存在掩膜时,程序会计算并绘制相关的几何特征。

process_frame 函数用于处理每一帧图像。它首先对图像进行预处理,然后使用模型进行预测,最后将检测到的目标信息传递给 draw_detections 函数进行绘制。

在 __main__ 部分,程序首先加载目标类别名称和检测模型。然后通过 OpenCV 打开摄像头,进入一个循环,不断读取摄像头的帧并进行处理。处理后的帧会显示在窗口中,用户可以通过按下 ‘q’ 键退出程序。

整体而言,这个程序实现了一个实时的目标检测和分割系统,能够在视频流中标注出检测到的目标,并显示相关的几何和颜色信息。

```python

import sys

import subprocess

def run_script(script_path):

"""

使用当前 Python 环境运行指定的脚本。

Args:

script_path (str): 要运行的脚本路径

Returns:

None

"""

# 获取当前 Python 解释器的路径

python_path = sys.executable

# 构建运行命令,使用 streamlit 运行指定的脚本

command = f'"{python_path}" -m streamlit run "{script_path}"'

# 执行命令

result = subprocess.run(command, shell=True)

# 检查命令执行的返回码,如果不为0则表示出错

if result.returncode != 0:

print("脚本运行出错。")

# 实例化并运行应用

if __name__ == "__main__":

# 指定要运行的脚本路径

script_path = "web.py" # 这里可以直接指定脚本名

# 调用函数运行脚本

run_script(script_path)

代码注释说明:

-

导入模块:

sys:用于访问与 Python 解释器相关的变量和函数。subprocess:用于创建新进程、连接到它们的输入/输出/错误管道,并获得返回码。

-

run_script函数:- 该函数接受一个脚本路径作为参数,并在当前 Python 环境中运行该脚本。

- 使用

sys.executable获取当前 Python 解释器的路径,以确保使用正确的 Python 版本来运行脚本。 - 构建一个命令字符串,使用

streamlit模块运行指定的脚本。 - 使用

subprocess.run执行命令,并检查返回码以判断脚本是否成功运行。

-

主程序块:

- 当脚本作为主程序运行时,指定要运行的脚本路径(在这里是

web.py)。 - 调用

run_script函数来执行指定的脚本。```

这个程序文件名为ui.py,主要功能是通过当前的 Python 环境运行一个指定的脚本,具体是一个名为web.py的文件。程序的实现依赖于几个模块,包括sys、os和subprocess,以及一个自定义的abs_path函数。

- 当脚本作为主程序运行时,指定要运行的脚本路径(在这里是

首先,程序导入了必要的模块。sys 模块用于访问与 Python 解释器相关的变量和函数,os 模块提供了与操作系统交互的功能,而 subprocess 模块则用于执行外部命令。abs_path 函数来自于 QtFusion.path 模块,可能用于获取文件的绝对路径。

接下来,定义了一个名为 run_script 的函数,该函数接受一个参数 script_path,表示要运行的脚本的路径。在函数内部,首先获取当前 Python 解释器的路径,这通过 sys.executable 实现。然后,构建一个命令字符串,使用 streamlit 来运行指定的脚本。这个命令字符串将 Python 解释器的路径和脚本路径结合在一起,形成一个完整的命令。

随后,使用 subprocess.run 方法执行这个命令。该方法的 shell=True 参数表示在一个新的 shell 中执行命令。执行后,函数检查返回的结果码,如果结果码不为零,表示脚本运行过程中出现了错误,程序会打印出相应的错误信息。

在文件的最后部分,使用 if __name__ == "__main__": 语句来确保当该文件作为主程序运行时才会执行后面的代码。这里指定了要运行的脚本路径为 web.py,并调用 run_script 函数来执行这个脚本。

总体来说,这个程序的主要目的是提供一个简单的接口来运行一个 Streamlit 应用,便于开发者在本地环境中快速启动和测试他们的 Web 应用。

```python

import torch

from ultralytics.engine.predictor import BasePredictor

from ultralytics.engine.results import Results

from ultralytics.utils import ops

class NASPredictor(BasePredictor):

"""

Ultralytics YOLO NAS 预测器,用于目标检测。

该类扩展了 Ultralytics 引擎中的 `BasePredictor`,负责对 YOLO NAS 模型生成的原始预测结果进行后处理。

它应用非最大抑制(NMS)等操作,并将边界框缩放以适应原始图像的尺寸。

"""

def postprocess(self, preds_in, img, orig_imgs):

"""对预测结果进行后处理,并返回 Results 对象的列表。"""

# 将预测框转换为 (x_center, y_center, width, height) 格式

boxes = ops.xyxy2xywh(preds_in[0][0])

# 将边界框和类分数合并,并调整维度

preds = torch.cat((boxes, preds_in[0][1]), -1).permute(0, 2, 1)

# 应用非最大抑制,过滤掉重叠的框

preds = ops.non_max_suppression(preds,

self.args.conf, # 置信度阈值

self.args.iou, # IOU 阈值

agnostic=self.args.agnostic_nms, # 是否对类别无关

max_det=self.args.max_det, # 最大检测数量

classes=self.args.classes) # 过滤特定类别

# 如果输入图像不是列表,则将其转换为 numpy 数组

if not isinstance(orig_imgs, list):

orig_imgs = ops.convert_torch2numpy_batch(orig_imgs)

results = []

# 遍历每个预测结果

for i, pred in enumerate(preds):

orig_img = orig_imgs[i] # 获取原始图像

# 将预测框缩放到原始图像的尺寸

pred[:, :4] = ops.scale_boxes(img.shape[2:], pred[:, :4], orig_img.shape)

img_path = self.batch[0][i] # 获取图像路径

# 创建 Results 对象并添加到结果列表

results.append(Results(orig_img, path=img_path, names=self.model.names, boxes=pred))

return results # 返回处理后的结果列表

代码说明:

- 导入必要的库:导入 PyTorch 和 Ultralytics 的相关模块。

- NASPredictor 类:继承自

BasePredictor,用于处理 YOLO NAS 模型的预测结果。 - postprocess 方法:该方法对模型的原始预测结果进行后处理,主要步骤包括:

- 将预测框从

(x1, y1, x2, y2)格式转换为(x_center, y_center, width, height)格式。 - 合并边界框和类别分数,并进行维度调整。

- 应用非最大抑制(NMS)来去除重叠的边界框。

- 将输入图像转换为 numpy 数组(如果需要)。

- 遍历每个预测结果,缩放边界框到原始图像的尺寸,并创建

Results对象以存储最终结果。```

这个程序文件是Ultralytics YOLO NAS模型的预测模块,主要用于目标检测。它继承自Ultralytics引擎中的BasePredictor类,负责对YOLO NAS模型生成的原始预测结果进行后处理。后处理的主要操作包括非极大值抑制(NMS)和将边界框缩放到原始图像的尺寸。

- 将预测框从

在这个类中,有一个重要的属性args,它是一个命名空间,包含了各种后处理的配置参数。通过这些参数,用户可以控制预测的精度、IoU阈值、最大检测数量以及需要检测的类别等。

该类的主要方法是postprocess,它接收原始预测结果、输入图像和原始图像作为参数。首先,它将原始预测结果中的边界框坐标转换为另一种格式,并将边界框和类分数合并。接着,调用非极大值抑制函数,过滤掉重叠度过高的检测结果,以减少冗余的预测。

在处理完预测结果后,如果输入的原始图像不是列表格式,而是一个Torch张量,则将其转换为NumPy数组。然后,程序遍历每个预测结果,使用scale_boxes函数将边界框的坐标缩放到原始图像的尺寸,并将结果存储在Results对象中,最后返回这些结果。

需要注意的是,通常情况下,这个类不会被直接实例化,而是作为NAS类内部的一个组件来使用。通过这种设计,用户可以方便地利用YOLO NAS模型进行目标检测,而无需深入了解底层的实现细节。

```python

import random

import numpy as np

import cv2

class BaseMixTransform:

"""

基础混合变换类(MixUp/Mosaic)。

该类用于实现数据增强,通过将多张图像混合生成新的图像。

"""

def __init__(self, dataset, pre_transform=None, p=0.0) -> None:

"""初始化BaseMixTransform对象,包含数据集、预处理变换和应用概率。"""

self.dataset = dataset # 数据集

self.pre_transform = pre_transform # 预处理变换

self.p = p # 应用概率

def __call__(self, labels):

"""应用预处理变换和混合变换到标签数据。"""

if random.uniform(0, 1) > self.p: # 根据概率决定是否应用变换

return labels

# 获取其他图像的索引

indexes = self.get_indexes()

if isinstance(indexes, int):

indexes = [indexes]

# 获取用于混合的图像信息

mix_labels = [self.dataset.get_image_and_label(i) for i in indexes]

if self.pre_transform is not None:

for i, data in enumerate(mix_labels):

mix_labels[i] = self.pre_transform(data) # 应用预处理变换

labels['mix_labels'] = mix_labels # 存储混合标签

# 应用混合变换

labels = self._mix_transform(labels)

labels.pop('mix_labels', None) # 移除混合标签

return labels

def _mix_transform(self, labels):

"""应用MixUp或Mosaic增强到标签字典。"""

raise NotImplementedError

def get_indexes(self):

"""获取用于马赛克增强的随机索引列表。"""

raise NotImplementedError

class Mosaic(BaseMixTransform):

"""

马赛克增强类。

该类通过将多张图像(4或9张)组合成一张马赛克图像来进行增强。

"""

def __init__(self, dataset, imgsz=640, p=1.0, n=4):

"""初始化Mosaic对象,包含数据集、图像大小、概率和网格大小。"""

assert 0 <= p <= 1.0, f'概率应在[0, 1]范围内,但得到的是 {p}.'

assert n in (4, 9), '网格大小必须为4或9。'

super().__init__(dataset=dataset, p=p)

self.imgsz = imgsz # 图像大小

self.border = (-imgsz // 2, -imgsz // 2) # 边界

self.n = n # 网格大小

def get_indexes(self, buffer=True):

"""返回数据集中随机索引的列表。"""

if buffer: # 从缓冲区选择图像

return random.choices(list(self.dataset.buffer), k=self.n - 1)

else: # 随机选择任何图像

return [random.randint(0, len(self.dataset) - 1) for _ in range(self.n - 1)]

def _mix_transform(self, labels):

"""应用混合变换到输入图像和标签。"""

return self._mosaic4(labels) if self.n == 4 else self._mosaic9(labels)

def _mosaic4(self, labels):

"""创建2x2图像马赛克。"""

mosaic_labels = [] # 存储马赛克标签

s = self.imgsz # 图像大小

yc, xc = (int(random.uniform(-x, 2 * s + x)) for x in self.border) # 马赛克中心坐标

for i in range(4):

labels_patch = labels if i == 0 else labels['mix_labels'][i - 1] # 获取当前图像的标签

img = labels_patch['img'] # 当前图像

h, w = labels_patch.pop('resized_shape') # 获取图像的尺寸

# 在马赛克图像中放置当前图像

if i == 0: # 左上角

img4 = np.full((s * 2, s * 2, img.shape[2]), 114, dtype=np.uint8) # 创建基础图像

x1a, y1a, x2a, y2a = max(xc - w, 0), max(yc - h, 0), xc, yc # 大图像的坐标

x1b, y1b, x2b, y2b = w - (x2a - x1a), h - (y2a - y1a), w, h # 小图像的坐标

# 其他三个位置的处理同理

# ...

img4[y1a:y2a, x1a:x2a] = img[y1b:y2b, x1b:x2b] # 将当前图像放入马赛克图像中

mosaic_labels.append(labels_patch) # 存储当前图像的标签

final_labels = self._cat_labels(mosaic_labels) # 合并标签

final_labels['img'] = img4 # 更新最终图像

return final_labels

def _cat_labels(self, mosaic_labels):

"""返回带有马赛克边界实例剪裁的标签。"""

if len(mosaic_labels) == 0:

return {}

cls = []

instances = []

imgsz = self.imgsz * 2 # 马赛克图像大小

for labels in mosaic_labels:

cls.append(labels['cls'])

instances.append(labels['instances'])

final_labels = {

'im_file': mosaic_labels[0]['im_file'],

'ori_shape': mosaic_labels[0]['ori_shape'],

'resized_shape': (imgsz, imgsz),

'cls': np.concatenate(cls, 0),

'instances': Instances.concatenate(instances, axis=0),

'mosaic_border': self.border} # 最终标签

final_labels['instances'].clip(imgsz, imgsz) # 剪裁实例

good = final_labels['instances'].remove_zero_area_boxes() # 移除零面积框

final_labels['cls'] = final_labels['cls'][good] # 更新类别

return final_labels

代码说明:

- BaseMixTransform: 这是一个基础类,用于实现混合数据增强(如MixUp和Mosaic)。它包含了初始化、调用和获取索引的方法。

- Mosaic: 这是一个具体的实现类,继承自

BaseMixTransform,用于将多张图像组合成一张马赛克图像。它包含了获取索引、混合变换的具体实现等方法。 - _mosaic4: 该方法实现了将4张图像组合成2x2的马赛克图像,并更新标签信息。

- _cat_labels: 该方法合并马赛克图像的标签信息,返回最终的标签字典。

这些代码是YOLOv8数据增强的一部分,主要用于提升模型的鲁棒性和泛化能力。```

这个程序文件 ultralytics\data\augment.py 主要用于实现图像增强的功能,特别是在目标检测和图像分类任务中。文件中定义了多个类和方法,旨在对输入图像及其对应的标签进行各种变换和增强,以提高模型的鲁棒性和泛化能力。

首先,文件中定义了一个基类 BaseTransform,它是所有图像变换类的基础。这个类包含了一些基本的方法,如 apply_image、apply_instances 和 apply_semantic,用于对图像和标签进行变换。通过重载 __call__ 方法,可以方便地对输入的标签进行一系列变换。

接下来,Compose 类用于将多个变换组合在一起。它接收一个变换列表,并在调用时依次应用这些变换。这个类还提供了 append 方法来添加新的变换,以及 tolist 方法将变换列表转换为标准的 Python 列表。

BaseMixTransform 类是用于实现混合增强(如 MixUp 和 Mosaic)的基类。它的 __call__ 方法首先获取其他图像的索引,然后应用混合变换。具体的混合变换逻辑在子类中实现,如 Mosaic 和 MixUp 类。

Mosaic 类实现了马赛克增强,通过将多个图像组合成一个马赛克图像来增加数据的多样性。它支持 4 张或 9 张图像的组合,并在 get_indexes 方法中随机选择图像索引。_mix_transform 方法负责将这些图像合并成一个马赛克图像。

MixUp 类则实现了 MixUp 增强,通过将两张图像按一定比例混合来生成新的图像。这种方法有助于模型学习更平滑的决策边界。

RandomPerspective 类实现了随机透视变换和仿射变换,允许对图像进行旋转、平移、缩放和剪切等操作。它提供了多种参数来控制变换的程度和类型。

此外,文件中还定义了 RandomHSV、RandomFlip、LetterBox、CopyPaste 等类,分别用于调整图像的色调、饱和度和亮度,随机翻转图像,调整图像大小并添加边框,以及实现 Copy-Paste 增强。

Albumentations 类则提供了使用 Albumentations 库进行的增强,支持多种图像处理操作,如模糊、对比度调整和亮度变化。

最后,Format 类用于格式化图像注释,以便在 PyTorch 的 DataLoader 中使用。它将图像和实例的标签标准化,并根据需要返回掩码和关键点。

整体而言,这个文件通过定义多个增强类和组合逻辑,为目标检测和图像分类任务提供了丰富的图像增强功能,旨在提高模型的性能和鲁棒性。

```python

import os

import torch

import yaml

from ultralytics import YOLO # 导入YOLO模型库

if __name__ == '__main__': # 确保该模块被直接运行时才执行以下代码

# 设置训练参数

workers = 1 # 数据加载的工作进程数

batch = 8 # 每个批次的样本数量,需根据显存/内存调整

device = "0" if torch.cuda.is_available() else "cpu" # 检查是否有可用的GPU

# 获取数据集的YAML配置文件的绝对路径

data_path = abs_path(f'datasets/data/data.yaml', path_type='current')

# 将路径格式转换为Unix风格

unix_style_path = data_path.replace(os.sep, '/')

# 获取数据集所在目录的路径

directory_path = os.path.dirname(unix_style_path)

# 读取YAML文件,保持原有顺序

with open(data_path, 'r') as file:

data = yaml.load(file, Loader=yaml.FullLoader)

# 如果YAML文件中包含训练、验证和测试数据的路径,则修改为绝对路径

if 'train' in data and 'val' in data and 'test' in data:

data['train'] = directory_path + '/train' # 设置训练数据路径

data['val'] = directory_path + '/val' # 设置验证数据路径

data['test'] = directory_path + '/test' # 设置测试数据路径

# 将修改后的数据写回YAML文件

with open(data_path, 'w') as file:

yaml.safe_dump(data, file, sort_keys=False)

# 加载YOLO模型,使用指定的配置文件和预训练权重

model = YOLO(r"C:\codeseg\codenew\50+种YOLOv8算法改进源码大全和调试加载训练教程(非必要)\改进YOLOv8模型配置文件\yolov8-seg-C2f-Faster.yaml").load("./weights/yolov8s-seg.pt")

# 开始训练模型

results = model.train(

data=data_path, # 指定训练数据的配置文件路径

device=device, # 指定使用的设备(GPU或CPU)

workers=workers, # 指定用于数据加载的工作进程数

imgsz=640, # 指定输入图像的大小为640x640

epochs=100, # 指定训练的轮数为100

batch=batch, # 指定每个批次的样本数量

)

代码注释说明:

- 导入必要的库:导入了操作系统相关的库、PyTorch库、YAML解析库以及YOLO模型库。

- 主程序入口:使用

if __name__ == '__main__':确保代码块仅在直接运行该脚本时执行。 - 设置训练参数:定义了数据加载的工作进程数、批次大小和设备(GPU或CPU)。

- 获取数据集路径:使用

abs_path函数获取数据集配置文件的绝对路径,并将其转换为Unix风格路径。 - 读取和修改YAML文件:读取YAML文件内容,检查并修改训练、验证和测试数据的路径为绝对路径,然后将修改后的内容写回YAML文件。

- 加载YOLO模型:使用指定的配置文件和预训练权重加载YOLO模型。

- 开始训练模型:调用

model.train()方法,传入训练所需的参数,包括数据路径、设备、工作进程数、图像大小、训练轮数和批次大小。```

这个程序文件train.py是一个用于训练 YOLO(You Only Look Once)模型的脚本,主要功能是加载数据集、配置模型并开始训练。以下是对代码的逐行讲解。

首先,程序导入了一些必要的库,包括 os、torch、yaml 和 matplotlib。其中,torch 是 PyTorch 的核心库,yaml 用于处理 YAML 格式的配置文件,matplotlib 用于绘图(虽然在这个脚本中没有实际使用)。

在 if __name__ == '__main__': 这一行,确保只有当该脚本被直接运行时,以下代码才会执行。接下来,程序设置了一些训练参数,包括工作进程数 workers、批次大小 batch,并根据系统是否支持 CUDA 来选择设备(GPU 或 CPU)。

接着,程序通过 abs_path 函数获取数据集配置文件 data.yaml 的绝对路径,并将其转换为 UNIX 风格的路径。然后,使用 os.path.dirname 获取该路径的目录部分。

程序打开 data.yaml 文件并读取其内容,使用 yaml.load 方法保持原有顺序。接下来,检查 YAML 文件中是否包含 train、val 和 test 三个字段,如果存在,则将这些字段的值修改为相应的训练、验证和测试数据集的路径,并将修改后的内容写回到 YAML 文件中。

之后,程序加载 YOLO 模型的配置文件,使用 YOLO 类的 load 方法加载预训练的权重文件。这里的模型配置文件和权重文件路径是硬编码的,用户可以根据需要进行修改。

最后,程序调用 model.train 方法开始训练模型,传入训练数据的配置文件路径、设备、工作进程数、输入图像大小、训练的 epoch 数量和批次大小等参数。这样,程序就会开始进行模型训练。

总的来说,这个脚本提供了一个简单的框架来配置和训练 YOLO 模型,用户可以根据自己的需求调整数据集路径、模型配置和训练参数。

```python

from pathlib import Path

from ultralytics import SAM, YOLO

def auto_annotate(data, det_model='yolov8x.pt', sam_model='sam_b.pt', device='', output_dir=None):

"""

自动标注图像,使用YOLO目标检测模型和SAM分割模型。

参数:

data (str): 包含待标注图像的文件夹路径。

det_model (str, optional): 预训练的YOLO检测模型,默认为'yolov8x.pt'。

sam_model (str, optional): 预训练的SAM分割模型,默认为'sam_b.pt'。

device (str, optional): 模型运行的设备,默认为空字符串(CPU或可用的GPU)。

output_dir (str | None | optional): 保存标注结果的目录。

默认为与'data'相同目录下的'labels'文件夹。

示例:

auto_annotate(data='ultralytics/assets', det_model='yolov8n.pt', sam_model='mobile_sam.pt')

"""

# 加载YOLO目标检测模型

det_model = YOLO(det_model)

# 加载SAM分割模型

sam_model = SAM(sam_model)

# 将数据路径转换为Path对象

data = Path(data)

# 如果未指定输出目录,则创建一个默认的输出目录

if not output_dir:

output_dir = data.parent / f'{data.stem}_auto_annotate_labels'

# 创建输出目录(如果不存在)

Path(output_dir).mkdir(exist_ok=True, parents=True)

# 使用YOLO模型进行目标检测,stream=True表示实时处理

det_results = det_model(data, stream=True, device=device)

# 遍历检测结果

for result in det_results:

# 获取检测到的类别ID

class_ids = result.boxes.cls.int().tolist() # noqa

# 如果检测到的类别ID不为空

if len(class_ids):

# 获取边界框坐标

boxes = result.boxes.xyxy # Boxes对象用于边界框输出

# 使用SAM模型进行分割,传入边界框

sam_results = sam_model(result.orig_img, bboxes=boxes, verbose=False, save=False, device=device)

# 获取分割结果

segments = sam_results[0].masks.xyn # noqa

# 将分割结果写入文本文件

with open(f'{str(Path(output_dir) / Path(result.path).stem)}.txt', 'w') as f:

for i in range(len(segments)):

s = segments[i]

# 如果分割结果为空,则跳过

if len(s) == 0:

continue

# 将分割结果转换为字符串并写入文件

segment = map(str, segments[i].reshape(-1).tolist())

f.write(f'{class_ids[i]} ' + ' '.join(segment) + '\n')

代码核心部分说明:

- 模型加载:使用YOLO和SAM模型进行目标检测和图像分割。

- 路径处理:使用

Path模块处理文件路径,确保输出目录的创建。 - 目标检测:通过YOLO模型检测图像中的目标,并获取边界框。

- 图像分割:使用SAM模型对检测到的目标进行分割,得到分割结果。

- 结果保存:将分割结果和对应的类别ID写入文本文件,以便后续使用。```

这个程序文件是用于自动标注图像的,主要使用了YOLO(You Only Look Once)目标检测模型和SAM(Segment Anything Model)分割模型。程序的核心功能是从指定的图像文件夹中读取图像,利用YOLO模型检测图像中的物体,然后使用SAM模型对检测到的物体进行分割,最后将分割结果保存为文本文件。

程序的入口函数是auto_annotate,它接受几个参数:data表示图像文件夹的路径,det_model是YOLO检测模型的路径,sam_model是SAM分割模型的路径,device指定运行模型的设备(CPU或GPU),output_dir是保存标注结果的目录。如果没有指定输出目录,程序会在输入数据的同级目录下创建一个名为{data.stem}_auto_annotate_labels的文件夹。

在函数内部,首先加载YOLO和SAM模型。接着,使用Path模块处理文件路径,确保输出目录存在。然后,调用YOLO模型对输入数据进行检测,结果以流的形式返回。对于每一张检测到的图像,程序提取出物体的类别ID和边界框信息。

如果检测到的物体类别ID不为空,程序会进一步调用SAM模型,传入原始图像和边界框信息,进行分割操作。分割结果以掩膜的形式返回。最后,程序将每个物体的类别ID和对应的分割坐标写入到一个文本文件中,文件名与原始图像文件名相同,但后缀为.txt。

整个过程实现了从图像读取、目标检测、分割到结果保存的自动化,方便用户快速获取标注信息。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

更多推荐

已为社区贡献250条内容

已为社区贡献250条内容

所有评论(0)