技术选型必看!GPGPU与NPU/DSA对比,国产算力芯片落地指南

对于CSDN的技术从业者而言,信创算力选型、AI芯片落地已成为日常工作的核心痛点。GPGPU与NPU/DSA作为国产算力的两大核心路线,究竟该如何选择?本文结合技术特性、落地场景,做干货级对比,帮开发者快速理清选型逻辑,避开踩坑。不同于泛科普,本文聚焦技术落地视角,从核心定位、能力特性、优劣势、选型建议四个维度,精准匹配开发者、运维工程师、技术架构师的核心需求,兼顾专业性与实用性。

对于CSDN的技术从业者而言,信创算力选型、AI芯片落地已成为日常工作的核心痛点。GPGPU与NPU/DSA作为国产算力的两大核心路线,究竟该如何选择?本文结合技术特性、落地场景,做干货级对比,帮开发者快速理清选型逻辑,避开踩坑。

不同于泛科普,本文聚焦技术落地视角,从核心定位、能力特性、优劣势、选型建议四个维度,精准匹配开发者、运维工程师、技术架构师的核心需求,兼顾专业性与实用性。

一、核心定位拆解:通用算力vs专用算力,选型先看场景

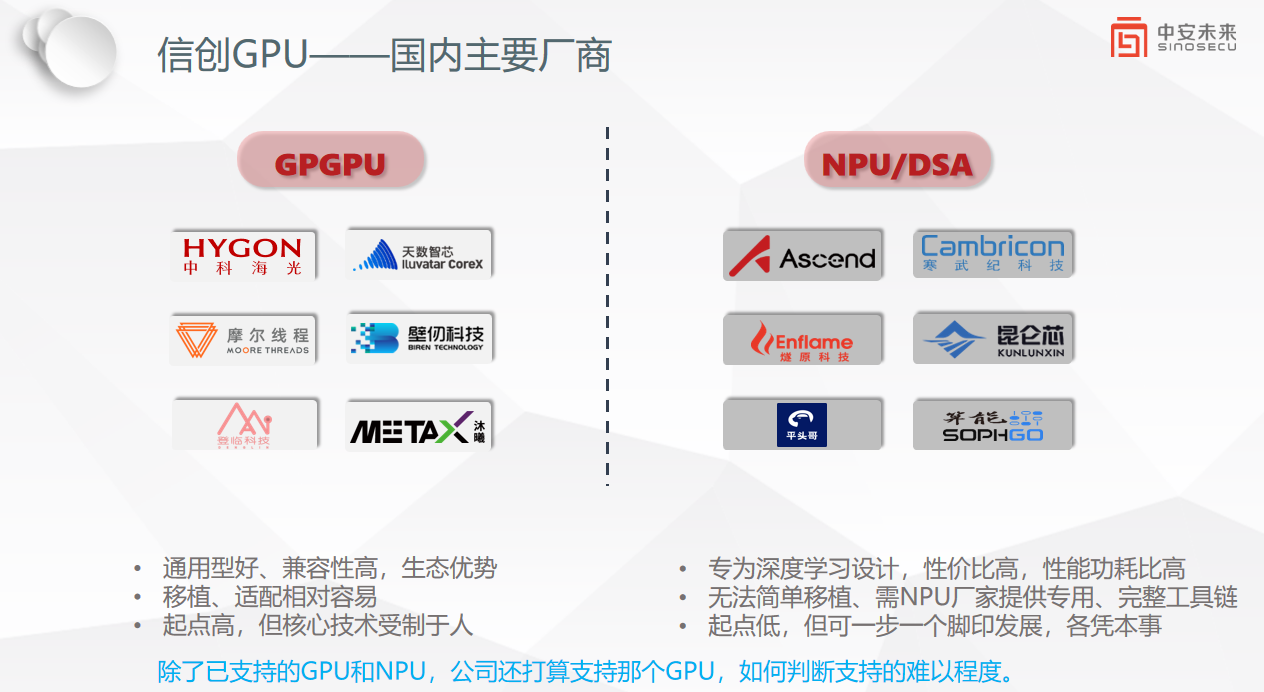

两者的核心差异是“多场景兼容”与“单一场景极致优化”,直接决定选型方向:

GPGPU(通用图形处理器):核心是“通用计算+图形渲染”双能力,基于CUDA/类CUDA生态,可无缝适配TensorFlow、PyTorch等主流AI框架,同时支撑科学计算、大数据分析,适配多场景算力需求,无需针对单一任务做定制开发,兼容性和通用性是核心优势。

NPU/DSA(神经网络处理器/特定领域架构):专为深度学习、AI推理定制,通过硬件架构层面优化特定算法(如CNN、Transformer),算力密度高、功耗低,核心优势是在单一AI任务中实现极致能效比,但需依赖专用工具链做适配,场景针对性极强。

二、核心能力与落地场景:聚焦技术细节,拒绝泛谈

作为技术从业者,选型的核心是“能力适配性”,以下是两大路线的核心能力及落地场景,精准对标实际开发需求:

GPGPU阵营(通用路线):主打“生态兼容+高性能落地”,核心能力集中在多场景适配,可支撑信创服务器、桌面终端、超算等多类场景。具备高兼容度的类CUDA生态,能无缝适配x86服务器,可作为政企信创算力底座;部分产品高性能突出,可对标国际高端水平,支撑大模型训练、超算等高强度计算场景;同时有兼顾图形渲染与轻量AI推理的能力,适配国产操作系统,满足桌面信创、云桌面开发需求。

NPU/DSA阵营(专用路线):聚焦“AI场景深度适配”,核心能力是单一AI任务的高效处理,覆盖云端推理、边缘终端、车载计算等场景。部分产品具备全栈框架支持能力,可适配大模型训练与推理,适用于政务、金融等高端AI场景;主打云端推理的产品支持多框架适配,适合安防、大数据推理开发;聚焦边缘终端的产品采用轻量化设计,适配物联网、智能硬件等轻量化算力需求。

三、优劣势对比:针对性选型,避开技术踩坑

结合开发场景,两大路线优劣势清晰,无需盲目跟风选型:

GPGPU优势:生态成熟,与主流开发框架、信创系统适配度高,开发移植成本低,可支撑多场景算力需求,后期扩展灵活;短板:单一AI任务能效比低于专用芯片,高端制程仍有提升空间,部分产品存在性能瓶颈。

NPU/DSA优势:架构精简,单一AI任务算力密度、能效比突出,自主设计路线适配灵活,适合规模化部署;短板:通用性弱,跨框架、跨场景适配成本高,需熟悉专用工具链,开发门槛较高。

四、选型建议:按需取舍,贴合技术落地需求

对于技术从业者而言,没有最优路线,只有最适配场景:

若涉及多场景算力(如AI训练+科学计算)、信创服务器部署,优先选择GPGPU,降低开发移植成本;若聚焦单一AI推理、边缘终端、车载计算,NPU/DSA更具性价比,可实现极致能效比。

当前,国产算力芯片正快速突破技术瓶颈,两大路线并行发展,已能满足多数国内技术落地需求。作为开发者,掌握两者差异,才能精准选型,提升开发效率。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)