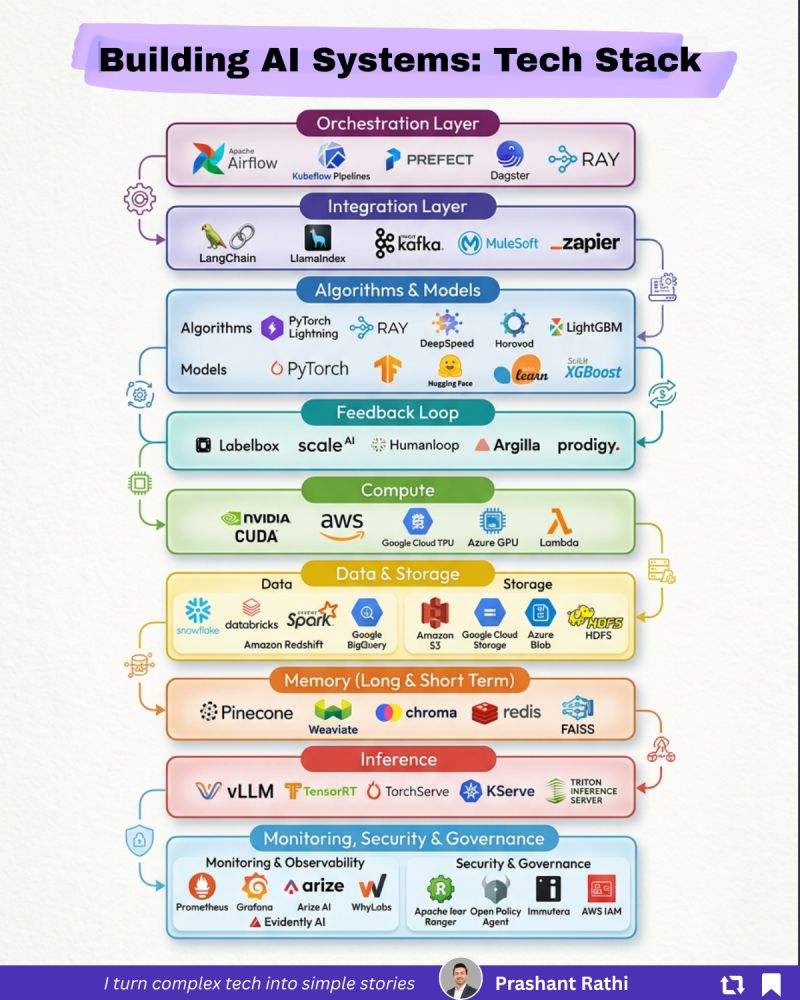

构建生产级 AI 系统:模型只是冰山一角,这 10 层完整技术栈才是产品的核心

《从Demo到产品:AI落地的10层技术栈挑战》 当前AI行业存在一个普遍误区:90%的团队将精力过度集中在模型层面,却忽略了从实验室到生产环境所需的完整技术体系。实际上,AI产品的成功落地需要构建10层环环相扣的技术栈: 算力层:提供弹性可扩展的计算资源 数据层:构建高质量的数据治理体系 内存层:实现长期记忆和语义检索 模型层:算法开发与版本管理 推理层:生产环境部署优化 集成层:业务系统连接

如今整个行业都在疯狂讨论大模型、微调技术、基座能力,仿佛只要选对了模型,就能做出成功的 AI 产品。但一个残酷的现实是:90% 的 AI demo,最终都死在了从实验室到生产环境的路上。

无数团队都在重复同一个踩坑循环:耗费 3 个月甚至更久的时间,微调出一个在实验室里效果惊艳的模型,终于跑出了完美的 demo;可到了要上线交付、规模化服务用户的时候,才彻底慌了神 —— 他们根本没有规划模型的服务化部署、全链路监控、数据安全治理,更没有设计持续迭代的反馈闭环。最终,demo 永远只是 demo,永远无法变成真正可用、可盈利的产品。

这就是当下 AI 行业最大的认知误区:构建 AI 系统,从来都不是一个模型问题,而是一个彻头彻尾的系统工程问题。模型只是 AI 产品冰山露出水面的那一小部分,水面之下,是 10 层环环相扣、缺一不可的完整技术栈,它决定了你的 AI 系统能不能稳定运行、能不能规模化扩展、能不能安全合规、能不能真正创造业务价值。归根结底,模型从来都不是产品,完整的技术栈才是。

1. 算力层(Compute):AI 系统的动力引擎

算力是整个 AI 系统最底层的基础设施,没有算力支撑,一切模型、算法都只是空中楼阁。大模型的训练、微调、推理,都极度依赖海量的并行计算能力,这一层就是为整个 AI 系统提供源源不断的动力,是所有 AI 能力落地的物理基础。

这一层的核心价值,是提供异构计算资源的调度、管理与弹性扩缩容能力,平衡模型训练、微调、推理不同阶段的性能需求与成本控制。主流的技术工具覆盖了从底层加速到云化服务的全场景:

- 底层算力核心:NVIDIA CUDA 是目前 GPU 加速的事实标准,几乎所有 AI 训练与推理框架都基于 CUDA 构建,是 NVIDIA GPU 生态的核心底座;

- 云厂商算力服务:AWS、Google Cloud TPU、Azure GPU 提供弹性的云化算力资源,中小团队可以按需租用,避免自建机房的高额固定成本,其中 Google 的 TPU 在大模型分布式训练场景有极强的性能优势;

- 无服务器算力:Lambda 针对轻量级、突发式的推理场景,提供按需付费的无服务器算力,大幅降低资源闲置成本。

行业最常见的踩坑点,是前期只关注实验室的单卡算力,完全忽略了生产环境的弹性扩缩容设计,上线后面对用户峰值请求,算力不足直接导致服务宕机;或是没有做算力成本优化,盲目租用高端 GPU,最终算力成本远超业务收入,让项目难以为继。

2. 数据与存储层(Data & Storage):AI 系统的燃料仓库

AI 模型的效果上限,本质上是由训练数据决定的。这一层是整个 AI 系统的数据底座,负责全生命周期的数据处理、存储与管理,为模型训练、RAG 检索、业务分析提供高质量、可追溯的数据燃料。

它的核心能力,是覆盖结构化、半结构化、非结构化数据的接入、清洗、转换、处理与持久化存储,支撑海量数据的高并发读写、分布式处理,同时保证数据的一致性、可用性与合规可追溯性。主流工具分为四大类:

- 企业级数仓与数据处理:Snowflake、Databricks、Amazon Redshift、Google BigQuery 是企业级数据仓库的核心工具,支撑海量结构化与半结构化数据的存储、分析与处理;Spark 则是分布式数据处理的事实标准,负责海量非结构化数据的清洗、转换与预处理;

- 对象存储:Amazon S3、Google Cloud Storage、Azure Blob 是 AI 场景最主流的存储方案,用于存储模型权重、训练数据集、文档、图片等非结构化数据,具备无限扩容、高可用、低成本的优势;

- 分布式文件系统:HDFS、HopsFS 针对大模型训练场景的海量文件读写做了深度优化,支撑分布式训练集群的高吞吐数据访问。

无数团队的血泪教训证明:只关注模型微调,却忽略了数据治理,最终只会导致训练数据杂乱无章、质量低下,微调出来的模型效果大打折扣;RAG 场景中,没有做好文档数据的预处理与版本管理,会直接导致检索结果混乱,大模型幻觉频发;而没有做好数据全链路追溯,则会直接触发合规风险。

3. 内存层(Memory - Long & Short Term):AI 系统的语义大脑

这是大模型时代 AI 系统最核心的组件之一,它彻底解决了大模型的上下文窗口限制、长期记忆缺失、精准语义检索三大核心痛点,是 RAG 系统、Agent 智能体落地的核心底座。我们常说的向量数据库,正是这一层的核心载体。

这一层的核心能力,是将文本、图像、音频等非结构化数据转换为嵌入向量,实现高维稠密向量的高效存储、检索与管理,为大模型提供长期记忆能力,支撑毫秒级的语义相似度搜索,让大模型能够获取精准的外部上下文;同时通过内存数据库实现短期会话记忆的管理,优化用户体验与调用成本。主流工具分为三大类:

- 托管式向量数据库(长期记忆):Pinecone、Weaviate、Chroma 是目前 RAG 场景最主流的选择,开箱即用,支持弹性扩缩容,适合中小团队快速落地;

- 开源向量检索引擎:FAISS 是 Meta 开源的高性能向量检索库,是绝大多数向量数据库的底层核心,适合有定制化需求的团队自建检索系统;

- 短期会话记忆:Redis 作为高性能内存数据库,用于存储用户会话历史、短期上下文、缓存高频检索结果,大幅降低大模型调用成本,提升系统响应速度。

行业最普遍的误区,是以为向量数据库 “插进去就能用”,完全忽略了向量维度、索引类型、文档分块策略的优化,最终导致检索延迟高、召回率低,直接拉低整个 RAG 系统的效果;而没有做好长短期记忆的协同管理,则会导致会话上下文混乱,大模型频繁出现答非所问的问题。

4. 算法与模型层(Algorithms & Models):AI 系统的核心逻辑单元

这是整个行业最熟悉、也内卷最严重的一层,它是 AI 系统的核心逻辑载体,但从来都不是 AI 系统的全部。这一层负责 AI 模型的选型、训练、微调、算法开发,实现核心的语义理解、逻辑推理、内容生成能力。

它的核心价值,是覆盖从传统机器学习到大语言模型的全场景算法开发与模型管理,提供模型训练、微调、量化、压缩的全流程工具链,支撑业务场景的算法需求落地。主流工具覆盖了从框架到生态的全链路:

- 深度学习框架:PyTorch 是目前 AI 开发的事实标准,生态完善、灵活性高,覆盖大模型训练、微调、计算机视觉、自然语言处理全场景;TensorFlow 则在工业级部署场景仍有广泛应用;

- 模型生态:Hugging Face 是全球最大的开源模型社区,提供海量的预训练模型、数据集、工具链,是绝大多数 AI 开发者的首选;

- 分布式训练与优化:PyTorch Lightning、DeepSpeed、Horovod、Ray 解决了大模型训练的分布式并行问题,大幅降低大模型微调、训练的技术门槛与算力成本;

- 传统机器学习算法:LightGBM、XGBoost、scikit-learn 在结构化数据预测、分类、排序场景仍有不可替代的优势,是 AI 系统的重要补充。

这一层最大的误区,就是 “唯模型论”:无数团队盲目追求更大的模型、更复杂的微调方案,却完全忽略了业务场景的实际需求,最终模型在实验室里效果完美,到了生产环境根本无法落地;同时,没有做好模型的版本管理、权重管理,会导致团队协作混乱,模型迭代完全无法追溯。

5. 推理层(Inference):AI 模型从实验室到生产环境的桥梁

这一层是决定 AI 系统能不能真正上线的核心环节,它解决了 “训练好的模型怎么给用户提供稳定、高效、低成本的服务” 的核心问题。很多团队的模型训练得再好,没有做好推理优化,上线后就会面临延迟高、吞吐低、成本爆炸的问题,根本无法服务海量用户。

它的核心能力,是实现模型的高效部署、推理优化、服务化封装,提供高并发、低延迟、高可用的模型推理服务,同时通过量化、压缩、批处理等技术,大幅降低推理成本,提升资源利用率。主流工具覆盖了从推理优化到服务化部署的全场景:

- 高吞吐推理框架:vLLM 是目前大模型推理的主流框架,通过 PagedAttention 技术大幅提升显存利用率与吞吐能力,是开源模型部署的首选;

- 推理优化引擎:TensorRT 是 NVIDIA 推出的推理优化引擎,针对 GPU 架构做深度优化,大幅提升模型推理速度,降低延迟;

- 模型服务化框架:TorchServe、KServe、Triton Inference Server 实现了模型的标准化服务化封装,支持多模型管理、弹性扩缩容、流量控制、A/B 测试,是企业级生产部署的核心工具,其中 Triton 在多框架、多模型部署场景有极强的优势。

行业最常见的踩坑行为,是用 FastAPI 简单封装一下模型就直接上线,完全没有做推理优化,导致单卡吞吐极低,延迟动辄十几秒,用户体验极差;没有做好模型的量化、压缩,显存占用极高,只能用高端 GPU 部署,推理成本是优化后的 10 倍以上;更有甚者,没有做服务的高可用设计,单节点故障直接导致整个服务宕机。

6. 集成层(Integration Layer):AI 系统与业务世界的连接器

AI 系统从来都不是孤立存在的,它必须和企业的业务系统、外部工具、数据来源打通,才能真正创造业务价值。这一层就是 AI 系统的 “连接器”,负责把大模型的能力,和企业内部的数据库、API、第三方工具、业务流程深度集成,让 AI 从 “聊天机器人” 变成真正的业务生产力工具。

它的核心能力,是实现大模型与外部系统的互联互通,提供工具调用、数据接入、API 编排、事件流处理的能力,让 AI 系统能够调用外部工具完成复杂任务,接入企业的业务数据,实现端到端的业务流程自动化。主流工具分为四大类:

- LLM 应用开发框架:LangChain、LlamaIndex 是目前最主流的 AI 应用开发框架,提供了完整的工具调用、RAG、Agent 编排、多数据源接入能力,大幅降低了 AI 应用的开发门槛,让开发者能够快速把大模型和外部系统集成;

- 消息队列与事件流:Kafka 负责 AI 系统与业务系统之间的异步数据传输、事件流处理,解耦系统架构,支撑高并发的业务数据接入;

- 企业级集成平台:MuleSoft 针对大型企业的复杂系统集成场景,实现 AI 系统与企业内部 ERP、CRM、HR 系统等存量系统的深度打通;

- 自动化集成工具:Zapier 针对中小团队的轻量化场景,无需代码就能实现 AI 系统与数千款 SaaS 工具的集成,快速实现业务流程自动化。

90% 的 AI 应用最终沦为 “玩具”,核心原因就是忽略了这一层:它们只是一个孤立的聊天机器人,没有和企业的业务系统打通,无法调用业务数据、无法执行业务操作,根本无法创造实际的业务价值;而工具调用逻辑设计混乱,没有做权限管控、异常处理,则会导致 AI 调用工具时频繁出错,甚至触发业务风险。

7. 编排层(Orchestration Layer):AI 系统的指挥中枢

当 AI 系统从简单的单轮对话,升级为复杂的多步骤 Agent 工作流、端到端的业务自动化流程时,就需要一个强大的指挥中枢,来管控整个工作流的执行、调度、重试、监控与故障恢复,这就是编排层的核心作用。它决定了复杂 AI 任务能不能稳定、可靠地执行,是 AI 系统从 “玩具” 走向工业化的核心标志。

它的核心能力,是实现复杂 AI 工作流的可视化编排、任务调度、依赖管理、弹性扩缩容、故障重试与兜底,保证复杂的多步骤 AI 任务能够稳定、可靠地执行,同时实现工作流的版本管理、可追溯与可观测。主流工具覆盖了从工作流调度到分布式计算编排的全场景:

- 工作流编排与调度:Apache Airflow 是数据与 AI 工作流编排的事实标准,支持可视化的 DAG 工作流定义,强大的任务调度、依赖管理、重试机制,适合复杂的离线 AI 任务、数据预处理流水线、模型训练任务的编排;Prefect、Dagster 则是新一代的工作流编排工具,针对 AI 场景做了大量优化,开发者体验更好;

- MLOps 编排:Kubeflow Pipelines 针对 Kubernetes 环境的机器学习工作流编排,实现模型训练、微调、部署的全流程自动化,适合企业级 MLOps 平台构建;

- 分布式计算编排:Ray 不仅能做分布式训练,还能实现复杂 AI 任务的分布式编排、资源调度,支撑大规模的 Agent 集群、推理任务的分布式执行。

无数团队的 AI 工作流,最终都变成了一堆杂乱的 Python 脚本:没有统一的编排、调度、重试机制,一旦某个步骤出错,整个流程就直接崩溃,根本无法排查问题;没有做工作流的版本管理与可观测,任务执行的状态、日志、结果无法追溯,出了问题根本找不到根因;面对大规模的任务调度,没有做弹性扩缩容,资源利用率极低,任务排队严重。

8. 反馈闭环层(Feedback Loop):AI 系统持续进化的核心动力

AI 系统上线,从来都不是终点,而是迭代的起点。大模型的效果会随着数据分布的变化、用户需求的变化而持续退化,想要让 AI 系统长期保持高质量的输出,就必须构建一个完整的反馈闭环,实现数据、模型、效果的持续迭代优化。这一层,决定了你的 AI 系统是越用越好,还是越用越差。

它的核心能力,是收集用户的反馈、模型的输出效果、业务的指标数据,实现数据的标注、清洗、回流,驱动模型的持续微调、prompt 优化、检索策略迭代,形成 “上线 - 收集反馈 - 数据回流 - 模型优化 - 重新上线” 的完整闭环,让 AI 系统实现持续的自我进化。主流工具分为两大类:

- 数据标注平台:Labelbox、Scale AI 是企业级的 AI 数据标注平台,支持文本、图像、音频等多模态数据的标注,为模型微调、效果优化提供高质量的标注数据;

- 人机协同与反馈管理:Humanloop、Argilla、Prodigy 针对大语言模型场景优化,实现用户反馈的收集、模型输出的人工审核、RLHF/RLAIF 的标注数据管理,大幅降低大模型迭代的反馈闭环成本,快速实现模型的持续优化。

90% 的团队都忽略了这一层:模型上线后就放任不管,没有收集用户反馈,没有做效果监控,几个月后模型效果持续退化,用户体验越来越差,最终被弃用;还有很多团队没有建立自动化的反馈回流机制,反馈数据散落在各个地方,无法形成标准化的数据集,根本无法驱动模型的迭代优化。

9. 监控与可观测性层(Monitoring):AI 系统的 “仪表盘”

传统软件是确定性的,2+2 永远等于 4,而 AI 系统是概率性、非确定性的,相同的输入可能会得到完全不同的输出。这就导致传统的监控体系,根本无法满足 AI 系统的需求。这一层就是 AI 系统的 “眼睛”,让你能够实时掌握系统的运行状态、模型的效果变化,提前发现问题,而不是等用户投诉了才后知后觉。

它的核心能力,是实现 AI 系统全链路的可观测性,覆盖基础设施监控、服务性能监控、模型效果监控三大维度,实时采集系统的延迟、吞吐、成本、错误率,以及模型的幻觉率、准确率、召回率、用户满意度等核心指标,提供告警、根因分析、趋势预判能力,保证系统的稳定运行。主流工具分为两大类:

- 基础设施与性能监控:Prometheus + Grafana 是监控体系的黄金组合,开源、灵活,能够实现系统算力、内存、存储、服务接口延迟、吞吐、错误率的全维度监控与可视化告警,是几乎所有企业级系统的标配;

- AI 原生可观测性平台:Arize AI、WhyLabs、Evidently AI 专门针对 AI 系统的特性设计,实现模型效果的实时监控、数据漂移检测、幻觉率监控、特征分布变化分析,提前发现模型效果退化的问题,解决传统监控无法覆盖的 AI 场景痛点。

行业最普遍的误区,是只监控服务有没有宕机,完全忽略了模型效果的监控:服务一直在正常运行,但模型的幻觉率已经飙升到 50%,召回率暴跌,用户体验极差,团队却根本没有发现;没有做全链路的可观测性,出了问题不知道是算力不足、推理延迟高,还是检索召回率低,亦或是模型本身的问题,排查问题如同大海捞针。

10. 安全与治理层(Security & Governance):AI 系统的生命线

在 AI 系统的全生命周期里,安全与合规是不可突破的底线,一旦失守,整个系统都可能面临灭顶之灾。尤其是企业级 AI 系统,涉及到企业的核心业务数据、用户的隐私数据,必须做好严格的权限管控、数据安全、合规治理,避免数据泄露、滥用、违规生成等风险。这一层,是 AI 系统能够长期合规运行的生命线。

它的核心能力,是实现 AI 系统全生命周期的安全管控与合规治理,覆盖身份认证、权限管理、数据加密、内容安全、合规审计、模型生命周期管理,保证 AI 系统符合行业合规要求,避免数据泄露、恶意滥用、违规输出等风险。主流工具分为三大类:

- 权限与访问管控:AWS IAM 是云原生环境的身份与访问管理核心,实现精细化的权限管控,落地最小权限原则,避免未授权的资源访问与操作;Open Policy Agent(OPA) 是开源的策略引擎,实现统一的、代码化的权限策略管理,支撑跨系统的策略统一管控;

- 数据安全与治理:Apache Ranger 针对大数据与 AI 场景的统一数据治理平台,实现数据的细粒度访问控制、数据脱敏、合规审计,保证数据的全生命周期安全;

- 模型安全与合规:Immuta 针对 AI 场景的数安全与访问控制平台,实现数据的动态脱敏、隐私计算、合规审计,满足 GDPR、等保 2.0 等全球主流合规要求。

无数团队为了快速上线,完全忽略了安全与治理:没有做精细化的权限管控,导致企业核心数据泄露;没有做内容安全审核,大模型生成违规、有害内容,触发合规风险;没有做数据脱敏,用户的隐私数据被直接传入大模型,违反个人信息保护相关法律法规,最终面临巨额罚款,甚至项目直接被叫停。

结尾:AI 行业的竞争,终将是系统工程能力的竞争

当我们拆解完这 10 层技术栈,就能清晰地看到:一个真正能落地、能规模化、能创造业务价值的 AI 系统,是一个环环相扣、缺一不可的完整工程体系。模型只是这个体系里的一个组件,甚至不是最核心的组件。

很多人说,现在的 AI 行业,是 “算法科学家过剩,AI 系统工程师稀缺”。本质上就是因为,绝大多数人都只盯着模型这一层,而真正能把这 10 层技术栈打通,把 AI 系统从 demo 变成生产级产品的系统工程师,少之又少。

AI 行业的风口期,大家都在拼模型、拼 demo,谁的模型更大、谁的 demo 更惊艳,谁就能吸引眼球。但当风口散去,行业进入深水区,真正能活下来的,一定是那些把系统工程做扎实的团队 —— 他们的 AI 系统,稳定、低成本、可扩展、安全合规,能真正持续地为业务创造价值。

永远记住:模型从来都不是产品,完整的、闭环的技术栈,才是真正的产品。

在这 10 层技术栈里,哪一层给你的团队带来了最多的痛点?欢迎在评论区交流讨论。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)