基于OpenCV的手势控制电脑音量项目:让操作更直观

通过这个项目,我们不仅体验到了OpenCV的强大功能,还实现了手势控制的实际应用。当然,这个项目的可扩展性很强,只要你有创意,就可以用同样的思路实现更多有趣的功能。如果你对这个项目感兴趣,或者有其他问题,欢迎随时交流!一起动手做项目,才是最好的学习方式!

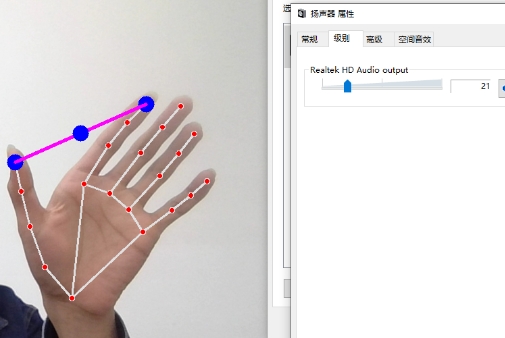

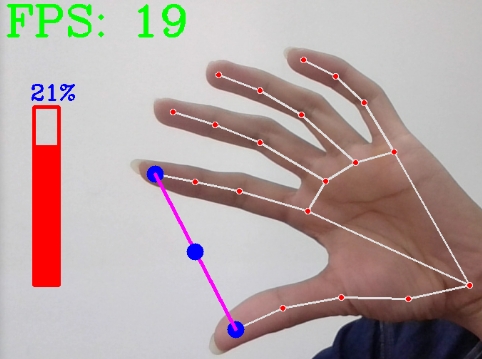

基于opencv的目标检测 远程手势控制电脑音量项目 源代码 基于opencv实现的手势控制电脑音量项目。 通过手部识别出21个关键点,并对21个关键点进行定位和着色,然后做出了个控制电脑音量小项目,还可以自己照葫芦画瓢diy很多小项目喔,有环境可以直接跑,带详细注解源码和详细介绍报告,小白也能从零学会。 还有很多类似的写好的小项目,比如手势控制虚拟计算器,手势控制电脑鼠标键盘,手势演示ppt,调节物体尺寸,搭积木,桌上冰球

最近尝试了一个挺有意思的小项目,是基于OpenCV的手势控制电脑音量功能。这个项目不仅有趣,还能让操作变得更加直观,尤其是对手势识别感兴趣的朋友们绝对值得一试!下面我就和大家分享一下这个项目的实现过程以及其中的一些小技巧。

1. 项目背景与目标

大家都知道,OpenCV是一个强大的计算机视觉库,可以用它来做很多有趣的事情,比如目标检测、图像处理、手势识别等等。这次的项目主要是利用OpenCV的手部关键点检测功能,通过捕捉手部的特定动作来控制电脑的音量大小。

基于opencv的目标检测 远程手势控制电脑音量项目 源代码 基于opencv实现的手势控制电脑音量项目。 通过手部识别出21个关键点,并对21个关键点进行定位和着色,然后做出了个控制电脑音量小项目,还可以自己照葫芦画瓢diy很多小项目喔,有环境可以直接跑,带详细注解源码和详细介绍报告,小白也能从零学会。 还有很多类似的写好的小项目,比如手势控制虚拟计算器,手势控制电脑鼠标键盘,手势演示ppt,调节物体尺寸,搭积木,桌上冰球

实现这个项目需要用到以下几部分:

- OpenCV库:用于手部关键点检测。

- Python:编写控制逻辑。

- PyAutoGUI:用来控制电脑音量(当然也可以用其他库,比如

ctypes)。

2. 项目实现步骤

整个项目大概可以分为以下几个步骤:

- 手部关键点检测:使用OpenCV的预制模型检测手部的21个关键点。

- 关键点定位与着色:在图像中绘制出关键点的位置,并用颜色标注。

- 动作识别:根据关键点的位置判断手势动作(比如“放大”或“缩小”)。

- 音量控制:根据识别到的动作调节数量。

接下来,我会详细讲解这些步骤,并在中间穿插代码和分析。

3. 手部关键点检测与绘制

首先,我们需要导入OpenCV库并加载手部检测模型。这里我们使用OpenCV官方提供的预制模型来检测手部关键点。代码如下:

import cv2

import numpy as np

import pyautogui

# 初始化摄像头

cap = cv2.VideoCapture(0)

# 加载手部检测模型

model = cv2.dnn.readNetFromCaffe(

'hand.pb', # 模型文件路径

'hand.prototxt' # 配置文件路径

)在检测到手部关键点之后,我们需要将这些点绘制在图像上。每个关键点都需要用不同的颜色标注,这样可以更直观地看到手部的姿态。

# 检测到手部后,获取关键点的位置

if detection.confidence > 0.5:

points = []

for i in range(21):

x = int(detection.keypoints[i].x * width)

y = int(detection.keypoints[i].y * height)

points.append([x, y])

cv2.circle(img, (x, y), 5, (0, 255, 0), -1)4. 动作识别与音量控制

接下来是关键的一步——根据关键点的位置判断手势动作。这里我们可以设定一些简单的规则,比如当手部张开时增加音量,握拳时减少音量。

# 计算拇指与其他指关节的相对位置

thumb_x = points[4][0]

index_x = points[8][0]

# 如果拇指在右侧,降低音量

if thumb_x > index_x:

pyautogui.press('voldown')

# 如果拇指在左侧,增加音量

elif thumb_x < index_x:

pyautogui.press('volup')5. 其他功能的扩展

做完这个项目之后,你会发现类似的逻辑可以应用到很多场景中。比如:

- 手势控制虚拟计算器:通过检测手势来模拟计算器的操作。

- 手势控制鼠标键盘:用手指的移动来代替鼠标,用拳头点击。

- 演示PPT:通过特定手势实现幻灯片的前后切换。

这些都是非常有趣且实用的小项目,只需要稍加修改就能实现。

6. 开源项目与资源

如果你对这个项目感兴趣,我建议直接从开源社区获取手部检测模型和相关代码。这样不仅省时,还能快速上手。我的项目代码已经整理得很详细,注释也很清晰,适合小白学习。

# 初始化音量控制

pyautogui.alert('音量控制已就绪,你可以开始操作了!')

# 进入主循环

while True:

ret, img = cap.read()

height, width = img.shape[:2]

# 手部检测逻辑

blob = cv2.dnn.blobFromImage(img)

model.setInput(blob)

detections = model.forward()

if detections.size > 0:

for i in range(detections.shape[2]):

confidence = detections[0, 0, i, 2]

if confidence > 0.5:

# 提取关键点坐标

points = []

for j in range(21):

x = int(detections[0, 0, i, 3 + 2 * j] * width)

y = int(detections[0, 0, i, 4 + 2 * j] * height)

points.append([x, y])

cv2.circle(img, (x, y), 5, (0, 255, 0), -1)

# 增加或减少音量

thumb_x = points[4][0]

index_x = points[8][0]

if thumb_x > index_x:

pyautogui.press('voldown')

elif thumb_x < index_x:

pyautogui.press('volup')

cv2.imshow('Gesture Volume Control', img)

if cv2.waitKey(1) == ord('q'):

break

cap.release()

cv2.destroyAllWindows()7. 总结与展望

通过这个项目,我们不仅体验到了OpenCV的强大功能,还实现了手势控制的实际应用。当然,这个项目的可扩展性很强,只要你有创意,就可以用同样的思路实现更多有趣的功能。

如果你对这个项目感兴趣,或者有其他问题,欢迎随时交流!一起动手做项目,才是最好的学习方式!

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)