LLM--大模型部署

本文介绍了Ollama本地大模型部署工具的使用方法。主要内容包括:下载安装Ollama(版本0.16.3)、部署轻量级qwen3:0.6b模型、运行与退出操作。重点讲解了Ollama提供的API接口,包括聊天对话、文本向量化、模型管理等8个核心接口的调用方法和Python示例代码,特别详细说明了/chat和/embeddings接口的使用场景和请求格式。文章还提及了因硬件限制选择小模型的考虑,为本

·

文章目录

下载Ollama

- 简介:本地大模型部署工具。

- 官网直接下载即可,很简单。

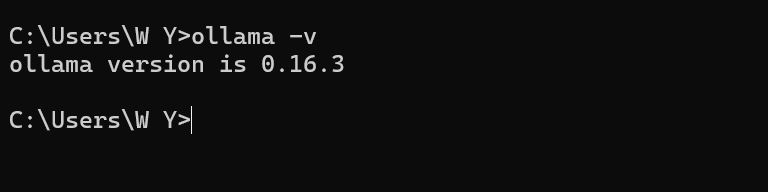

检查(cmd)

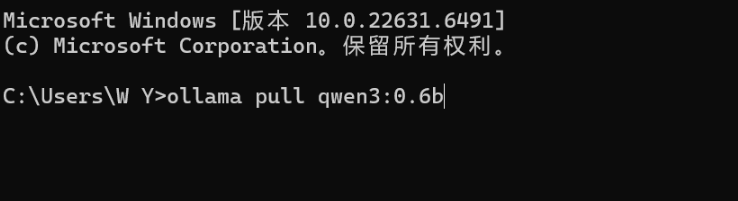

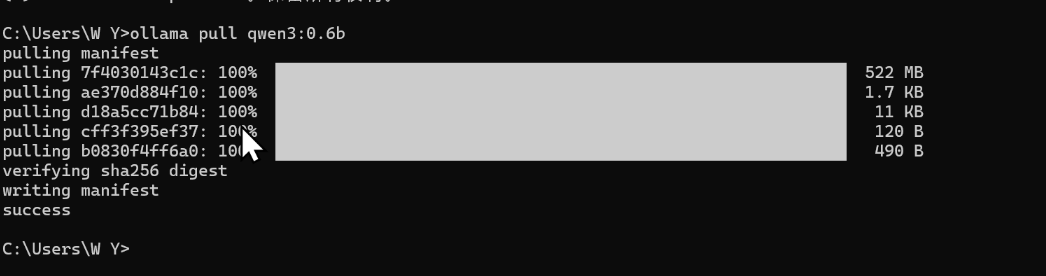

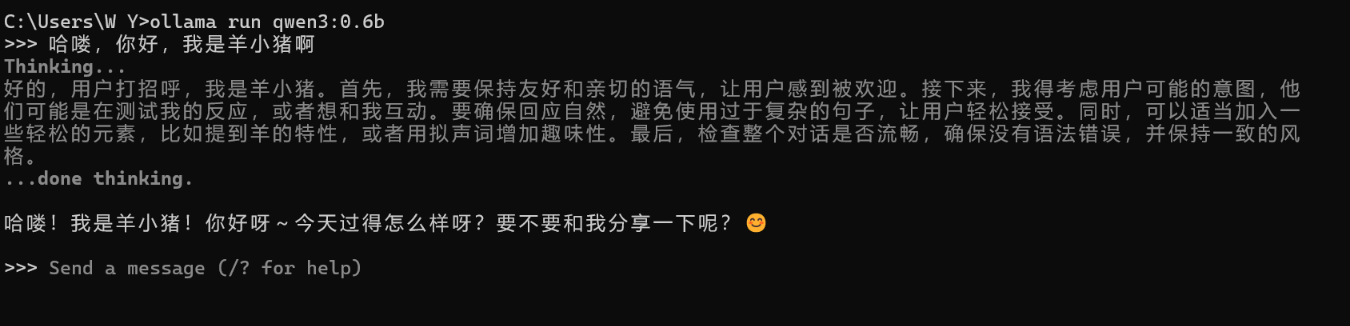

本地部署模型

本人电脑C盘不足,且电脑显卡不行,故只部署qwen3::0.6b模型

- 打开cmd,输入

- 运行

- 退出

Embedding嵌入模型

<font style="color:rgb(0, 0, 0);">ollama pull nomic-embed-text</font>

作用:文本转Embedding嵌入

Ollama API

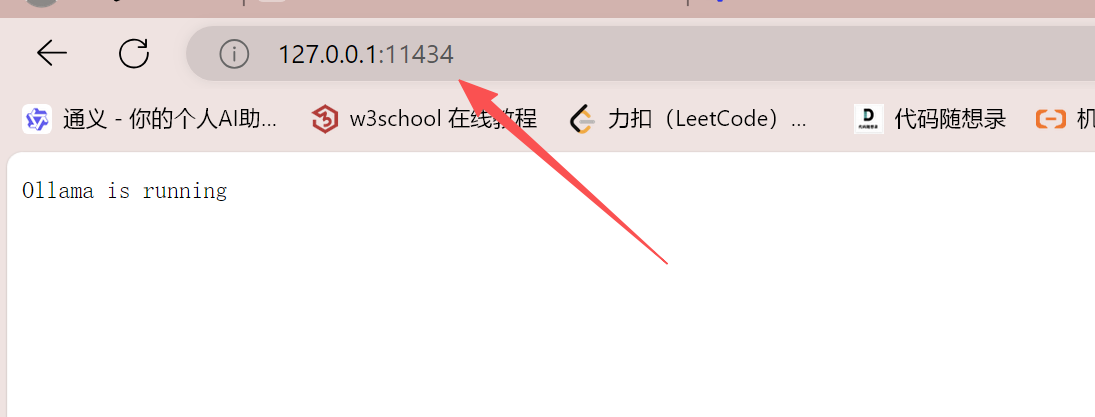

启动:ollama serve

接口解释

| 接口 | 方法 | 用途 |

|---|---|---|

/api/chat |

POST | 聊天对话 |

/api/embeddings |

POST | 文本向量化 |

/api/generate |

POST | 单次生成 |

/api/tags |

GET | 查看模型 |

/api/show |

POST | 模型详情 |

/api/pull |

POST | 下载模型 |

/api/delete |

DELETE | 删除模型 |

/api/version |

GET | 查看版本 |

/api/chat - 聊天对话(最常用)

用途:多轮对话,支持 system/user/assistant 角色

请求格式:

{

"model": "qwen3:0.6b",

"messages": [

{"role": "system", "content": "你是一个助手"},

{"role": "user", "content": "你好"}

],

"stream": false

}

Python 调用:

import requests

response = requests.post("http://localhost:11434/api/chat", json={

"model": "qwen3:0.6b",

"messages": [

{"role": "system", "content": "你是一个助手"},

{"role": "user", "content": "你好"}

],

"stream": False

})

print(response.json()["message"]["content"])

curl 测试:

curl http://localhost:11434/api/chat -d '{

"model": "qwen3:0.6b",

"messages": [{"role": "user", "content": "你好"}],

"stream": false

}'

/api/embeddings - 文本向量化

用途:将文本转换为向量**(用于 RAG 语义搜索)**

请求格式:

{

"model": "nomic-embed-text",

"prompt": "今天天气真好"

}

Python 调用:

import requests

response = requests.post("http://localhost:11434/api/embeddings", json={

"model": "nomic-embed-text",

"prompt": "今天天气真好"

})

vector = response.json()["embedding"]

print(f"向量维度: {len(vector)}") # 768 维

/api/generate - 单次文本生成(旧版)

用途:简单文本生成(不支持多轮对话)

请求格式:

{

"model": "qwen3:0.6b",

"prompt": "你好,请介绍一下你自己",

"stream": false

}

Python 调用:

import requests

response = requests.post("http://localhost:11434/api/generate", json={

"model": "qwen3:0.6b",

"prompt": "你好",

"stream": False

})

print(response.json()["response"])

/api/tags - 查看已下载模型

用途:列出本地所有可用模型

Python 调用:

import requests

response = requests.get("http://localhost:11434/api/tags")

models = response.json()["models"]

print("已安装的模型:")

for model in models:

print(f" - {model['name']} ({model['size'] / 1e9:.2f} GB)")

curl 测试:

curl http://localhost:11434/api/tags

/api/show - 查看模型详情

用途:获取模型的详细信息(参数、许可证等)

Python 调用:

import requests

response = requests.post("http://localhost:11434/api/show", json={

"model": "qwen3:0.6b"

})

info = response.json()

print(f"模型: {info['model']}")

print(f"参数: {info.get('details', {})}")

/api/pull - 下载模型

用途:编程方式下载模型

Python 调用:

import requests

response = requests.post("http://localhost:11434/api/pull", json={

"model": "qwen3:0.6b",

"stream": False

})

print(response.json())

/api/delete - 删除模型

用途:删除本地模型释放空间

Python 调用:

import requests

response = requests.delete("http://localhost:11434/api/delete", json={

"model": "qwen3:0.6b"

})

print(response.json())

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)