U-Net:图像领域像素级理解的革命性网络

想象一下,如果计算机能够像人类医生一样精确识别医学图像中的肿瘤区域,像城市规划师一样准确划分卫星图像中的道路和建筑物,甚至像生物学家一样区分显微镜下的细胞结构——这正是Unet所实现的奇迹。无论是医学诊断的精准化,自动驾驶的安全性提升,还是地球观测的智能化,Unet都将继续在各个领域发挥重要作用,帮助人类解决更多实际问题。在这段时间里,它从一个专门为医学图像分割设计的架构,发展成为一个通用的图像分

引言:从细胞到宇宙的分割艺术

想象一下,如果计算机能够像人类医生一样精确识别医学图像中的肿瘤区域,像城市规划师一样准确划分卫星图像中的道路和建筑物,甚至像生物学家一样区分显微镜下的细胞结构——这正是Unet所实现的奇迹。2015年,由Olaf Ronneberger等人提出的Unet架构彻底改变了图像分割领域,特别是医学影像分析。但它的影响力远不止于此,从自动驾驶到农业监测,从工业检测到天文观测,Unet已成为深度学习中最重要的架构之一。

Unet的诞生背景:医学图像分析的迫切需求

在Unet出现之前,医学图像分割面临着诸多挑战:

-

数据稀缺性:标注高质量的医学图像需要领域专家的大量时间和专业知识

-

类别不平衡:目标区域(如肿瘤)通常只占图像的很小部分

-

边界模糊性:生物组织的边界常常不清晰、不连续

-

三维结构的二维表示:三维医学扫描通常以二维切片形式处理

传统的图像处理方法如阈值分割、区域生长、边缘检测等往往难以应对这些复杂情况。而早期的卷积神经网络在医学图像分割任务上表现不佳,主要原因是它们缺乏捕捉多尺度特征的能力,并且需要大量标注数据。

正是在这样的背景下,Unet应运而生,它巧妙地将编码器-解码器结构与跳跃连接相结合,创造出一种既高效又精确的解决方案。

Unet的核心原理:优雅的对称之美

3.1 整体架构:编码与解码的完美对称

Unet的架构如同一只展翅的蝴蝶,其名称源于其独特的U形结构。整个网络可以清晰地分为两个部分:

左侧收缩路径(编码器):

-

由一系列卷积层和最大池化层组成

-

每经过一个池化层,空间维度减半,特征通道数加倍

-

目标:提取图像的上下文信息,理解图像中“是什么”

右侧扩展路径(解码器):

-

由一系列转置卷积(或上采样)和卷积层组成

-

每经过一个上采样层,空间维度加倍,特征通道数减半

-

目标:精确定位,理解“在哪里”

跳跃连接:

-

将编码器每一层的特征图与解码器对应层的特征图连接

-

传递细粒度信息,帮助解码器更好地重建细节

-

解决梯度消失问题,加速训练收敛

3.2 数学原理详解

设输入图像为X ∈ ℝ^{H×W×C},其中H、W、C分别表示高度、宽度和通道数。

编码器第i层的操作:

text

Conv_i(X) = σ(BN(W_i * X + b_i))

其中*表示卷积操作,W_i和b_i是卷积核权重和偏置,BN是批量归一化,σ是激活函数(通常为ReLU)。

池化操作(下采样):

text

Pool_i(X) = MaxPool(Conv_i(X))

解码器第j层的操作:

text

UpConv_j(X) = TransposeConv(X) Fusion_j = Concat(UpConv_j(X), Skip_j) DecConv_j = σ(BN(W_j * Fusion_j + b_j))

其中Skip_j来自编码器对应层的特征图,Concat表示通道维度的拼接。

最终输出层:

text

Output = Softmax(Conv_{final}(DecConv_{last}))

3.3 为什么Unet如此有效?

-

多尺度特征融合:通过不同深度的特征图,Unet同时捕捉局部细节和全局上下文

-

信息无损传递:跳跃连接确保了空间信息在降采样过程中的损失最小化

-

端到端训练:整个网络可以一次性训练,优化分割目标

-

数据效率高:即使训练数据有限,也能取得良好效果

Unet的进化之路:从基础到变体

4.1 基础Unet的局限性

尽管原始Unet取得了巨大成功,但它仍有一些不足:

-

计算量较大,参数量多

-

对小目标分割不够敏感

-

对边界的分割精度有待提高

-

难以处理类别极度不平衡的情况

4.2 主要变体及改进

Res-Unet:引入残差连接

text

ResBlock(X) = X + Conv(Conv(X))

解决深层网络梯度消失问题,使网络可以设计得更深。

Attention Unet:添加注意力机制

text

Attention = σ(Conv(Concat(Query, Key))) Refined = Attention × Value

使网络能够聚焦于相关区域,减少背景干扰。

Dense-Unet:采用密集连接

text

X_l = H_l(Concat(X_0, X_1, ..., X_{l-1}))

促进特征重用,减少参数量,增强梯度流动。

3D Unet:处理三维体积数据

-

使用3D卷积核和3D池化

-

直接处理CT、MRI等三维医学图像

-

捕捉三维空间中的连续性和结构信息

nnUnet(No New Net):

-

不是新的架构,而是系统化的训练框架

-

自动适应不同的数据集特性

-

在多个医学图像分割挑战赛中取得最先进结果

4.3 损失函数的创新

除了架构改进,损失函数的创新也大大提升了Unet的性能:

Dice损失:

text

Dice Loss = 1 - (2|X∩Y|)/(|X|+|Y|)

特别适用于类别不平衡的情况,是医学图像分割最常用的损失函数之一。

Focal损失:

text

Focal Loss = -α(1-p_t)^γ log(p_t)

降低易分类样本的权重,使模型更关注难分类样本。

复合损失:

text

Total Loss = λ1 * BCE + λ2 * Dice + λ3 * Boundary

结合多种损失函数的优点,达到更好的综合性能。

Unet在医学影像中的应用

5.1 肿瘤检测与分割

脑肿瘤分割(BraTS挑战赛):

-

多模态MRI图像(T1、T1c、T2、FLAIR)

-

分割水肿、增强肿瘤、坏死和非增强肿瘤

-

3D Unet及其变体在该任务上表现卓越

肺结节检测:

-

从CT图像中识别恶性肺结节

-

早期肺癌筛查的关键技术

-

减少假阳性,提高诊断效率

皮肤病变分割:

-

从皮肤镜图像中分割黑色素瘤

-

辅助皮肤病专家进行早期诊断

-

ISIC挑战赛中Unet类模型占据主导地位

5.2 器官分割

心脏分割:

-

从MRI图像中分割左心室、右心室和心肌

-

计算射血分数等关键临床指标

-

对心血管疾病诊断至关重要

肝脏和肝脏肿瘤分割:

-

LiTS挑战赛中的核心任务

-

为肝切除术规划提供关键信息

-

准确评估肿瘤体积和位置

视网膜血管分割:

-

从眼底图像中分割视网膜血管

-

糖尿病视网膜病变的早期检测

-

DRIVE、STARE等数据集上的基准模型

5.3 细胞分割与生物医学应用

显微镜图像细胞分割:

-

识别和分割单个细胞

-

细胞计数、形态分析

-

药物发现和基础研究的重要工具

神经元结构分割:

-

电子显微镜图像中的神经元重建

-

连接组学研究的基础

-

ISBI神经元分割挑战赛的常用方法

超越医学:Unet的跨领域应用

6.1 卫星与航空图像分析

土地利用分类:

-

识别城市、农田、森林、水域等

-

从高分辨率卫星图像生成土地利用图

-

环境保护和城市规划的重要工具

道路提取:

-

从卫星图像中自动提取道路网络

-

地图更新和导航系统的基础

-

DeepGlobe道路提取挑战赛的优胜方案

建筑物检测与分割:

-

识别和分割建筑物轮廓

-

城市扩张监测、人口估计

-

灾害评估和应急响应

6.2 自动驾驶与环境感知

语义场景分割:

-

实时分割道路、车辆、行人、标志等

-

Cityscapes、KITTI等数据集的标准方法

-

自动驾驶系统的核心感知模块

车道线检测:

-

准确识别车道线位置和类型

-

车道保持和自动导航的基础

-

必须处理各种光照和天气条件

6.3 工业检测与质量控制

缺陷检测:

-

识别产品表面缺陷

-

提高质量控制效率和一致性

-

应用于金属、纺织品、电子元件等多个行业

PCB检测:

-

印刷电路板的自动检测

-

识别短路、断路、错位等缺陷

-

提高电子产品制造质量

6.4 农业与生态学

作物分割与分类:

-

从无人机图像中识别不同作物类型

-

监测作物健康状况

-

精准农业和产量预测

森林监测:

-

识别树种、监测森林健康状况

-

检测非法砍伐和森林退化

-

生物多样性保护和气候变化研究

实战指南:构建自己的Unet模型

7.1 环境配置与数据准备

python

# 基础环境配置

import torch

import torch.nn as nn

import torch.nn.functional as F

from torch.utils.data import Dataset, DataLoader

import numpy as np

import matplotlib.pyplot as plt

# 自定义数据集类

class MedicalImageDataset(Dataset):

def __init__(self, image_paths, mask_paths, transform=None):

self.image_paths = image_paths

self.mask_paths = mask_paths

self.transform = transform

def __len__(self):

return len(self.image_paths)

def __getitem__(self, idx):

image = np.load(self.image_paths[idx])

mask = np.load(self.mask_paths[idx])

if self.transform:

augmented = self.transform(image=image, mask=mask)

image = augmented['image']

mask = augmented['mask']

return image, mask

7.2 基础Unet实现

python

class DoubleConv(nn.Module):

"""(卷积 => BN => ReLU) * 2"""

def __init__(self, in_channels, out_channels):

super().__init__()

self.double_conv = nn.Sequential(

nn.Conv2d(in_channels, out_channels, kernel_size=3, padding=1),

nn.BatchNorm2d(out_channels),

nn.ReLU(inplace=True),

nn.Conv2d(out_channels, out_channels, kernel_size=3, padding=1),

nn.BatchNorm2d(out_channels),

nn.ReLU(inplace=True)

)

def forward(self, x):

return self.double_conv(x)

class Unet(nn.Module):

def __init__(self, n_channels, n_classes):

super(Unet, self).__init__()

self.n_channels = n_channels

self.n_classes = n_classes

# 编码器

self.inc = DoubleConv(n_channels, 64)

self.down1 = nn.Sequential(

nn.MaxPool2d(2),

DoubleConv(64, 128)

)

self.down2 = nn.Sequential(

nn.MaxPool2d(2),

DoubleConv(128, 256)

)

self.down3 = nn.Sequential(

nn.MaxPool2d(2),

DoubleConv(256, 512)

)

self.down4 = nn.Sequential(

nn.MaxPool2d(2),

DoubleConv(512, 1024)

)

# 解码器

self.up1 = nn.ConvTranspose2d(1024, 512, kernel_size=2, stride=2)

self.conv1 = DoubleConv(1024, 512)

self.up2 = nn.ConvTranspose2d(512, 256, kernel_size=2, stride=2)

self.conv2 = DoubleConv(512, 256)

self.up3 = nn.ConvTranspose2d(256, 128, kernel_size=2, stride=2)

self.conv3 = DoubleConv(256, 128)

self.up4 = nn.ConvTranspose2d(128, 64, kernel_size=2, stride=2)

self.conv4 = DoubleConv(128, 64)

# 输出层

self.outc = nn.Conv2d(64, n_classes, kernel_size=1)

def forward(self, x):

# 编码器路径

x1 = self.inc(x)

x2 = self.down1(x1)

x3 = self.down2(x2)

x4 = self.down3(x3)

x5 = self.down4(x4)

# 解码器路径

x = self.up1(x5)

# 跳跃连接

x = torch.cat([x, x4], dim=1)

x = self.conv1(x)

x = self.up2(x)

x = torch.cat([x, x3], dim=1)

x = self.conv2(x)

x = self.up3(x)

x = torch.cat([x, x2], dim=1)

x = self.conv3(x)

x = self.up4(x)

x = torch.cat([x, x1], dim=1)

x = self.conv4(x)

logits = self.outc(x)

return logits

7.3 训练与评估

python

def train_model(model, train_loader, val_loader, epochs=100, lr=1e-4):

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model.to(device)

# 使用复合损失函数

criterion = nn.BCEWithLogitsLoss() # 对于二分类

# 或多分类情况:criterion = nn.CrossEntropyLoss()

optimizer = torch.optim.Adam(model.parameters(), lr=lr)

scheduler = torch.optim.lr_scheduler.ReduceLROnPlateau(

optimizer, mode='min', patience=5, factor=0.5

)

best_val_loss = float('inf')

for epoch in range(epochs):

# 训练阶段

model.train()

train_loss = 0.0

for images, masks in train_loader:

images = images.to(device)

masks = masks.to(device)

optimizer.zero_grad()

outputs = model(images)

loss = criterion(outputs, masks)

loss.backward()

optimizer.step()

train_loss += loss.item()

# 验证阶段

model.eval()

val_loss = 0.0

with torch.no_grad():

for images, masks in val_loader:

images = images.to(device)

masks = masks.to(device)

outputs = model(images)

loss = criterion(outputs, masks)

val_loss += loss.item()

# 计算评估指标

train_loss /= len(train_loader)

val_loss /= len(val_loader)

# 计算Dice系数

dice_score = compute_dice(outputs, masks)

print(f'Epoch {epoch+1}/{epochs}')

print(f'Train Loss: {train_loss:.4f}, Val Loss: {val_loss:.4f}, Dice: {dice_score:.4f}')

# 保存最佳模型

if val_loss < best_val_loss:

best_val_loss = val_loss

torch.save(model.state_dict(), 'best_model.pth')

scheduler.step(val_loss)

return model

def compute_dice(pred, target, smooth=1e-6):

# 计算Dice系数

pred = torch.sigmoid(pred)

pred = (pred > 0.5).float()

intersection = (pred * target).sum()

dice = (2. * intersection + smooth) / (pred.sum() + target.sum() + smooth)

return dice.item()

Unet的挑战与未来发展方向

8.1 当前面临的挑战

数据标注成本:

-

高质量的标注需要领域专家

-

不同标注者之间存在不一致性

-

半监督和弱监督学习成为研究热点

模型泛化能力:

-

在不同设备、不同协议获取的图像上性能下降

-

域适应和领域泛化是重要研究方向

计算资源需求:

-

高分辨率图像需要大量内存

-

实时应用需要模型轻量化

不确定性估计:

-

模型预测的可信度评估

-

在临床决策中的安全应用

8.2 未来发展方向

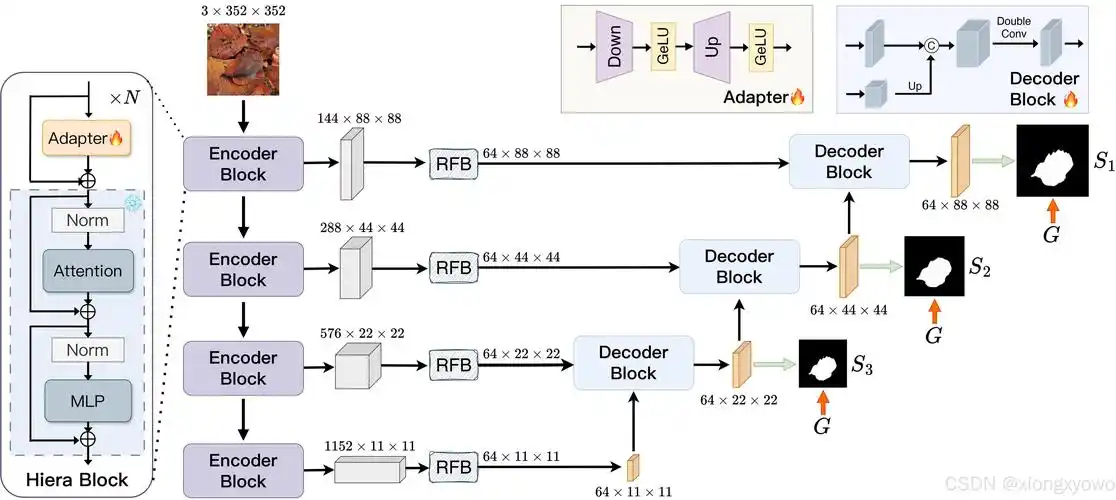

Transformer与Unet的结合:

-

Vision Transformer在图像分割中的成功应用

-

Swin-Unet、TransUnet等混合架构

-

捕捉长距离依赖关系

自监督与半监督学习:

-

利用大量未标注数据

-

对比学习、生成式预训练

-

减少对标注数据的依赖

联邦学习与隐私保护:

-

跨机构协作训练,保护数据隐私

-

医学图像分析的重要方向

-

解决数据孤岛问题

可解释性与可信AI:

-

理解模型的决策过程

-

可视化注意力区域

-

建立临床医生的信任

实时与轻量化模型:

-

移动设备部署

-

实时医学影像分析

-

边缘计算应用

结论:Unet的遗产与影响

从2015年诞生至今,Unet已经走过了近十年的发展历程。在这段时间里,它从一个专门为医学图像分割设计的架构,发展成为一个通用的图像分割框架,影响了计算机视觉的多个领域。

Unet的成功不仅在于其优雅的对称结构,更在于它提出了一种有效的多尺度特征融合范式。跳跃连接的思想被广泛借鉴,影响了后续许多网络架构的设计。更重要的是,Unet证明了深度学习可以在数据有限的专业领域取得突破性进展,这为AI在医学、科学和工业等领域的应用铺平了道路。

今天,虽然出现了许多新的架构和技术,但Unet及其变体仍然是图像分割任务中最常用、最可靠的基准模型之一。它的设计理念——结合全局上下文与局部细节、通过跳跃连接保留空间信息、端到端的训练方式——已经成为图像分割领域的宝贵遗产。

随着技术的不断进步,我们可能会看到更强大的架构出现,但Unet所代表的理念和精神将继续影响未来的研究。无论是医学诊断的精准化,自动驾驶的安全性提升,还是地球观测的智能化,Unet都将继续在各个领域发挥重要作用,帮助人类解决更多实际问题。

Unet告诉我们,有时最简单的对称之美,能够孕育出最强大的技术解决方案。在这个由数据驱动的人工智能时代,Unet的U形结构不仅是一个网络架构,更是一座连接人工智能与真实世界需求的桥梁。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)