C#语音识别与文本转语音的SAPI实现指南

语音交互技术已成为IT行业中最前沿且最吸引人的技术之一。它通过语音合成(Text-to-Speech,TTS)和语音识别(Speech-to-Text,STT)技术,实现了人机交互的自然化,极大增强了用户体验。在Windows平台上,Speech API(SAPI)是一种广泛使用的技术,它提供了一套丰富的语音识别和语音合成功能,允许开发者集成语音交互能力到自己的应用程序中。SAPI是一组语音技术的

简介:本教程详细介绍了如何使用微软的Speech API(SAPI)在C#中实现语音识别和文本到语音的转换功能。通过引用.NET Framework中的 System.Speech 类库,创建 SpeechRecognitionEngine 和 SpeechSynthesizer 对象,设置相关属性和事件处理器,开发者可以轻松集成语音识别和语音合成功能到他们的应用程序中。教程还提供了代码示例和实践操作,帮助开发者掌握SAPI的应用,并通过调整语音合成器的属性来实现更丰富的语音交互效果。

1. Speech API(SAPI)简介

语音交互技术已成为IT行业中最前沿且最吸引人的技术之一。它通过语音合成(Text-to-Speech,TTS)和语音识别(Speech-to-Text,STT)技术,实现了人机交互的自然化,极大增强了用户体验。在Windows平台上,Speech API(SAPI)是一种广泛使用的技术,它提供了一套丰富的语音识别和语音合成功能,允许开发者集成语音交互能力到自己的应用程序中。

1.1 Speech API概述

SAPI是一组语音技术的集合,它包括语音识别引擎(SRE)和语音合成引擎(TTS),允许开发者处理语音输入和输出。SAPI的主要目的是简化程序中的语音集成过程,使得开发者能够轻松地为应用程序添加语音命令、语音控制、语音反馈等功能。

1.2 SAPI的版本迭代与特性

自推出以来,SAPI已经经历了多个版本的更新,每个版本都在性能、易用性及功能上有所增强。最新的SAPI版本不仅提高了准确性,也扩展了对更多语言的支持,而且在API的设计上更加直观和灵活。

1.3 SAPI在现代应用中的角色

在如今的智能设备、服务机器人、车载系统以及个人助理应用中,SAPI的应用变得越来越广泛。它让设备能够理解和回应人类的语音指令,是构建更自然用户界面的关键组件。

接下来的章节中,我们将深入探讨SAPI的不同组成部分,从机制与应用的角度,全面了解如何在实际项目中实现语音识别与语音合成。

2. 语音识别引擎(SRE)和语音合成引擎(TTS)

2.1 语音识别引擎(SRE)的机制与应用

2.1.1 SRE的工作原理

语音识别引擎(SRE)是将人类的语音信号转换为可读文本的技术。为了实现这一过程,SRE通过几个主要步骤进行:

- 声音采集 :首先,需要从麦克风等输入设备采集到原始语音信号。

- 预处理 :对采集的信号进行去噪、回声消除等预处理,以便更好地进行后续处理。

- 特征提取 :提取声学特征,这通常包括提取梅尔频率倒谱系数(MFCCs),这些系数可以捕捉到语音信号中的关键信息。

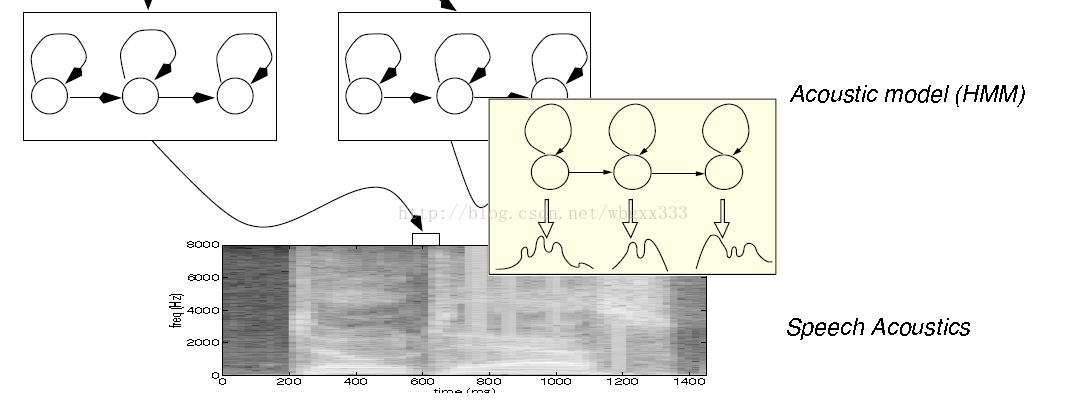

- 声学模型 :使用预先训练好的声学模型来识别这些特征,这些模型通常基于隐马尔可夫模型(HMM)或深度学习模型。

- 语言模型 :语言模型用于预测接下来最可能的单词或短语,它基于大量文本数据训练得到。

- 解码 :结合声学模型和语言模型的输出,使用解码算法将声学特征转换成对应的文本。

2.1.2 SRE在不同环境下的应用实例

语音识别引擎的应用范围非常广泛,例如:

- 智能助手 :Siri、Google Assistant、Alexa等都在背后使用了SRE技术,用户可以通过自然语言与这些助手进行交互。

- 语音输入法 :提供语音转文字功能的输入法软件,比如讯飞输入法,大大提高了文字输入的效率。

- 客服系统 :自动语音识别可用来处理客户咨询,提供快速响应。

- 汽车系统 :集成在现代汽车中的语音控制系统允许驾驶员在开车时,通过语音命令来控制导航、电话和车辆设置。

2.2 语音合成引擎(TTS)的机制与应用

2.2.1 TTS的工作原理

语音合成引擎(TTS)则是将文本信息转换为语音信息的技术。其主要步骤包括:

- 文本解析 :分析文本内容,识别文字、标点符号和特殊格式。

- 文本标准化 :将缩写、数字、日期等转换成对应的完整形式。

- 文本到音素的映射 :将标准化的文本转换为音素序列,即发音的基本单位。

- 声音合成 :根据音素序列,合成相应的语音波形。

- 后处理 :对合成的语音进行音质调整,如调整语速、音调、音量等。

2.2.2 TTS在不同环境下的应用实例

TTS技术的应用同样多样:

- 屏幕阅读器 :为视障用户提供文本到语音的转换服务,帮助他们访问电子文档和网络内容。

- 导航系统 :在车载导航系统中提供语音指示,提高了行车的安全性。

- 教育技术 :为学习者提供文本到语音的辅助,特别是在语言学习和特殊教育领域。

- 智能客服 :自动为客户提供电话服务,可以模拟人类语音回答常见问题。

第三章:在C#中引用 System.Speech 类库

3.1 安装与配置 System.Speech 类库

3.1.1 安装类库的方法

要在C#项目中使用语音识别和语音合成功能,可以使用 System.Speech 类库。该类库属于.NET Framework的一部分,因此确保你的开发环境已经安装了相应版本的.NET Framework。接下来,你可以通过NuGet包管理器来安装 System.Speech 包,以确保所有必要的类和方法都可用。

打开Visual Studio中的”工具” -> “NuGet包管理器” -> “管理解决方案的NuGet包”,然后搜索 System.Speech 并进行安装。

3.1.2 配置类库的环境设置

安装好 System.Speech 之后,需要确保你的项目已正确配置。在项目中添加对 System.Speech.dll 的引用,通常这个操作在Visual Studio中会自动完成。如果需要手动操作,可以通过项目属性的“引用”标签页添加。

3.2 创建C#项目与类库集成

3.2.1 新建C#控制台或窗体应用程序

创建一个新的C#项目,选择适合你的应用类型的模板。对于入门级的应用,控制台应用程序是一个好的起点。在Visual Studio中选择“文件”->“新建”->“项目…”,然后选择“控制台应用(.NET Framework)”或“Windows窗体应用(.NET Framework)”。

3.2.2 引入 System.Speech 类库

在项目中引入 System.Speech 之后,你将能够访问 SpeechRecognitionEngine 和 SpeechSynthesizer 等核心类。在代码文件的顶部添加以下using指令:

using System.Speech.Recognition;

using System.Speech.Synthesis;

第四章:使用 SpeechRecognitionEngine 实现语音识别

4.1 创建语音识别引擎实例

4.1.1 实例化 SpeechRecognitionEngine

要使用语音识别引擎,首先需要创建一个 SpeechRecognitionEngine 的实例。

SpeechRecognitionEngine recognizer = new SpeechRecognitionEngine();

4.1.2 配置识别引擎的基本属性

配置识别引擎的第一步是选择一个语言识别的配置文件,这通常是一个 .grammar 文件。根据需要识别的语言和词汇,你可以选择合适的文件。

recognizer.SetInputToDefaultAudioDevice();

recognizer.LoadGrammar(new DictationGrammar());

recognizer.SpeechRecognized += Recognizer_SpeechRecognized;

recognizer.RecognizeAsync(RecognizeMode.Multiple);

在这个示例中,我们首先将输入设置为默认的音频设备,然后加载了一个语音识别字典(在此例中为一个自由格式的字典,用于识别任意语言)。我们还添加了一个事件处理器来响应识别事件。

4.2 实现语音识别功能

4.2.1 选择音频输入设备

通过调用 SetInputToDefaultAudioDevice 方法,语音识别引擎可以使用默认的音频输入设备。如果你希望从特定的设备接收输入,可以使用 SetInputToWaveFile 方法指定一个波形文件,或者使用 SetInputToAudioSource 方法并传入一个自定义的 AudioSource 对象。

4.2.2 开始监听和识别

一旦配置了输入源和识别引擎,你就可以开始语音识别过程。调用 RecognizeAsync 方法可以使引擎异步地开始监听,并且持续地识别语音输入。

private void Recognizer_SpeechRecognized(object sender, SpeechRecognizedEventArgs e)

{

string result = e.Result.Text;

// 处理识别结果

}

在上面的代码示例中,当语音被识别出来时, SpeechRecognized 事件被触发,我们可以在事件处理器中获取到识别的文本。

4.3 语音识别事件处理器与回调机制

4.3.1 自定义事件处理器

在前面的例子中,我们已经看到如何创建一个基本的事件处理器。如果你需要更复杂的行为,你可以编写多个事件处理器,并在它们之间建立逻辑关系。例如,你可以根据识别结果的不同,执行不同的函数。

recognizer.SpeechHypothesized += Recognizer_SpeechHypothesized;

recognizer.SpeechDetected += Recognizer_SpeechDetected;

void Recognizer_SpeechHypothesized(object sender, SpeechHypothesizedEventArgs e)

{

// 处理识别过程中的中间结果

}

void Recognizer_SpeechDetected(object sender, SpeechDetectedEventArgs e)

{

// 检测到语音时的处理

}

4.3.2 处理识别结果和相关事件

语音识别过程中会产生多种事件,如识别中间结果(SpeechHypothesized)、检测到语音(SpeechDetected)以及实际识别完成(SpeechRecognized)。为了实现一个完整的语音识别解决方案,你可能需要在这些事件中添加逻辑代码,以便在应用程序中使用识别结果。

第五章:使用 SpeechSynthesizer 实现文本转语音

5.1 创建语音合成器实例

5.1.1 实例化 SpeechSynthesizer

要使用语音合成技术,需要创建 SpeechSynthesizer 的实例。

SpeechSynthesizer synthesizer = new SpeechSynthesizer();

5.1.2 选择并设置合成引擎的发音人

SpeechSynthesizer 允许你选择不同的发音人,他们都有不同的声音特点和语言能力。

synthesizer.SelectVoice("Microsoft Zira Desktop");

在上面的代码示例中,我们选择了名为”Microsoft Zira Desktop”的语音。你可以根据需要选择其他支持的声音,例如”Microsoft David Desktop”等。

5.2 文本转语音功能实现

5.2.1 文本的输入和格式处理

将文本输入到语音合成器是最基本的操作,可以简单地传递一个字符串。

string text = "Hello, world!";

synthesizer.SpeakAsync(text);

5.2.2 执行文本到语音的转换

使用 SpeakAsync 方法可以异步地将文本信息转换为语音信息,这不会阻塞主线程。 Speak 方法可以同步地执行这个操作,但在UI线程中使用时需要小心,因为这可能会导致UI冻结。

5.3 调整语音合成器属性

5.3.1 修改语速和音量

通过调整语音合成器的属性,你可以改变生成语音的语速和音量。

synthesizer.Rate = -1; // -10 到 10 之间的值,其中 0 表示正常速度

synthesizer.Volume = 100; // 0 到 100 之间的值,其中 0 表示静音

5.3.2 使用语音合成标记优化输出

SpeechSynthesizer 还支持使用SSML(语音合成标记语言)来增强语音输出的控制。这允许你指定语音的详细属性,如语调、音高等。

string ssmlText = @"<speak version='1.0' xmlns='http://www.w3.org/2001/10/synthesis' xml:lang='en-US'>

<voice xml:lang='en-US' xml:gender='Female' name='Microsoft Zira Desktop'>

<prosody rate='50%'>

I am excited to speak with you!

</prosody>

</voice>

</speak>";

synthesizer.SpeakSsmlAsync(ssmlText);

第六章:代码示例和操作实践

6.1 集成语音识别和文本转语音的综合示例

6.1.1 简单的语音识别到文本转语音的流程

using System;

using System.Speech.Recognition;

using System.Speech.Synthesis;

namespace SpeechDemo

{

class Program

{

static void Main(string[] args)

{

SpeechRecognitionEngine recognizer = new SpeechRecognitionEngine();

recognizer.SetInputToDefaultAudioDevice();

recognizer.LoadGrammar(new DictationGrammar());

recognizer.SpeechRecognized += Recognizer_SpeechRecognized;

recognizer.RecognizeAsync(RecognizeMode.Multiple);

Console.WriteLine("Speak now...");

Console.ReadLine(); // 等待用户结束程序

}

private static void Recognizer_SpeechRecognized(object sender, SpeechRecognizedEventArgs e)

{

if (e.Result.Text.Length > 0)

{

SpeechSynthesizer synthesizer = new SpeechSynthesizer();

synthesizer.SelectVoice("Microsoft Zira Desktop");

synthesizer.SpeakAsync(e.Result.Text);

}

}

}

}

在这个简单的示例中,程序启动后开始监听用户的语音输入,并将识别到的文本内容通过语音合成技术说出来。

6.1.2 实践中遇到的常见问题及解决方法

在实践中,你可能会遇到不同的问题,比如识别不准确、环境噪声干扰、长词或短语处理等。通常,可以通过以下方法提高识别准确性和系统性能:

- 调整声音大小和清晰度 :使用质量好的麦克风,并确保输入音量不要过大或过小。

- 训练个人词汇 :对于特定的词汇或术语,可以通过训练使SRE更好地识别。

- 环境噪音过滤 :在嘈杂的环境中,使用噪音过滤技术或使用定向麦克风。

- 处理长词和短语 :对于长词或短语,可能需要使用更复杂的语法或词汇模型,以提高识别率。

6.2 进阶应用与优化

6.2.1 复杂场景下的语音处理策略

在更复杂的场景中,如对话系统或多方会议记录,需要更复杂的语音处理策略。这包括但不限于:

- 声学模型的优化 :采用更大规模的数据训练声学模型,以适应不同说话者的声音特征。

- 对话状态追踪 :利用对话管理技术来理解整个对话的上下文,从而提高识别的准确性。

- 语音识别的并发处理 :允许并行处理多个语音流,从而提高系统的响应能力和吞吐量。

6.2.2 性能优化和多语言支持

性能优化涉及多个方面:

- 算法优化 :优化识别算法,减少计算成本和延迟。

- 异步处理 :采用异步编程模式来处理语音识别任务,使UI保持响应状态。

- 多线程与并发 :合理利用多线程和并行计算来处理语音数据,提高吞吐量。

对于多语言支持:

- 国际化 :实现代码的国际化,以支持不同的语言和文化。

- 语言检测和自动切换 :集成语言检测机制,根据说话者语言自动切换到相应的语言模型。

- 本地化资源 :为不同语言提供本地化的字典和语法文件,以及适当的发音人。

以上内容仅作为实践示例和操作指导的一部分,后续部分将更详细地描述各个部分的工作方式和代码逻辑,以帮助读者更深入地理解和应用。

3. 在C#中引用 System.Speech 类库

在深入探讨如何在C#中实现语音识别和语音合成之前,本章将详细介绍如何安装和配置 System.Speech 类库,并指导读者创建一个C#项目并集成这个类库。本章的目的是确保开发者能够顺利地在项目中使用 System.Speech 提供的APIs。

3.1 安装与配置 System.Speech 类库

3.1.1 安装类库的方法

System.Speech 类库是Microsoft提供的一个专门用于处理语音的库,它是.NET框架的一部分,因此不需要额外安装。不过,若要使用一些高级功能,如多语言支持,可能需要下载相应的语音引擎。安装这个类库通常通过NuGet包管理器完成,这是.NET开发者最常用的方式。打开Visual Studio,选择“工具”菜单下的“NuGet包管理器”,然后选择“管理解决方案的NuGet包”。在浏览标签页搜索“System.Speech”,然后点击安装。

在安装过程中,NuGet会自动处理所有的依赖关系,并将必要的DLL文件添加到项目的引用中。安装完成后,开发者就可以在项目中直接使用 System.Speech 提供的类了。

3.1.2 配置类库的环境设置

安装完毕后,需要在项目中进行一些基本配置以确保类库能够正常工作。通常,开发者需要在代码文件顶部引入 System.Speech 命名空间:

using System.Speech.Recognition;

using System.Speech.Synthesis;

这行代码允许开发者在后续代码中直接使用 SpeechRecognitionEngine 和 SpeechSynthesizer 等类,而无需完整命名空间路径。通过引用命名空间,开发者可以开始创建语音识别和文本转语音的实例。

3.2 创建C#项目与类库集成

3.2.1 新建C#控制台或窗体应用程序

要开始集成 System.Speech 类库,首先创建一个新的C#项目。在Visual Studio中,选择“创建新项目”,然后选择“控制台应用程序”或“Windows窗体应用程序”作为项目类型。根据个人喜好或项目需求选择合适的项目类型。

创建项目后,项目会自动打开,里面包含一个 Program.cs (控制台应用程序)或一个空的窗体(窗体应用程序)。

3.2.2 引入 System.Speech 类库

接下来,在项目中引入 System.Speech 类库。如之前提到的,使用NuGet包管理器进行安装即可。在项目文件夹下,右键点击“引用”,选择“管理NuGet包”,搜索并安装 System.Speech 包。安装完成之后,就可以在项目中使用 System.Speech 中定义的各种类和方法了。

完成安装和配置后,开发者可以开始编写代码来实现语音识别或文本转语音的功能。下面的章节将深入介绍如何使用 System.Speech 类库提供的API来创建这些功能。

4. 使用 SpeechRecognitionEngine 实现语音识别

4.1 创建语音识别引擎实例

4.1.1 实例化 SpeechRecognitionEngine

SpeechRecognitionEngine 是.NET Framework中用于实现语音识别功能的核心类。通过创建其实例并对其进行配置,我们可以实现将人类语音转换为计算机可以处理的文本信息。

实例化 SpeechRecognitionEngine 通常通过其构造函数来完成,可以传递一个包含文化信息的参数来指定语言环境。比如,在处理中文语音时,我们需要指定语言环境为中文(中国)。

using System.Speech.Recognition;

SpeechRecognitionEngine recognitionEngine = new SpeechRecognitionEngine(new System.Globalization.CultureInfo("zh-CN"));

4.1.2 配置识别引擎的基本属性

在实例化 SpeechRecognitionEngine 后,我们需要对其进行一系列的配置才能使其工作。这包括加载语音识别的语法(Grammar),设置音频输入源以及音频格式等。

加载语法通常需要使用 Choices 类来表示一组可能的识别项,或者使用 GrammarBuilder 来构建更为复杂的语法结构。此外,还需要指定音频流的格式,比如采样率、采样大小、通道数等。

// 使用Choices构建简单的语法,识别“打开”和“关闭”两个命令

Choices commands = new Choices();

commands.Add(new string[] { "打开", "关闭" });

// 构建Grammar

GrammarBuilder gb = new GrammarBuilder(commands);

Grammar grammar = new Grammar(gb);

// 将Grammar加载到识别引擎

recognitionEngine.LoadGrammar(grammar);

// 设置音频输入设备为默认设备

recognitionEngine.SetInputToDefaultAudioDevice();

4.2 实现语音识别功能

4.2.1 选择音频输入设备

在开始识别之前,我们需要选择一个音频输入设备。这可以通过调用 SetInputToDefaultAudioDevice 方法来设置为默认的音频输入设备。当然,如果需要从特定设备进行输入,可以使用 SetInputToAudioDevice 方法,并传入设备的标识。

// 设置为默认音频输入设备

recognitionEngine.SetInputToDefaultAudioDevice();

4.2.2 开始监听和识别

开始监听和识别是通过调用 SpeechRecognitionEngine 的 Recognize 方法来完成的。有同步和异步两种方式:

- 同步方式会阻塞当前线程直到识别结束;

- 异步方式则不会阻塞当前线程,可以在回调函数中处理识别结果。

// 同步识别

recognitionEngine.Recognize();

// 异步识别

recognitionEngine.RecognizeAsync(RecognizeMode.Multiple);

在异步方式中, RecognizeAsync 方法还允许我们选择单次或连续的识别模式。 RecognizeMode.Multiple 表示可以连续识别并返回多个结果。

4.3 语音识别事件处理器与回调机制

4.3.1 自定义事件处理器

为了处理识别过程中的各种事件(如识别成功或失败),我们通常会为 SpeechRecognitionEngine 绑定一个事件处理器。事件处理器可以响应如 RecognizeCompleted 、 AudioSignalProblemOccurred 等事件。

// 创建一个事件处理器

recognitionEngine.RecognizeCompleted += new EventHandler<RecognizeCompletedEventArgs>(RecognitionEngine_RecognizeCompleted);

// 在此方法中处理事件

private static void RecognitionEngine_RecognizeCompleted(object sender, RecognizeCompletedEventArgs e)

{

if (e.Error != null)

{

// 处理识别错误

Console.WriteLine("识别错误: " + e.Error.ToString());

}

else if (e.Result != null)

{

// 处理识别结果

Console.WriteLine("识别结果: " + e.Result.Text);

}

}

4.3.2 处理识别结果和相关事件

事件处理器为识别结果提供了处理逻辑。识别结果通常通过 RecognizeCompletedEventArgs 类来传递。在事件处理器中,可以通过 e.Result 获取到 RecognitionResult 对象,从而访问到识别的文本内容。

// 从RecognitionResult对象获取识别文本

string recognizedText = e.Result.Text;

Console.WriteLine("识别到的文本: " + recognizedText);

这些事件的回调机制使得我们可以在不阻塞主线程的情况下,实时地处理识别结果,并对可能出现的错误进行相应的处理。这对于构建一个响应快速、用户体验良好的语音交互应用程序是至关重要的。

5. 使用 SpeechSynthesizer 实现文本转语音

5.1 创建语音合成器实例

5.1.1 实例化 SpeechSynthesizer

在文本到语音(TTS)的应用中, SpeechSynthesizer 类扮演了至关重要的角色。它负责将文本信息转换为人类可理解的语音信息。创建这个实例是实现TTS功能的第一步。以下是创建 SpeechSynthesizer 实例的示例代码:

using System.Speech.Synthesis;

namespace TextToSpeechDemo

{

class Program

{

static void Main(string[] args)

{

using (SpeechSynthesizer synthesizer = new SpeechSynthesizer())

{

// 在这里配置语音合成器的属性并使用它

}

}

}

}

在这段代码中,我们使用了 using 语句确保 SpeechSynthesizer 实例在使用完毕后能被正确地释放。 SpeechSynthesizer 类有多个构造函数,可以根据需要选择合适的构造函数来实例化。

5.1.2 选择并设置合成引擎的发音人

SpeechSynthesizer 类允许我们选择不同的语音引擎和发音人。默认情况下,系统会使用操作系统的默认语音。如果需要使用特定的语音或语音特性,我们可以使用 SelectVoice 方法或 SelectVoiceByHints 方法来选择。

using (SpeechSynthesizer synthesizer = new SpeechSynthesizer())

{

// 使用SelectVoiceByHints方法选择发音人

// 可以根据需要设置语言、性别、年龄、地域等

synthesizer.SelectVoiceByHints(VoiceGender.Female);

// 或者直接使用SelectVoice方法选择特定的发音人

synthesizer.SelectVoice("Microsoft Zira");

// 接下来执行文本到语音的转换

}

在上面的代码中,我们选择了一个女性发音人来执行文本到语音的转换。需要注意的是,不同的操作系统安装的语言包不同,因此可选的发音人也不同。

5.2 文本转语音功能实现

5.2.1 文本的输入和格式处理

SpeechSynthesizer 类提供了多种方法来实现文本到语音的转换,包括 Speak 和 SpeakAsync 方法。文本可以通过字符串直接输入,也可以通过文件来读取。

using (SpeechSynthesizer synthesizer = new SpeechSynthesizer())

{

synthesizer.SelectVoiceByHints(VoiceGender.Female);

// 使用Speak方法将文本转换为语音

synthesizer.Speak("Hello, World!");

// 使用SpeakAsync方法异步地将文本转换为语音

synthesizer.SpeakAsync("Hello, World!");

}

文本格式的处理也很重要。 SpeechSynthesizer 支持SSML(语音合成标记语言),通过使用SSML,我们可以更细致地控制语音的音调、音量、速度等属性。

5.2.2 执行文本到语音的转换

文本到语音的转换是将字符串或文件中的文本内容转换为语音输出。在C#中,我们通过调用 SpeechSynthesizer 类的 Speak 或 SpeakAsync 方法来实现这一过程。

using (SpeechSynthesizer synthesizer = new SpeechSynthesizer())

{

synthesizer.SelectVoiceByHints(VoiceGender.Female);

// 异步转换长文本,使用SpeakAsync方法

string longText = File.ReadAllText("large_text_file.txt");

synthesizer.SpeakAsync(longText);

}

在上面的代码示例中,我们从一个文件中读取了一段长文本,并使用 SpeakAsync 方法将文本异步地转换为语音。这样可以使程序在进行语音输出的同时执行其他任务。

5.3 调整语音合成器属性

5.3.1 修改语速和音量

SpeechSynthesizer 类提供了调整语速和音量的方法。语速(Rate)和音量(Volume)的调整使得TTS输出能够适应不同的使用场景。

using (SpeechSynthesizer synthesizer = new SpeechSynthesizer())

{

synthesizer.SelectVoiceByHints(VoiceGender.Female);

// 设置语音合成器的语速和音量

synthesizer.Rate = -1; // -10到10的范围

synthesizer.Volume = 100; // 0到100的范围

synthesizer.Speak("Hello, this is an example of adjusting rate and volume.");

}

在上述代码中,我们将语速设置为较慢(-1表示比正常速度慢1个单位),音量设置为最大(100)。合理调整这两个参数,可以使语音输出更加符合用户的听觉习惯。

5.3.2 使用语音合成标记优化输出

SSML提供了丰富的标签来优化TTS的输出。例如,我们可以通过标签来改变特定单词或短语的发音、暂停时间、音调等。

using (SpeechSynthesizer synthesizer = new SpeechSynthesizer())

{

synthesizer.SelectVoiceByHints(VoiceGender.Female);

// 使用SSML标签来优化文本输出

string ssmlText = "<speak version='1.0' xmlns='http://www.w3.org/2001/10/synthesis' xml:lang='en-US'>" +

"<p><s>Slowly</s> <s rate='-2'>speak</s> <break time='500ms'/> this <prosody pitch='high'>text</prosody>.</p>" +

"</speak>";

synthesizer.Speak(ssmlText);

}

在这个例子中,我们使用了SSML来控制文本的发音速度、暂停时间以及音调。通过这种方式,我们可以使TTS输出更接近于自然语言的说话方式。

在本章节中,我们详细介绍了如何在C#中使用 SpeechSynthesizer 类来实现文本转语音的功能。通过实例化语音合成器,选择合适的发音人,处理文本输入,以及调整语音属性等步骤,可以有效地实现高质量的TTS输出。接下来的章节将进一步通过代码示例和操作实践来展示如何将语音识别与文本转语音功能结合起来,实现更加复杂的语音交互应用。

6. 代码示例和操作实践

6.1 集成语音识别和文本转语音的综合示例

6.1.1 简单的语音识别到文本转语音的流程

在这里,我们将展示一个简单的示例,它整合了语音识别(Speech Recognition)和文本转语音(Text-to-Speech, TTS)的过程。这个流程会从用户的语音输入中识别文字,然后使用 SpeechSynthesizer 将识别到的文字转换成语音输出。

using System;

using System.Speech.Recognition;

using System.Speech.Synthesis;

using System.Threading;

class Program

{

static void Main()

{

// 初始化语音识别引擎

using (SpeechRecognitionEngine recognizer = new SpeechRecognitionEngine())

{

// 加载预定义的语音识别配置

recognizer.SetInputToDefaultAudioDevice();

// 识别时调用的方法

recognizer.SpeechRecognized += Recognizer_SpeechRecognized;

// 开始连续语音识别

recognizer.RecognizeAsync(RecognizeMode.Multiple);

Console.WriteLine("Please speak now...");

Console.ReadLine(); // 按任意键退出程序

}

// 初始化语音合成器

using (SpeechSynthesizer synth = new SpeechSynthesizer())

{

// 设置语音合成器的发音人

synth.SelectVoice("Microsoft Zira Desktop");

// 待转换为语音的文本

string textToSpeak = "You said: ";

// 等待用户输入

Console.WriteLine("Press Enter to continue...");

Console.ReadLine();

// 检查是否通过语音识别得到了文本

if (Program.recognizedText != null)

{

// 输出识别到的文本

Console.WriteLine(textToSpeak + Program.recognizedText);

// 将文本转换成语音并播放

synth.Speak(textToSpeak + Program.recognizedText);

}

}

}

private static string recognizedText = null;

private static void Recognizer_SpeechRecognized(object sender, SpeechRecognizedEventArgs e)

{

if (e.Result.Confidence > 0.5) // 可接受的置信度阈值

{

recognizedText = e.Result.Text;

Console.WriteLine("You said: " + recognizedText);

}

else

{

recognizedText = null;

Console.WriteLine("Could not understand speech.");

}

}

}

6.1.2 实践中遇到的常见问题及解决方法

在实际使用过程中,开发者可能会遇到以下常见问题:

- 问题 1 : 语音识别无法正确识别语音。

-

解决方法 : 确保麦克风工作正常,并调整

SpeechRecognitionEngine中的识别器设置,如ResultConfidence属性来过滤低置信度的结果。 -

问题 2 : 文本转语音的输出听起来不自然。

-

解决方法 : 尝试更换不同的

VoiceInfo,找到更适合的发音人,并且调整SpeechSynthesizer的语速和音量属性来获得更自然的输出。 -

问题 3 : 应用在长时间运行后出现性能问题。

- 解决方法 : 对于长时间运行的应用,考虑使用

RecognizeOnceAsync代替RecognizeAsync(RecognizeMode.Multiple)来减少资源消耗,并且定期重新初始化语音识别引擎和语音合成器来保持性能。

6.2 进阶应用与优化

6.2.1 复杂场景下的语音处理策略

在处理复杂场景下的语音应用时,如多语言支持、特定领域的词汇识别等,可以采取以下策略:

- 使用

Grammar对象来定义词汇和语法规则,提高识别准确性。 - 采用

DictationGrammar实现动态词典的支持,这对于专业术语和地名等的识别特别有用。 - 应用

SemanticResultValue对识别结果进行更深层次的语义分析,以便于更好地理解用户的意图。

6.2.2 性能优化和多语言支持

优化语音识别和文本转语音性能的关键在于合理配置和适时的资源管理:

- 调整

SpeechSynthesizer的Rate和Volume属性来优化播放的语速和音量。 - 使用异步调用方法

RecognizeAsync和SpeakAsync来避免阻塞主线程,从而改善用户体验。 - 对于多语言支持,开发者可以加载

SpeechLib中的相应语言包,并通过InstallOption指定安装路径。

通过上述策略和优化,可以有效地提升语音应用的性能和用户体验。在后续的章节中,我们将进一步探讨如何结合实际案例对这些策略和优化进行更加深入的分析和实践。

简介:本教程详细介绍了如何使用微软的Speech API(SAPI)在C#中实现语音识别和文本到语音的转换功能。通过引用.NET Framework中的 System.Speech 类库,创建 SpeechRecognitionEngine 和 SpeechSynthesizer 对象,设置相关属性和事件处理器,开发者可以轻松集成语音识别和语音合成功能到他们的应用程序中。教程还提供了代码示例和实践操作,帮助开发者掌握SAPI的应用,并通过调整语音合成器的属性来实现更丰富的语音交互效果。

更多推荐

已为社区贡献162条内容

已为社区贡献162条内容

所有评论(0)