STEP3-VL-10B部署案例:CSDN算力平台WebUI一键访问+Supervisor服务管理详解

本文介绍了如何在星图GPU平台上自动化部署STEP3-VL-10B多模态视觉语言模型(阶跃星辰)。该平台简化了部署流程,用户可通过WebUI一键访问,轻松实现图片内容理解与分析,例如上传图片并获取详细描述,适用于教育辅助、内容审核等场景。

STEP3-VL-10B部署案例:CSDN算力平台WebUI一键访问+Supervisor服务管理详解

1. 引言:为什么选择STEP3-VL-10B?

如果你正在寻找一个既强大又轻便的多模态AI模型,那么STEP3-VL-10B绝对值得你花时间了解。这个由阶跃星辰开源的10B参数模型,在保持相对较小体积的同时,实现了令人惊讶的视觉理解和推理能力。

简单来说,它就像一个“小而精”的AI助手,能看懂图片、理解图表、解答数学问题,甚至能识别文档中的文字。最吸引人的是,它的表现可以媲美那些参数量大10-20倍的模型,这意味着你不需要昂贵的硬件就能获得接近顶级模型的效果。

在CSDN算力平台上,这个模型的部署变得异常简单。平台已经为你准备好了完整的运行环境,你只需要点击几下,就能通过Web界面直接使用,或者通过API调用来集成到自己的应用中。更贴心的是,平台用Supervisor服务管理工具帮你自动管理模型服务,让你能专注于使用模型,而不是折腾部署。

接下来,我会带你一步步了解如何在CSDN算力平台上部署和使用STEP3-VL-10B,重点讲解WebUI的一键访问和Supervisor服务管理的实用技巧。

2. STEP3-VL-10B核心能力速览

在深入部署细节之前,我们先快速了解一下这个模型到底能做什么。知道它的能力边界,你才能更好地决定是否适合你的需求。

2.1 模型基本信息

STEP3-VL-10B是一个拥有100亿参数的多模态视觉语言模型。虽然参数规模不算最大,但它在多个专业测试中表现突出:

- 视觉推理能力强:不仅能识别图片中的物体,还能理解图片背后的逻辑关系

- 数学视觉处理:可以看懂数学公式、图表,并给出解题思路

- 文档OCR识别:对扫描文档、截图中的文字识别准确率高

- 界面元素理解:能识别软件界面、网页布局中的各种元素

2.2 性能表现对比

为了让概念更具体,我们看看它在几个关键测试中的表现:

| 测试项目 | STEP3-VL-10B得分 | 对比说明 |

|---|---|---|

| STEM推理(MMMU) | 78.11 | 在科学、技术、工程、数学领域的推理能力,达到10B模型中的最优水平 |

| 数学视觉(MathVista) | 83.97 | 处理数学图表和问题的能力,接近更大规模模型的表现 |

| 视觉识别(MMBench) | 92.05 | 通用视觉理解能力出色,能准确识别各种场景和物体 |

| 文档OCR(OCRBench) | 86.75 | 文档文字识别准确率高,适合处理扫描件和截图 |

| 界面定位(ScreenSpot) | 92.61 | 识别软件界面元素的能力强,适合自动化测试等场景 |

这些数据告诉我们,STEP3-VL-10B虽然体积相对较小,但在特定任务上的表现可以媲美甚至超过那些参数量大得多的模型。

2.3 硬件要求友好

对于个人开发者或中小团队来说,硬件成本是个重要考虑因素。STEP3-VL-10B的要求相对亲民:

- 最低配置:NVIDIA显卡,24GB显存(如RTX 4090),32GB内存

- 推荐配置:A100 40GB/80GB,64GB以上内存

- 系统要求:支持CUDA 12.x,推荐12.4及以上版本

在CSDN算力平台上,这些硬件配置都已经为你准备好了,你不需要自己购买昂贵的显卡,按需租用即可。

3. CSDN算力平台一键部署实战

现在进入实战环节。在CSDN算力平台上部署STEP3-VL-10B,整个过程比你想的要简单得多。

3.1 环境准备与镜像选择

首先,你需要登录CSDN算力平台。如果你还没有账号,注册过程很简单,跟着提示操作就行。

登录后,进入算力服务器管理页面。这里的关键是选择正确的镜像。CSDN平台已经为STEP3-VL-10B准备了专门的镜像,里面包含了:

- 预装好的Python环境

- 必要的深度学习框架(PyTorch等)

- STEP3-VL-10B模型文件

- 配置好的WebUI界面

- Supervisor服务管理工具

你不需要手动安装任何东西,平台都帮你搞定了。选择镜像后,根据你的需求配置服务器规格(CPU、内存、GPU等),然后启动服务器。

3.2 WebUI一键访问详解

服务器启动后,最方便的使用方式就是通过WebUI界面。这里有个很贴心的设计:平台用Supervisor自动启动了WebUI服务,你不需要手动运行任何命令。

访问WebUI的步骤:

- 在算力服务器管理页面,找到你刚启动的服务器

- 在右侧导航栏中,你会看到一个“快速访问”或类似的功能区域

- 找到标有“WebUI”或“7860端口”的访问链接

- 点击链接,浏览器会自动打开WebUI界面

点击后打开的地址类似这样:

https://gpu-pod699d9da7a426640397bd2855-7860.web.gpu.csdn.net/

注意:每台服务器的地址都不同,上面只是示例,你的实际地址会在平台页面上显示。

打开后的界面长这样:

3.3 WebUI功能体验

进入WebUI界面后,你会发现它设计得很直观,主要功能区域包括:

- 图片上传区域:可以拖拽或点击上传图片

- 对话输入框:在这里输入你的问题或指令

- 历史对话记录:保存之前的对话内容

- 模型设置选项:可以调整一些生成参数

基本使用流程:

- 上传一张图片(支持JPG、PNG等常见格式)

- 在输入框中输入你的问题,比如“描述这张图片的内容”

- 点击发送,等待模型生成回答

- 查看结果,如果需要可以继续追问

这个界面特别适合快速测试模型能力,或者进行一些简单的图片分析任务。不需要写代码,像使用普通聊天软件一样操作就行。

4. Supervisor服务管理深度解析

Supervisor是CSDN平台用来管理模型服务的神器。它让服务管理变得像开关灯一样简单。下面我详细解释一下它的用法。

4.1 Supervisor是什么?

简单来说,Supervisor是一个进程管理工具。它帮你:

- 自动启动服务(比如我们的WebUI)

- 监控服务运行状态

- 在服务异常退出时自动重启

- 提供统一的管理命令接口

在STEP3-VL-10B的镜像中,Supervisor已经配置好了WebUI服务。这意味着你启动服务器后,WebUI服务会自动运行,不需要你手动干预。

4.2 常用管理命令

虽然服务是自动运行的,但有时候你可能需要手动管理。以下是几个最常用的命令:

查看服务状态

supervisorctl status

这个命令会显示所有由Supervisor管理的服务状态。对于STEP3-VL-10B,你通常会看到一个名为webui的服务,状态应该是RUNNING。

停止WebUI服务

supervisorctl stop webui

如果你暂时不需要使用WebUI,或者想释放一些资源,可以用这个命令停止服务。

停止所有服务

supervisorctl stop all

这个命令会停止Supervisor管理的所有服务。慎用,除非你确定要停止所有服务。

启动WebUI服务

supervisorctl start webui

如果服务被停止了,用这个命令重新启动。

重启WebUI服务

supervisorctl restart webui

如果你修改了配置,或者服务出现异常,可以用这个命令重启服务。

4.3 自定义端口配置

默认情况下,WebUI服务运行在7860端口。如果你需要改用其他端口,可以修改启动脚本。

找到启动脚本

/usr/local/bin/start-webui-service.sh

修改端口号 打开这个文件,你会看到类似下面的内容:

source /Step3-VL-10B/venv/bin/activate

echo "Starting Step3-VL-10B webui service..."

exec python /root/Step3-VL-10B/webui.py \

--host 0.0.0.0 \

--port 7860

把--port 7860中的7860改成你想要的端口号,比如--port 8888。

重启服务生效 修改后,需要重启服务才能生效:

supervisorctl restart webui

注意:修改端口后,访问地址也会相应变化。在CSDN平台页面上,可能需要刷新或重新获取访问链接。

4.4 手动启动WebUI(备用方案)

虽然Supervisor自动管理很方便,但了解手动启动方法也有必要,特别是在调试或特殊情况下。

手动启动步骤:

# 进入模型目录

cd ~/Step3-VL-10B

# 激活Python虚拟环境

source /Step3-VL-10B/venv/bin/activate

# 启动WebUI服务

python3 webui.py --host 0.0.0.0 --port 7860

手动启动时,终端会显示详细的运行日志,方便你查看运行状态和调试问题。不过,手动启动的服务在终端关闭后就会停止,不如Supervisor管理的服务稳定。

5. API服务调用指南

除了WebUI界面,STEP3-VL-10B还提供了OpenAI兼容的API接口。这意味着你可以像调用ChatGPT API一样调用这个模型,方便集成到自己的应用中。

5.1 基础API调用

API服务默认和WebUI运行在同一个地址。假设你的WebUI地址是:

https://gpu-pod699d9da7a426640397bd2855-7860.web.gpu.csdn.net

那么API端点就是:

https://gpu-pod699d9da7a426640397bd2855-7860.web.gpu.csdn.net/api/v1/chat/completions

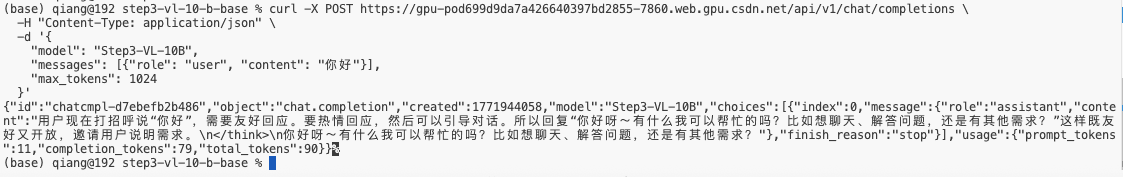

纯文本对话示例:

curl -X POST https://gpu-pod699d9da7a426640397bd2855-7860.web.gpu.csdn.net/api/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Step3-VL-10B",

"messages": [{"role": "user", "content": "你好"}],

"max_tokens": 1024

}'

这个调用会返回一个JSON格式的响应,包含模型生成的回答。

5.2 多模态API调用(图片+文本)

STEP3-VL-10B的真正强大之处在于多模态能力。你可以通过API同时发送图片和文字。

图片理解示例:

curl -X POST http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Step3-VL-10B",

"messages": [

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {

"url": "https://huggingface.co/datasets/huggingface/documentation-images/resolve/main/bee.jpg"

}

},

{

"type": "text",

"text": "描述这张图片"

}

]

}

],

"max_tokens": 1024

}'

这个调用做了两件事:

- 通过URL引用了一张图片(一只蜜蜂的图片)

- 请求模型描述这张图片

模型会分析图片内容,然后生成文字描述。

5.3 本地图片处理

上面的例子使用了网络图片URL。如果你要处理本地图片,需要先上传到服务器,或者将图片转换为base64编码。

base64图片示例:

curl -X POST http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Step3-VL-10B",

"messages": [

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {

"url": "data:image/jpeg;base64,/9j/4AAQSkZJRgABAQAAAQABAAD/2wBDAAgGBgcGBQgHBwcJCQgKDBQNDAsLDBkSEw8UHRofHh0aHBwgJC4nICIsIxwcKDcpLDAxNDQ0Hyc5PTgyPC4zNDL/2wBDAQkJCQwLDBgNDRgyIRwhMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjIyMjL/wAARC..."

}

},

{

"type": "text",

"text": "这张图片里有什么?"

}

]

}

],

"max_tokens": 1024

}'

注意:base64字符串很长,上面只是示意,实际使用时需要完整的base64编码。

5.4 编程语言调用示例

在实际开发中,你更可能用Python、JavaScript等编程语言调用API。下面是一个Python示例:

import requests

import json

# API端点

api_url = "https://gpu-pod699d9da7a426640397bd2855-7860.web.gpu.csdn.net/api/v1/chat/completions"

# 请求头

headers = {

"Content-Type": "application/json"

}

# 请求数据

data = {

"model": "Step3-VL-10B",

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "用简单的语言解释什么是机器学习"

}

]

}

],

"max_tokens": 500

}

# 发送请求

response = requests.post(api_url, headers=headers, data=json.dumps(data))

# 解析响应

if response.status_code == 200:

result = response.json()

answer = result['choices'][0]['message']['content']

print("模型回答:", answer)

else:

print("请求失败:", response.status_code, response.text)

这个Python脚本展示了如何用requests库调用STEP3-VL-10B的API。你可以根据需要修改messages内容,实现不同的功能。

6. 实用技巧与问题排查

在实际使用中,你可能会遇到一些小问题。这里我总结了一些实用技巧和常见问题的解决方法。

6.1 性能优化建议

批量处理图片 如果你需要处理大量图片,建议使用API批量调用,而不是通过WebUI一张张上传。这样可以减少网络开销,提高处理效率。

合理设置max_tokens max_tokens参数控制生成文本的最大长度。设置太小可能导致回答不完整,设置太大会增加生成时间。根据任务需求合理设置:

- 简单问答:100-300 tokens

- 详细描述:500-1000 tokens

- 复杂分析:1000-2000 tokens

使用缓存 如果频繁调用相同的图片分析,可以考虑在客户端实现缓存机制,避免重复调用。

6.2 常见问题与解决

问题1:WebUI无法访问

- 检查服务状态:

supervisorctl status - 如果服务停止,启动它:

supervisorctl start webui - 检查端口是否被占用,可以尝试修改端口号

问题2:API调用返回错误

- 检查API地址是否正确

- 确认请求格式符合OpenAI API规范

- 查看服务器日志:

tail -f /var/log/supervisor/webui-stderr*.log

问题3:图片处理速度慢

- 确认图片大小适中,过大的图片可以先压缩

- 检查服务器资源使用情况,确保GPU内存充足

- 考虑使用更低的分辨率或质量设置

问题4:模型回答不准确

- 尝试更清晰的图片

- 提供更具体的指令

- 调整temperature参数(如果API支持)

6.3 日志查看方法

了解如何查看日志对问题排查很重要。STEP3-VL-10B的日志主要通过Supervisor管理:

查看WebUI服务日志

# 标准输出日志

tail -f /var/log/supervisor/webui-stdout*.log

# 错误日志

tail -f /var/log/supervisor/webui-stderr*.log

查看Supervisor自身日志

tail -f /var/log/supervisor/supervisord.log

日志中会记录服务的启动信息、运行状态、错误详情等,是排查问题的第一手资料。

7. 总结与下一步建议

通过上面的介绍,你应该对在CSDN算力平台上部署和使用STEP3-VL-10B有了全面的了解。让我们回顾一下关键点:

7.1 核心优势总结

- 部署简单:CSDN平台提供了一键部署的镜像,省去了复杂的环境配置

- 访问方便:WebUI界面直观易用,适合快速测试和简单任务

- 管理省心:Supervisor自动管理服务,确保稳定运行

- 集成灵活:OpenAI兼容API方便集成到各种应用中

- 性价比高:10B参数模型在多个任务上媲美更大模型,硬件要求相对友好

7.2 适用场景建议

根据我的使用经验,STEP3-VL-10B特别适合以下场景:

- 教育辅助:解释图表、解答数学问题、分析科学图片

- 内容审核:识别图片中的敏感内容、检查文档合规性

- 智能客服:处理用户上传的图片问题,提供视觉支持

- 数据分析:从图表中提取信息,生成分析报告

- 创意辅助:根据图片生成描述、标题或故事

7.3 下一步学习建议

如果你已经成功部署并体验了STEP3-VL-10B,我建议你可以:

- 深入探索API功能:尝试更复杂的多模态任务,比如多图分析、连续对话等

- 集成到实际项目:将模型API集成到你的网站、应用或工作流程中

- 性能调优实验:测试不同参数设置对生成质量和速度的影响

- 探索其他模型:CSDN平台还有更多AI镜像,可以尝试不同模型的特点

最重要的是动手实践。只有实际使用,你才能真正理解模型的优势和局限,找到最适合你的使用方式。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献144条内容

已为社区贡献144条内容

所有评论(0)