Qwen3-32B部署教程:Clawdbot镜像免配置启动+8080端口代理调试详解

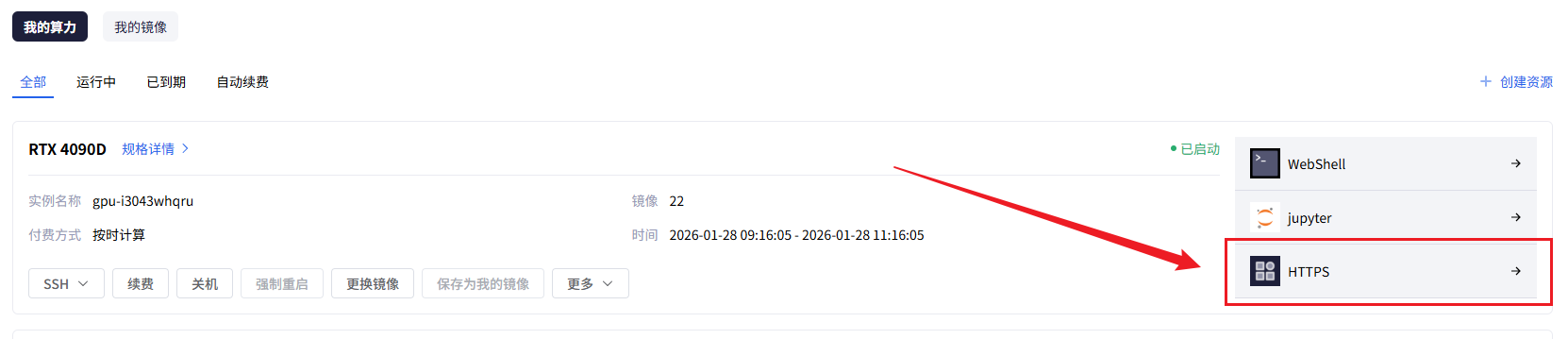

本文介绍了如何在星图GPU平台自动化部署Clawdbot整合Qwen3:32B代理直连Web网关配置Chat平台镜像,实现免配置快速启动。该镜像通过内置端口转发机制,提供开箱即用的AI对话服务,适用于智能客服、知识问答等文本生成场景,显著提升大模型部署效率。

Qwen3-32B部署教程:Clawdbot镜像免配置启动+8080端口代理调试详解

本文介绍如何快速部署Qwen3-32B大模型,通过Clawdbot镜像实现免配置启动,并详细讲解8080端口代理调试方法,让您10分钟内完成私有化部署。

1. 项目概述与价值

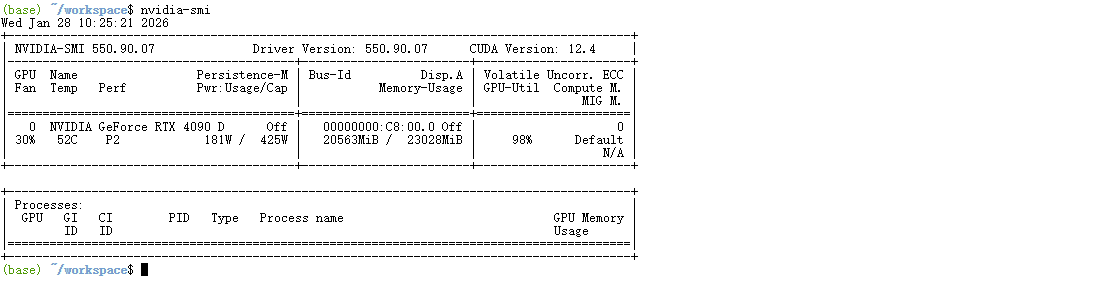

Qwen3-32B是阿里云推出的大规模语言模型,具有320亿参数,在多项基准测试中表现出色。但在实际部署中,很多开发者会遇到环境配置复杂、端口转发困难等问题。

Clawdbot镜像整合了Qwen3-32B模型和Ollama API接口,提供了开箱即用的解决方案。通过内部代理机制,将8080端口转发到18789网关,大大简化了部署流程。

本教程的核心价值:

- 免去复杂的环境配置,一键启动

- 内置端口转发,无需手动设置代理

- 完整的Web界面,直接对话测试

- 适合本地开发和生产环境部署

2. 环境准备与快速部署

2.1 系统要求

在开始部署前,请确保您的系统满足以下要求:

- 操作系统:Ubuntu 20.04+ / CentOS 7+ / Windows WSL2

- 内存:至少64GB RAM(32B模型需要较大内存)

- 存储:100GB可用磁盘空间

- 网络:能够访问Docker Hub和模型下载源

2.2 一键部署步骤

通过Docker快速部署Clawdbot镜像:

# 拉取最新镜像

docker pull clawdbot/qwen3-32b:latest

# 运行容器(自动配置端口转发)

docker run -d \

--name qwen3-32b \

-p 8080:8080 \

-p 18789:18789 \

--restart unless-stopped \

clawdbot/qwen3-32b:latest

参数说明:

-p 8080:8080:将容器内8080端口映射到主机,用于Web访问-p 18789:18789:模型服务端口,用于API调用--restart unless-stopped:容器自动重启,确保服务持续运行

部署完成后,通过以下命令检查服务状态:

# 查看容器运行状态

docker ps

# 查看服务日志

docker logs qwen3-32b

如果看到"Server started successfully"的提示,说明部署成功。

3. 核心功能与配置详解

3.1 内部架构说明

Clawdbot镜像采用了智能的代理架构:

用户请求 → 8080端口 → 内部代理 → 18789网关 → Ollama API → Qwen3-32B模型

这种设计让外部访问统一通过8080端口,内部自动转发到正确的服务端口,简化了配置复杂度。

3.2 Web界面使用

部署完成后,打开浏览器访问 http://localhost:8080,即可看到聊天界面:

界面功能特点:

- 简洁的对话界面,支持多轮对话

- 实时显示生成进度和速度

- 支持对话历史保存和加载

- 可调整生成参数(温度、最大长度等)

3.3 API接口调用

除了Web界面,您也可以通过API直接调用模型:

import requests

import json

# API端点配置

api_url = "http://localhost:8080/api/chat"

# 请求参数

payload = {

"model": "qwen3-32b",

"messages": [

{"role": "user", "content": "请介绍一下人工智能的发展历史"}

],

"temperature": 0.7,

"max_tokens": 1000

}

# 发送请求

headers = {"Content-Type": "application/json"}

response = requests.post(api_url, json=payload, headers=headers)

# 处理响应

if response.status_code == 200:

result = response.json()

print(result['choices'][0]['message']['content'])

else:

print(f"请求失败: {response.status_code}")

4. 代理配置与端口转发

4.1 内部代理机制

Clawdbot镜像内置了智能代理服务,自动处理端口转发:

代理工作流程:

- 外部请求到达8080端口

- 代理服务接收并验证请求

- 转发到内部的18789端口(Ollama API)

- 获取响应后返回给客户端

4.2 自定义端口配置

如果需要使用其他端口,可以通过环境变量自定义:

docker run -d \

--name qwen3-32b \

-p 9090:8080 \ # 将外部访问端口改为9090

-p 18790:18789 \ # 修改内部服务端口映射

-e EXTERNAL_PORT=9090 \

-e INTERNAL_PORT=18790 \

clawdbot/qwen3-32b:latest

常用环境变量:

EXTERNAL_PORT:外部访问端口(默认8080)INTERNAL_PORT:内部服务端口(默认18789)API_TIMEOUT:API调用超时时间(默认30秒)

5. 常见问题与解决方法

5.1 端口冲突问题

如果8080端口已被占用,会出现启动失败:

# 查看端口占用情况

netstat -tulnp | grep 8080

# 停止占用端口的进程或修改映射端口

docker run -d -p 8081:8080 ... # 使用其他端口

5.2 内存不足处理

Qwen3-32B需要较大内存,如果出现OOM错误:

# 增加Docker内存限制

docker run -d \

--memory=64g \ # 分配64GB内存

--memory-swap=128g \ # 设置交换空间

clawdbot/qwen3-32b:latest

# 或者使用资源限制更宽松的部署方式

5.3 模型加载失败

如果模型下载或加载失败,可以手动检查:

# 进入容器内部

docker exec -it qwen3-32b bash

# 检查模型文件

ls -lh /app/models/

# 查看服务日志

tail -f /var/log/ollama.log

6. 进阶使用与优化建议

6.1 性能优化配置

对于生产环境,建议进行以下优化:

# 使用GPU加速(如果可用)

docker run -d \

--gpus all \

-p 8080:8080 \

clawdbot/qwen3-32b:latest

# 调整线程数和工作进程

-e OMP_NUM_THREADS=8 \

-e NUM_WORKERS=4 \

6.2 监控与日志

建立监控体系以便及时发现问题和优化性能:

# 查看实时日志

docker logs -f qwen3-32b

# 监控资源使用情况

docker stats qwen3-32b

# 设置日志轮转(在宿主机上)

docker run -d \

--log-driver=json-file \

--log-opt max-size=100m \

--log-opt max-file=3 \

clawdbot/qwen3-32b:latest

6.3 安全加固建议

在公网部署时,务必加强安全防护:

# 使用HTTPS加密

# 建议在前端配置Nginx反向代理并添加SSL证书

# 添加访问认证

docker run -d \

-e API_KEY=your_secret_key \

clawdbot/qwen3-32b:latest

# 限制访问IP(通过防火墙或安全组)

7. 总结

通过本教程,您已经学会了如何使用Clawdbot镜像快速部署Qwen3-32B大模型。这种部署方式的主要优势在于:

核心价值总结:

- 🚀 快速部署:10分钟内完成从下载到可用的全过程

- 🔧 免配置:内置代理机制,自动处理端口转发和API对接

- 🌐 开箱即用:提供完整的Web界面和API接口

- 📊 易于调试:清晰的日志和监控,方便问题排查

适用场景:

- 个人学习和实验

- 团队内部知识管理助手

- 产品原型开发和演示

- 中小规模的生产应用

下一步建议:

- 尝试不同的提示词技巧,挖掘模型潜力

- 集成到您的现有系统中(如客服系统、知识库)

- 监控性能指标,根据实际使用情况优化资源配置

- 关注模型更新,及时升级到新版本

现在就开始您的Qwen3-32B之旅吧!如果有任何问题,欢迎在评论区交流讨论。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献169条内容

已为社区贡献169条内容

所有评论(0)