快速构建图像识别训练集工具包

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库。它提供了大量的图像处理和分析功能,广泛应用于实时图像处理领域。OpenCV支持多种编程语言,其中以Python接口最为人熟知和使用。OpenCV的基本功能涵盖但不限于以下几点:图像读写:快速加载和保存各种格式的图像文件。基本图像处理:包括图像滤波、边缘检测、几何变换等。高级

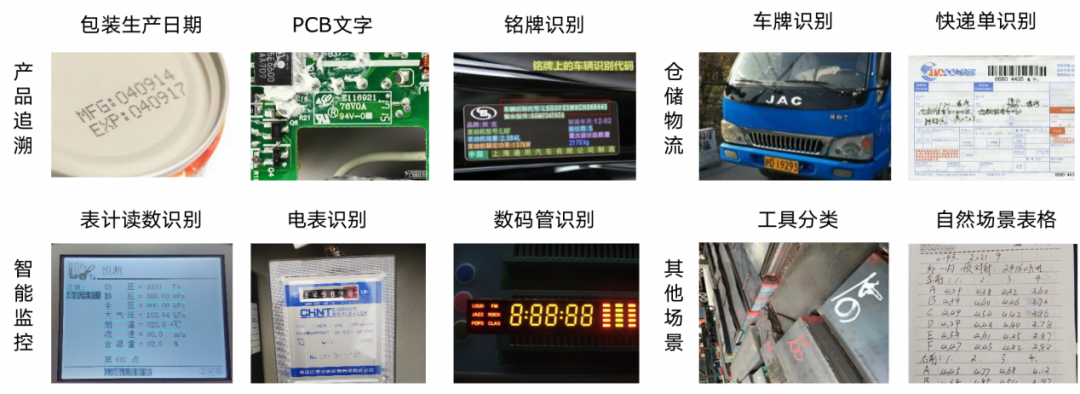

简介:在图像识别领域,构建一个高效的训练集是至关重要的,它包括大量正样本和负样本图片。正样本含有特定目标,负样本则不含有。手工制作训练集的过程繁琐,但可以通过批量处理工具如OpenCV或PIL自动化,提高效率。"批量手工截取正负样本图片,制作训练集"的工具包提供了一系列程序,帮助用户自定义参数如图像大小、样本数量,应用数据增强技术和类别平衡,从而有效地创建训练集。

1. 图像识别训练集的重要性

在当今这个信息化快速发展的时代,图像识别技术在多个领域发挥着日益重要的作用,如医疗诊断、自动驾驶、监控安全、内容审查等。训练集,作为图像识别模型训练的基础材料,对模型的性能和准确性起到决定性作用。

训练集的重要性首先体现在其质量上。高质量的训练集能够更好地覆盖目标场景中的各种变体,从而使得模型能够在真实环境下具备更好的泛化能力。此外,训练集的规模也直接影响模型的学习效果;较大的训练集能提供更丰富的样本信息,有助于模型捕捉到更多特征,减少过拟合的风险。

因此,理解并确保训练集的质量与多样性,是构建高效图像识别模型的前提和基础。本章将对训练集的重要作用展开讨论,从基础概念入手,深入分析如何优化和提升训练集的构建过程。

2. 正样本与负样本的界定

2.1 样本的概念与分类

在图像识别的训练集中,区分正样本与负样本是至关重要的。正样本是指能够正确反映我们训练模型目标特征的图像,即模型应识别为正类的图像。而负样本,则是不包含目标特征或与目标特征相反的图像,模型应将其识别为负类。

2.1.1 正样本的特征和识别

正样本的特征需要通过详细分析目标的特性来确定。例如,在进行猫的图像识别训练时,正样本应包含各种姿势、表情和环境下的猫的图片。识别正样本的关键在于图像清晰、目标特征明显,并且符合训练模型的定义标准。

graph TD;

A[开始] --> B[图像获取];

B --> C[图像预处理];

C --> D[特征分析];

D --> E[确定正样本特征];

E --> F[正样本识别]

在代码实现上,可以通过以下伪代码来对正样本进行识别:

def is_positive_sample(image_path, feature_threshold):

image = load_image(image_path)

processed_image = preprocess_image(image)

features = analyze_features(processed_image)

if features > feature_threshold:

return True

else:

return False

# 使用函数

sample_path = 'path_to_sample_image.jpg'

if is_positive_sample(sample_path, 0.8):

print("这是一个正样本")

else:

print("这不是一个正样本")

在参数说明中, feature_threshold 是一个阈值参数,用来决定一个图像的特征强度是否足以被分类为正样本。

2.1.2 负样本的特征和识别

与正样本相反,负样本是不包含目标特征或含有错误特征的图像。在图像识别任务中,负样本的选取同样重要,因为它帮助模型区分目标和非目标。例如,在猫的图像识别任务中,狗的图像、无动物的自然风景,或者带有猫的图像但是被严重遮挡的都可作为负样本。

2.2 样本选择的原则

在选择正样本和负样本时,应遵循一定的原则以保证数据集的质量和多样性。

2.2.1 样本多样性的考量

为了提高模型的泛化能力,样本应具有足够的多样性。多样性意味着样本应涵盖不同的视角、光照条件、遮挡情况和背景干扰。以下是一个样本多样性的评估表格:

| 样本特征 | 描述 | 示例 | |----------|------------------------|---------------------------| | 光照条件 | 不同的光照和阴影条件 | 日光、阴天、夜晚、背光 | | 视角变换 | 目标对象的不同观察角度 | 正面、侧面、斜视、俯视、仰视 | | 遮挡情况 | 目标被部分遮挡的情况 | 部分遮挡、重度遮挡、无遮挡 | | 背景干扰 | 不同复杂度的背景 | 简单背景、复杂背景、相似干扰物 |

2.2.2 样本量与模型性能的关系

样本量的大小直接影响到模型的训练效果。通常情况下,样本量越大,模型性能越好,泛化能力越强。然而,也要考虑到样本的代表性,以免过度拟合。样本量的选择应遵循以下原则:

- 确保正负样本比例合理,以避免模型偏向某一类别。

- 利用交叉验证等技术评估不同样本量对模型性能的影响。

- 增加样本多样性和质量,而非单纯追求数量。

在实际操作中,可以使用类似下面的表格来记录和分析样本量与模型性能的关系:

| 样本数量 | 正样本量 | 负样本量 | 模型准确率 | 过拟合情况 | |--------|--------|--------|---------|---------| | 100 | 50 | 50 | 80% | 无 | | 500 | 250 | 250 | 85% | 轻微 | | 1000 | 500 | 500 | 88% | 无 | | 5000 | 2500 | 2500 | 90% | 无 |

通过表格的数据分析,可以合理控制样本量,提高模型训练效果。

3. 手工截取图像的耗时过程

在图像识别的训练集中,准确的手工截取图像步骤是至关重要的。本章将深入探讨为什么需要手工截取图像,以及如何高效、准确地完成这一过程。我们还会讨论在截取过程中可能会遇到的问题,并提供相应的解决策略。

3.1 手工截取的必要性

3.1.1 为何需要手工截取

手工截取图像的目的在于从原始图像中提取出清晰、准确的样本,以供训练集使用。原始图像往往包含大量不相关的背景信息,这些信息会对图像识别模型的训练产生干扰,导致识别准确性下降。通过手工截取,可以确保每个样本都具有高相关性,并符合后续图像处理和识别任务的需求。

3.1.2 手工截取的准确性要求

手工截取的准确性直接影响到模型的训练效果。如果截取过程中出现偏差,如边缘切割不完整或包含多余背景,将导致模型在识别时产生误差。因此,在截取图像时,要求操作者具备高度的专注度和细致的观察力,确保每个样本都是以最高标准选取的。

3.2 手工截取的技巧与注意事项

3.2.1 使用图像处理软件的技巧

使用图像处理软件进行手工截取时,一些高级功能如网格线、放大镜和多图层编辑,可以显著提高效率。网格线能够帮助操作者更精确地定位图像边缘,而多图层编辑则可以在不影响原图的情况下,对截取区域进行细微调整。以下是一个使用Photoshop进行图像截取的示例代码块:

import cv2

def crop_image(image_path, output_path, coordinates):

"""

Crop image using coordinates.

Parameters:

image_path : str

The path to the original image.

output_path : str

The path where the cropped image will be saved.

coordinates : tuple

A tuple of coordinates (x, y, width, height) specifying the region to crop.

"""

image = cv2.imread(image_path)

cropped_image = image(coordinates[1]:(coordinates[1] + coordinates[3]),

coordinates[0]:(coordinates[0] + coordinates[2]))

cv2.imwrite(output_path, cropped_image)

# Example usage:

crop_image("path/to/original/image.jpg", "path/to/cropped/image.jpg", (100, 100, 200, 200))

3.2.2 截取过程中的常见问题及解决方法

在手工截取图像的过程中,常见的问题包括:图像失真、选取区域不准确、效率低下等。为了避免图像失真,应该使用无损格式保存和传输图像。选取区域不准确时,可以使用图像处理软件的辅助工具,如标尺和对齐线来辅助定位。效率问题可以通过编写宏或使用脚本来自动化重复的截取步骤,减少手动操作。

在接下来的章节中,我们将探讨如何使用批量处理工具来提高这一过程的效率和准确性。

4. 批量处理工具的应用

批量处理工具在图像识别领域扮演着至关重要的角色,尤其在处理大规模训练集时,它们能够显著提升工作效率,减少重复劳动。本章将详细介绍两个流行的图像处理库:OpenCV和Python Imaging Library(PIL),以及如何利用它们来实现批量处理的脚本。

4.1 OpenCV与PIL工具介绍

4.1.1 OpenCV的基本功能和应用

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库。它提供了大量的图像处理和分析功能,广泛应用于实时图像处理领域。OpenCV支持多种编程语言,其中以Python接口最为人熟知和使用。

OpenCV的基本功能涵盖但不限于以下几点:

- 图像读写 :快速加载和保存各种格式的图像文件。

- 基本图像处理 :包括图像滤波、边缘检测、几何变换等。

- 高级图像处理 :如特征检测、模板匹配、物体识别。

- 视频处理 :提供视频读写、帧处理、运动分析等功能。

- 机器学习 :集成常用机器学习算法,用于模式识别、聚类等任务。

在图像识别训练集中,OpenCV常被用于图像预处理阶段,比如调整图像大小、转换颜色空间、应用滤波去除噪声等。

4.1.2 PIL的基本功能和应用

PIL(Python Imaging Library),现在一般称为Pillow,是Python的一个图像处理库。Pillow致力于为Python提供图像处理能力,包括打开、操作、保存多种格式的图片。Pillow简单易用,对于需要快速开发图像处理应用的开发者来说,是一个非常好的选择。

Pillow的基本功能包括:

- 图像创建和显示 :能够创建新图像,也可以在各种平台上显示图像。

- 图像像素操作 :直接读取和修改图像中的像素数据。

- 图像转换 :调整图像尺寸、旋转、裁剪等。

- 图像处理 :包括滤波、色彩处理、几何变换等。

- 图像格式支持 :支持众多图像格式,如JPEG、PNG、GIF等。

与OpenCV相比,Pillow对图像处理操作的API设计更接近于Python的习惯,同时在某些基础图像处理任务中速度更快。在实际应用中,根据不同的需求,开发者可以选择使用Pillow或OpenCV,甚至在同一个项目中同时使用两者。

4.2 批量处理的实现方法

4.2.1 编写脚本自动化截取流程

当需要处理大量图像时,编写脚本进行自动化截取是提高效率的关键。以Pillow为例,我们可以使用Python脚本自动加载图像,对图像进行必要的预处理操作,然后保存处理后的图像。

from PIL import Image

import os

# 设置图片所在的文件夹路径和需要保存的文件夹路径

image_folder = 'path/to/images'

output_folder = 'path/to/output'

# 确保输出文件夹存在

if not os.path.exists(output_folder):

os.makedirs(output_folder)

# 遍历图片文件夹中的所有文件

for filename in os.listdir(image_folder):

if filename.endswith('.png') or filename.endswith('.jpg'):

# 打开图片

img = Image.open(os.path.join(image_folder, filename))

# 执行一些图像处理操作,如调整大小、裁剪、滤波等

img = img.resize((256, 256)) # 示例:将图片大小调整为256x256

# 保存图片到输出文件夹

img.save(os.path.join(output_folder, filename))

print("处理完成!")

上述代码展示了使用Pillow进行图像批量处理的基本逻辑:加载、处理、保存。开发者可以根据实际需求调整图像处理的细节。

4.2.2 批量处理的优势与局限

批量处理的优势是显而易见的。首先,它显著提高了工作效率,自动化流程可以在数分钟内处理成千上万的图像,而手动处理这些图像可能需要数周甚至数月的时间。其次,批量处理可以确保每一图像都经过相同的一系列处理步骤,保证处理结果的一致性和重复性。

然而,批量处理也有其局限性。其一,初始的脚本编写需要一定的时间和专业知识,特别是对于复杂的图像处理任务。其二,图像识别训练集的特殊需求可能无法仅通过批量处理完全满足,需要个别审查和调整。其三,对于异常情况的处理,批量处理可能不如人工处理精细。

总之,批量处理工具是图像识别训练集准备中不可或缺的组件,它们大大提升了准备工作的效率和质量。然而,对于高度专业化的图像处理任务,结合人工审查和调整仍然是必要的。

5. 数据增强与类别平衡

在深度学习和计算机视觉领域,数据集的质量和多样性是决定模型性能的关键因素。本章将深入探讨数据增强技术的应用及其对模型性能的影响,并重点分析类别不平衡问题及其解决策略。

5.1 数据增强技术的应用

数据增强是一种提高图像数据集多样性的技术,通过在不改变标签的前提下,对图像进行各种变换,从而生成新的训练样本。这些变换包括旋转、缩放、裁剪、颜色变化等。

5.1.1 数据增强的常用技术

在构建图像识别模型时,常见的数据增强技术包括但不限于以下几种:

- 旋转(Rotation) :随机旋转图片一定角度,以模拟不同的观测角度。

- 缩放(Scaling) :对图片进行随机缩放,增加模型对物体大小变化的适应性。

- 裁剪(Cropping) :随机裁剪图片的一部分,以增加模型对物体位置变化的适应性。

- 颜色变化(Color Augmentation) :包括改变亮度、对比度、饱和度,甚至是应用色彩空间变换(如Hue、Saturation、Value变换)。

- 水平/垂直翻转(Flipping) :通过水平或垂直翻转图片来增加变化。

下面是一个使用Python和OpenCV库进行图像旋转增强的示例代码:

import cv2

import numpy as np

# 读取图片

image = cv2.imread('path/to/image.jpg')

(h, w) = image.shape[:2]

# 随机生成旋转角度

center = (w // 2, h // 2)

M = cv2.getRotationMatrix2D(center, np.random.uniform(-20, 20), 1.0)

# 旋转图片

rotated = cv2.warpAffine(image, M, (w, h))

# 展示旋转后的图片

cv2.imshow('Rotated', rotated)

cv2.waitKey(0)

cv2.destroyAllWindows()

5.1.2 数据增强对模型性能的影响

数据增强对模型性能的影响是显著的,主要体现在以下几个方面:

- 提高泛化能力 :通过数据增强,模型能在训练过程中见到更多样化的样本,从而在面对新的、未见过的数据时有更好的泛化能力。

- 减少过拟合 :适当的数据增强可以减少模型在训练集上的过拟合现象,使模型更加健壮。

- 提升识别准确性 :多样化的训练样本可以帮助模型更准确地识别特征,尤其是在分类任务中。

尽管数据增强的好处很多,但也应注意适度原则,过度的数据增强可能会引入不自然的样本,反而对模型性能产生负面影响。

5.2 类别平衡的重要性与实现

在实际应用中,类别不平衡是一个常见的问题,尤其是对于那些少数类别(如异常检测)更是如此。类别不平衡指的是不同类别的样本数量差异很大,这会导致模型倾向于预测数量较多的类别,从而忽视少数类。

5.2.1 类别不平衡问题的识别

类别不平衡问题可以通过分析各类别的样本数量比例来识别。当一个或多个类别相对于其他类别拥有压倒性的样本量时,就可以认为存在类别不平衡问题。

5.2.2 类别平衡的方法与策略

为了解决类别不平衡问题,可以采取以下策略:

- 重采样技术 :通过过采样少数类别或欠采样多数类别,使各类别的样本数量达到平衡。例如,在过采样时可以使用SMOTE(Synthetic Minority Over-sampling Technique)算法生成新的少数类别样本。

- 修改损失函数 :在训练模型时,可以对不同类别的样本赋予不同的权重,使得模型对少数类别样本给予更高的关注。这种方法被称为加权损失函数。

- 多任务学习 :通过引入辅助任务,提升模型对少数类别的学习兴趣和能力。例如,在主要的分类任务之外,增加一个辅助任务来预测样本的类别分布或类别相关性。

下面展示了一个简单的过采样实例,使用Python的 imblearn 库进行过采样:

from imblearn.over_sampling import RandomOverSampler

import pandas as pd

# 假设有一个DataFrame,其中一列是标签

data = pd.DataFrame({

'image': images, # 图像数据列表

'label': labels # 图像对应的标签

})

# 定义采样策略

ros = RandomOverSampler(random_state=0)

# 应用过采样,重新获得平衡后的数据

X_resampled, y_resampled = ros.fit_resample(data[['image']], data['label'])

# 输出各类别平衡后的数量

print(pd.Series(y_resampled).value_counts())

通过上述方法,我们可以有效地处理类别不平衡问题,进而提升模型对少数类别的识别能力。在实际操作中,可能需要综合使用多种方法,以达到最佳效果。

6. 训练集的标注与划分

6.1 标注质量的必要性

标注是图像识别中不可或缺的一环,它为训练集提供了必要的参考标签,使得机器能够学习并区分不同的图像特征。标注质量直接关系到模型训练的效果和最终的识别性能。

6.1.1 标注不准确的影响

不准确的标注会误导模型学习,导致模型的泛化能力下降。例如,在一个行人检测的项目中,如果将车辆错误地标记为行人,模型就可能将车辆误判为行人,从而在实际应用中出现误报。标注的不一致性同样会导致模型性能的波动,因为不同标注人员的标注标准不统一,模型就会接收到混杂的数据,难以构建出稳定准确的判断标准。

6.1.2 提高标注质量的措施

为了提高标注质量,可采取以下措施: - 制定严格的标注规范 :确保每个标注员都清楚明确的标注标准,减少歧义。 - 进行标注培训 :对标注员进行专业的培训,提高其专业能力和标注准确度。 - 实施标注审核制度 :完成初步标注后,由经验丰富的审核员进行复审,确保标注质量。 - 使用半自动化标注工具 :引入半自动化的标注工具,提高标注效率,同时保持标注的准确性。

6.2 训练集、验证集与测试集的划分

在机器学习项目中,将数据集划分为训练集、验证集和测试集是常见的实践,以评估模型性能并避免过拟合。

6.2.1 各数据集的作用与划分原则

- 训练集 :用于模型的学习,模型通过训练集数据学会识别图像中的特征。

- 验证集 :在模型训练过程中用于调整超参数,如学习率、批大小等。它是模型性能的评估者,但不直接参与训练。

- 测试集 :在模型训练完成后使用,用于最终评估模型的泛化能力。测试集数据是模型从未见过的,因此可以更公正地评价模型的性能。

合理的划分原则如下: - 随机分配 :数据集应该随机分配到训练集、验证集和测试集,以保证数据的代表性和均匀性。 - 比例适当 :通常按照70%训练集、15%验证集和15%测试集的比例分配,但根据具体情况可以适当调整。 - 保证类别平衡 :确保每个类别的数据在各个数据集中都有适当的比例,以避免类别不平衡对模型性能造成影响。

6.2.2 数据集划分方法及注意事项

数据集的划分方法如下: - 简单的随机划分 :直接随机打乱数据,然后按照预定的比例分配到各个集。 - 分层抽样 :在保证每个类别比例不变的前提下进行随机划分,确保每个集都具有良好的代表性。

注意事项: - 保留时间信息 :在处理时间序列数据时,要确保训练集、验证集和测试集中的数据是按照时间顺序正确分配的。 - 避免数据泄露 :在划分数据集之前,确保没有将验证集或测试集中的数据用于训练过程中的任何决策,以避免模型学习到不应该学习的信息。

划分数据集是构建高效模型的一个关键步骤,适当的划分方法能够帮助我们更加准确地评估模型的性能,并确保模型具有良好的泛化能力。

简介:在图像识别领域,构建一个高效的训练集是至关重要的,它包括大量正样本和负样本图片。正样本含有特定目标,负样本则不含有。手工制作训练集的过程繁琐,但可以通过批量处理工具如OpenCV或PIL自动化,提高效率。"批量手工截取正负样本图片,制作训练集"的工具包提供了一系列程序,帮助用户自定义参数如图像大小、样本数量,应用数据增强技术和类别平衡,从而有效地创建训练集。

更多推荐

已为社区贡献141条内容

已为社区贡献141条内容

所有评论(0)